对抗知识焦虑,从看懂这条开始

App 下载

把3D重建从“野蛮生长”掰回“预算可控”

多传感器数据|3D重建|高斯点预算控制|3D高斯溅射|YOGO系统|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

多传感器数据|3D重建|高斯点预算控制|3D高斯溅射|YOGO系统|AI产业应用|人工智能

想象你用3D扫描仪复刻一套房子,扫到一半突然弹出“内存不足”——这不是科幻场景,而是3D高斯溅射(3DGS)技术落地时的真实尴尬。这项曾以“实时高保真3D重建”惊艳学术界的技术,却因高斯点无节制“野蛮生长”、多传感器数据杂乱冲突,始终卡在实验室与工厂的中间地带。直到2026年4月,一套名为YOGO的系统出现,它第一次把3D重建的资源消耗从“开盲盒”变成了“明码标价”——你说要150万个高斯点,它就给你150万个,不多不少。

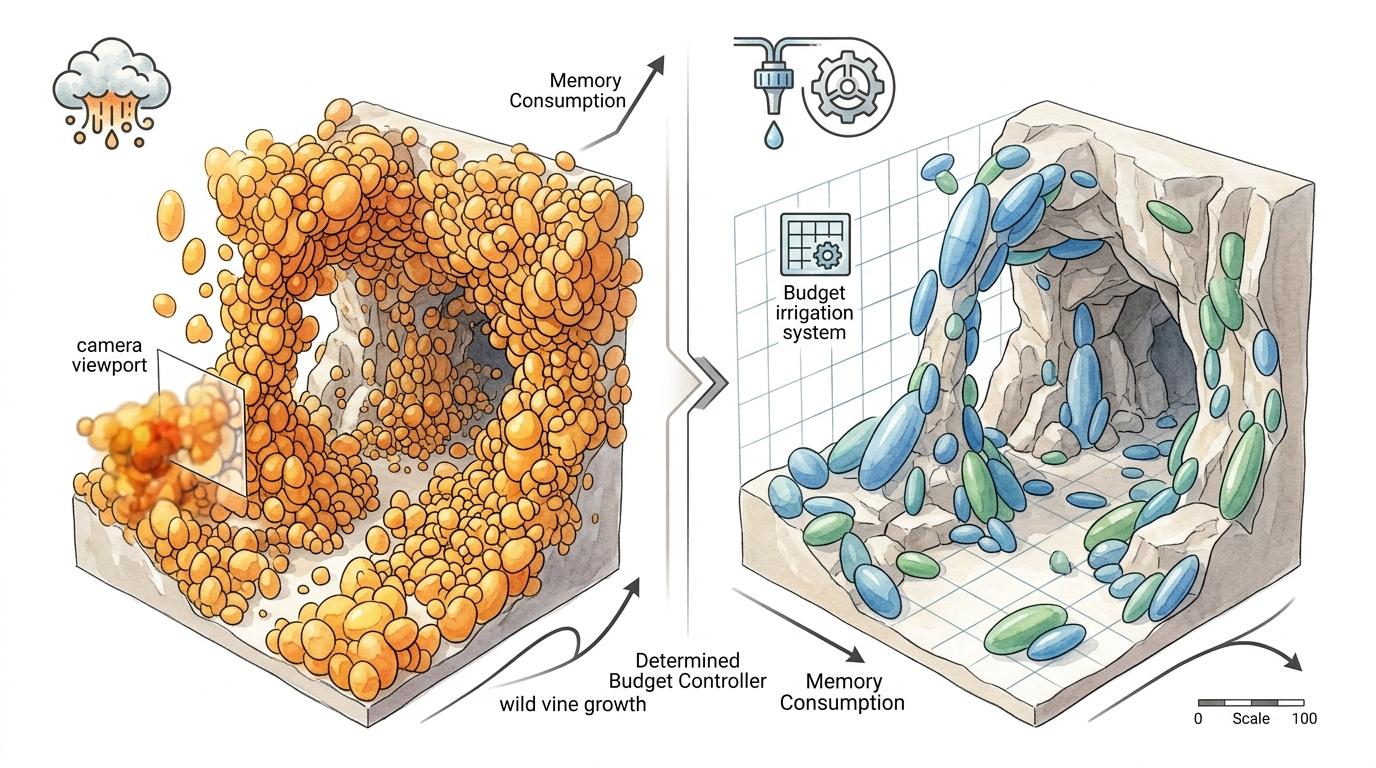

你可以把传统3DGS的高斯点生长想象成没人管的野生藤蔓:只要有数据就疯狂分裂,直到把内存撑爆。YOGO的核心突破,就是给这套藤蔓装了个精准的“滴灌系统”——确定性预算控制器(DBC)。

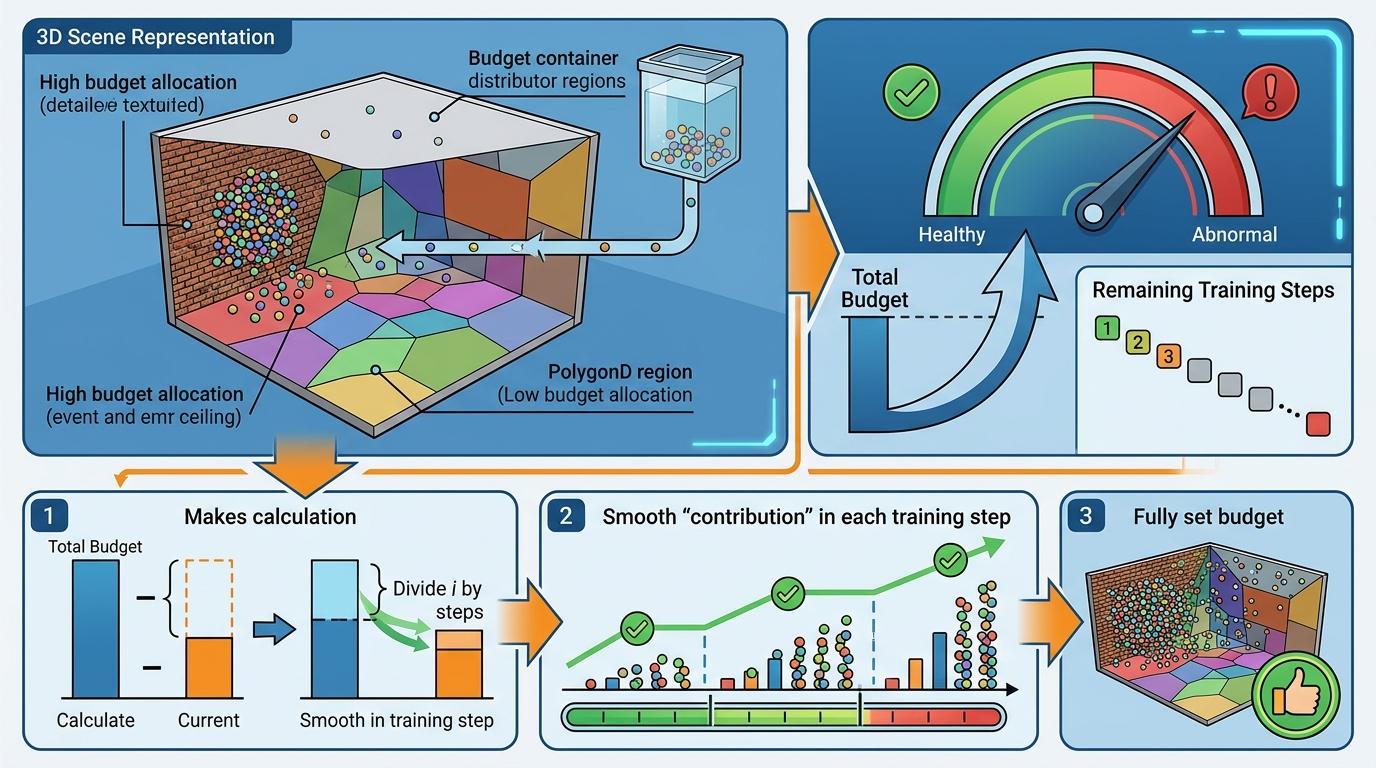

它先把整个3D场景划分成一个个多边形区域,比如给纹理复杂的墙面多分配预算,给空旷的天花板少分配。每次高斯点要“生长”时,系统会先算清楚:离预设的总预算还差多少?剩下的训练步骤还有几次?然后把缺口平均分摊到每一步里,像还房贷似的平稳“供款”,绝对不超额。

更聪明的是,它不会随便让高斯点分裂,只会挑那些梯度幅值最高的点——也就是重建误差最大、最需要补充细节的地方。这样一来,150万个高斯点能发挥出传统方法400万个点的效果,资源利用率直接翻了倍。

工业场景里的3D数据从来不是“干干净净”的:主相机拍的照片曝光正常,辅助全景相机可能过曝,激光雷达的数据还带着噪声——直接把这些数据混在一起训练,结果就是一团糊。

YOGO的解决思路像办一场严谨的会议:先让主传感器单独“发言”,训练出一个基准模型;再让每个辅助传感器“对着基准校准自己的口音”——给每张辅助照片计算一个颜色变换矩阵,和基准模型的偏差越大,说明数据“污染”越严重;最后给所有辅助数据打分,只有得分达标的才能加入训练。

这套流程下来,原本杂乱的多传感器数据就像经过统一校对的书稿,不仅不会拖后腿,还能互补细节。测试显示,用这种方法融合的数据,在陌生视角下的重建精度比直接融合提升了12%。

过去的3D重建数据集,就像用几张照片拼全景图——算法不得不靠“脑补”填补视角空白,看起来效果不错,实则是在“作弊”。YOGO团队同步推出的Immersion v1.0数据集,直接把这种“幻觉”戳破了。

他们在每个室内场景拍了3万张照片,是传统数据集的15倍,平均每个空间体素被数百个视角覆盖。这意味着算法再也不能靠“脑补”混过去,必须老老实实地还原每一处物理细节。配套的实体优化套件还能精准“修剪”掉那些对渲染毫无贡献的高斯点,进一步压缩模型体积却不损失细节——就像给大树剪去无用的枯枝,养分全用在长新叶上。

当然,这套系统也有局限:目前只验证了室内静态场景,室外大尺度和动态场景的适配性还没经过测试;多传感器融合的阈值参数,也需要针对不同场景微调,自动化程度还有提升空间。

从“野生藤蔓”到“精准滴灌”,YOGO的本质不是发明了新的3D重建技术,而是给一项天才技术套上了工业级的“缰绳”。它让3D重建从“追求极致效果”转向“平衡效果与成本”,这恰恰是从实验室走向工厂的核心一步。

可控,才是技术落地的第一要义。当越来越多的前沿技术学会在“预算”里跳舞时,我们离真正的“数字孪生”时代,也就更近了一步。