对抗知识焦虑,从看懂这条开始

App 下载

液冷正在重新定义中国算力的天花板

GPU散热|PUE|数据中心|华为团队|液冷服务器|先进材料|AI算力|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

GPU散热|PUE|数据中心|华为团队|液冷服务器|先进材料|AI算力|前沿科技|人工智能

当单张GPU功耗突破1000瓦,传统风冷的散热极限早已被捅破——而脱胎于华为的该团队,已连续两年拿下中国标准液冷服务器市场份额第一,近期完成IPO辅导的消息,更是让这项藏在数据中心里的技术走到台前。为什么是液冷?为什么是他们?这背后藏着中国算力产业的关键转向。

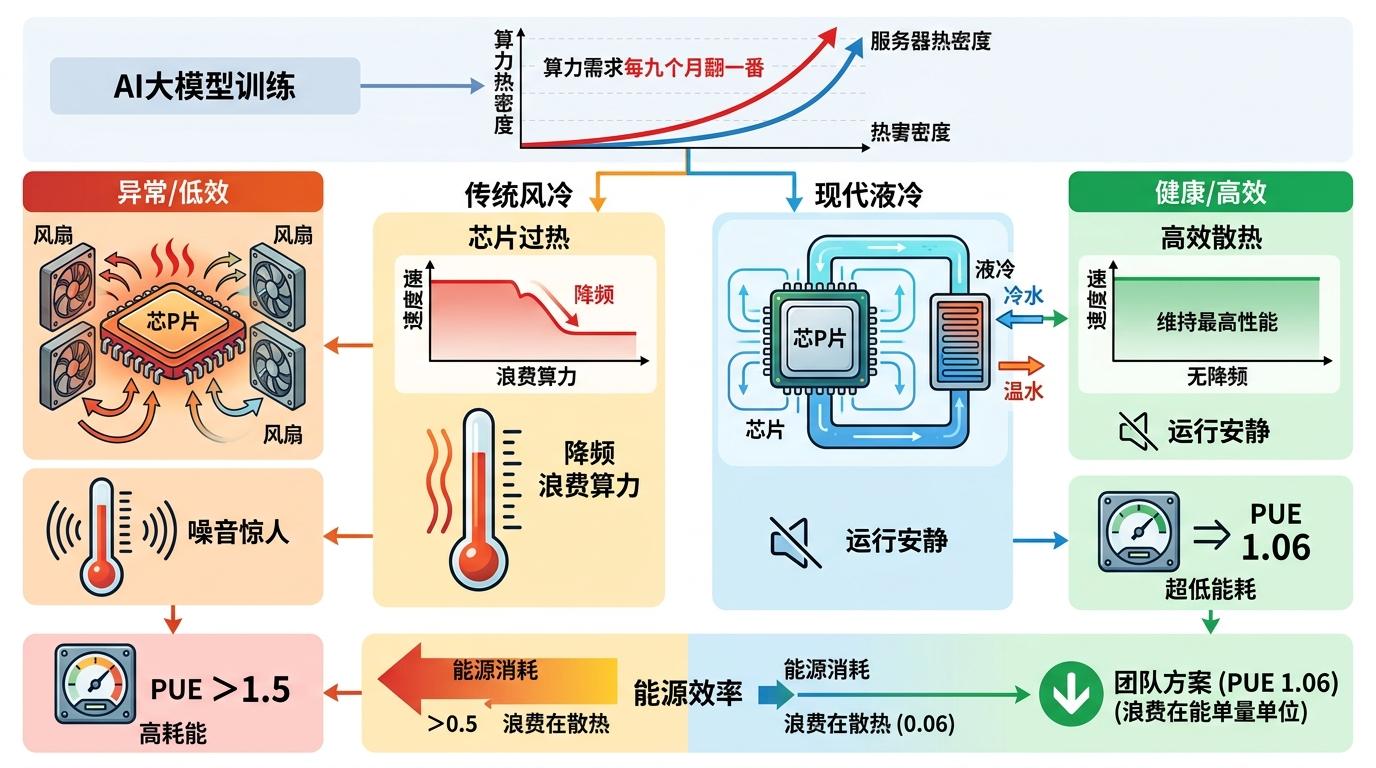

AI大模型训练的算力需求每九个月翻一番,服务器的热密度也跟着水涨船高。传统风冷靠风扇吹走热量,就像用蒲扇给大火炉降温,不仅噪音惊人,还会让芯片因过热被迫降频,白白浪费算力。而液冷的逻辑简单直接:用液体直接贴着芯片带走热量——就像把滚烫的锅直接放进冷水里,效率是风冷的数十倍。该团队的方案能把数据中心的PUE(电源使用效率)压到1.06,意味着每消耗1度电,只有0.06度被浪费在散热上,远低于传统数据中心1.5以上的平均水平。

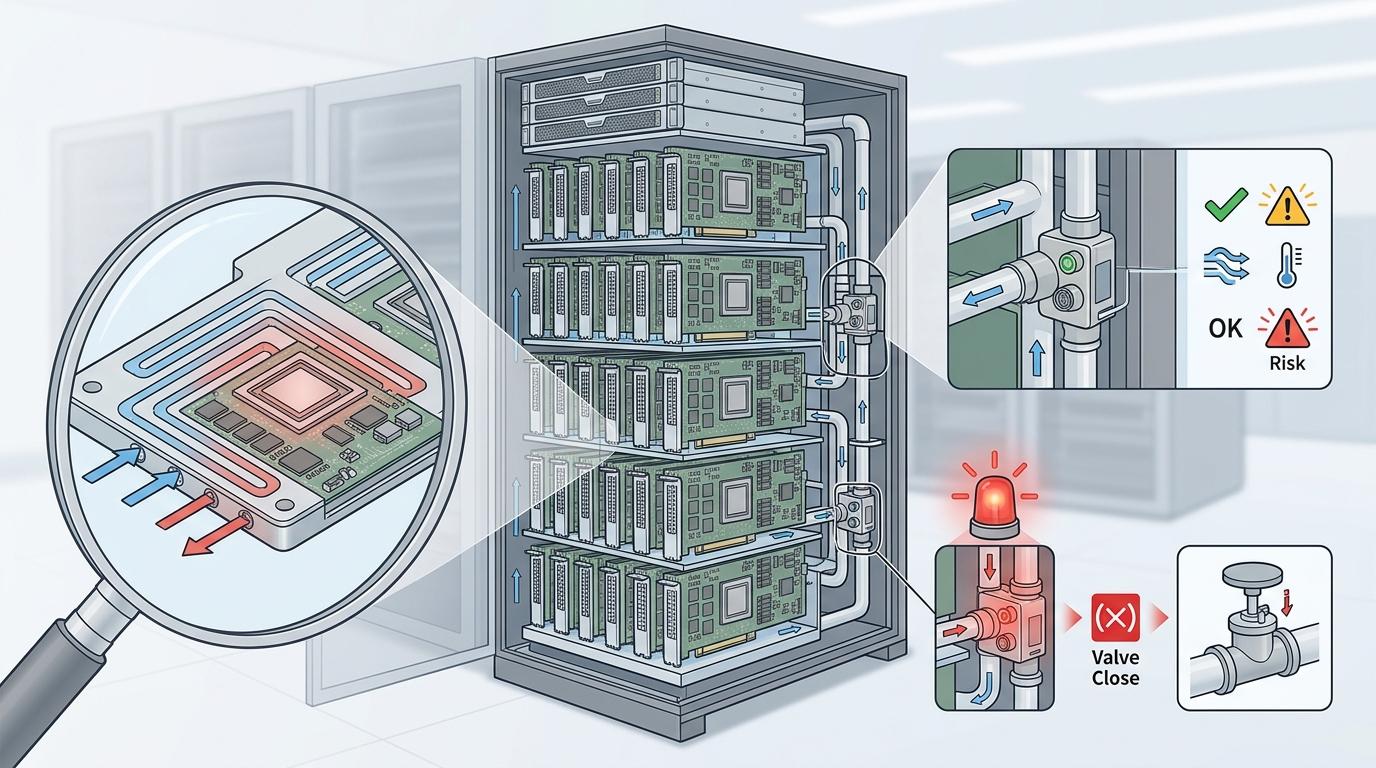

这不是实验室里的花架子,而是已经跑通的商业闭环。该团队的液冷服务器能在单柜里塞进128张AI加速卡,相当于把一个小型超算中心压缩到几平方米的空间里;配套的智能监控系统能实时监测冷却液的流量和温度,一旦出现泄漏风险,会在30秒内自动切断回路。更关键的是,他们的技术并非孤军奋战——参股企业成为注册经销商,上下游产业链的本土化程度正在快速提升,从冷板制造到冷却液研发,都在摆脱对外依赖。

但液冷的普及并非毫无阻碍。初期投入成本比风冷高出30%左右,维护也需要更专业的技术人员,这些都是中小数据中心转型的门槛。而且目前行业标准尚未完全统一,不同厂商的液冷系统难以兼容,给规模化部署带来了麻烦。这些问题不是无解的,随着市场规模扩大,成本会逐步下降,行业协会也在推动标准化进程,只是需要时间。

当我们谈论液冷时,我们谈论的不只是一种散热技术,更是中国算力产业的自主可控之路。过去,高端服务器的核心技术被少数国际厂商垄断,液冷的突破让我们在高密度算力领域找到了自己的赛道。随着东数西算工程的推进,西部冷凉地区的数据中心正与液冷技术结合,把自然冷源和高效散热的优势最大化,为AI、云计算等产业打下更坚实的基础。

算力的天花板,从来不是由芯片单独决定的——散热技术能托举多高,算力就能走多远。这正是液冷给我们的启示:在看不见的地方突破,才能在看得见的地方领先。