对抗知识焦虑,从看懂这条开始

App 下载

大模型评测不用写配置,一句话搞定全流程

评测报告生成|自然语言交互|自动化评测工具|北京大学DCAI团队|One-Eval|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

评测报告生成|自然语言交互|自动化评测工具|北京大学DCAI团队|One-Eval|大语言模型|人工智能

想象一下:你对着电脑说“帮我测测这个模型在金融、法律和幻觉控制上的能力”,不用找数据集、不用写配置脚本、不用排查格式错误,11分钟后一份标清所有指标含义、失败案例的分析报告自动出现在桌面。这不是科幻场景——2026年4月,北京大学DCAI团队开源的One-Eval,把大模型评测从“程序员专属的配置游戏”,变成了普通人也能上手的自动化工作流。为什么这套工具能解决行业卡了好几年的痛点?答案藏在它对“评测”的重新定义里。

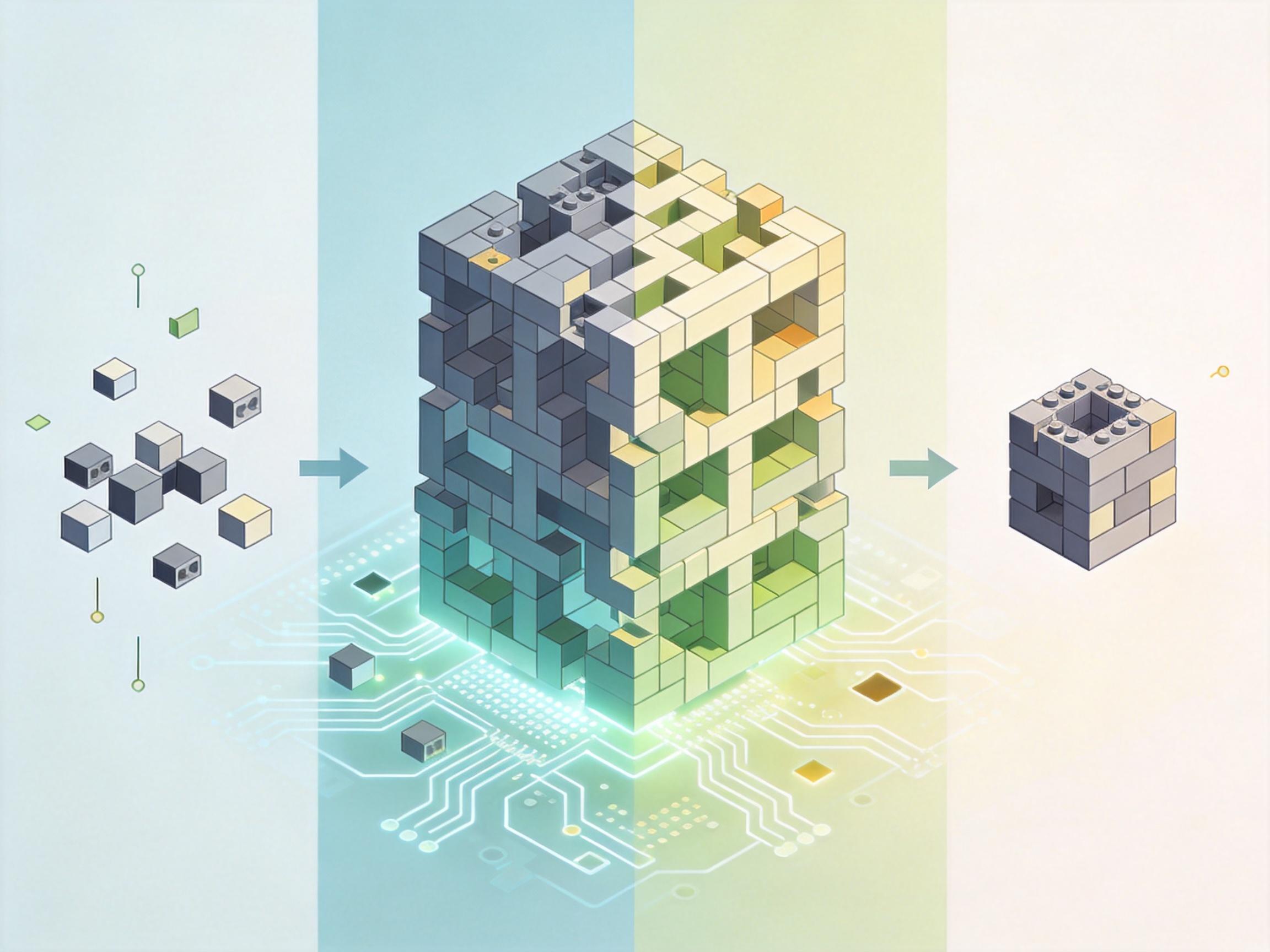

过去做一次大模型评测,像在搭一套精密的积木:你得先从几十种基准测试(benchmark)里挑合适的,手动下载数据集还要把不同格式的字段一一对应,写满几页配置参数后,跑起来可能还会因为某一行代码报错前功尽弃。有统计说,真正花在“测模型”上的时间,还不到搭流程的三分之一。

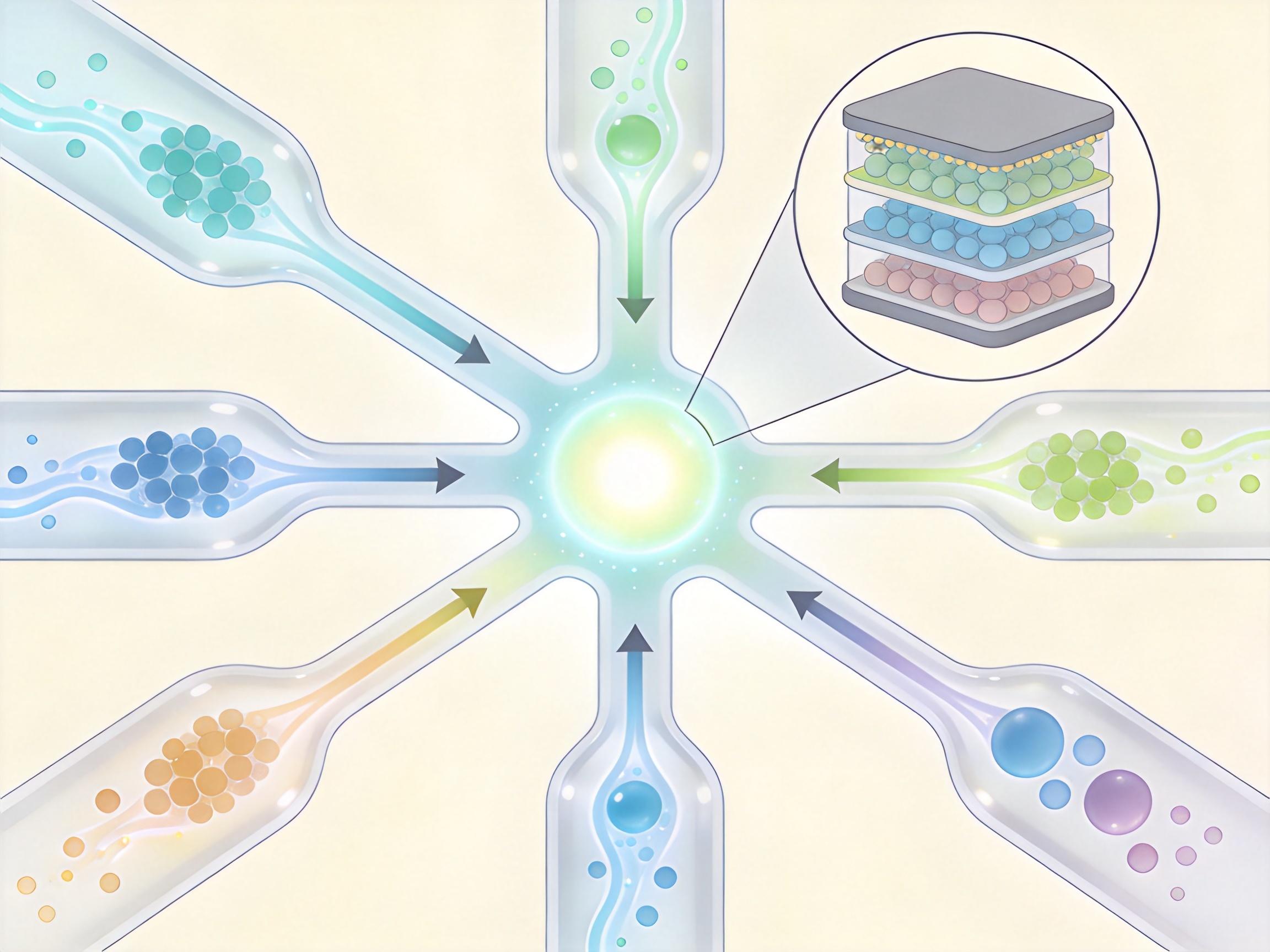

One-Eval把这套逻辑彻底倒了过来。它的核心是一个叫NL2Bench的模块——你可以把它理解成评测界的“智能助理”,能把你说的自然语言需求,自动拆解成结构化的评测任务:要测金融能力就调用FinanceQA,要查幻觉就匹配TruthfulQA,连对应的评测指标都会自动推荐。在实测的100个需求里,它能99%准确解析意图,84%实现从数据下载到报告生成的全自动化,全程不用你写一行配置。

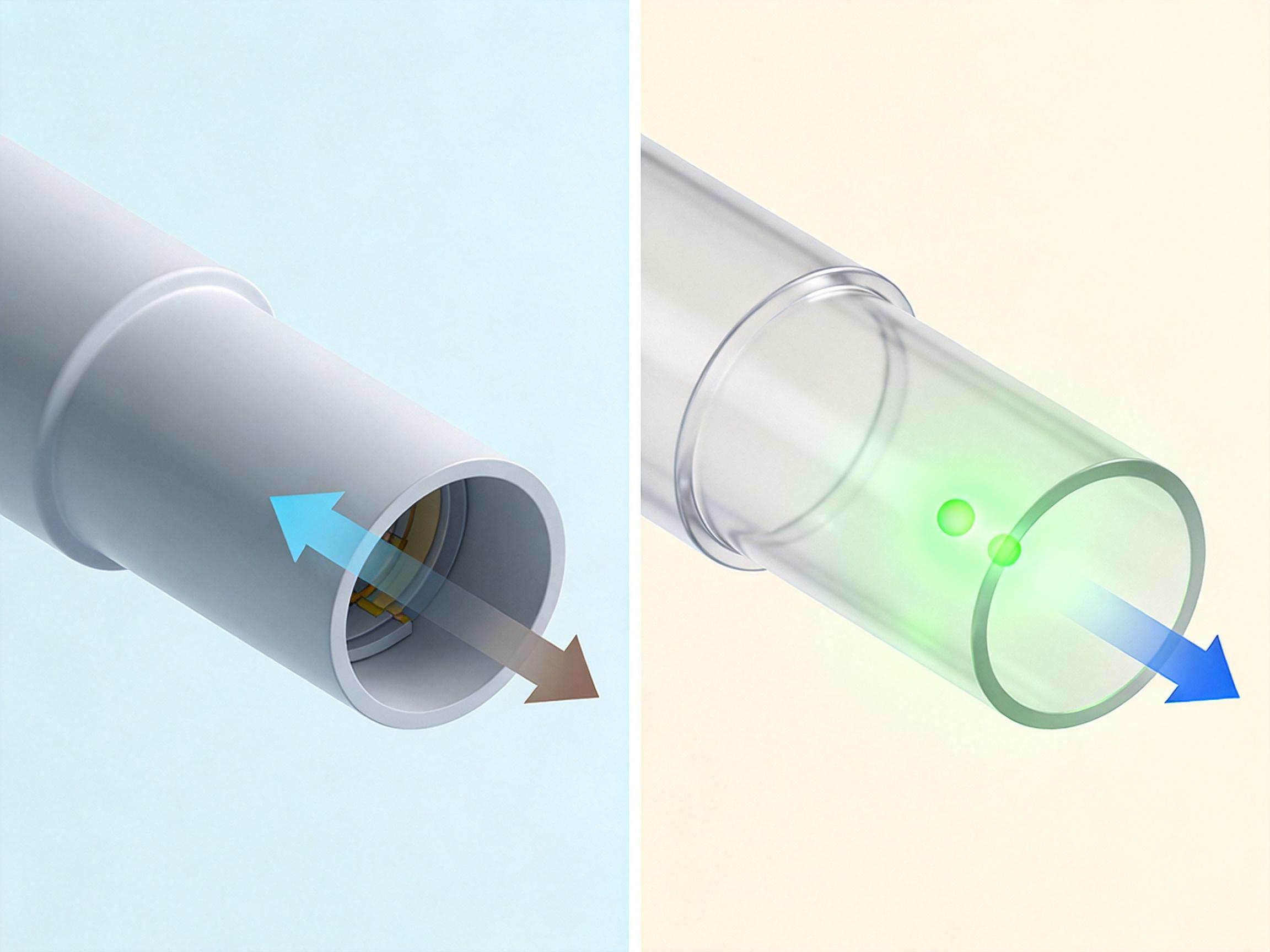

传统评测框架像一条单行道——数据从一端进,分数从另一端出,中间的推理过程、错误原因全是黑箱。要是结果出了问题,你得从几百行日志里挨个排查,比找一根掉进米缸的针还难。

One-Eval的破局点,是它底层的全局状态(Global State)数据总线架构。你可以把这个架构想象成一个全程录像的指挥中心:评测的每一步——从你输入需求的瞬间,到系统选了哪个基准测试、下载了哪份数据、模型输出了什么内容、甚至中间哪一步暂停等你确认——所有信息都被实时记录在一个动态的“状态库”里。不管是中途中断评测,还是事后想复盘某一个分数的由来,你都能像拉进度条一样回溯全程。这种全链路可追溯的设计,把评测从“一锤子买卖”变成了可调试、可审计的完整流程。

当然它也没把人完全排除在外。在选基准测试、确认关键参数这些节点,系统会主动停下来等你拍板——毕竟有些行业的特殊需求,还是得人来把控方向。

One-Eval不是没有局限:它目前对低资源语言的评测支持还不够完善,面对完全自定义的小众任务,自动适配的准确率会下降;而且它的智能推荐依赖已有的基准测试库,要是你想测一个全新的能力维度,还是得手动补充配置。 但它最值得肯定的地方,是抓住了大模型评测从“实验室研究”转向“工业级应用”的核心需求——效率和可复用性。过去只有大厂的专业团队能频繁做评测,现在创业公司甚至个人开发者,也能通过自然语言快速验证模型能力。在实测DeepSeek-V4时,它只用了11分钟就完成了金融、法律、医疗三个领域的评测,生成的报告里不仅有分数,还标清了每个指标的含义,连模型在哪道题上犯了幻觉都列得明明白白。

当大模型的能力越来越强,评测的复杂度也在指数级上升——就像给一辆每秒进化的跑车做年检,传统的卡尺和秒表早就不够用了。One-Eval的出现,本质是用AI的方式解决AI带来的问题:让自动化工具接管重复的机械劳动,把人从繁琐的配置里解放出来,专注在真正需要判断的关键环节。 评测的终极目标,从来不是分数,而是让AI的能力边界清晰可见。 从手动搭积木到智能助理式的工作流,这不仅是效率的提升,更是AI产业走向成熟的信号——当我们能准确、高效地衡量AI的能力,才能更放心地把它放进真实的生产场景里。