对抗知识焦虑,从看懂这条开始

App 下载

AI的“奥数时刻”:当顶级大模型兵败AMO-Bench,一场关于智能极限的博弈才刚刚开始

高阶推理能力|Qwen3-Max|Gemini 3 Pro|GPT-5-Thinking|AMO-Bench|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

高阶推理能力|Qwen3-Max|Gemini 3 Pro|GPT-5-Thinking|AMO-Bench|大语言模型|人工智能

想象一个考场,坐满了当今世界最聪明的“学生”——GPT-5-Thinking、Gemini 3 Pro、Qwen3-Max……它们在过去的各类考试中几乎战无不胜,从基础的GSM8K到高难度的数学竞赛AIME、HMMT,满分捷报频传,似乎已经触及了知识的穹顶。然而,一张全新的试卷发下,考场瞬间安静。当成绩公布时,整个科技界都感到了震动:几乎所有顶级模型都未及格,曾经的“学神”们集体遭遇滑铁卢。这并非科幻小说,而是2025年11月真实上演的一幕。这张名为AMO-Bench的试卷,如同一面冷峻的镜子,照出了人工智能在迈向更高阶推理能力道路上,那条清晰可见却又难以逾越的鸿沟。

事件的主角,是美团的LongCat团队联合多所顶尖高校共同推出的全新数学竞赛测试集——AMO-Bench。这不仅仅是一套包含50道原创难题的题库,更是一场精心设计的“阳谋”,旨在给高歌猛进的大模型赛道泼一盆“冷水”,迫使业界重新审视AI推理能力的真实边界。

成绩单 starkly 揭示了现状:

AMO-Bench的出现,宣告了AI“刷题时代”的终结。当旧的标尺失去衡量意义,新的、更严苛的度量衡便应运而生。

大模型与评测基准的演进,就像一场永不停歇的“猫鼠游戏”。

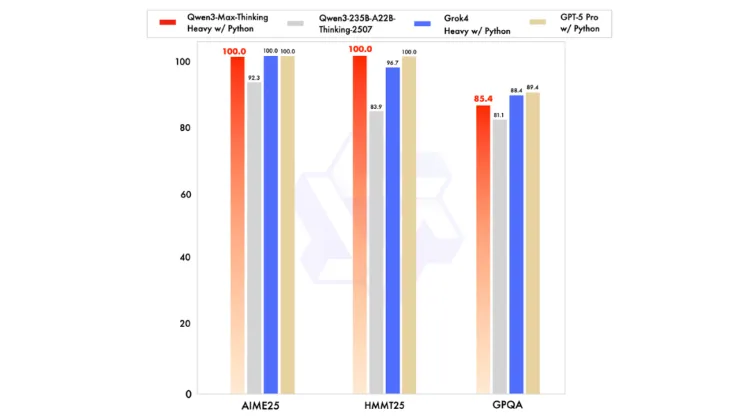

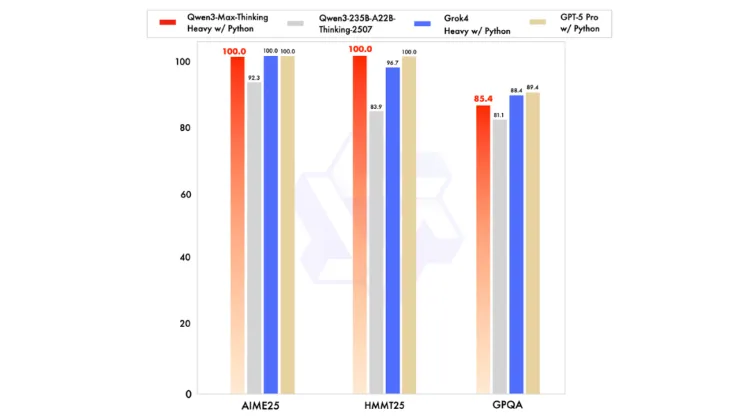

这条进化之路始于GSM8K这样的“小学数学题”,它们很快就成了大模型的“白送分”项目。随后,MATH数据集提高了难度,模型们奋力追赶,逐渐饱和。再后来,AIME(美国数学邀请赛)等竞赛级基准成为新的战场,直到GPT-5、Qwen3等模型相继取得满分,人们一度以为AI的数学推理能力已经接近完美。

然而,每一次“满分”的背后,都隐藏着评测体系失效的风险。模型可能只是在海量的训练数据中“见过”类似的题目,形成了路径依赖,而非真正掌握了底层的抽象推理能力。正如DeepMind的AlphaProof系统虽然在2024年的IMO竞赛中取得银牌,展现了惊人的实力,但也同样刺激着研究者们去构建更严苛的试炼场。

AMO-Bench正是在这样的背景下诞生的。它的构建过程堪称“铸剑”,每一步都为了确保其成为一把能够刺穿模型能力表象的“利刃”:

这条从“已知”迈向“未知”的评测进化之路,本质上是在探索如何更科学地度量机器的“智力”,推动AI从模仿走向真正的理解与创造。

AMO-Bench不仅是一次“摸底考”,更是一次深入的“思维诊断”。它揭示了当前大模型在面对极限挑战时的一些核心行为模式。

最引人注目的便是**“长度换准确率”**的现象。模型在更难的榜单上,输出会显著变长。同一模型,其正确率与输出长度的对数呈现出近线性的正相关关系。这说明,在现有架构下,AI提升推理深度的一个重要手段,就是增加推理步骤的广度和密度,即所谓的“暴力计算”。这是一种有效的策略,但也暴露了其推理效率的瓶颈。

与此同时,我们看到了模型迭代带来的效率提升。例如,OpenAI的o4-mini在与前代o3-mini相近的Token消耗下,实现了更高的正确率。这表明,算法和架构的优化,正在让AI的“思考”变得更加高效和精炼。

更有希望的是,顶级模型内部似乎蕴藏着更大的潜力。通过Pass@32(即模型尝试32次后取最佳答案)的指标来看,GPT-5-Thinking等模型的成绩可以触及70%以上。这暗示着,正确的解题路径已经存在于模型的“知识空间”中,只是模型尚不能稳定地、第一次就找到它。如何激活和引导这种“隐藏”的能力,将是未来研究的关键方向。

AMO-Bench的出现,为大模型的发展树立了新的灯塔,但它远非终点。当AI最终也能征服AMO-Bench时,我们又该去向何方?

这场关于智能极限的博弈,正在引导我们走向更深层次的思考。正如数学家陶哲轩在使用AI辅助研究时的感悟:“AI可以成为证明的发动机,而人类依然是结构的设计师。它能把定理算完,却算不出‘意义’。”

或许,未来的评测体系将不再局限于给出最终答案的竞赛题,而是转向更开放、更接近真实科研探索的场景。比如,让AI自主发现新的物理定律(如AI-Newton项目),或者在形式化证明环境中协助数学家攻克百年猜想。那时的挑战,将不再是“解题”,而是“提问”和“创造”。

AMO-Bench的警钟已经敲响。它告诉我们,通往通用人工智能的道路远未平坦,模型的能力增长与评测体系的演进将长期处于一种动态的、螺旋上升的博弈之中。在这场人与机器、已知与未知的宏大叙事里,每一次极限的触碰,都是对“智能”本身更深刻的一次探索。而这,或许才是这场博弈最迷人的地方。