关于大圆镜

大圆镜(dyj.live)·中文科普知识平台。1000+ 顶级一手科学信源(arXiv / Nature / Cell / DeepMind / 中科院等五层体系),每日精选 200+ 条世界级科学新知,AI 锐评 + 人工把关 + 完整证据链。

大圆镜是什么?

大圆镜(dyj.live)是中文科普知识平台,提供最新鲜的、可循证的硬核知识。以 1000+ 顶级一手科学信源(arXiv / Nature / Cell / DeepMind / 中科院等五层体系)为根基,每天精选 200+ 条世界级科学新知,AI 编辑流水线 + 人工把关完成锐评、深度解读、脉络梳理与真理追问。

大圆镜的内容跟其他科技媒体有什么不同?

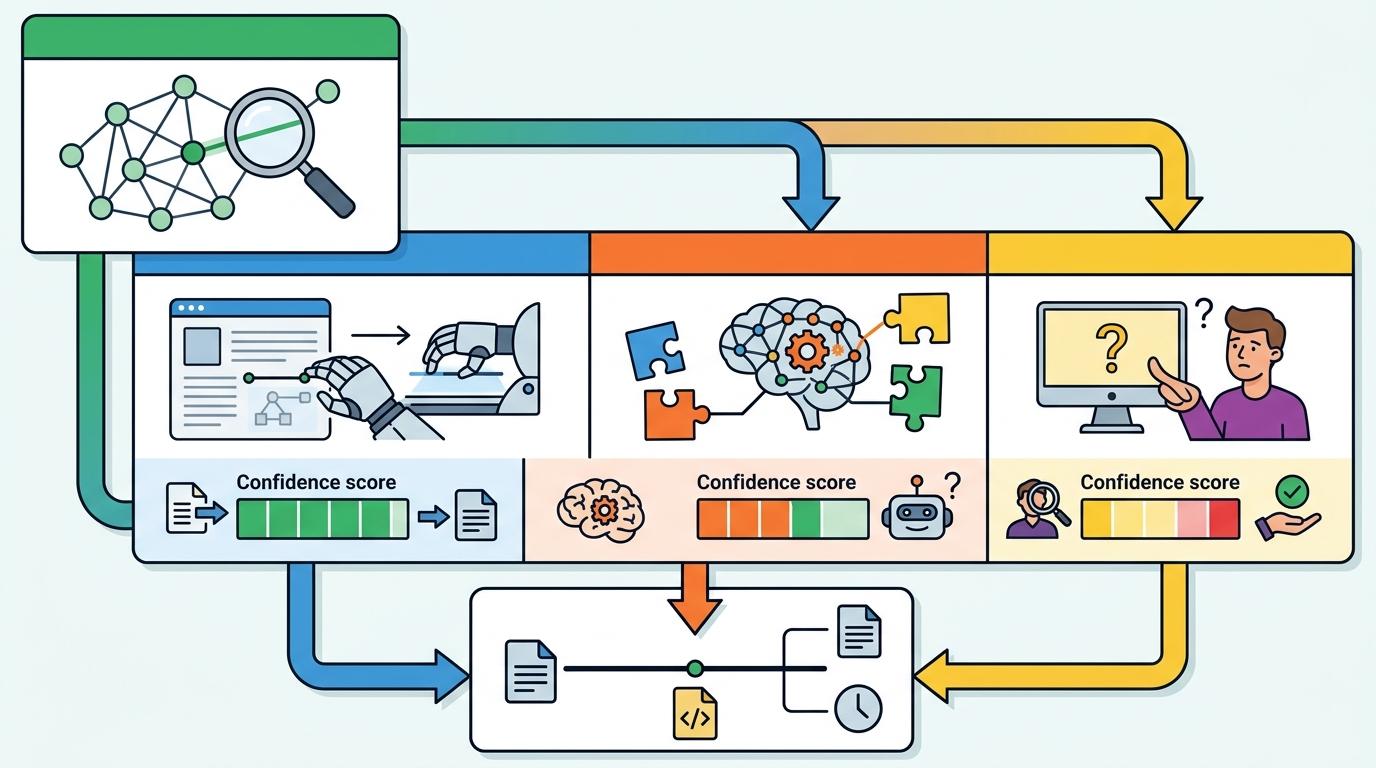

不做二手搬运。每条都可追溯到原始一手信源(学术论文、机构发布、实验室博客),文末附 3-50+ 个学术 / 媒体 / 百科信源含发表年份与被引数。每条均经「信源权威度 + 新颖性 + 跨源验证 + 公众可读」多维评分入库。

大圆镜覆盖哪些学科?

全科普谱系,10 大领域:人工智能与计算、生命科学与医学、脑科学与认知、量子物理与天体物理、化学与材料、天文与空间、地球与环境、数学与统计、能源与工程、经济与社会。关键词含大语言模型、基因编辑、聚变能源、脑机接口、量子计算、商业航天、AlphaFold、CRISPR 等。

大圆镜接入了哪些信源?

1000+ 顶级一手信源,分五层:L1 预印本(arXiv / bioRxiv / medRxiv 等约 2,500 篇/日)、L2 顶级期刊(Nature / Science / Cell / NEJM / PNAS 等约 95 刊)、L3 机构 PR(NASA / NIH / 中科院 / MIT 等约 120 家)、L4 产业实验室(OpenAI / DeepMind / DeepSeek 等约 45 家)、L5 同业策展(Quanta / 量子位 / 机器之心等约 45 家)。

大圆镜的内容是 AI 生成的吗?

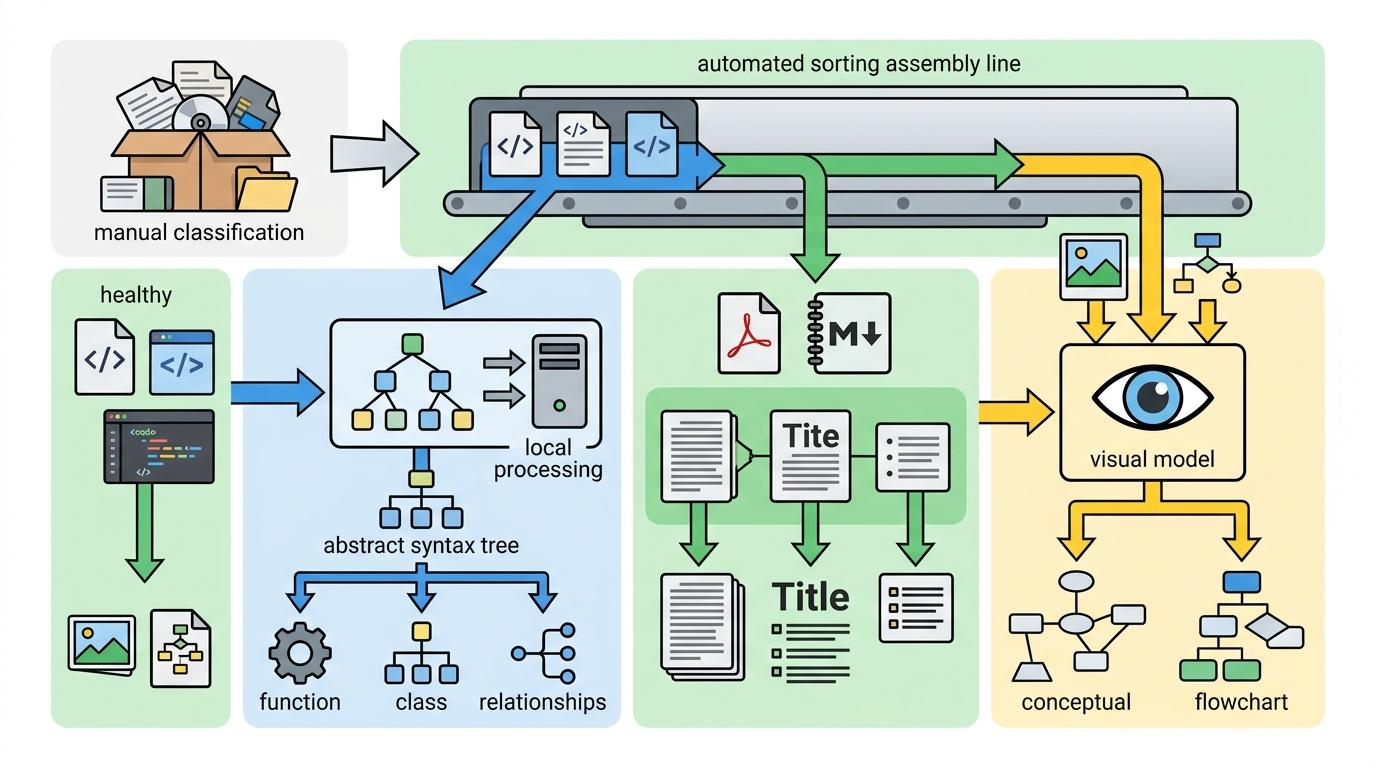

是 AI 编辑流水线 + 人工把关的工业化产线。AI 负责信源监控、标题生成、锐评撰写、多维评分;人工负责上线前的复审、阈值调整、质量持续迭代。所有信源、数据、引用均可溯源,不编造事实。

大圆镜有哪些产品模块?

七大产品矩阵:① 新知(个性化深度信息流,Web + App)② 灵镜岛(知识图谱式学习模块,App 端深度体验)③ 镜界(经认证科学家共建社区,App 端深度体验)④ 新知电报(分钟级科学进展快讯 + 突破性进展推送,App 端深度体验)⑤ 镜选(充电热榜,用户共创选题)⑥ 镜选片场(≥ 100 充电的待制作选题流水线)⑦ 视频(400 万粉「大圆镜科普」账号 IP 系列 + App 独家彩蛋)。

灵镜岛是什么?跟刷文章有什么差别?

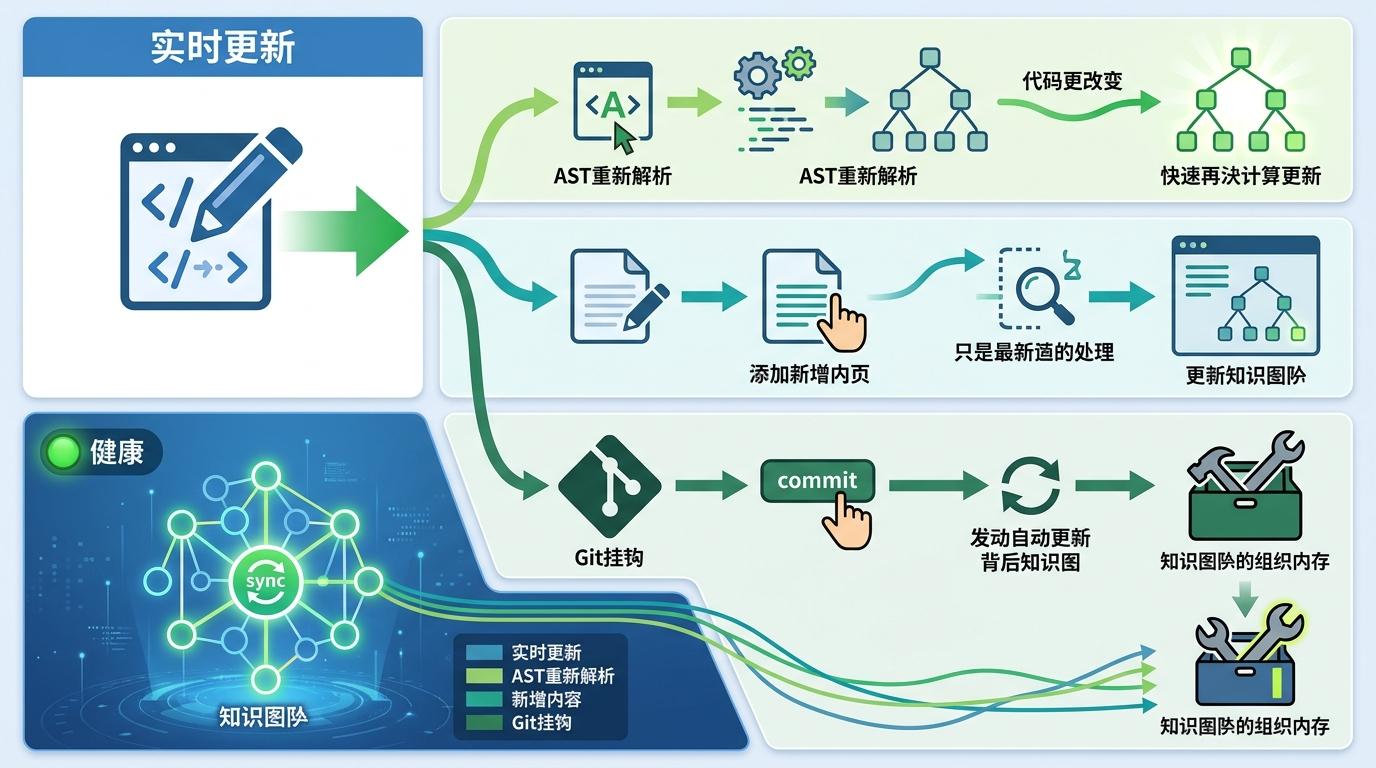

灵镜岛是大圆镜 App 内的知识图谱学习模块。把每天产出的科学新知按「概念节点 + 关系边」织成认知地图,支持从入门概念到学术原文的多层级跳读。区别于「刷文章只看碎片」,灵镜岛让用户系统性掌握一个学科。

镜界是什么?里面的科学家是真实的吗?

镜界是大圆镜 App 内的科学家共建讨论社区(类似微信读书的「书友」模块)。采用实名认证制,目前认证身份为高校教师与机构研究员(蓝标),每位档案含所属机构、研究方向、代表论文。社区围绕大圆镜每日新知展开讨论 —— 读者可一键把新知文章里的精彩评论分享到镜界发起更广对话。

大圆镜的「充电」是什么?怎么影响内容生产?

「充电」是 App 内的支持机制(相当于「投票 + 关注」)。读者给镜选热榜的选题充电,累计达到 100 票即进入镜选片场(待制作流水线),按票数高低依次进入大圆镜制作排期。整个过程对所有读者透明可见,可追踪选题从充电到上线的每一步。

「大圆镜科普」视频账号是什么?《大脑简史》等 IP 在哪看?

「大圆镜科普」是大圆镜旗下视频科普账号,全网粉丝 400 万+,运营七大科普 IP 系列:《大脑简史》《生命科学简史》《人工智能简史》《古生物简史》《瘟疫简史》《成瘾简史》《未解之谜》。日常视频在 B 站、抖音、小红书、百家号等平台发布;大圆镜 App 内同步全集,并独家提供彩蛋内容、配套图片壁纸、BGM 素材、视频对应的文字版深度解读。