对抗知识焦虑,从看懂这条开始

App 下载

不用GPU训数据,蝴蝶萤火虫搞定低光修图

CPU图像增强|蝴蝶萤火虫方法|无监督算法|低光修图|AIGC|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

CPU图像增强|蝴蝶萤火虫方法|无监督算法|低光修图|AIGC|人工智能

深夜街头拍的夜景糊成一片黑,噪点多到像撒了芝麻——你肯定有过这种想删照片的时刻。过去要么靠大佬手动调14个参数碰运气,要么用深度学习烧GPU训几十万张图,前者看脸后者看钱。但法国研究者最近搞出的新方法,居然让蝴蝶和萤火虫来当「自动修图师」,不用一张训练数据,修图效果直接超过了经典深度学习模型。更离谱的是,它连GPU都不用,普通CPU就能跑。这到底是怎么做到的?

你可以把低光修图想象成装修老破小:得先把昏暗的屋子提亮(亮度校正)、把墙皮上的霉斑去掉(去噪)、最后再给家具刷上合适的漆(色彩恢复)。过去这三步的14个「装修参数」全靠人工试,换个屋子就得重来一遍。

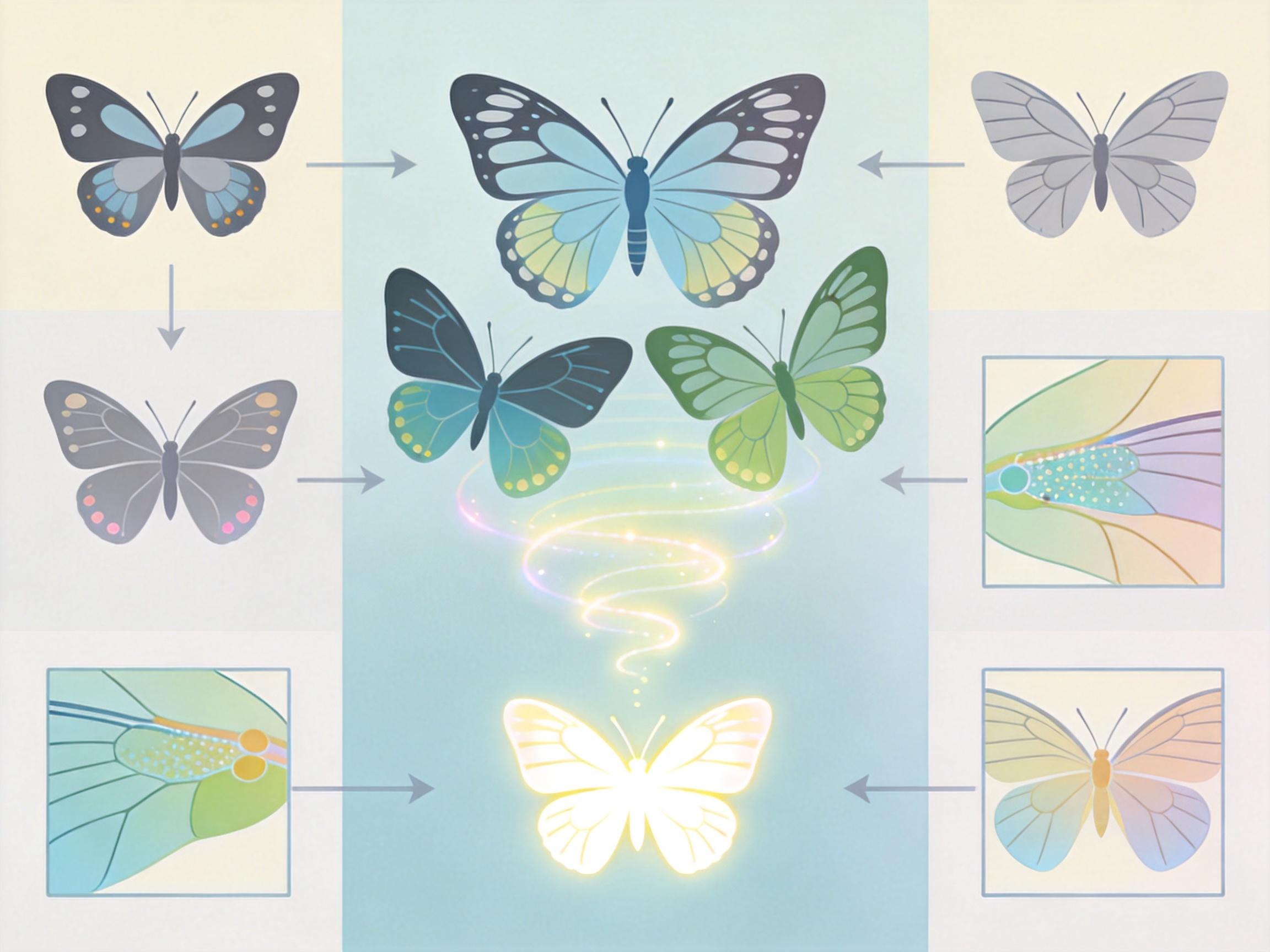

现在这两只小虫接手了装修:蝴蝶算法负责「全局找最优方案」——它模拟蝴蝶靠气味找花蜜的行为,每只蝴蝶代表一组参数组合,「香气越浓」说明修图效果越好,所有蝴蝶都会往香气最浓的方向飞,一口气把影响全局色彩的8个参数试到最优。

而萤火虫算法则是「局部精修工」——它模仿萤火虫靠亮光聚集的习性,盯着亮度校正和去噪的6个参数死磕,比如提亮时的伽马值、去噪的滤镜强度,一点点把细节磨到最舒服。

关键是它们还会自动换班:先让蝴蝶飞几圈找到大致方向,等蝴蝶们飞不动了(收敛停滞),萤火虫立刻接上做精细调整,既不会漏掉最优解,也不会在细节上浪费时间。

在低光修图界的「高考卷」LOL数据集上,这套叫BFORE的方法交出了惊人的成绩单:峰值信噪比(PSNR)达到17.22dB,比传统手动调参方法最高提升20.3%,甚至超过了需要大量训练数据的RetinexNet——后者的PSNR只有16.77dB,结构相似性(SSIM)更是被拉开了一大截。

更有意思的是消融实验:只让萤火虫干活,PSNR能涨2.89dB;只让蝴蝶干活,仅涨0.48dB。这说明对低到发暗的照片来说,先把亮度和噪声搞定,比纠结色彩要重要得多。

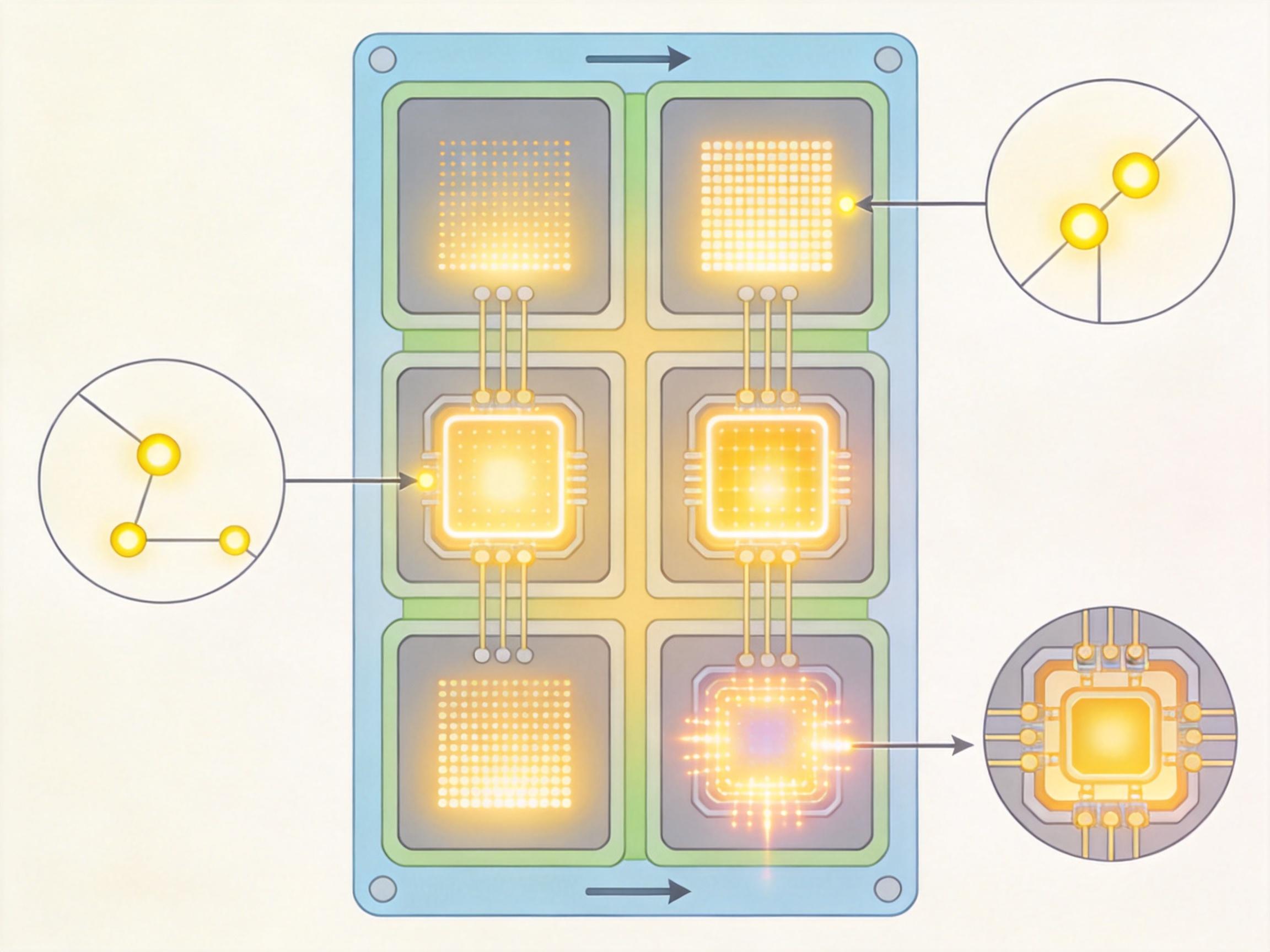

当然它也有软肋:全参数优化一张400×267的图要170秒,根本没法实时用。研究者于是搞了个「快速模式」:先拿小缩略图让小虫们找参数,再把参数套到大图上,耗时直接降到1秒,效果只降了0.27dB——对手机修图、相册批量处理这种场景来说,完全够用。

现在的低光修图圈,深度学习是「优等生」,能处理复杂场景但要吃大量数据和算力;传统方法是「低保户」,省钱但效果看运气。BFORE更像「灵活的手艺人」——不用花钱买数据,也不用高端设备,靠两只小虫的分工协作,就能把大部分日常低光照片修得像样。

它的价值不在于打败深度学习,而在于给那些用不起GPU、拿不到标注数据的场景开了后门:比如偏远地区的安防监控,没法训模型但需要看清夜间画面;比如老相机的底片修复,没有成对的亮暗照片做训练;甚至是手机离线修图,不用连网等云服务处理。

当然它还有不少问题:比如只在LOL数据集上测过,换水下、矿井这种极端场景还不知道行不行;比如全优化模式还是太慢,没法做实时视频处理。但至少它证明了一件事:不一定非要堆数据堆算力,向自然界找灵感,也能搞出好用的技术。

当我们为深度学习的算力竞赛欢呼时,这套靠蝴蝶和萤火虫干活的方法,像个安静的提醒:AI不一定非要越做越复杂,有时候向简单的自然智慧借点力,反而能解决接地气的问题。

未来它或许会和轻量级深度学习结合,把170秒的优化时间压缩到几十毫秒;或许会被塞进手机芯片里,让你拍夜景时不用等几秒的多帧合成。但现在,它已经让我们看到了另一种可能——好的技术,不一定最贵,而是最懂怎么借力。