对抗知识焦虑,从看懂这条开始

App 下载

AI告别幻觉:用数学证明给代码上保险

Putnam竞赛|AI幻觉|数学证明生成|Axiom公司|AxiomProver|应用数学|大语言模型|数理基础|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

Putnam竞赛|AI幻觉|数学证明生成|Axiom公司|AxiomProver|应用数学|大语言模型|数理基础|人工智能

2025年12月,全球最难的本科生数学竞赛Putnam出了结果——一个AI拿到了满分。这是近百年赛事里第6次有人拿满分,前5次都是人类数学天才。但更吓人的是,这个叫AxiomProver的AI,不仅能做对题,还能把每一步解题过程写成机器能检查的数学证明,连半个逻辑漏洞都没有。

3个月后,它的开发者Axiom公司拿到了2亿美元融资,估值冲上16亿美元。投资人赌的不是又一个解题AI,而是一种能让AI彻底告别“胡说八道”的新范式——可信人工智能。为什么一群数学家做的AI,能解决连OpenAI都头疼的幻觉问题?

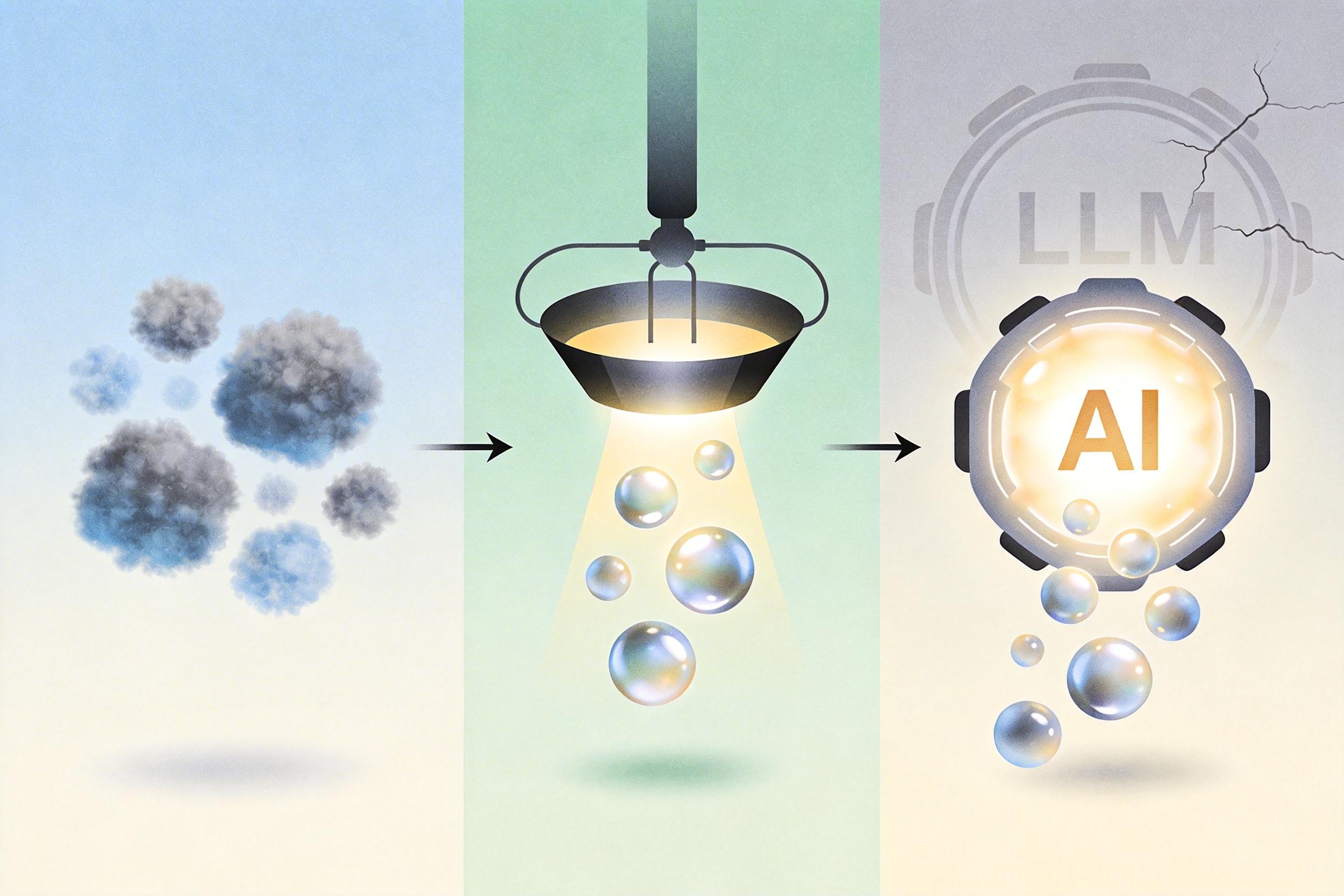

你可以把当前主流AI的代码生成能力,想象成一个背了十万道编程题的学生——考试时它不是靠推理写答案,而是凭记忆里的相似题型“蒙”出最像正确选项的结果。这种概率性生成的本质,就是幻觉的根源:它追求的是“看起来对”,而非“真的对”。

比如Claude Code能写出看起来完美的金融交易代码,但可能在某个边界条件下突然崩溃;CodeRabbit生成的自动驾驶算法,会在极端天气里给出错误判断。Menlo Ventures的合伙人在融资博客里写过一句话:“当代码要控制核电站时,‘大部分时候能用’是个可怕的标准。”

传统的解决思路是给AI加“外挂”——比如用检索增强生成(RAG)让它查资料,或者加人工审核。但这些都是“补漏”,没从根上解决问题:只要AI的核心逻辑是“猜”,就总有漏网的错误。

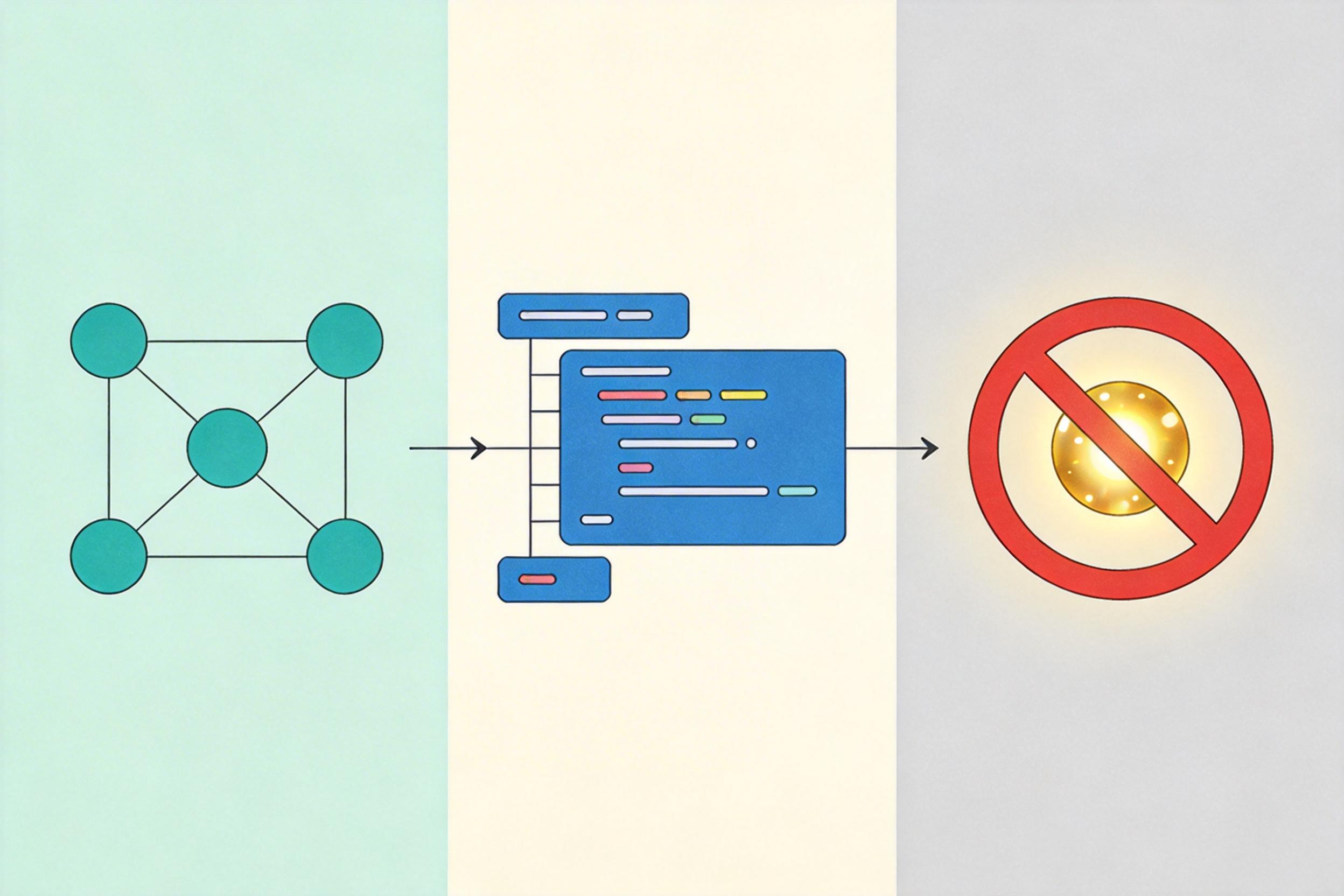

Axiom的思路简单粗暴:既然AI爱瞎猜,那就逼它每一步都拿出数学证明。他们用的工具是Lean——一种专为数学证明设计的编程语言,核心是一个“可信核”:任何输入Lean的推理,都要经过这个核的逐行检查,只要有一步逻辑不成立,整个证明就会被打回。

你可以把这个过程想象成机场安检:AI生成的代码是乘客,Lean的可信核是安检机,每一行代码都要过一遍X光,藏在逻辑里的漏洞、幻觉都会被揪出来。而且这个安检机是数学层面的绝对严谨,没有“可能没问题”的灰色地带,只有“证明正确”和“证明错误”两种结果。

Axiom的AI不是直接写代码,而是先写用Lean语言写证明,再把证明转化为代码。比如要写一个银行转账的函数,它会先证明“无论输入什么金额,转出账户余额都不会为负”“转入账户余额一定增加对应金额”,再把这些证明逻辑翻译成可执行的代码。这个过程里,幻觉根本没有生存空间——因为任何逻辑跳跃都会被Lean的可信核直接拒绝。

更聪明的是,Axiom把这些经过验证的证明数据,又喂回AI模型训练,形成了一个“可信数据飞轮”:验证过的证明越多,AI生成正确证明的能力就越强,还不会像传统LLM那样出现“模型崩溃”。

Axiom的创始人洪乐潼,是个24岁的斯坦福数学博士——她做Axiom的初衷,本来是帮数学家更快证明猜想。但很快她发现,这种“用数学证明保证正确性”的思路,刚好戳中了AI产业的命门:当AI要进入医疗、金融、航空这些高风险领域,“绝对正确”比“好用”更重要。

现在Axiom的客户已经开始接触芯片设计和航空航天公司:比如给芯片验证逻辑,确保不会出现制造时才发现的设计漏洞;给飞机控制系统写代码,保证每一条指令都符合安全标准。这些领域里,一次AI幻觉带来的可能不是bug,而是灾难。

我认为,Axiom真正的价值,不是造出了一个能拿数学竞赛满分的AI,而是把“形式化验证”这个过去只有顶尖数学家和芯片工程师才会用的工具,变成了AI的标配。这不是对现有AI的优化,而是给AI换了一套底层逻辑——从“概率正确”升级到“数学保证正确”。

当我们还在为AI能写论文、编代码欢呼时,Axiom已经在解决下一个问题:如何让AI的输出值得绝对信任。毕竟,AI的能力越强,“胡说八道”的代价就越大。

可信,才是AI的终极护城河。

未来的AI不会只是一个帮我们干活的工具,它会成为医疗诊断的依据、金融交易的核心、甚至是自动驾驶的大脑。到那时,我们需要的不是一个能“蒙对”的AI,而是一个能把每一步逻辑都摊在阳光下,用数学证明自己绝对可靠的AI。Axiom的融资,其实是投资人在赌:这种“不允许出错”的AI,才是下一个时代的主角。