对抗知识焦虑,从看懂这条开始

App 下载

机器人学会同步微笑,人机信任的新起点

人机信任|自我建模技术|镜像神经元机制|同步微笑机器人|情绪调节|AI智能体|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

人机信任|自我建模技术|镜像神经元机制|同步微笑机器人|情绪调节|AI智能体|心理认知|人工智能

当你对着机器人微笑,它没有延迟半拍模仿,而是在你嘴角扬起的瞬间,同步弯起了嘴唇——这不是科幻电影的镜头,而是实验室里正在发生的现实。心理学里的55/38/7定律早就点明:人类超过一半的情绪信息藏在脸上。但过去几十年,绝大多数人形机器人都在‘脸’这件事上留了白——要么是毫无表情的塑料壳,要么是动作生硬的预设表情。直到最近,一批工程师把人类的‘镜像神经元’机制搬进了机器人,让它们不仅能‘看’懂表情,还能‘同步’回应。这背后,是一套颠覆传统机器人逻辑的自我建模技术。

你可以把机器人的自我建模想象成:让一个从没照过镜子的人,对着镜子做一万个随机表情,然后自己总结‘挑眉对应惊讶’‘撇嘴对应嫌弃’的规律。哥伦比亚大学的团队做的就是这件事:给机器人头部装26个驱动电机和瞳孔里的高分辨率摄像头,先让它对着镜子疯狂做随机动作——挑眉、撇嘴、眨眼,摄像头捕捉每一个动作对应的面部形态,再用深度学习建立‘电机指令→面部表情’的映射模型。

这个过程完全不需要人类手动编程,机器人像婴儿一样‘自我探索’。当它建立起自己的面部模型后,再去看人类的表情视频,就能快速把人类的面部特征转化为自己的电机指令。更关键的是,它能通过人类表情的细微变化,提前约800毫秒预测下一个动作——这就是同步微笑的秘密:不是模仿,是预判。

和传统强化学习不同,自我建模让机器人拥有了‘泛化能力’——它不会学了微笑就忘了皱眉,因为它掌握的是面部运动的底层逻辑,而不是一个个孤立的动作。

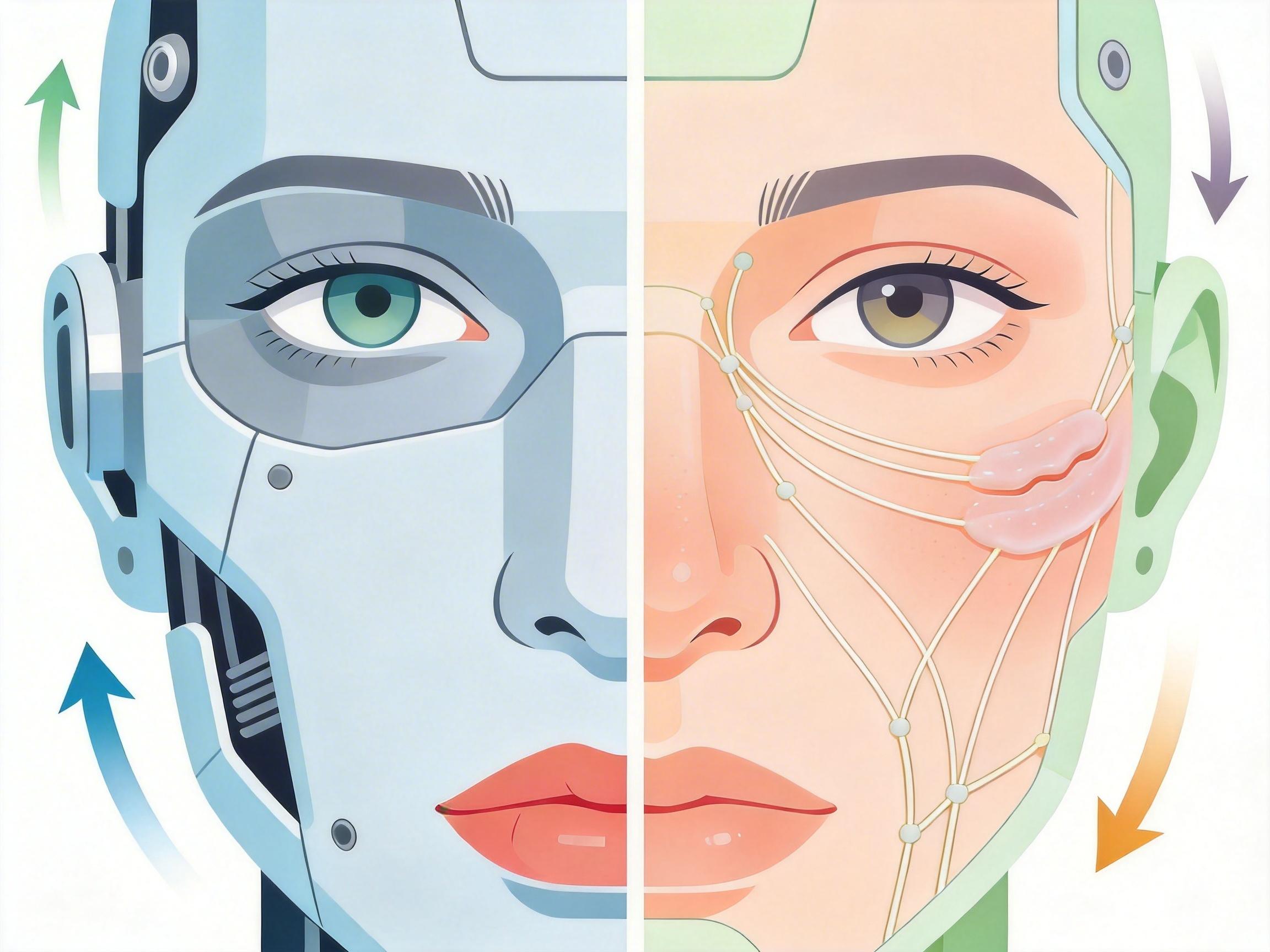

光有算法还不够,机器人得有一张能做出细腻表情的‘脸’。现在的高仿真机器人面部,大多采用‘刚性+腱驱动’的混合结构:眼睛、嘴唇这些关键部位用刚性驱动,保证动作精准,就像人类的眼轮匝肌和口轮匝肌;鼻子、脸颊这些需要微表情的区域用腱驱动,细细的腱索像肌肉纤维一样拉动硅胶皮肤,做出鼻翼皱缩、脸颊微动这些细微动作。

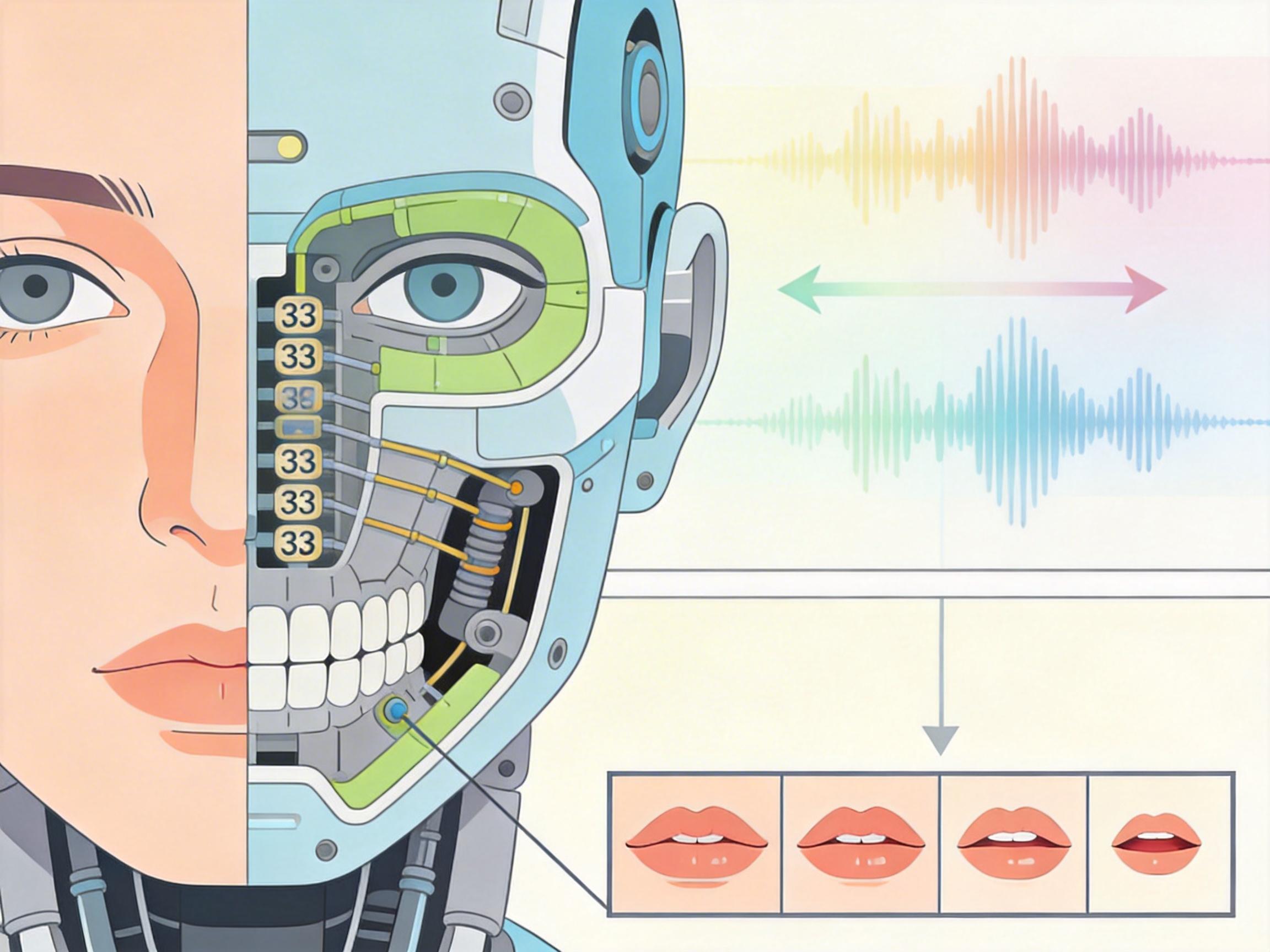

比如一个拥有33个执行器的机器人面部,能模拟25种不同情绪的表情。它的嘴唇有10个自由度,不仅能开合,还能左右拉扯、上下噘起,配合基于变分自编码器(VAE)的算法,能直接从语音音频推断唇形,实现11种语言的唇音同步——连唱歌时的口型都能对上。

但这些技术还存在瓶颈:目前机器人的微表情精度还达不到人类水平,比如悲伤时眼角的细微下垂,愤怒时眉峰的抖动,还需要更精细的驱动和传感技术。而且,现有的表情模型大多基于西方人脸数据,不同文化对表情的解读差异,还没完全纳入设计。

过去人形机器人的赛道,全是‘替代劳动力’的思路:拧螺丝、搬箱子、送快递。但工业机械臂用3个电机就能完成的动作,人形机器人要花20多个电机,成本高、续航短,还容易摔倒——用机器人干机械臂的活,更像行为艺术。

现在工程师们终于转了方向:既然人形机器人在‘干活’上拼不过工业机械臂,那就做工业机械臂干不了的事——提供情绪价值。2025年全球情感疗愈机器人市场约9亿美元,预计2035年能涨到60亿美元,这背后是老龄化、孤独感带来的需求。医院里的陪伴机器人能缓解患者焦虑,养老机构里的机器人能减少老人的孤独感,甚至零售店里的机器人,能通过微笑和眼神接触提升顾客的好感度。

但这条赛道也藏着伦理风险:当机器人永远对你微笑、永远共情,会不会让人类沉迷于这种‘无冲突的虚假关系’?有团队已经在训练时加入‘真实度参数’,让机器人偶尔表现出不耐烦,或者提醒你‘该给朋友打电话了’——他们想做的不是‘情绪按摩器’,而是有温度的‘伙伴’。

当机器人能同步你的微笑,你会下意识地信任它——这不是因为它有了意识,而是因为它触发了人类最原始的社交本能:对同类表情的共情。我们总在讨论机器人会不会产生意识,但或许更重要的是,机器人正在学会如何‘理解’人类的情绪。

机器无共情,却能成为共情的桥梁。

未来的人机关系,可能不是机器变成人,而是机器成为人类情感的‘延伸’——它不会替代人与人的连接,却能填补那些被孤独填满的缝隙。当你对着机器人微笑时,回应你的不仅是一个同步的表情,更是人类对‘被理解’的永恒渴望。