10 天前

10 天前

1900年《绿野仙踪》里,翡翠城的绿是眼镜片骗出来的幻觉。125年后,加州大学伯克利分校造了台叫Oz的机器,干了件完全相反的事:它没给人戴任何镜片,却让5个普通人看见了一种自然界里根本不存在的颜色。

这种颜色叫olo,是一种饱和度冲破人类视觉极限的蓝绿色——你在任何花鸟鱼虫、颜料屏幕里都找不到它的影子,全世界只有那5个受试者亲眼见过。要搞懂这到底有多颠覆,得先回到一个最基础的问题:我们到底是怎么看见颜色的?

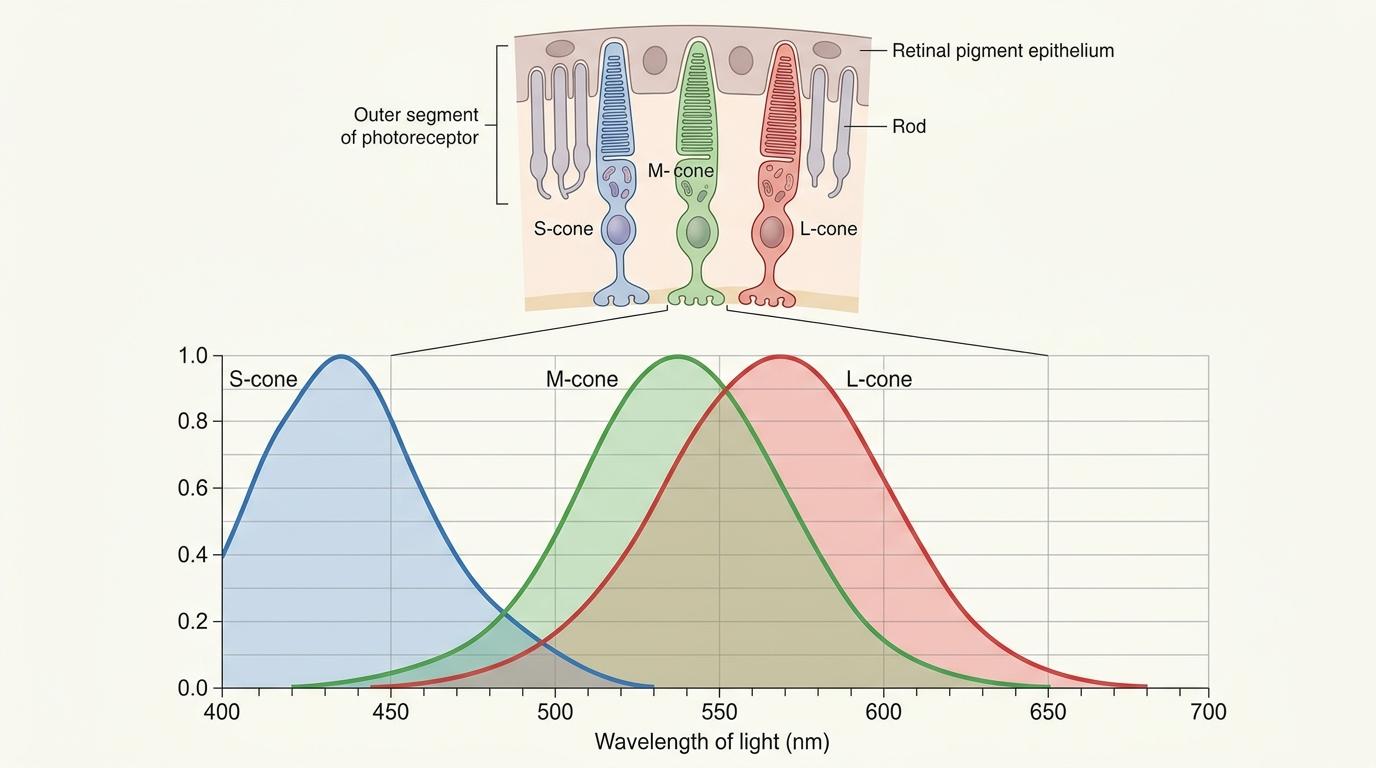

你可以把视网膜上的三种视锥细胞当成三个分工模糊的质检员:S锥盯蓝色,M锥盯绿色,L锥盯红色,但他们的“负责范围”严重重叠——尤其是M锥和L锥,对光线的敏感区间重合度超过85%。

颜色不是光的属性,是大脑算出来的:它把三个质检员的“报告比例”对应成一种颜色。比如看到草绿,是M锥激活70%、L锥激活30%的结果;看到大红,是L锥激活90%、M锥激活10%的结果。但问题在于,自然界里根本找不到一种光,能只让M锥拼命干活,同时让L锥完全躺平——这就像你没法只叫醒一个挤在大通铺里的人,不吵醒旁边的人。

更要命的是眼球自带的“光学模糊”:就算你用最细的激光瞄准单个M锥,光穿过晶状体时会自动扩散成光斑,必然会扫到旁边的L锥。这两道生物学枷锁,把人类能看见的颜色死死框在了一个固定范围里——直到伯克利的团队花了十几年,把这两道锁都撬开了。

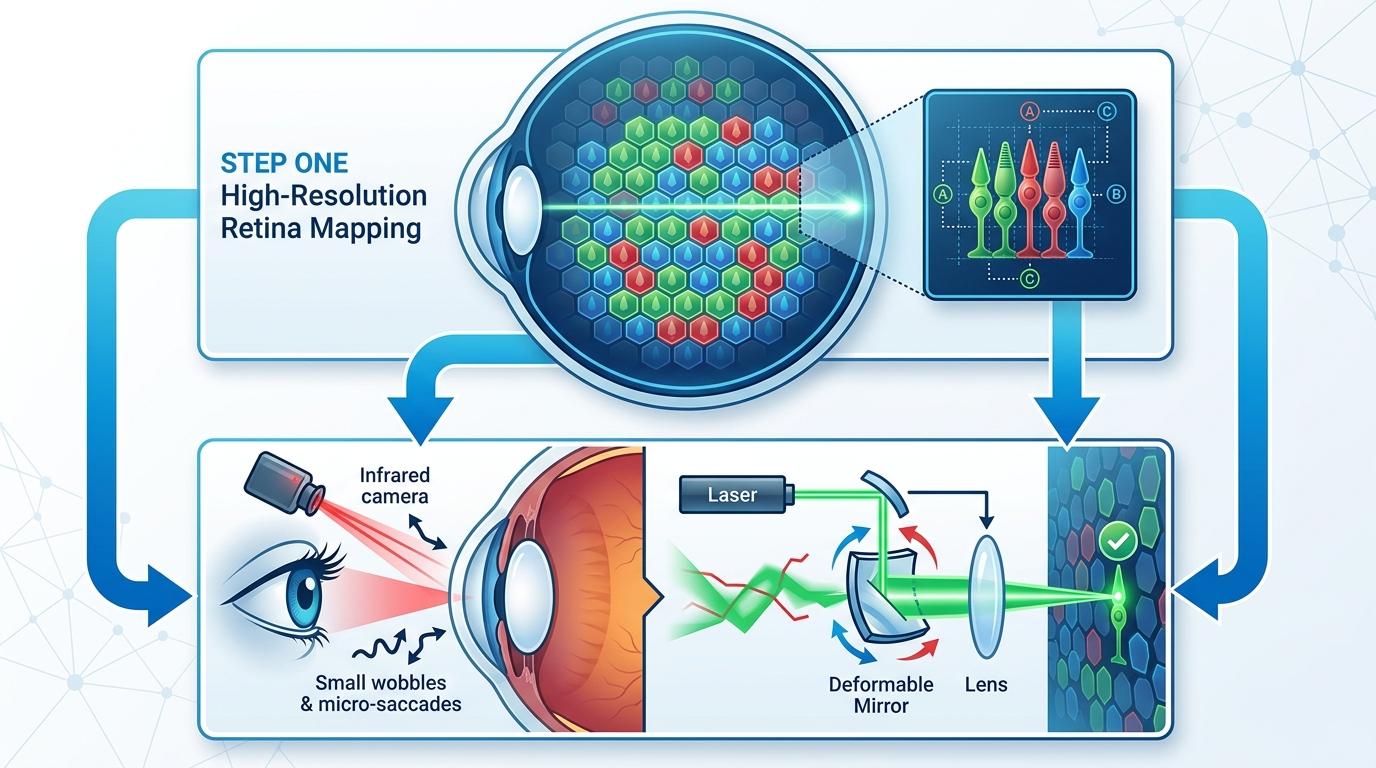

他们的办法是把天文学家用来校正大气湍流的自适应光学,搬到了人眼上。

第一步,先给每个人的视网膜画一张“高清地图”:用高分辨率成像技术逐个识别1000多个视锥细胞的类型和位置,精确到微米级——相当于在足球场上找到每一个球员的号码和站位。第二步,用红外光实时追踪眼球的微小转动,同时用自适应光学系统不断校正激光的光路,把光斑缩小到单个视锥细胞的大小——就像给针灸针装了自动瞄准器,精准扎到指定穴位。

最后的操作简单直接:用543纳米的绿色激光每秒扫过目标区域10万次,碰到M锥就释放微量激光,碰到L锥和S锥就直接跳过。

受试者的体验很朴素:滴散瞳药,咬着固定头部的金属棒,盯着一个点不敢眨眼。每次olo只能维持几秒,视野只有伸直手臂后食指指甲那么大。但就是这几秒,5个人都看到了同一种东西——一种极端饱和的蓝绿色,比实验室里最纯的青色激光还要鲜艳,像把整个春天的绿和深海的蓝拧干了杂质,直接怼到了眼前。

研究成果一出来,学界吵翻了。有人说这是“科幻级的壮举”,有人直接泼冷水:“这哪是新颜色,就是饱和度拉满的绿色而已。”

争论的核心,是“颜色”到底该怎么定义:如果按物理光谱算,olo确实没有对应的单一波长;但如果按人类的感知机制算,它对应的是大脑从未收到过的信号比例——M锥100%激活,L锥和S锥0%。这种比例在自然里绝不可能出现,大脑却能立刻处理它,甚至5个人的描述高度一致。

更有意思的是给olo起名的博士生James Fong,他花了几年时间开发这套系统,却因为抽签手气差,至今没亲眼见过olo。英国艺术家推出过号称“近似olo”的颜料,卖一万英镑一罐,伯克利团队只淡淡回应:“任何你能买到的颜色,在olo面前都像掺了水。”

当然,这套系统现在还只是实验室玩具:视野极小,必须固定头部,设备价格能买一套房。但它的意义早超出了“看见新颜色”本身——它第一次实锤了一个我们不愿相信的事实:我们看见的世界,从来不是世界本来的样子。

《绿野仙踪》里的翡翠城,是眼镜片给人套的幻觉;而我们从小到大看见的“真实世界”,不过是大脑给我们画的另一幅画——为了生存效率,它主动裁剪了光谱,模糊了边界,把复杂的光信号翻译成了我们能理解的颜色。

Oz机器没骗我们,它只是把我们眼前的画撕了个小口子,让我们瞥见了画框外的颜色。我们看见的,从来都是大脑想让我们看见的。说不定哪天,当这套系统能铺满整个视野时,我们会发现,原来世界的色彩,比我们想象的要疯狂得多。

点击充电,成为大圆镜下一个视频选题!