对抗知识焦虑,从看懂这条开始

App 下载

被挡的照片不用愁,AI自动从相册找参考补全

相册检索|自动参考图匹配|视觉语言模型|照片修复|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

相册检索|自动参考图匹配|视觉语言模型|照片修复|多模态视觉|人工智能

你有没有过这种时刻:翻出一张拍糊了脸的演唱会合影,或是被路人半遮半挡的旅行照,对着AI修复工具叹气——要么给你生成一张似是而非的“大众脸”,要么逼你在几百张相册里手动找角度匹配的参考图。现在,这个麻烦事有了新解法:一套无需额外训练的AI框架,能先“看懂”被挡住的是什么,再自动从你的相册里捞出最合适的照片当参考,最后补出和你本人一模一样的细节。它怎么做到跳过“手动找图”这个最磨人的步骤?

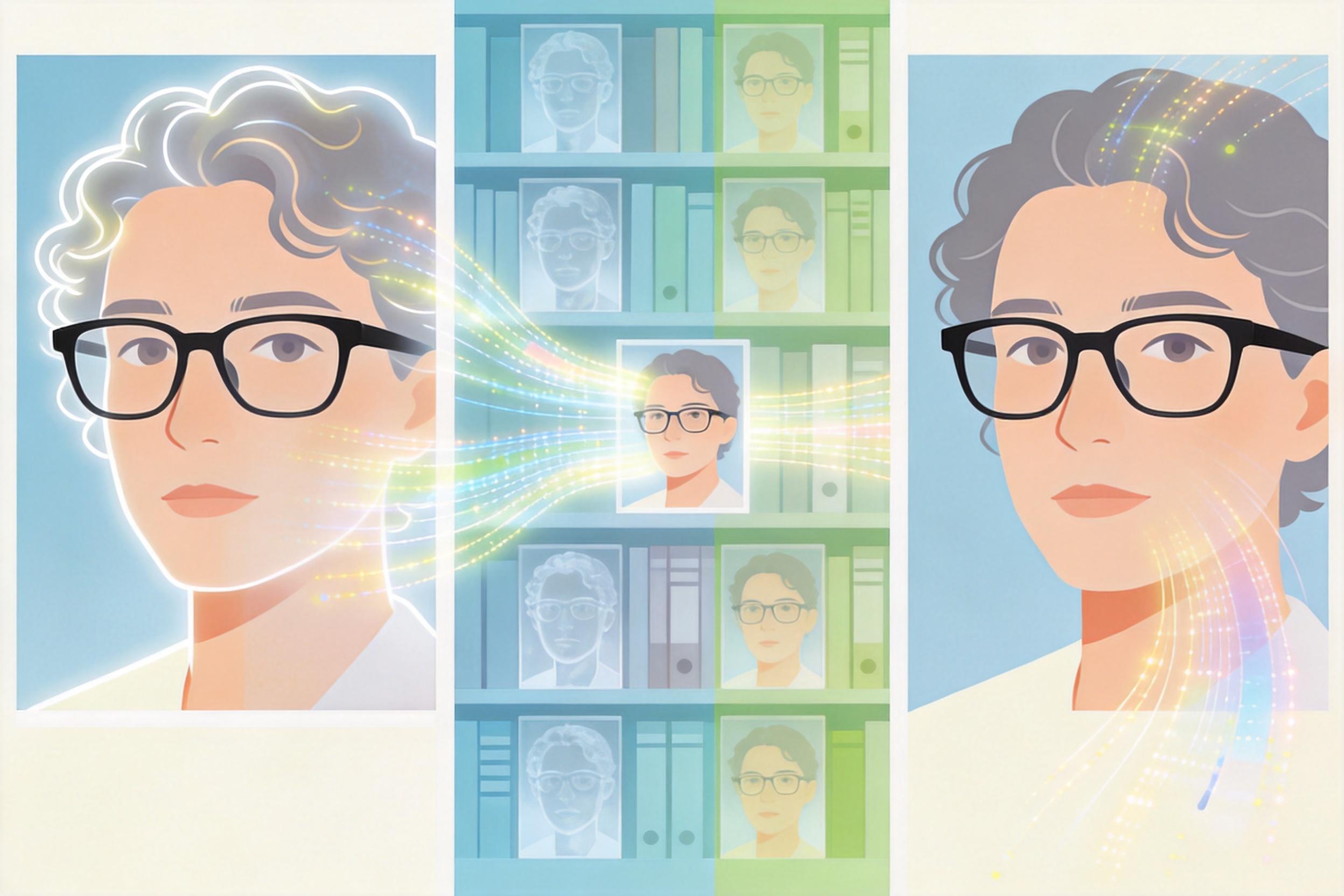

你可以把这套框架的工作流程想象成一个专业修图师的完整操作:第一步先“问诊”,用视觉语言模型(VLM)分析照片可见部分——比如看到露出的半副眼镜和卷发,就推理出“被挡的是一个戴黑框眼镜的卷发女生”;第二步去“找素材”,用组合图像检索技术(CIR)把这个推理描述和照片可见部分结合,在相册里快速定位到同一张脸、同个发型的清晰照片;第三步才是“动手修”,用参考式扩散模型把找到的参考图细节无缝补到被遮挡的位置。

这里的关键是组合图像检索——它和你平时用相册“搜照片”完全不同。传统图像检索只能靠视觉特征找相似,文本检索只能靠关键词,但组合检索能把“半张戴眼镜的脸”这个视觉信息,和“戴黑框眼镜的卷发女生”这个文本描述捏合在一起,像给AI装了个精准的“搜索雷达”,不会把你朋友的同款眼镜照片也捞出来。

这套框架最让人意外的一点,是完全不需要针对你的相册做任何训练。它就像用超市里的预制菜拼出一顿大餐:默认用Qwen3-VL做视觉推理,用LinCIR做组合检索,用UniReal做图像修补——这三个都是已经在各自领域验证过的预训练模型,连在一起就能直接干活。

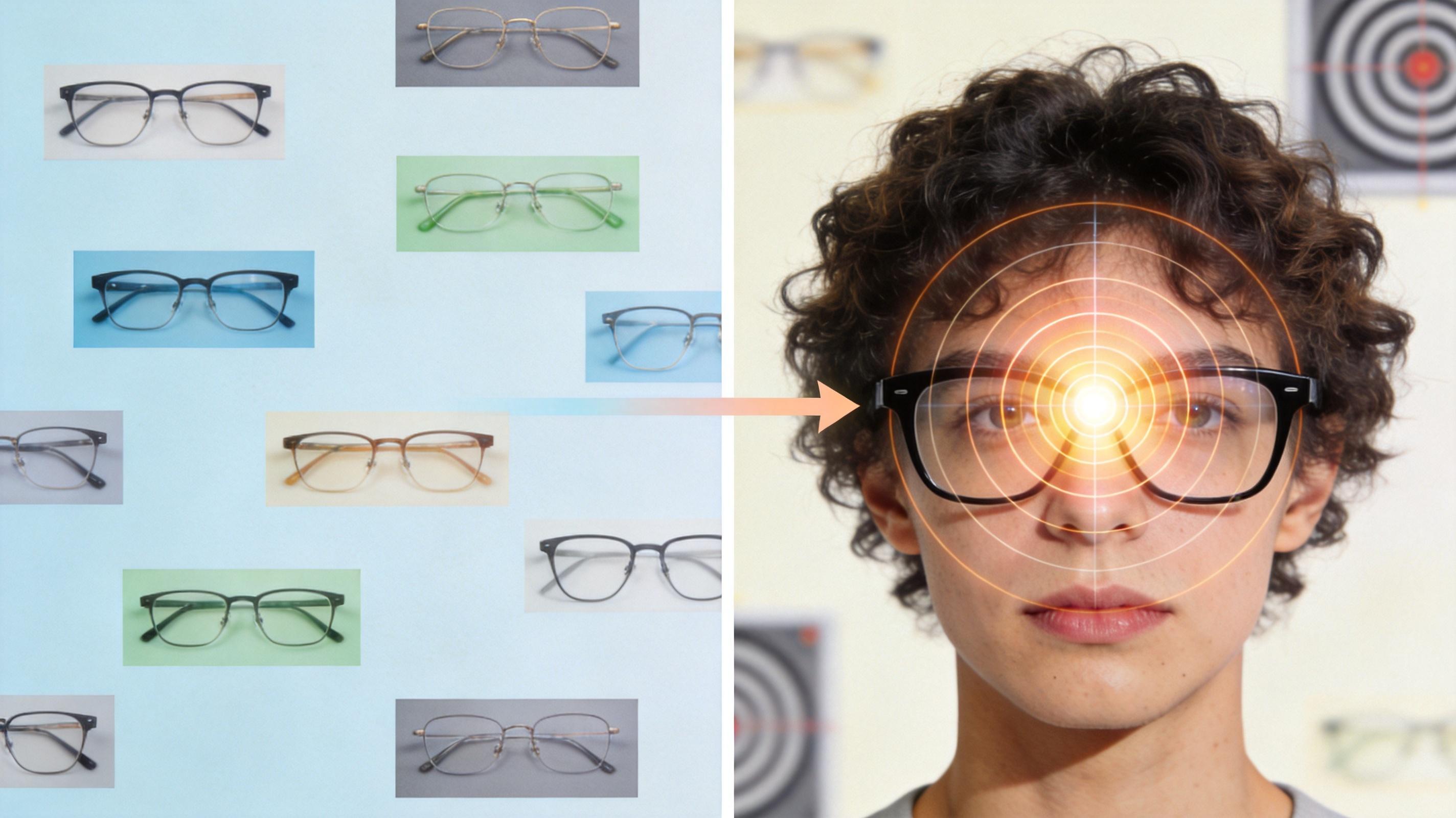

LinCIR这个检索模块尤其值得说:它不需要专门用“照片+描述+目标图”的三元组数据训练,只靠语言数据就能学会理解“图像+文本”的组合查询。在测试中,它在四个零样本检索基准上都拿到了最佳成绩,甚至在时尚商品检索数据集上超过了专门训练的监督模型。这意味着它能快速适应任何用户的相册,不用等几个小时的训练时间。

当然,这套框架还不是万能的。首先它极度依赖视觉语言模型的推理准确性——如果VLM把“戴帽子的男生”误判成“戴头盔的女生”,后面的检索和修补就全错了;其次它目前只针对人像照片优化,要是你想补被挡住的宠物或风景,效果会大打折扣;最后就是硬件门槛,跑8B参数的VLM和扩散模型,还是需要像样的GPU支持,暂时没法在千元机上流畅运行。

在5万多张人像照片的测试集里,它的检索准确率在Recall@1上只有7%——听起来不高,但对比其他零样本方法已经是最好成绩。这也说明,让AI精准理解“半遮半掩”的视觉信息,依然是个难题。

从手动找参考到AI自动完成,这不仅仅是操作步骤的减少,更是AI图像修复思路的转变:从“生成相似内容”转向“还原真实细节”。以前我们用AI修图,是让它“猜”我们想要什么;现在我们让它“找”我们已经拥有的——那些散落在相册里的、属于我们自己的真实瞬间。

未来它或许能学会跨相册找参考,或许能在手机本地完成所有运算保护隐私,或许能把宠物、风景都纳入修复范围。但现在,它已经给了我们一个新的可能:不用再为一张被挡住的照片遗憾,AI会帮你从记忆的碎片里,拼回完整的瞬间。

金句:AI修图的未来,是还原真实的自己。