对抗知识焦虑,从看懂这条开始

App 下载

AI润色邮件后,大脑活动竟骤降47%?

合作语气|大脑活动|神经科学家|邮件润色|脑科学|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

合作语气|大脑活动|神经科学家|邮件润色|脑科学|大语言模型|心理认知|人工智能

不久前,一位神经科学家在起草一封工作邮件时,发现自己的语气略显强硬,可能引发不必要的对立。他习惯性地向大型语言模型(LLM)求助,输入指令:“用更合作、更专业的语气重写。”

几秒钟内,一封措辞完美、无可挑剔的邮件诞生了。AI像一位技艺高超的编辑,“磨平”了原文所有的棱角。然而,在按下发送键的瞬间,这位科学家感到一丝不安。他意识到,AI在消除那些可能引起误解的“沟壑”(错误)的同时,也削平了他原创思想的“山峰”(独特性)。“它移除了一点‘我’,” 他后来反思道。这个看似微小的瞬间,却揭开了一个深刻的议题:当AI以前所未有的效率优化我们的沟通时,它是否也在悄无声息地侵蚀我们表达的独特性,甚至重塑我们的大脑?

这位科学家的经历并非孤例,它是一种正在蔓延的文化现象。AI的“平滑化”处理,正让我们的语言变得越来越“正确”,却也越来越相似。语言学家们观察到,自ChatGPT等工具普及以来,一些特定词汇,如“delve”(深入探究)、“intricate”(错综复杂的)、“commendable”(值得称赞的),在学术论文、商业邮件和日常沟通中出现的频率激增,形成了一种可被轻易识别的“AI味”。

这种语言风格,语法正确、逻辑清晰,却常常被批评为“没有灵魂”、“缺乏活人感”。它抹去了个人化的笨拙、犹豫、激情与偏见——那些让我们之所以为人的不完美印记。当一位教授审阅学生论文时,他发现文章虽然毫无语法错误,却读不到学生的声音,感受不到他们为研究付出的“血与汗”。沟通的效率得到了前所未有的提升,但表达的个性和情感温度却在悄然流失。 我们正在用独特性,为这种高效付出代价。

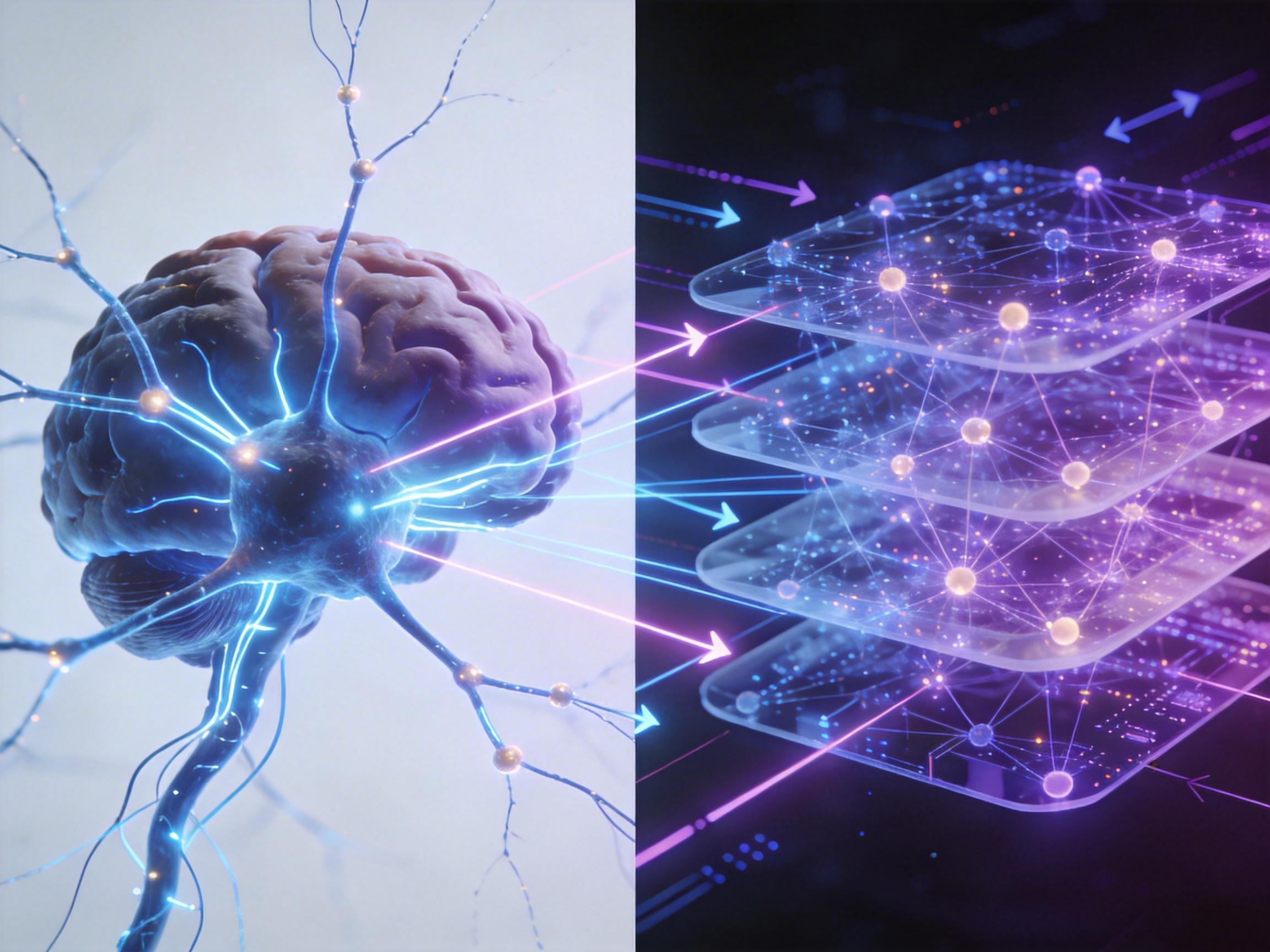

这种令人不安的趋同性,源于AI与人脑在底层运行逻辑上的惊人相似。无论是大型语言模型还是人类大脑,本质上都是一台**“算法预测机器”**。当我们说“我早餐吃了……”时,大脑会基于过往经验和语境,高概率地预测出“鸡蛋”或“面包”,而几乎不会是“一辆自行车”。LLM做的也是同样的事情,只是其计算能力更强,统计速度更快。

正因为这种机制上的相似,人脑在长期接触AI生成的平滑、标准化的文本后,会不自觉地开始模仿其模式。麻省理工学院(MIT)在2025年进行的一项研究为这一担忧提供了惊人的证据。研究人员通过脑电图(EEG)扫描发现,当学生使用AI辅助写作时,他们大脑的认知活动显著减少。更令人震惊的是,与纯靠大脑写作的对照组相比,AI辅助组的大脑神经连接数量骤降了47%。研究人员将这种现象称为“认知负债”——我们用未来的思考能力,为眼前的短暂效率支付了高昂的“利息”。

大脑活动的降低,正是“思维外包”的直接后果。当我们习惯于将构思、推理、甚至批判性思考的任务交给AI时,我们的大脑就如同长期不用的肌肉,开始逐渐“萎缩”。

这不仅仅是理论推测,现实数据已经敲响警钟。瑞士SBS商学院的一项调查显示,年轻群体对AI的依赖度更高,而他们的批判性思维得分平均比年长者低了约45%。心理学家警告,这可能形成一个恶性循环:

当学生们提交的报告结构完美但无法深入解释细节时,当专业人士可以快速生成方案却缺乏原创洞见时,这场认知危机已经悄然发生。我们正在失去与不确定性共处、在思维迷雾中艰难探索的宝贵锻炼机会。

影响是深远的,它正在重塑我们最底层的思维与写作习惯。写作,这一曾经被视为深度思考与自我发现的创造性过程,正逐渐简化为一种“提示工程学”——我们不再是思想的建筑师,而更像是AI的指令员。

长期来看,这种变化会改变我们的认知规范。当视野所及之处尽是AI生成的完美无瑕、四平八稳的文本时,我们对那些带有瑕疵、充满个性的“粗糙”表达的容忍度可能会下降。我们的大脑中负责处理和创造多样性表达的神经回路,可能因缺乏刺激而逐渐弱化。我们可能最终会忘记,真正有价值的思想,往往诞生于不完美、不确定甚至错误的探索之中。

技术本身是中立的,AI既可以成为增强我们认知的强大工具,也可能沦为我们逃避思考的“电子保姆”。我们正处在一个关键的十字路口,未来的走向取决于我们此刻的选择。

我们需要的,是一种有意识的“元认知”。在每一次向AI提问之前,先问自己几个问题:

有意识地建立一个“AI缓冲带”,先让自己的思想先行,再让AI作为“陪练”或“教练”介入,这或许是通往良性人机协作的道路。在完美的算法海洋中,人类那充满瑕疵、偏见、激情与伤口的灵魂,将是我们独特性最后的、也是最坚固的防伪水印。保卫这种独特性,就是保卫我们作为人类的价值本身。