对抗知识焦虑,从看懂这条开始

App 下载

跳过L3直接到L4?自动驾驶安全不答应

行业路线争论|安全门槛|多传感器融合|L3级自动驾驶|自动驾驶|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

行业路线争论|安全门槛|多传感器融合|L3级自动驾驶|自动驾驶|人工智能

2026年春夜的一场行业论坛上,关于自动驾驶的路线争论突然白热化:有人说要跳过L3,直接从L2跃升到L4级无人自动驾驶;另一派则拍桌强调,L3是绕不开的安全门槛。这场争论的核心,其实指向了一个更底层的问题:当机器要接管人类的驾驶权,靠什么才能把风险降到最低?答案藏在一套被反复提及的技术里——多传感器融合。它不是什么炫目的黑科技,却是自动驾驶安全的‘隐形安全带’。

要理解多传感器融合的价值,得先搞懂自动驾驶分级里的关键节点:L2是‘辅助驾驶’,人类司机必须全程盯着路;L4是‘高度自动驾驶’,机器能在特定场景下完全接管;而L3,是人类第一次把‘眼不看路、手不握方向盘’的权利交给机器——这意味着系统必须能在所有复杂场景下,自己判断‘能不能行’。

就像学开车不能刚学会起步就上高速,自动驾驶的进化也需要这样一个‘过渡考场’。L3的核心要求是‘系统能应对绝大多数场景,只有遇到极端情况才喊人接管’,这对环境感知的精度和可靠性提出了前所未有的要求。单一传感器根本扛不住:摄像头在逆光、夜里会‘瞎’,激光雷达在暴雨天会‘看不清’,毫米波雷达又分不出‘塑料桶和小孩’。

一组数据能说明问题:某机构测试显示,仅靠摄像头的自动驾驶系统,在夜间乡村道路的障碍物漏判率高达17%;而加入激光雷达和毫米波雷达的融合系统,漏判率直接降到0.3%。这就是L3必须迈过的坎——先让机器练出‘全天候不犯错’的感知能力,再谈完全无人。

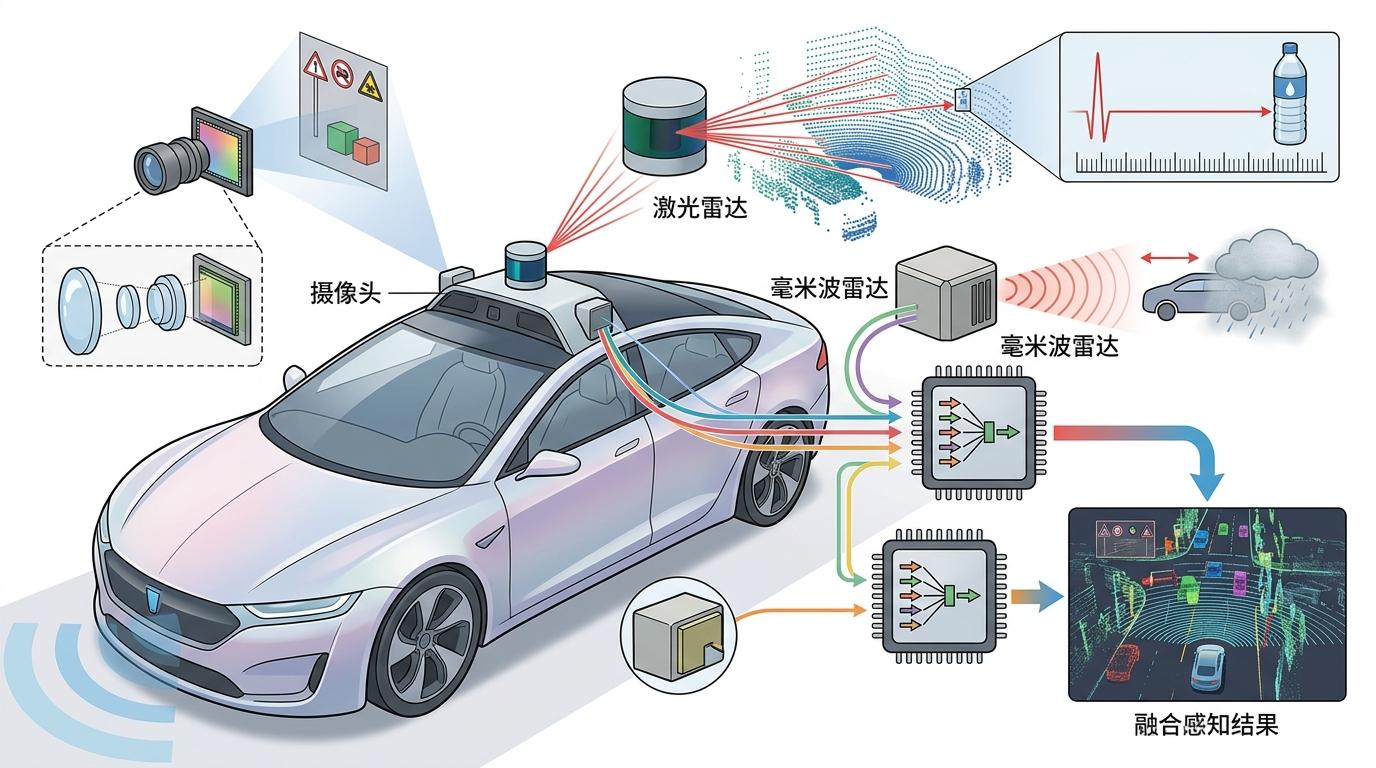

你可以把多传感器融合想象成给自动驾驶车装了一套‘超级感官’:摄像头是‘眼睛’,能认路牌、辨颜色;激光雷达是‘3D扫描仪’,能精确测出100米外一个矿泉水瓶的位置;毫米波雷达是‘雷达耳朵’,能穿透雨雾,盯着前方车辆的速度。这套系统的厉害之处,不在于单个传感器有多强,而在于它们能‘互相补位’。

现在主流的融合方案是‘特征层融合’:每个传感器先各自提取关键信息——比如摄像头识别出‘前方是行人’,激光雷达算出‘距离30米,正以5公里/小时移动’,毫米波雷达测出‘速度稳定’,然后由算法把这些信息拼成一个完整、准确的‘环境快照’。

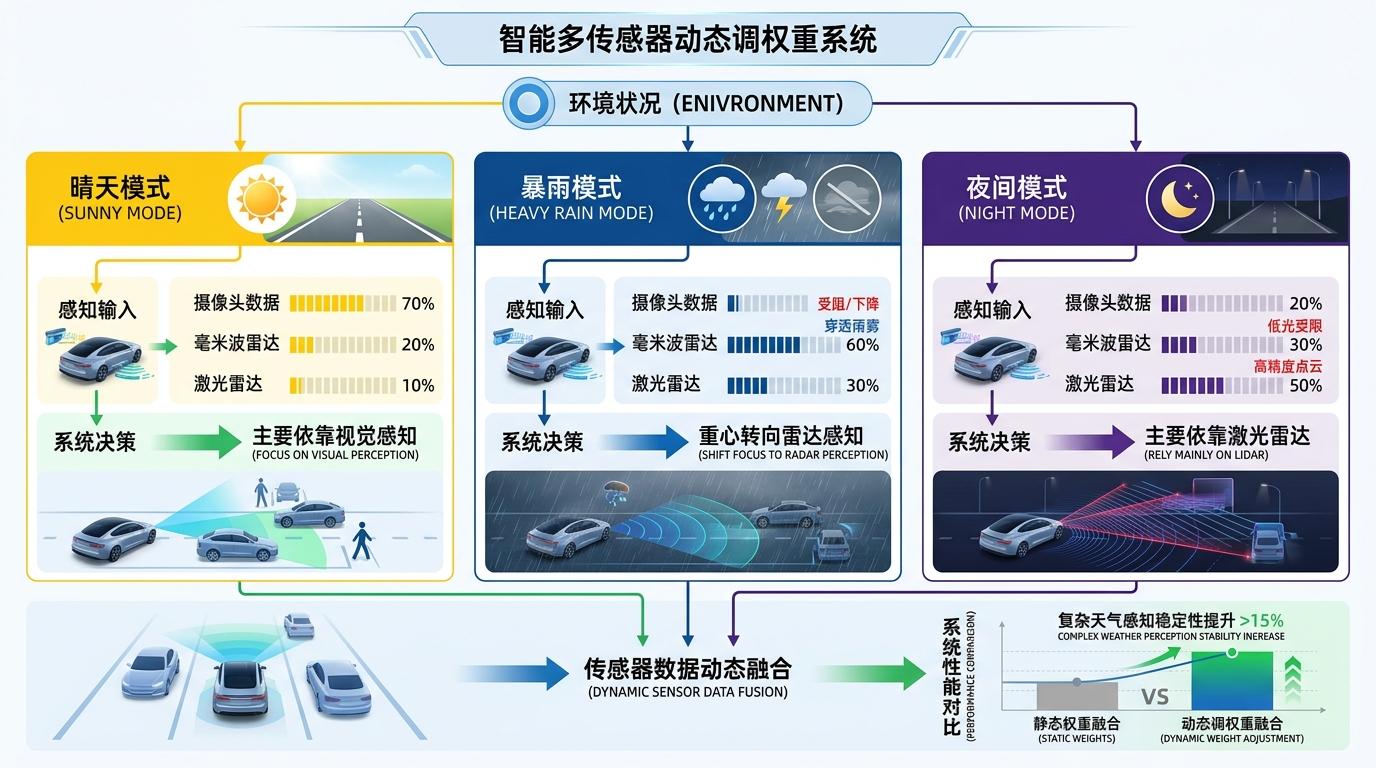

更聪明的系统还会‘动态调权重’:晴天时,摄像头的信息权重最高;到了暴雨天,系统会自动把重心转到毫米波雷达;夜间则主要依靠激光雷达。有测试显示,这种动态融合策略能让系统在复杂天气下的感知稳定性提升15%以上。

当然,这套系统也有自己的难题:不同传感器的数据格式、采样频率完全不同,就像让中文、英文、法文的信息实时同步,对时间和空间的精度要求极高——差0.1秒,就可能错过一个突然横穿马路的行人。目前行业里解决这个问题的方案,是用高精度的时间同步器和空间标定算法,把所有传感器的‘时钟’和‘视角’校准到分毫不差。

多传感器融合不是自动驾驶的‘终极答案’,却是当前阶段最务实的安全底线。它能解决的,是自动驾驶最核心的‘信任问题’:当你把自己的生命交给机器,你得知道,它不会因为逆光就把卡车当成天空,不会因为暴雨就看不见前方的护栏。

但它也有自己的局限:比如成本,一套包含激光雷达的融合系统,目前比纯视觉系统贵出数千元;比如计算量,处理多传感器的数据需要更强大的芯片,这对车辆的能耗和成本都是挑战。更重要的是,融合系统再强,也无法覆盖所有极端场景——比如被大雪完全覆盖的车道线,或者突然从货车后方窜出的小孩。

这也是为什么行业里会有‘要不要跳过L3’的争论:直接做L4,似乎能绕开L3阶段的成本和法规难题,但前提是你能保证系统在所有场景下都不出错——而目前的技术,还远远做不到。L3的意义,就是在‘机器还会犯错’的阶段,先把‘不犯致命错’的能力练扎实。

当我们讨论自动驾驶的‘速度’时,其实更该关注它的‘安全冗余度’。多传感器融合不是什么突破性的技术,它更像一种‘务实的笨办法’——用多重感官的互补,把单一传感器的漏洞一个个补上。

自动驾驶的终极目标是‘无人’,但通往‘无人’的路上,每一步都得踩着‘安全’往前。L3不是什么必须快速跨过的台阶,而是一个让机器‘学会对安全负责’的训练场。技术可以跳跃,安全没有捷径。这句话,不仅是给自动驾驶行业的提醒,也是给所有期待智能出行的普通人的一颗定心丸。