对抗知识焦虑,从看懂这条开始

App 下载

AI造假再逼真,人仍会信真实信息

社交媒体|信念变化|说服力实验|AI生成内容|社会心理学|大语言模型|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

社交媒体|信念变化|说服力实验|AI生成内容|社会心理学|大语言模型|心理认知|人工智能

刷到一条标注着「AI生成」的社交媒体帖子,你会先入为主觉得它是假的吗?2026年的一项心理学研究给出了反常识的答案:哪怕是大语言模型(LLM)生成的内容,人们依然能准确区分其中的真实与虚假,且会更愿意相信和分享真实的那部分。这打破了「AI造假会彻底击溃人类判断力」的焦虑预言,也留下了值得深究的问题:真实信息的说服力,到底从何而来?

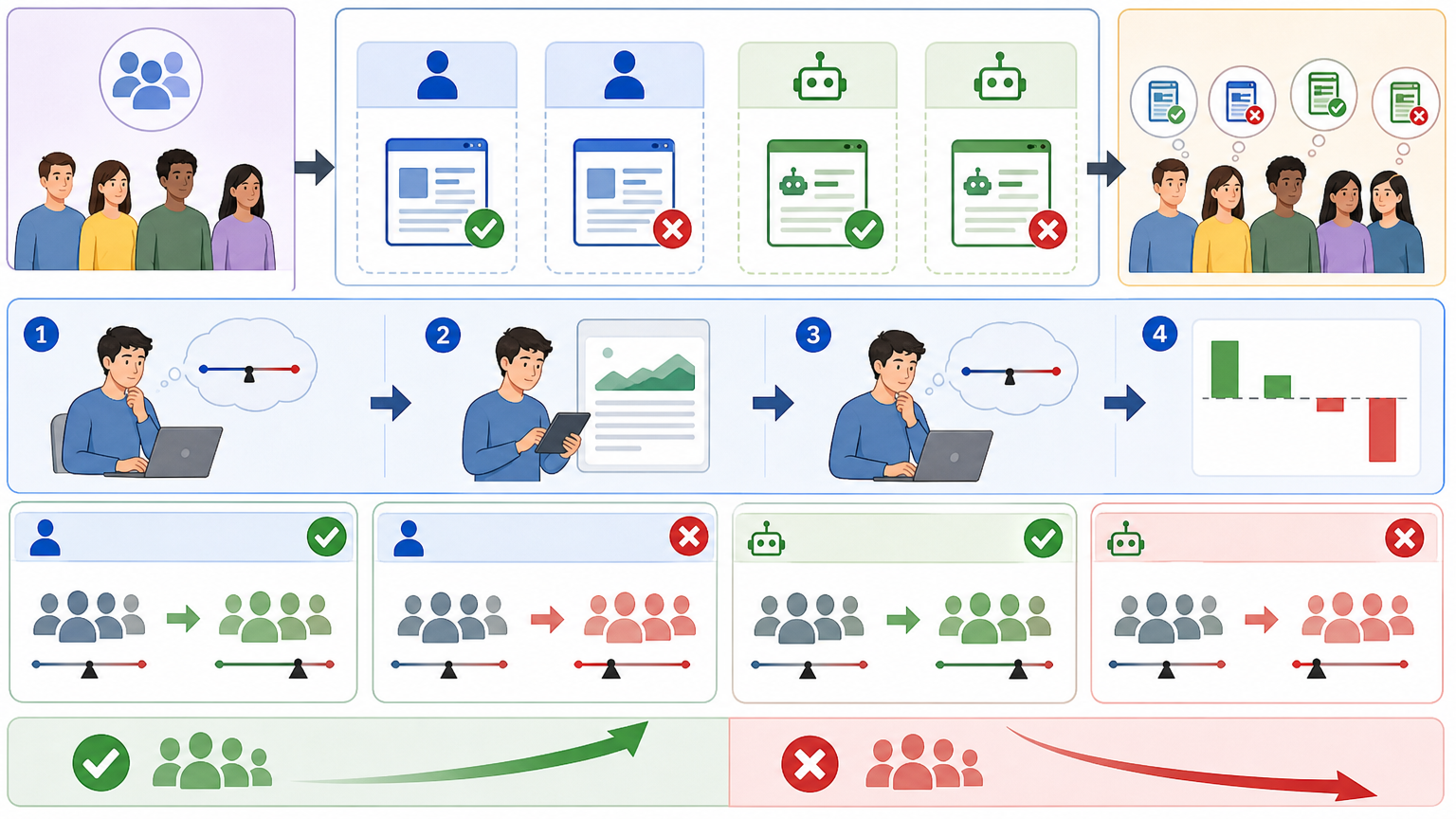

研究团队设计了四组对照实验,让参与者分别评估人类和AI生成的「说服性内容」与「吸睛内容」。核心的测量方法很直接——先记录参与者对某一议题的初始信念,再让他们阅读目标内容,最后对比信念的变化幅度,以此量化信息的说服力。结果清晰:无论内容出自人类还是AI,真实信息总能显著提升参与者的信念认同度,虚假内容则要么无效,要么反而削弱原有信念。

一个关键的差异点值得注意:人类生成的虚假内容,会直接拉低受众的信念评分;而AI生成的虚假内容,偶尔会带来微弱但无统计学意义的信念提升。这并非因为AI造假更高明,而是AI生成的虚假内容往往语言更正式、逻辑更顺滑,容易让受众放松警惕——但这种表面的「可信感」,终究敌不过真实内容自带的逻辑自洽性与可验证性。就像用精美的包装装了一罐劣质饮料,初见可能被吸引,入口后还是会察觉不对。

更有意思的是「吸睛内容」的对比实验。当要求人类或AI专门生成博眼球的内容时,虚假内容的比例确实会上升,但真实内容的说服力依然碾压虚假内容。这意味着,哪怕是在社交媒体的「注意力竞赛」里,真实信息也没输——情绪煽动或许能带来一时的传播量,却无法真正改变人们的深层信念。

不过这项研究也有其局限性:它只测试了单次接触信息的影响,而现实中我们对信息的判断,往往受重复曝光的「虚幻真理效应」左右。当一条虚假信息被反复推送,哪怕最初不信,见多了也可能下意识觉得「好像是真的」。这才是真实信息真正的挑战——它不需要刻意讨好算法,却要在算法制造的信息茧房里,对抗虚假信息的重复轰炸。

真实的力量,从来不是一蹴而就的碾压,而是在反复博弈中持续存在的韧性。它需要我们多一点认知反思,也需要平台多一点算法克制。毕竟,在信息洪流里,比识别虚假更重要的,是始终愿意相信真实的那股劲儿。