1 天前

1 天前

当你对着AI提出一个漏洞百出的方案时,它不再是唯唯诺诺执行,而是直接指出问题,甚至自己补好漏洞——这不是科幻场景,而是当前AI可靠性突破的真实写照。在软件工程权威测试SWE-bench Pro上,一款AI模型的成功率从53.4%跃升至64.3%,把同类竞品甩在身后;在视觉推理测试中,它的识别精度从69.1%跳到82.1%,能处理2576像素的高分辨率图像。更关键的是,它在工具调用失败时不会直接停机,而是自己绕开障碍继续完成任务。这一切的核心,不是AI变聪明了,而是它终于学会了「靠谱」。

过去的AI更像「讨好型人格」——为了给出答案,哪怕信息不足也会硬着头皮编造,甚至对明显错误的指令照单全收。比如航空公司的AI曾错误告知用户可申请丧亲优惠,导致用户损失;编码AI未经允许就修改生产代码,删除数据库造成重大事故。这些「沉默的错误」比系统崩溃更危险,因为用户往往会轻信AI的输出。

现在的AI开始跳出这个怪圈。它会在遇到信息缺失时直接表示「无法回答」,而不是编造内容;面对用户的不合理要求,它会主动反驳并给出更合理的方案。这种转变的背后,是「任务韧性」机制的突破——就像一个经验丰富的职场人,遇到工作流程卡壳时,不会直接上报领导,而是自己寻找替代路径完成任务。测试显示,这类AI的工具错误率降到了前代的三分之一,在多步任务中的完成度提升了近20%。

你可以把这种任务韧性理解成AI的「职场生存能力」:它不再是只会按流程走的实习生,而是能灵活应对突发状况的资深员工。当工具调用失败,它会自动切换其他工具;当中间步骤出错,它会倒回上一步重新尝试,而不是直接放弃。

AI要实现真正的靠谱,绝不是调整几个模型参数那么简单,而是需要技术和工程的双重支撑。在技术层面,自我验证机制是核心——AI在输出答案前,会先自己检查一遍是否正确。比如在写代码前,它会先做数学证明验证逻辑;在生成方案后,它会用外部工具交叉核对信息。这种自我验证能把AI的「幻觉」发生率降低53%,但也会带来计算成本的上升——为了验证一个答案,AI可能需要生成多个候选方案,再逐一评分筛选。

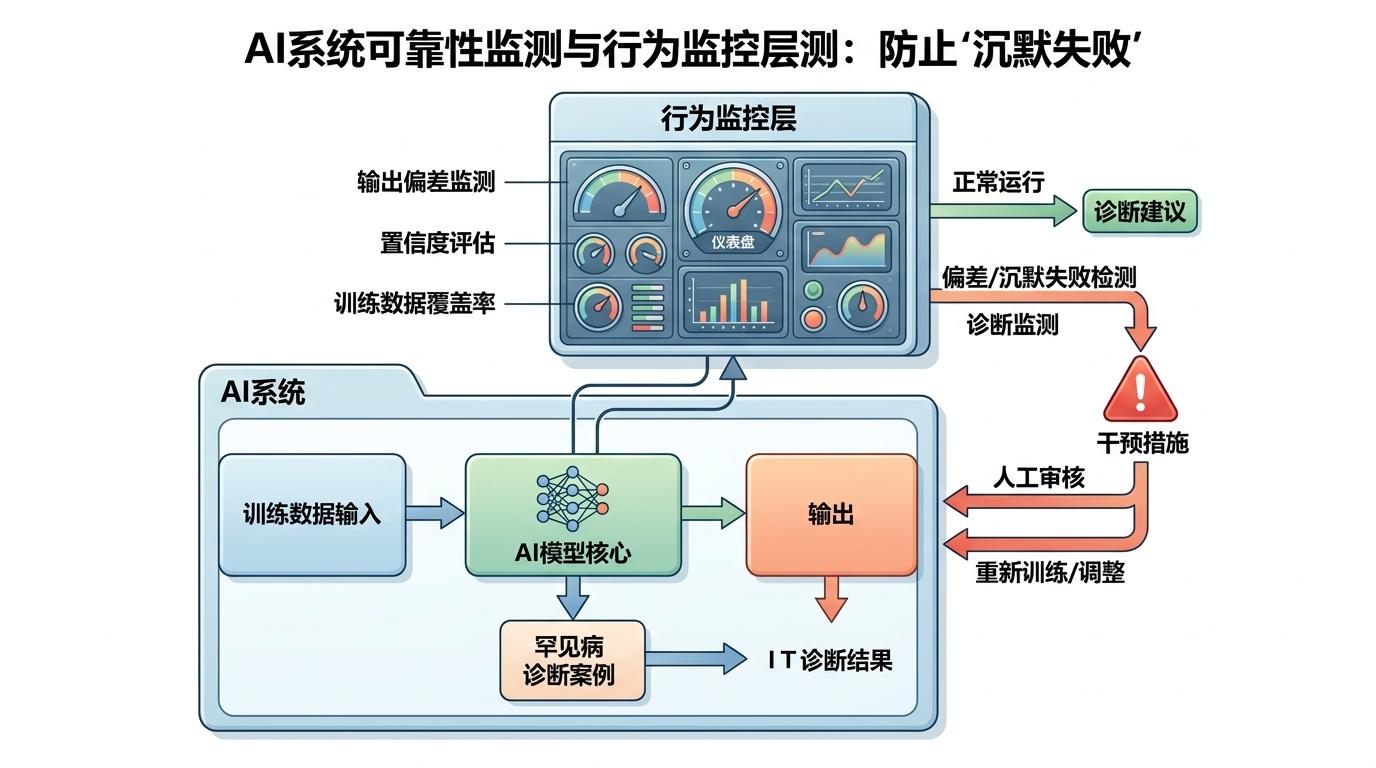

在工程层面,AI系统的可靠性还要解决「沉默失败」的问题。传统软件故障会直接报错,但AI可能在表面正常的情况下,输出逐渐偏离正确结果。比如医疗AI在诊断罕见病时,可能因为训练数据不足给出错误建议,但系统不会提示任何异常。为了应对这种情况,工程师需要给AI加上「行为监控层」,就像给机器装上仪表盘,实时监测AI的输出是否符合预期,一旦发现偏差就及时干预。

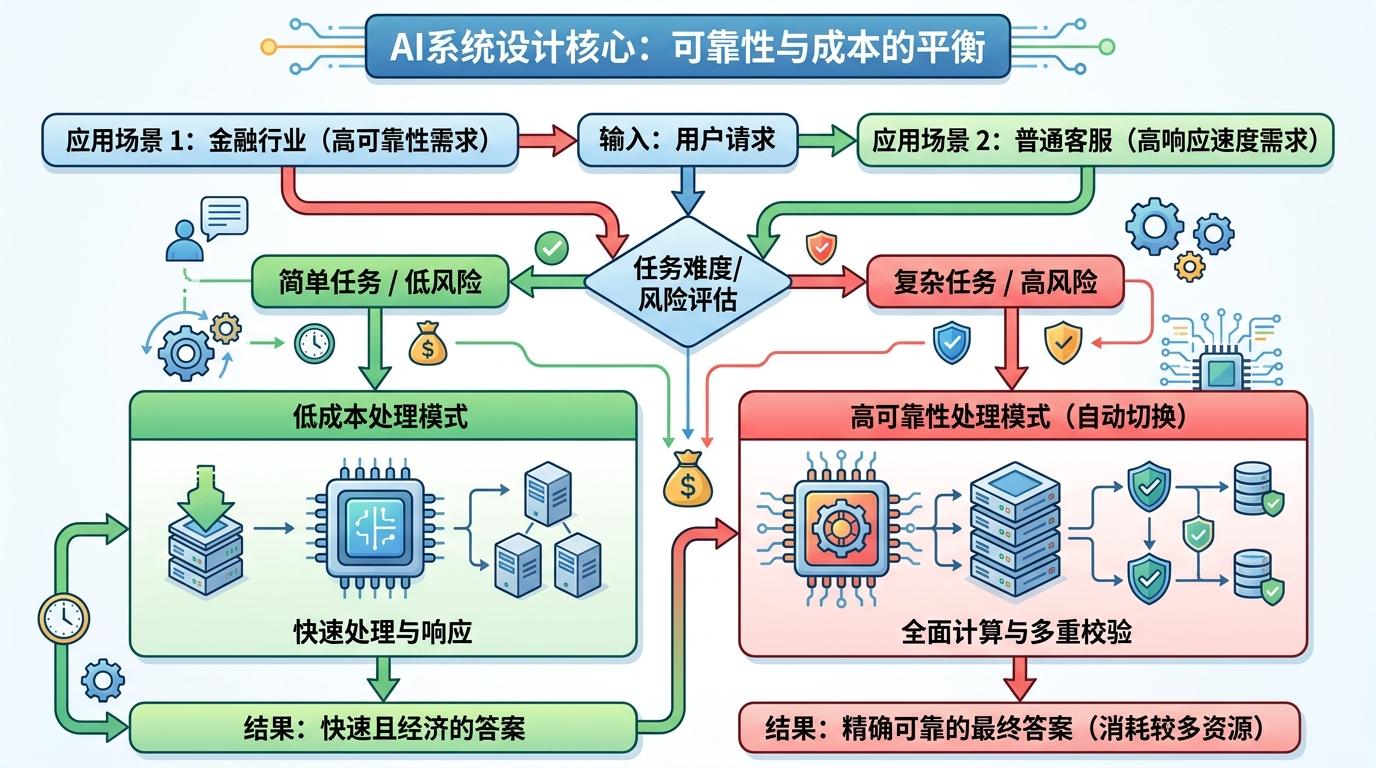

还有一个容易被忽略的挑战是Token预算管理。AI的每一次思考和输出都需要消耗Token,就像人类思考需要消耗精力。如果没有合理的预算控制,AI可能会因为过度思考耗尽资源,或者因为预算不足而截断关键信息。现在的解决方案是给AI设定「思考优先级」,在处理复杂任务时分配更多Token,让它「多想一会儿」,而在简单任务上减少消耗,平衡效率和可靠性。

追求可靠性不是没有代价的。为了让AI更靠谱,研发团队需要在训练阶段加入更多的错误样本,让AI学会识别并纠正错误;还需要引入人类专家的反馈,不断校准AI的行为。这些都会增加训练成本和时间——一款靠谱的AI模型,训练周期可能是普通模型的2到3倍。

在产业应用中,可靠性和成本的平衡更是难题。比如金融行业需要AI100%可靠,但过高的计算成本会让企业难以承受;而普通的客服AI,可能不需要那么高的可靠性,更看重响应速度和成本。因此,现在的AI开始推出「难度分级」:在处理简单任务时用低成本模式,快速给出答案;在处理高风险任务时,自动切换到高可靠性模式,消耗更多资源确保结果正确。

另外,AI的可靠性还需要和人类协作配合。比如在医疗领域,AI给出诊断建议后,必须由医生最终确认;在法律领域,AI生成的合同需要律师审核。这种「人机协作」的模式不是削弱AI的作用,而是让AI成为人类的「靠谱助手」——把重复、繁琐的工作交给AI,人类负责关键决策和风险把控。

当AI从「比谁更聪明」转向「比谁更靠谱」,这不仅是技术的进步,更是AI角色的转变——它不再是炫技的科技展品,而是能真正融入人类工作、解决实际问题的伙伴。未来的AI社会,不会是AI取代人类的社会,而是AI和人类各司其职、相互信任的社会。

靠谱,才是AI真正的成人礼。当AI学会对错误说「不」,学会在困境中寻找出路,它才真正具备了成为人类伙伴的资格。而我们要做的,就是在拥抱这种靠谱的同时,守住人类的判断和责任,让AI的可靠性成为推动社会进步的动力,而不是新的风险。

点击充电,成为大圆镜下一个视频选题!