对抗知识焦虑,从看懂这条开始

App 下载

浏览器渲染瓶颈被攻克:Visionary如何解锁世界模型实时交互?

Marble项目|实时交互|世界模型|浏览器渲染|Visionary引擎|消费电子|多模态视觉|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

Marble项目|实时交互|世界模型|浏览器渲染|Visionary引擎|消费电子|多模态视觉|前沿科技|人工智能

想象一个触手可及的数字孪生世界:工程师在浏览器标签页中实时调试产线上的机器人,设计师与全球同事共同漫步于虚拟建筑模型,学生则在动态复现的历史场景中身临其境。这个未来离我们似乎很近,却始终隔着一层看不见的墙——Web端渲染能力的瓶颈。长期以来,我们最常使用的信息入口“浏览器”,在处理复杂、动态的3D世界时,就像一条拥堵的单行道,无法承载“世界模型”(World Model)这一前沿AI技术奔涌而来的数据洪流。

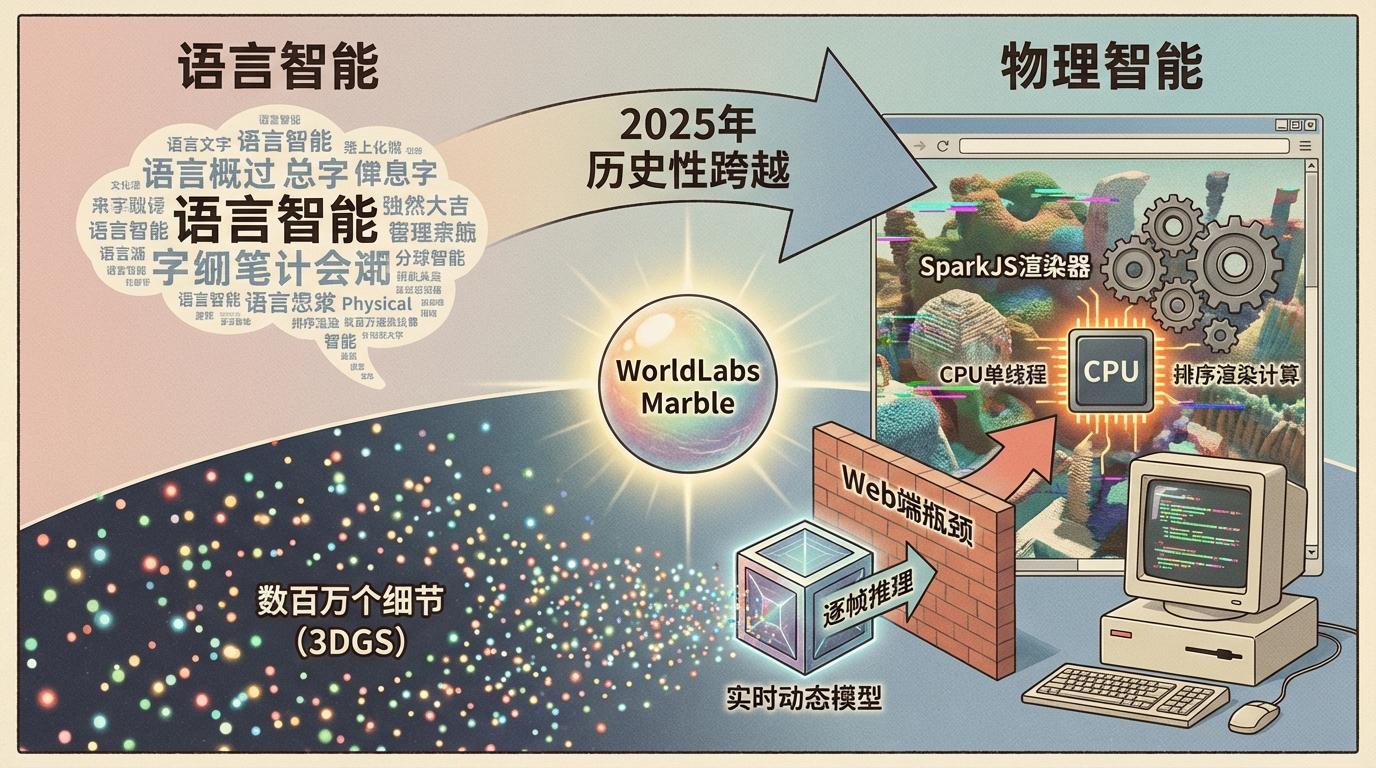

2025年,人工智能界见证了从“语言智能”到“物理智能”的历史性跨越,以李飞飞团队WorldLabs的Marble为代表的世界模型引爆热潮,它们试图在计算机中构建整个世界的模拟。然而,当Marble首次将基于3D高斯泼溅(3DGS)技术构建的3D世界搬入浏览器时,兴奋之余,一个残酷的现实也随之浮现:其依赖的WebGL渲染器SparkJS,在面对包含数百万个细节的大场景时,性能急剧下降。其瓶颈在于,所有用于排序和渲染准备的繁重计算都压在了CPU的单线程上,导致画面卡顿、交互延迟,更无法接入需要逐帧实时推理的动态模型。世界模型的可视化与交互,这“最后一公里”,被牢牢卡在了Web端。

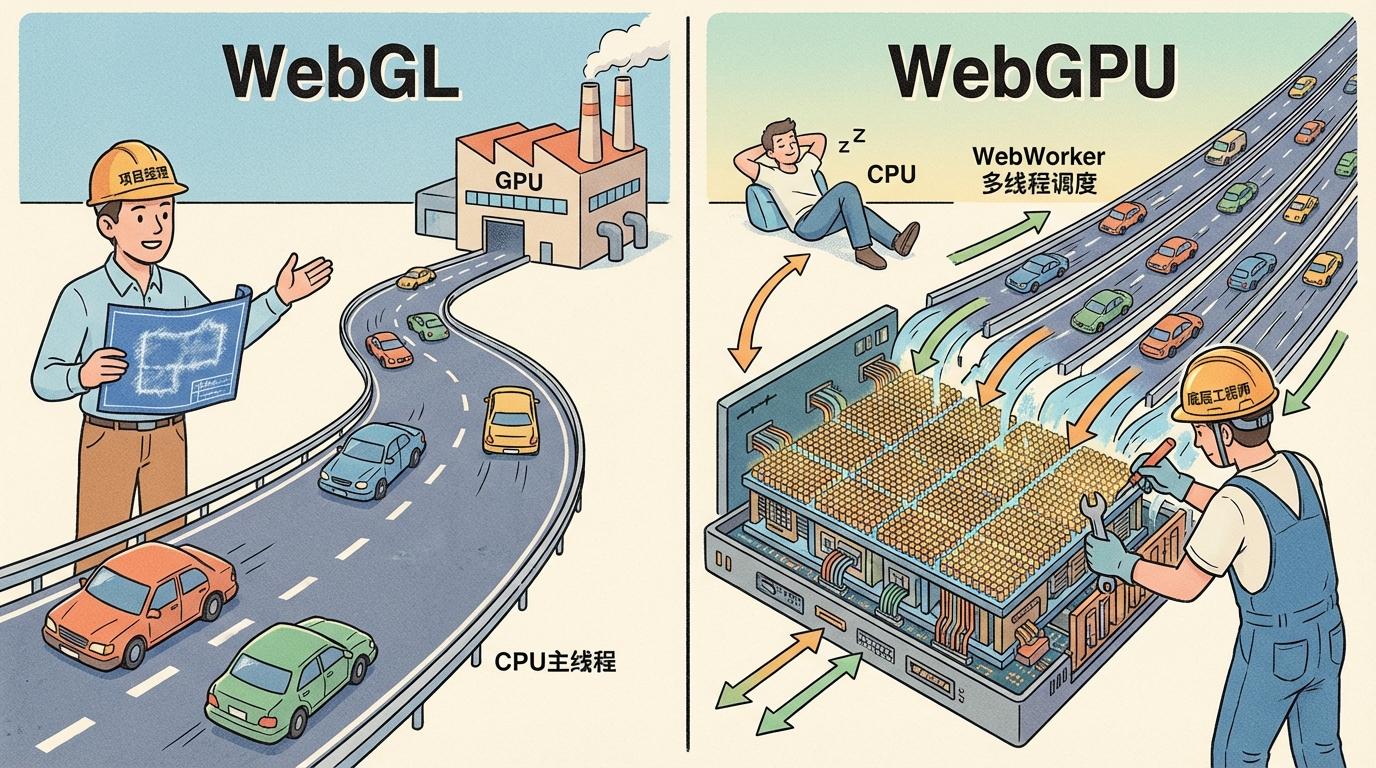

就在近日,由上海人工智能实验室钟志航团队联合四川大学、东京大学等多家顶尖机构共同完成的开源项目Visionary,为这个问题给出了一个截然不同的答案。它不是对现有技术的修补,而是一场彻底的架构革命。Visionary宣布:基于WebGPU与ONNX,在浏览器中实现了真正的动态3DGS乃至4DGS(即包含时间维度)的实时渲染,并在多项测试中全面超越了SparkJS。

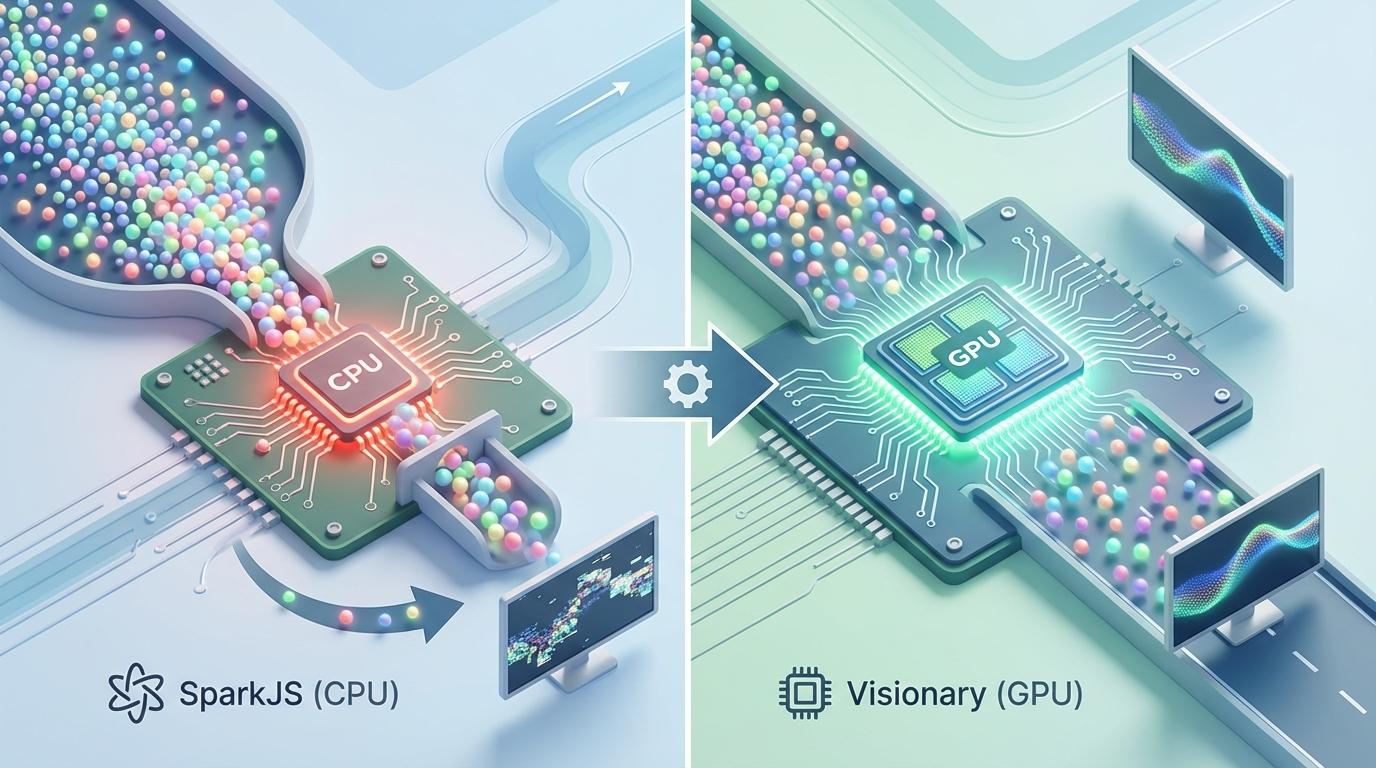

Visionary的定位并非“又一个3DGS查看器”,而是一个面向世界模型和空间智能的Web原生渲染基座。它的核心武器有两件:

实验数据清晰地展示了这场技术换代的威力。在处理包含数百万高斯点的典型场景时,SparkJS的性能瓶颈集中在CPU排序阶段,而Visionary将这一核心负载完全转移至GPU,极大地降低了端到端延迟,实现了肉眼可见的流畅。

更重要的是,Visionary带来的不仅仅是速度。它采用逐帧GPU全局排序,彻底根除了SparkJS在视角快速变化时因“懒排序”(lazy sorting)而产生的视觉伪影和闪烁问题。无论用户如何快速地拖动、旋转视角,画面始终保持稳定和精确。同时,在多个模型混合的复杂场景中,它也能保证透明物体渲染的正确性,避免了其他方案中常见的混合错误。这意味着,用户看到的不仅是一个更快的世界,更是一个视觉上更正确、更可信的世界。

Visionary的出现,其深远意义在于它为世界模型打开了从“静态观看”到“动态交互”的大门。在此之前,Web端的世界模型更像是一幅幅精美的3D“照片”,而现在,它们可以成为一个活生生的、可交互的“世界”。

对研究者而言:任何新的3DGS变体算法,只要能导出为ONNX格式,就能立刻在浏览器中复现、对比和展示,极大地加速了学术交流和迭代的效率。

对创作者而言:无需安装任何笨重的专业软件,在浏览器中就能完成对动态3D场景的编辑、动画录制和最终渲染,创作门槛被前所未有地拉低。

对工业界而言:这正是数字孪生、智能制造、扩展现实(XR)和具身智能等领域梦寐以求的基础设施。无论是模拟整个城市的交通流,还是训练机器人在虚拟工厂中执行任务,Visionary都提供了一个低成本、高效率、易于部署的实时可视化与交互平台。

Visionary团队表示,这仅仅是迈向统一世界模型框架的第一步。他们的蓝图远不止于此,未来将探索:

世界模型的终极竞争,最终会回到一个核心问题:谁能把复杂的世界,以稳定、快速、低门槛的方式呈现并交付给用户和AI?Visionary用WebGPU和ONNX的强大组合给出了响亮的回答:把世界模型,真正带到每个人的Web浏览器中。这场始于浏览器的渲染革命,正为我们开启一个可实时交互的动态数字新纪元。