对抗知识焦虑,从看懂这条开始

App 下载

谷歌砸400亿押注,AI圈两强对垒时代开启

定制芯片|算力路线|OpenAI|Anthropic|谷歌|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

定制芯片|算力路线|OpenAI|Anthropic|谷歌|AI产业应用|人工智能

2026年4月25日,谷歌宣布向Anthropic砸下最高400亿美元的投资——这不是普通的财务注资,而是一场AI产业格局的掀桌式重构。就在半年前,AI第一梯队还是OpenAI、谷歌、Anthropic的“御三家”鼎立局面;仅仅180天后,Anthropic的股东名单上已经集齐了亚马逊、谷歌、微软、英伟达四大硅谷巨头,累计算力承诺超过11吉瓦——相当于10个核电站的发电量。曾经的三足鼎立,如今变成了Anthropic与OpenAI的两强对垒,而这场对决的核心,藏在两种截然不同的算力路线里。

你可以把AI大模型想象成一台超级工厂,算力就是驱动工厂的能源——有人选择为工厂量身定制专用发电机,有人则直接采购市面上最通用的大功率机组。

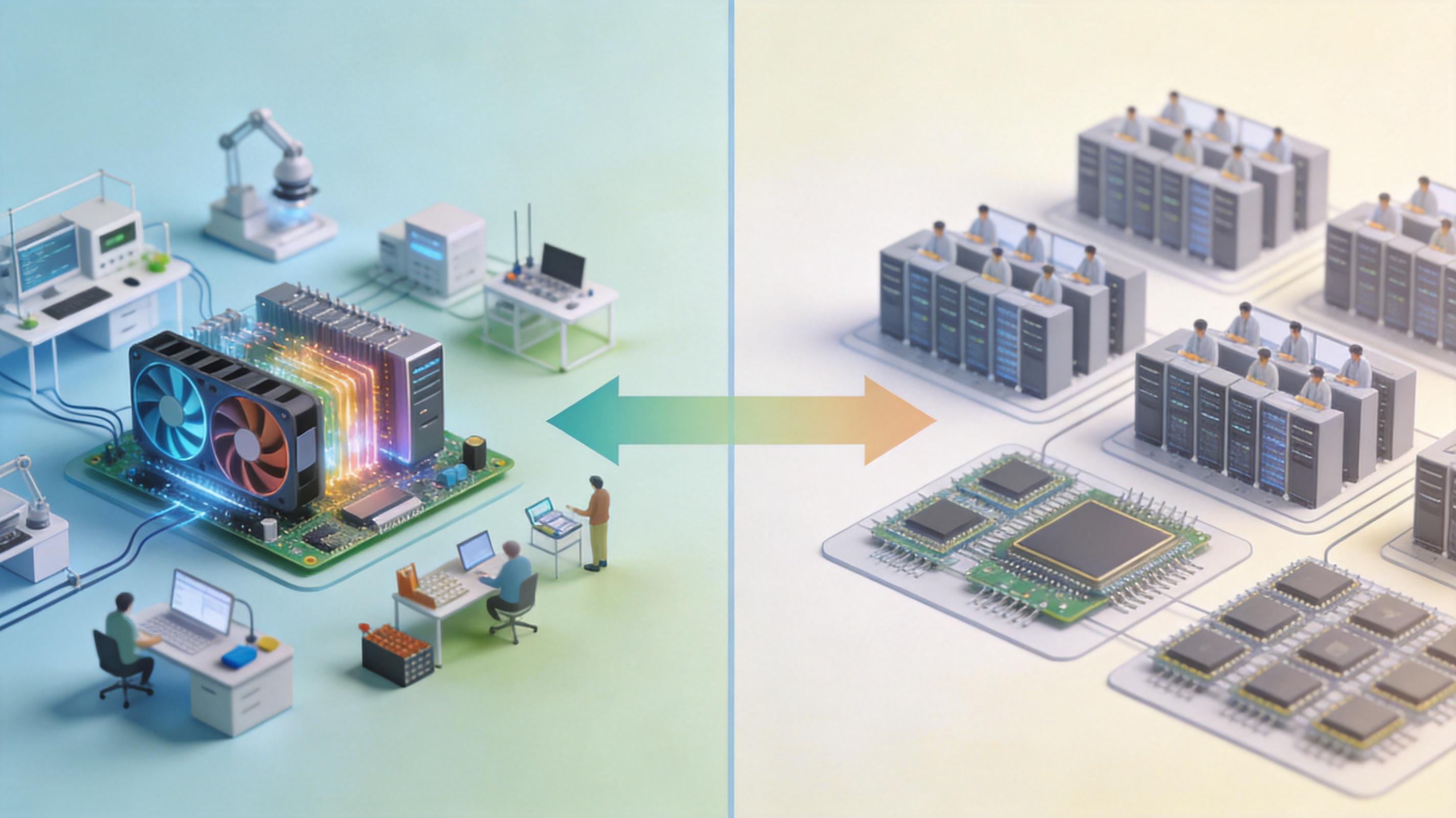

Anthropic走的是前者:大模型+ASIC路线。ASIC是“专用集成电路”的缩写,就像为AI的矩阵运算量身打造的发电机,没有多余的功能,每一分算力都用在刀刃上。谷歌的TPU、亚马逊的Trainium都是这类芯片的代表——AWS声称Trainium的训练成本比英伟达A100低54%,谷歌则表示TPU v5e的性能价格比是前代的2倍。对于年营收突破300亿美元、手握上千家付费超百万美元客户的Anthropic来说,这种“定制化省电”意味着真金白银的成本优势。

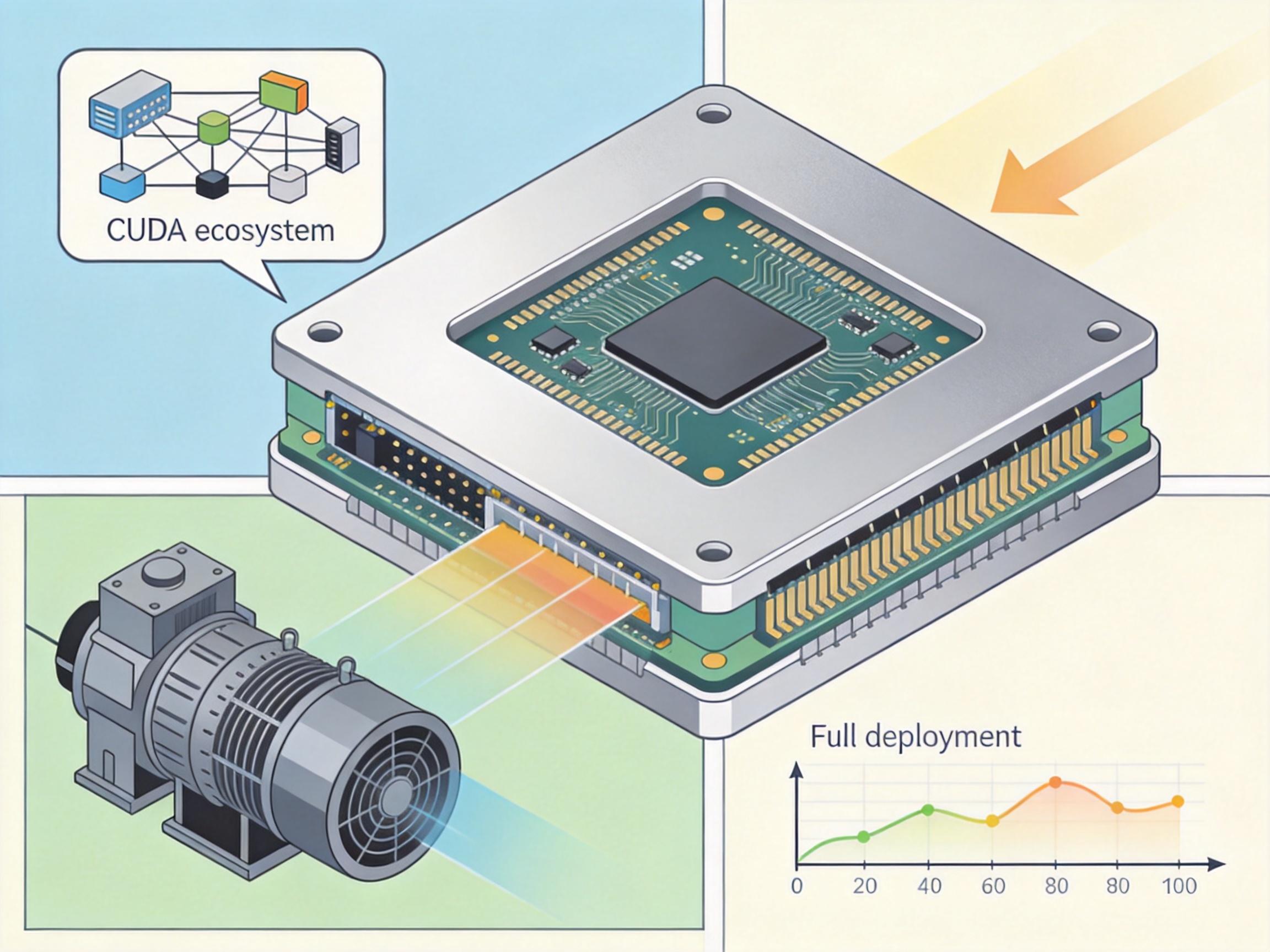

OpenAI则站在另一个阵营:大模型+GPU路线。GPU原本是为游戏图形渲染设计的通用芯片,就像市面上随处可见的大功率发电机组,虽然能耗不如定制芯片,但胜在兼容性强、配套设施完善。英伟达的GPU凭借CUDA生态,占据了AI训练市场90%以上的份额,开发者不用重新学习工具链,就能快速部署模型。但这种通用性也有代价:OpenAI的Stargate项目计划投入5000亿美元,却要等到2029年才能全面达产,当前还面临着资金缺口和供应链压力。

这场路线对决的背后,是巨头们用真金白银堆出来的生态闭环。

谷歌砸400亿美元的算盘很清晰:它今年的资本开支高达1850亿美元,其中大部分砸向了TPU芯片和数据中心。如果没有大客户消化这些产能,昂贵的定制芯片就会变成废铁。Anthropic既是能带来稳定收入的企业客户,也是验证TPU性能的最佳试验场——相当于谷歌用投资锁定了自己芯片的“官方代言人”。同样,亚马逊给Anthropic的250亿美元投资+5吉瓦Trainium算力,也是为了让自家定制芯片能在实战中站稳脚跟,摆脱对英伟达GPU的依赖。

OpenAI的处境则微妙得多。它一边和英伟达绑定,推进Stargate GPU集群建设,一边又在悄悄研发自主ASIC芯片;微软既是它的核心盟友,同时也给Anthropic投了5亿美元——巨头们都在做“对冲”,唯独OpenAI还在为算力缺口发愁。更关键的是,它的市场份额正在被蚕食:GPT系列在单点性能上依然领先,但Claude Code在编程场景、Claude在企业级应用里的份额持续扩大,就连微软的Foundry平台也开始主推Claude模型。

很多人在问,ASIC会不会彻底取代GPU?答案大概率是不会——它们更像是工厂里的两套动力系统,各司其职。

GPU的优势在于灵活性,适合快速迭代的模型训练和多样化的AI任务,比如科研机构的实验、中小企业的快速部署;而ASIC胜在能效比,适合规模化、标准化的推理场景,比如企业日常的AI客服、内容生成。谷歌自己的DeepMind在用TPU训练大模型的同时,也会用GPU做小范围实验;亚马逊的云平台上,Trainium和英伟达GPU的实例同时对外售卖。就连Anthropic也没有完全放弃GPU,它和英伟达签了1吉瓦的算力采购协议,用来应对一些灵活的需求。

但这场路线之争依然关乎生死:谁能先把自己的生态做扎实,谁就能掌握定价权。英伟达靠CUDA生态躺赚了十几年,现在谷歌和亚马逊想用ASIC打破这个垄断;而OpenAI如果不能尽快补上算力短板,可能会在这场“现金+算力+生态”的三线博弈中掉队。

当谷歌的400亿美元到账时,AI圈的“御三家”时代正式落幕了。这不再是单个模型的性能竞赛,而是巨头们用资本、算力和生态织成的一张大网。

ASIC与GPU的对决,本质上是“定制化效率”与“通用性灵活”的权衡——没有绝对的对错,只有适合不同阶段的选择。但有一点可以确定:AI产业的胜负,从来不是某一种技术路线的胜利,而是能把技术、资本和市场需求拧成一股绳的玩家的胜利。

算力决定下限,生态决定上限。