对抗知识焦虑,从看懂这条开始

App 下载

自动驾驶老兵转攻机器人,要造通用具身大脑

世界模型|具身智能机器人|英伟达DriveAV|原力无限|王一舟|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

世界模型|具身智能机器人|英伟达DriveAV|原力无限|王一舟|AI智能体|人工智能

2018年英伟达GTC大会后台,一辆自动驾驶测试车悄悄开进了黄仁勋的私人车库——不是违规闯入,是核心工程师王一舟带着刚写完的算法来做终极验证。七年后,同样是这位英伟达DriveAV的创始成员,坐在杭州的办公室里,盯着屏幕上机械臂抓取零件的实时画面。他的身份成了原力无限CTO,赛道从四个轮子的自动驾驶,切换到了能跑能抓的具身智能机器人。不变的是他要解决的问题:怎么让AI在真实物理世界里,像人一样稳当又聪明地活着。

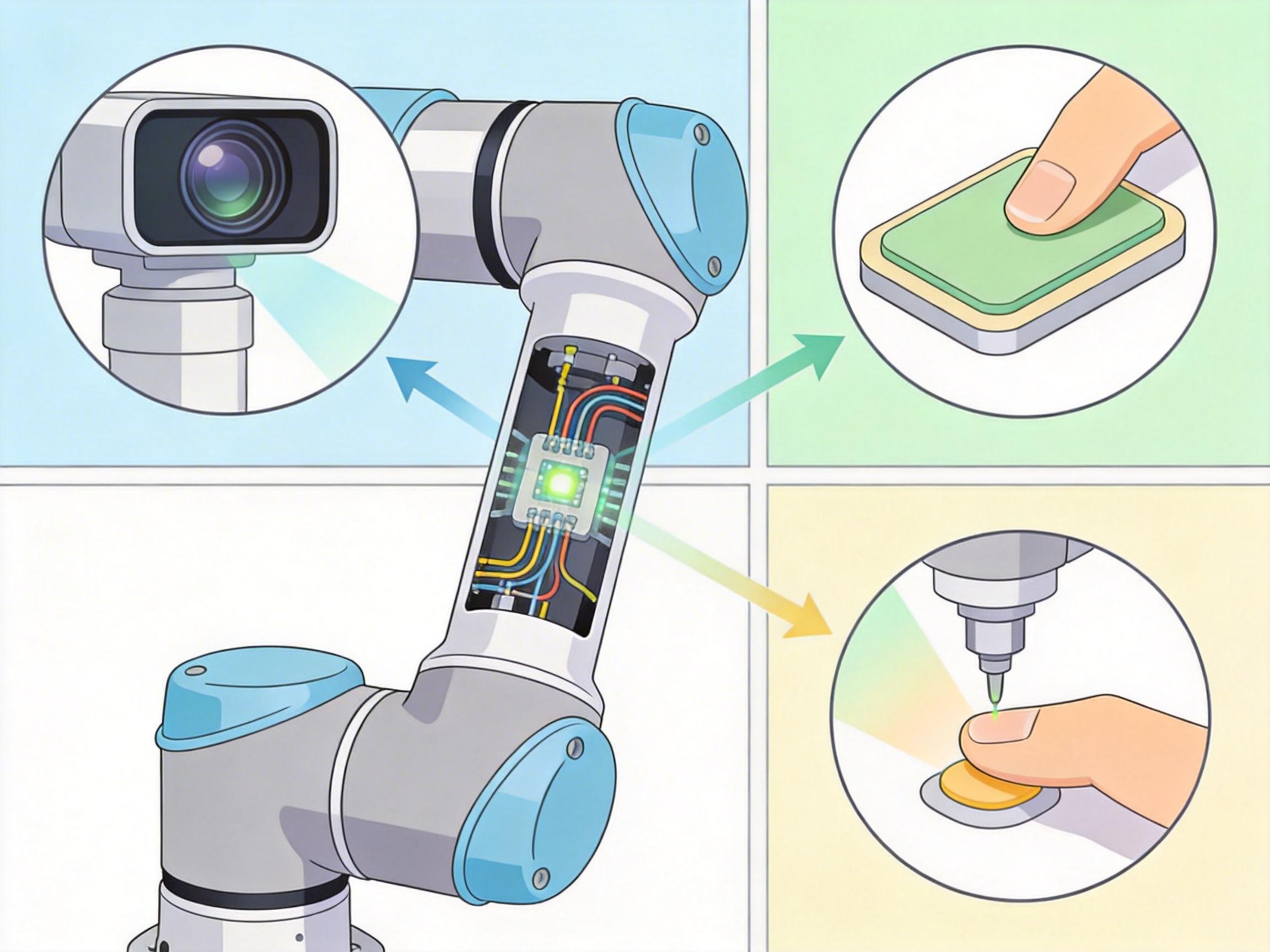

自动驾驶和具身智能,看起来是风马牛不相及的两个赛道,但在王一舟眼里,本质都是「给物理世界的智能体装大脑」。 你可以把自动驾驶的世界模型想象成一个超级导航:它融合雷达、摄像头、地图的所有数据,提前算出10秒后前车会不会变道、路口会不会有行人冲出来,然后规划出最安全的路线。而具身智能的世界模型,就是给机器人装一个能「脑补」的大脑——不仅要看到眼前的零件,还要能预判「我伸手去抓,它会往哪个方向滑」「我用力太大会不会捏碎它」。 自动驾驶用了十年磨出来的本事:多模态感知融合、数据闭环训练、鲁棒控制逻辑,全是具身智能急需的「基本功」。比如自动驾驶里的模型预测控制(MPC),原本是用来控制汽车不压线、不追尾,现在套用到机械臂上,就能让它在抓取易碎品时,精准控制力度不超过安全阈值。 但具身智能的难度,是自动驾驶的N次方。汽车只需要在二维的马路上跑,机器人却要在三维空间里做拧螺丝、叠衣服这种精细动作;汽车的环境有交通规则约束,机器人却要面对堆满杂物的仓库、随时有人走动的车间——每一个变量都是新的挑战。

2026年的具身智能赛道,已经从「比谁的机器人跳得高」转向「比谁的机器人能干活」。随着中国供应链的成熟,机器人本体——也就是机械臂、机身、传感器这些硬件——正在快速标准化,就像十年前的智能手机,拼到最后,核心竞争力还是操作系统和生态。 王一舟团队押注的「通用具身大脑」,本质是一套能适配不同机器人的智能系统:给机械臂装上,它能在工厂里拧螺丝、搬零件;给服务机器人装上,它能在医院里送药、在家庭里叠衣服。这套系统的核心,是把多模态大模型和因果世界模型焊在一起:多模态大模型负责「看懂」视觉信号、「听懂」人类指令,因果世界模型负责「想明白」动作的后果。 和直接把ChatGPT这类通用大模型嫁接到机器人上的思路不同,他们坚持从底层自研。通用大模型擅长「说」,但不擅长「做」——它能告诉你「怎么叠衣服」,但不知道「手要用力多大才能把衣角拉直」。而具身原生模型,是从机器人的动作数据里训练出来的,每一个参数都对应着真实的物理反馈。 当然,这条路难走得多。光是搭建数据闭环,就要解决机器人在真实环境里的自动数据采集、标注、仿真问题。他们用的RADAR系统,能让机器人自动完成「任务生成-执行-评估-环境重置」的循环,不用人工干预,一天就能采集上万条有效数据——这在自动驾驶领域是常规操作,但在具身智能领域,还是少数玩家能做到的事。

很多人觉得,具身智能的难点是算法,但王一舟说,真正的门槛是工程化——是把实验室里的Demo,变成能在工厂里连续运行1000小时不出错的产品。 第一个坑是「现实差距」:仿真环境里训练得再好的机器人,到了真实车间,可能因为地面的一点灰尘、零件的一点磨损,就抓不住东西。自动驾驶解决这个问题的办法,是用海量真实道路数据训练模型,具身智能也一样——他们把机器人放到真实工厂里试错,把每一次失败的记录都喂给模型,让它学会应对各种「意外」。 第二个坑是多模态融合:机器人要同时处理视觉、触觉、力觉的数据,就像人用眼睛看、用手摸、用力道感知物体。这需要把不同传感器的数据精准同步,差几毫秒,机械臂的动作就会偏掉。王一舟团队把自动驾驶里的传感器融合算法改了又改,才让机器人能像人一样,「看一眼、摸一下」就知道怎么抓东西。

还有一个绕不开的坑是成本。现在一台能干活的具身智能机器人,成本还是几十万,要普及到工厂,必须把成本降下来。而成本的大头,除了硬件,就是「大脑」的研发投入——谁能先把具身智能的算法效率提上去,用更少的算力训练出更聪明的模型,谁就能拿到成本优势。

王一舟把从自动驾驶到具身智能的转型,比作「从开汽车到开飞机」——原理相通,但难度呈指数级上升。自动驾驶用了十年,才从实验室走到马路上;具身智能要从车间走到千家万户,可能需要更长的时间。 但有一点是确定的:当机器人本体的硬件不再是壁垒,「大脑」的竞争才刚刚开始。那些在自动驾驶领域磨出来的工程化能力,那些对真实物理世界的理解,正在成为具身智能赛道最稀缺的资产。 智能的终极形态,从来不是会说话,而是会做事。 这句话不仅适用于自动驾驶,也适用于具身智能——毕竟,能帮人类把活干好的AI,才是真正有用的AI。