对抗知识焦虑,从看懂这条开始

App 下载

自动驾驶的隐形教练:学会自我进化的世界模型

场景数据|自我进化|虚拟大脑|世界模型|自动驾驶|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

场景数据|自我进化|虚拟大脑|世界模型|自动驾驶|人工智能

想象一下,一辆自动驾驶汽车在闹市区行驶时,突然预判到前方电动车会违规横穿——这个预判不是来自程序员提前写好的规则,而是车辆自带的“虚拟大脑”自己推演出来的。更厉害的是,如果它这次预判错了,下次会自动修正逻辑,甚至会主动告诉工程师“我需要更多这类场景的数据”。这不是科幻,而是已经落地的技术:一种能自我诊断、定向进化的世界模型,正在让自动驾驶从“按脚本开车”走向“像人一样学开车”。它到底是怎么做到的?又能解决自动驾驶最棘手的哪些问题?

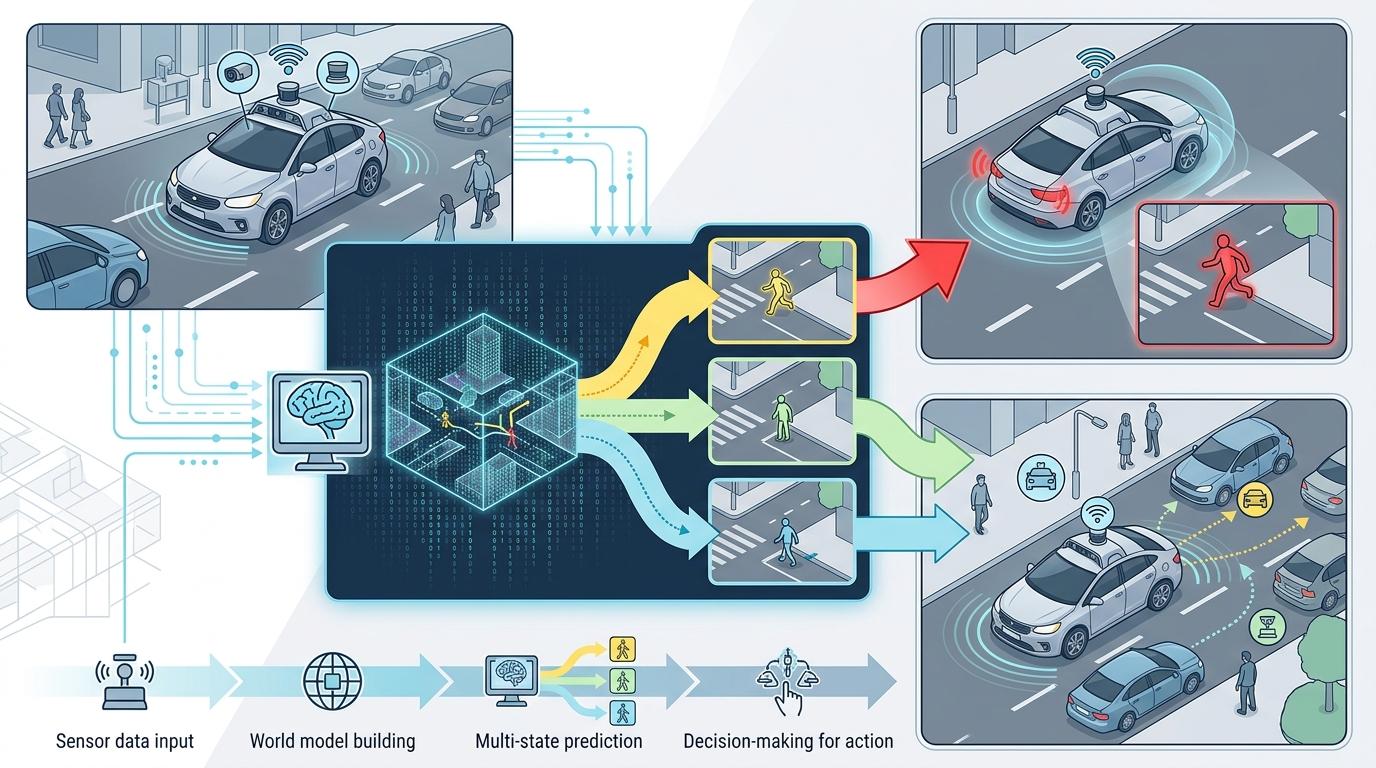

你可以把世界模型理解成自动驾驶汽车的“平行宇宙模拟器”——它会用摄像头、激光雷达等传感器收集的实时数据,在车里构建一个和现实同步的虚拟环境,还能预测未来几秒钟内每个行人和车辆的可能动作。比如看到路口有个玩手机的行人,它会模拟出“行人突然冲过马路”“行人停下等红灯”“行人退回人行道”三种可能性,提前让车辆做好应对准备。

但早期的世界模型更像个“被动的计算器”:只能按照工程师喂的数据和设定的规则做预测,一旦遇到没见过的场景就容易出错,而且错了也不知道自己错在哪。就像一个只会背题的学生,换个题型就懵了,还不知道自己哪里没学会。

新一代世界模型的核心突破,就是拥有了自我诊断和定向进化的能力。简单说,它终于学会了“自我复盘”:

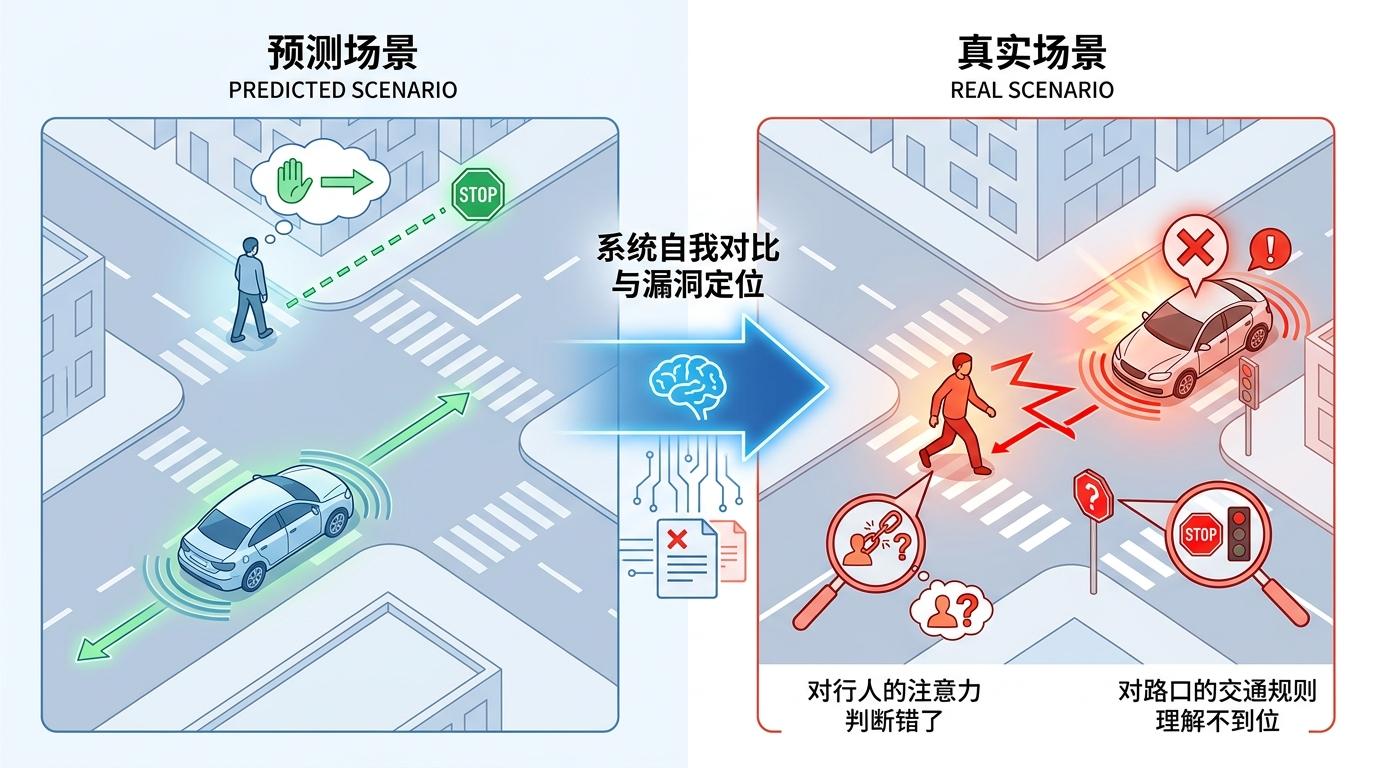

当它的预测和现实出现偏差——比如预判行人会停下,但对方突然冲了出去——它会自动对比“预测场景”和“真实场景”的差异,定位自己的漏洞:是对行人的注意力判断错了?还是对路口的交通规则理解不到位?

更关键的是,它不会只停留在“发现错误”,还会给出“改进方案”:如果是因为这类低头看手机的行人数据太少,它会主动通知数据采集团队“多去这类路口收集数据”;如果是预测逻辑有问题,它会自动调整模型参数,下次遇到类似场景时修正预判。

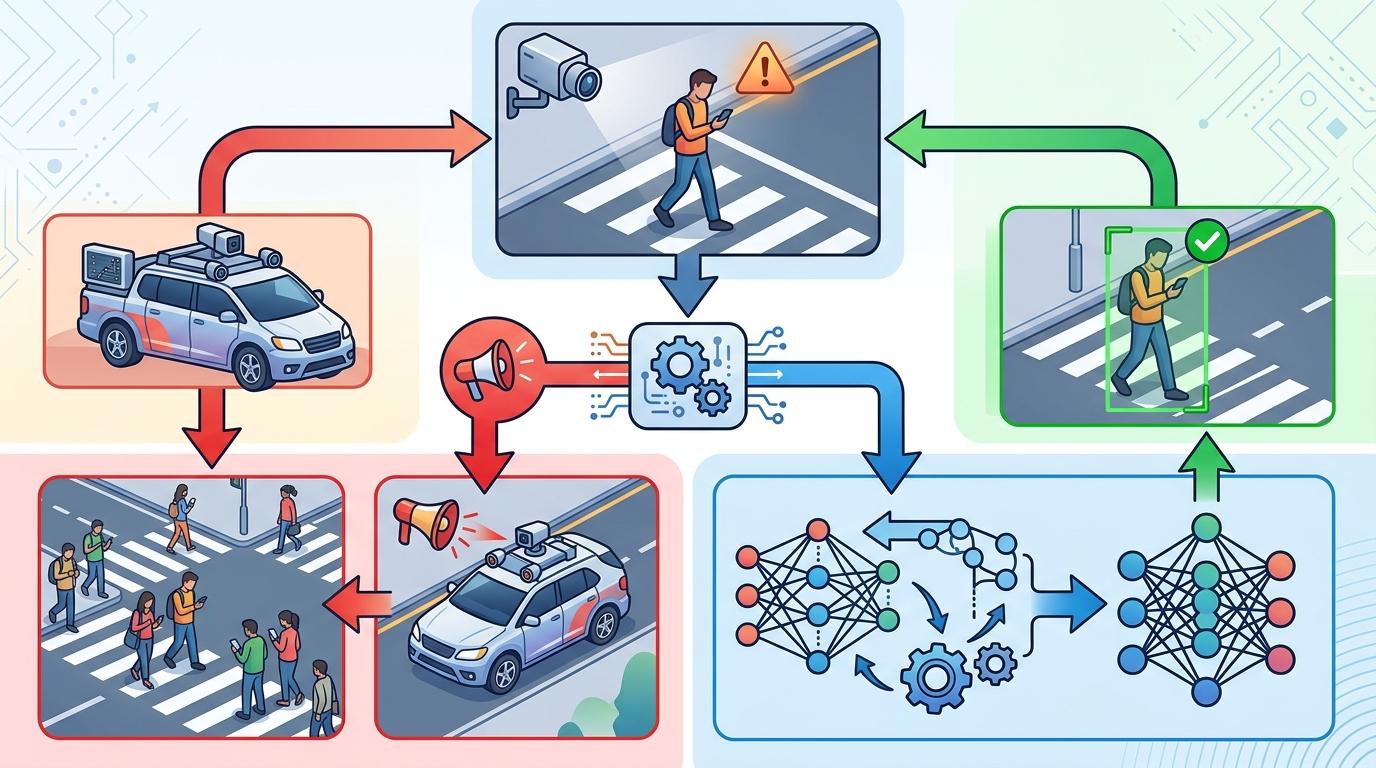

这个过程就像教练带学员:不用学员自己找错题,教练会直接指出“你这里刹车晚了”,还会针对性地加练“突发横穿场景”,直到学员熟练掌握。有厂商测试显示,这套机制让自动驾驶系统的场景适应速度提升了2倍,事故预判准确率提高了18%。

但这项技术也不是完美的。最棘手的是“模型幻觉”问题:有时候世界模型会生成和现实逻辑不符的预测——比如预判一辆停着的车会突然起飞,这听起来离谱,但在复杂的多传感器数据融合中,偶尔就会出现这种“脑补”出来的错误。目前行业里主要靠“检索增强生成”技术解决:让模型在预测前先调用真实世界的知识库,验证自己的预判是否符合物理规则。

另外,这种能自我进化的模型对计算资源要求极高,单辆车的硬件成本会增加数千元,这也是制约大规模普及的因素之一。更重要的是,如何让用户信任一个“自己会改程序”的自动驾驶系统?如果它在路上突然调整了预判逻辑,出了事故该谁负责?这些都是技术之外需要解决的问题。

从只会按脚本执行的“机器”,到能自我学习、自我进化的“智能体”,世界模型的进化,其实是自动驾驶技术从“模拟人类驾驶”到“拥有类人智能”的关键一步。它不再是一个冰冷的工具,更像一个能不断成长的“司机学徒”。

当然,这只是开始。未来的自动驾驶,需要的不仅是能自我进化的模型,还要有能监管这种进化的机制,以及让用户理解和信任这种智能的方式。毕竟,让机器学会开车不难,让机器学会“像负责任的人一样开车”,才是真正的挑战。

智能不是完美复刻,而是学会持续成长。