对抗知识焦虑,从看懂这条开始

App 下载

内存涨4倍,低端手机正在消失

智能手机|NAND闪存|DRAM|内存芯片价格|端侧AI|消费电子|AI产业应用|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

智能手机|NAND闪存|DRAM|内存芯片价格|端侧AI|消费电子|AI产业应用|前沿科技|人工智能

地铁信号盲区里,有人用手机实时修完了旅行照——不用等云端加载,指尖圈掉路人,AI自动补出漫山的樱花。而就在三个月前,同一款修图软件还需要加载30秒才能显示预览。这不是某款新机的独家噱头,而是端侧AI(On-device AI)正在重构消费电子的底层逻辑:当AI模型从云端搬进设备本地,连信号死角都能长出智能。但背后更尖锐的现实是,内存芯片价格在半年里翻了4倍,部分低端手机已经陷入亏本生产的困境。为什么智能体验升级的同时,我们的选择反而变少了?

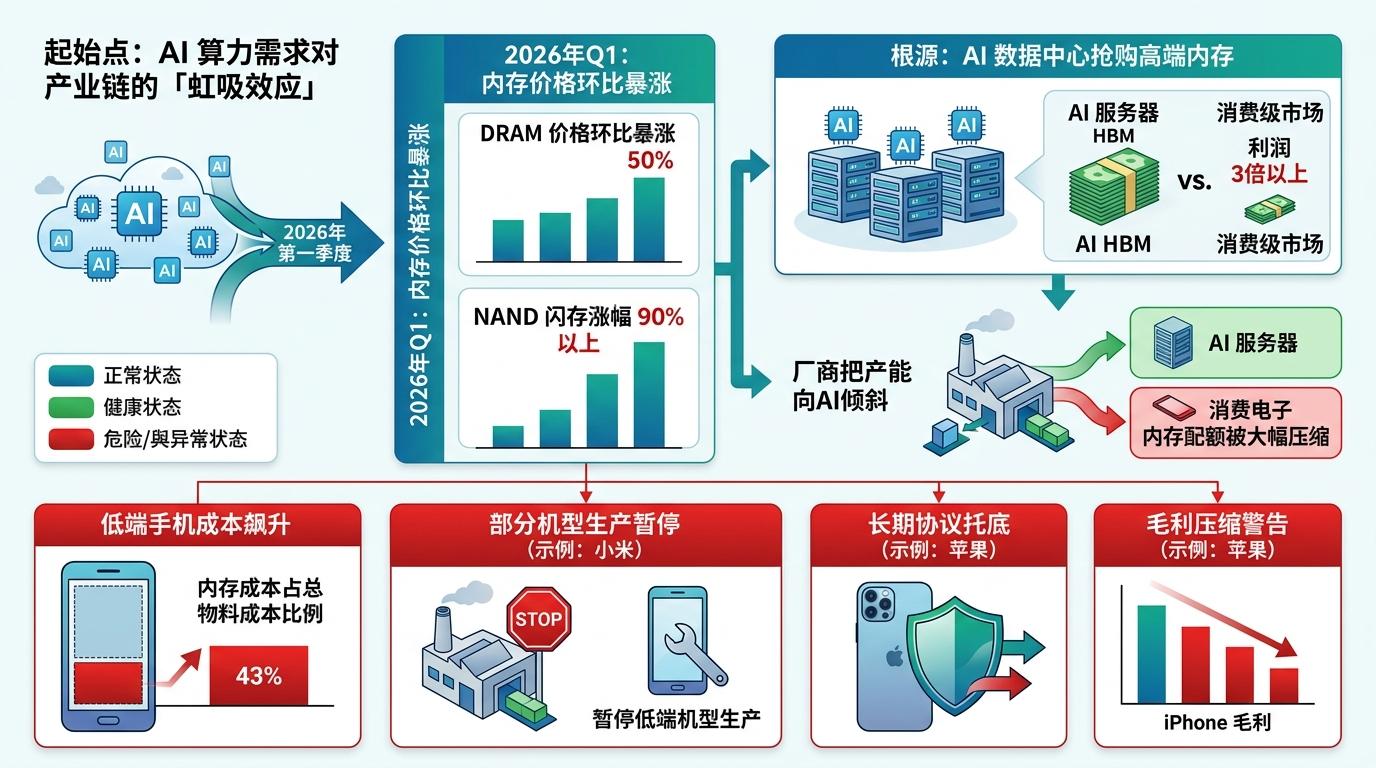

这一切的起点,是AI算力需求对产业链的「虹吸效应」。2026年第一季度,DRAM价格环比暴涨50%,NAND闪存涨幅超过90%,根源在于AI数据中心对高端内存的抢购——相比利润微薄的消费级市场,为AI服务器供应高带宽内存(HBM)的利润是前者的3倍以上。三星、SK海力士等厂商纷纷把产能向AI倾斜,消费电子的内存配额被大幅压缩,直接导致低端手机的内存成本占总物料成本的比例飙升至43%。小米等厂商不得不暂停部分低端机型生产,而苹果虽有长期采购协议托底,也不得不警告内存涨价将压缩iPhone毛利。

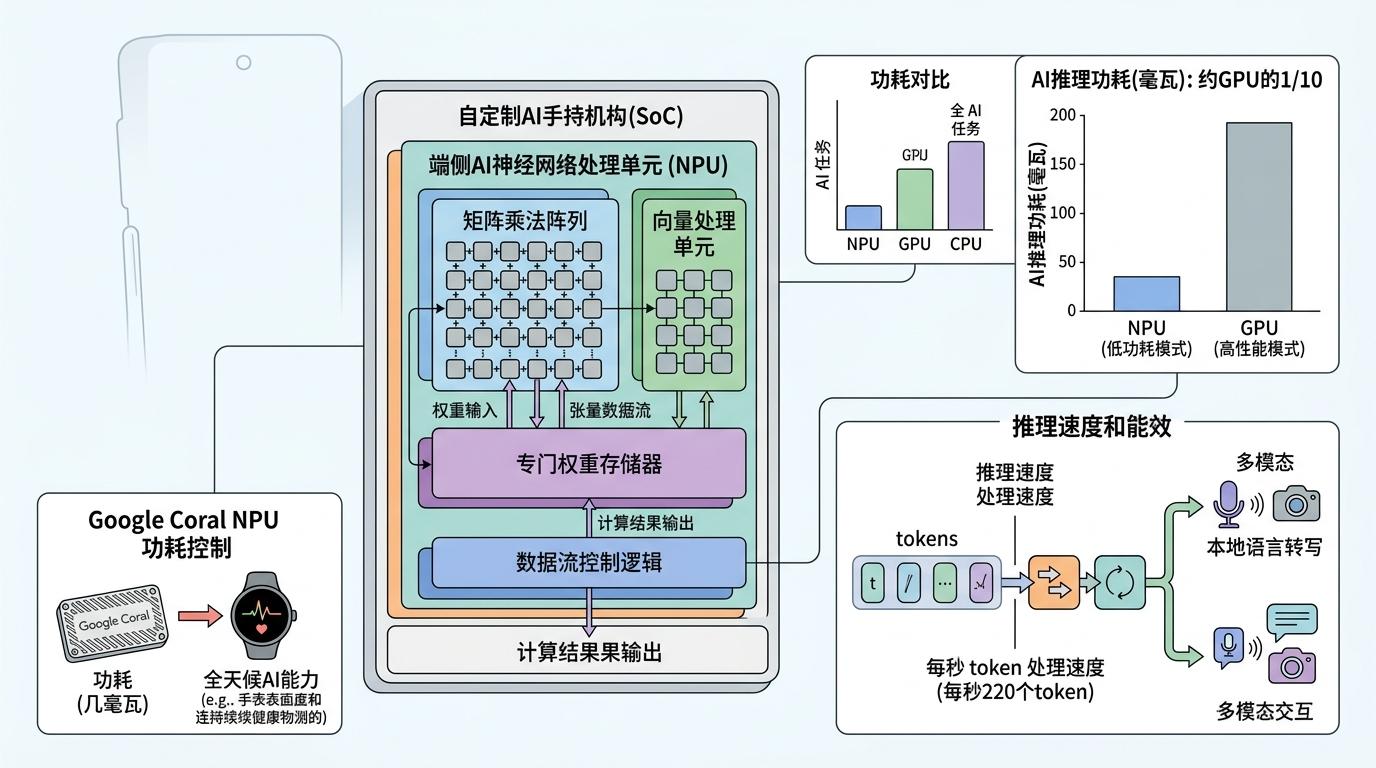

端侧AI的普及,正在倒逼硬件从「堆参数」转向「精准适配」。过去,消费电子的升级逻辑是「更大内存、更快处理器」,但现在,NPU(神经网络处理单元)成为了新的核心指标——它能以仅GPU1/10的功耗完成AI推理,让手机在离线状态下运行生成式AI模型。高通骁龙8 Elite Gen 5的NPU能实现每秒220个token的处理速度,足以支持本地语音转写和多模态交互;而Google Coral NPU则把功耗控制在几毫瓦,为智能手表和AR眼镜提供全天候AI能力。这些专用加速器的出现,让硬件不再是泛用性的计算容器,而是针对AI任务量身定制的「智能载体」。

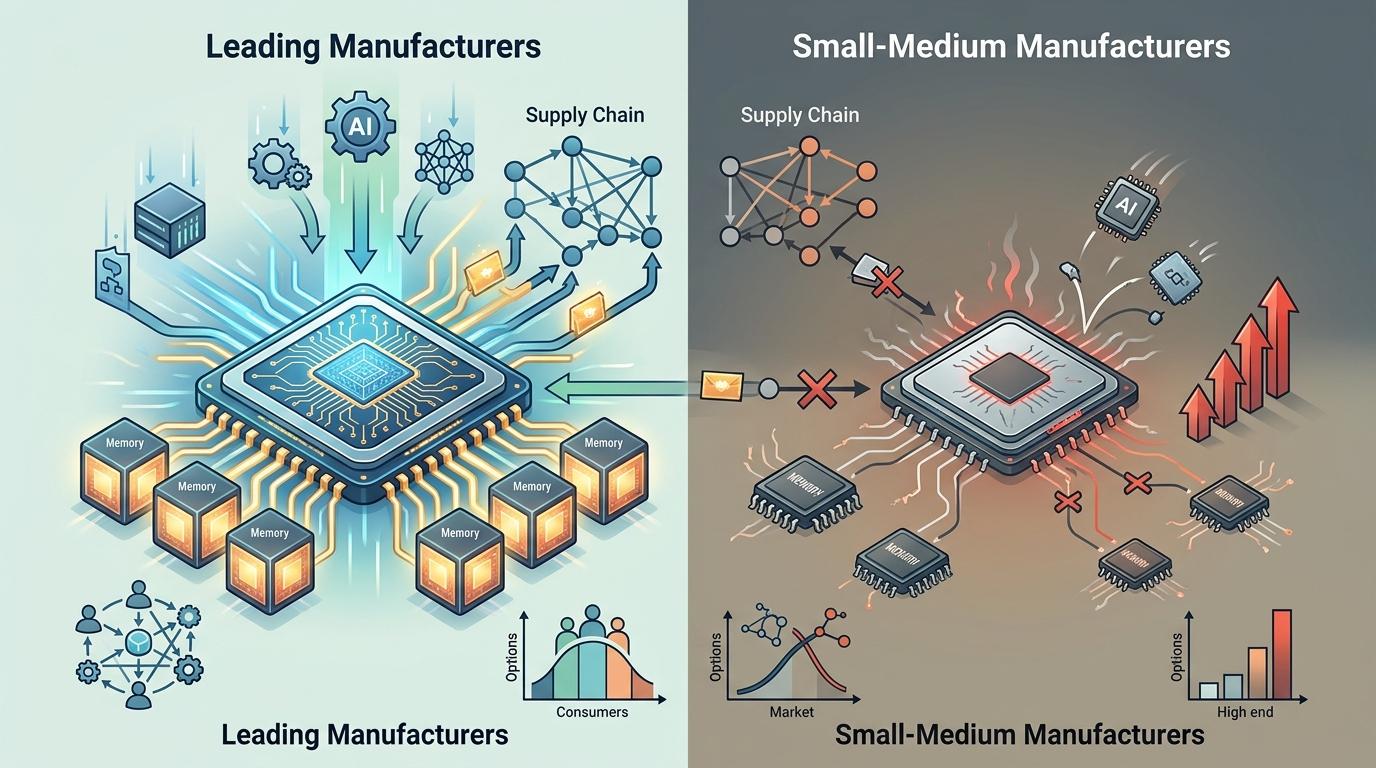

但这场变革的代价,是产业链的「分层加速」。头部厂商凭借芯片自研能力和供应链话语权,能快速适配端侧AI的需求——苹果M系列芯片通过软硬件协同,实现了AI模型的高效部署;而中小厂商则面临双重挤压:既拿不到足够的内存配额,又无力承担NPU的研发成本。更值得警惕的是,AI对内存的需求是长期且刚性的,行业普遍认为内存价格高位将持续至2027年,这意味着低端消费电子的生存空间将被进一步压缩,市场格局可能从「金字塔形」转向「哑铃形」。

当我们为端侧AI带来的实时智能欢呼时,也该看到消费电子正在经历的「隐性分化」。未来的设备或许不再有「高低端」的简单划分,而是会形成「AI原生设备」和「基础功能设备」的二元格局——前者能像伙伴一样理解用户,后者则回归纯粹的工具属性。而这场变革的本质,是AI正在重新定义「硬件价值」:不再是参数的堆砌,而是能否在本地完成智能决策的能力。毕竟,真正的智能,从来都不是云端的特权,而是握在手里的即时响应。