对抗知识焦虑,从看懂这条开始

App 下载

一张静态照,变出会动的3D数字人

静态照片生成|衣物动态建模|3D数字人|高丽大学|DynaAvatar|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

静态照片生成|衣物动态建模|3D数字人|高丽大学|DynaAvatar|多模态视觉|人工智能

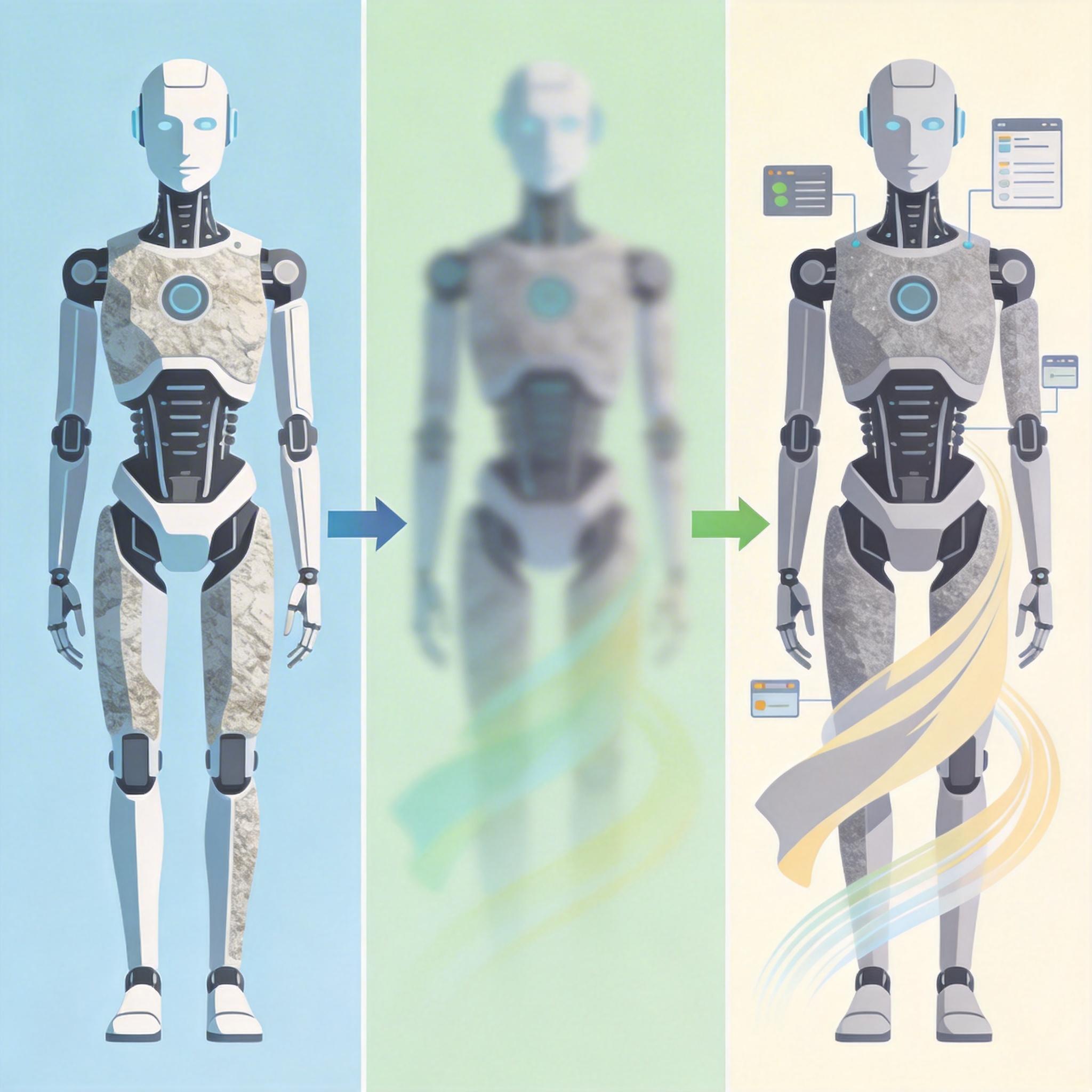

你拍了一张朋友穿长裙的照片,想让她的虚拟形象在元宇宙里跳起来——结果数字人跳得老高,裙子却像焊在腿上的铁板,纹丝不动。这不是科幻片里的bug,而是过去单图生成3D数字人的真实困境:衣服永远是静态贴图,动起来全是违和感。直到2026年3月,高丽大学的团队推出DynaAvatar:仅凭一张静态照片,就能生成会随着动作自然摆裙、扬外套的3D数字人,而且不用针对每个人单独训练。这怎么可能?

过去要让AI学会布料怎么飘,得喂它海量“人动衣飘”的动态视频——但这种数据贵得离谱,还稀缺。DynaAvatar的团队换了个思路:先让模型啃完几十万张静态3D人体扫描图,把“从一张照片还原出人的3D形状、衣服纹理褶皱”的基本功练到极致,这就是静态知识迁移。

但直接用动态数据微调这个“静态专家”,会让它把之前学的精细纹理忘得一干二净——这就是AI界的“灾难性遗忘”。团队用上了LoRA(低秩适应)技术:就像给资深画家配个只会看动态的助理,画家的核心本事不动,只让助理学“人跳起来时裙摆该往哪摆”。具体来说,就是冻结静态模型的上亿个核心参数,只给它加几万个专门学动态的小参数,既学会了布料动态,又没丢了静态重建的本事。

实验数据最能说明问题:用LoRA微调的模型,能完美保留照片上衣服的花纹细节,而全参数微调的模型,已经把花纹糊成了一片。

光靠静态知识加LoRA还不够——传统AI学动态时,只会看“渲染出来的颜色对不对”,经常把“颜色偏暗”和“布料位置错了”搞混,结果要么裙摆动幅太小,要么边缘糊成一团。

DynaAvatar的第二个杀招是DynaFlow光流损失:它直接跳过颜色,只盯着布料的位置。团队让模型额外渲染一张“坐标图”——每个像素的颜色不是RGB,而是这个点对应的3D坐标在屏幕上的位置。然后用光流技术,把模型渲染图和真实视频里的像素一一对应,直接告诉模型:“你这个裙摆的3D点,应该移到屏幕的X,Y位置”。

这相当于给AI发了个不带歧义的指令:别管颜色,先把位置挪对。对比实验显示,没加DynaFlow的模型,处理跳跃动作时裙摆动不起来,边缘还和腿粘在一起;加了之后,裙摆能扬到合理高度,边缘清晰得能看到褶皱。

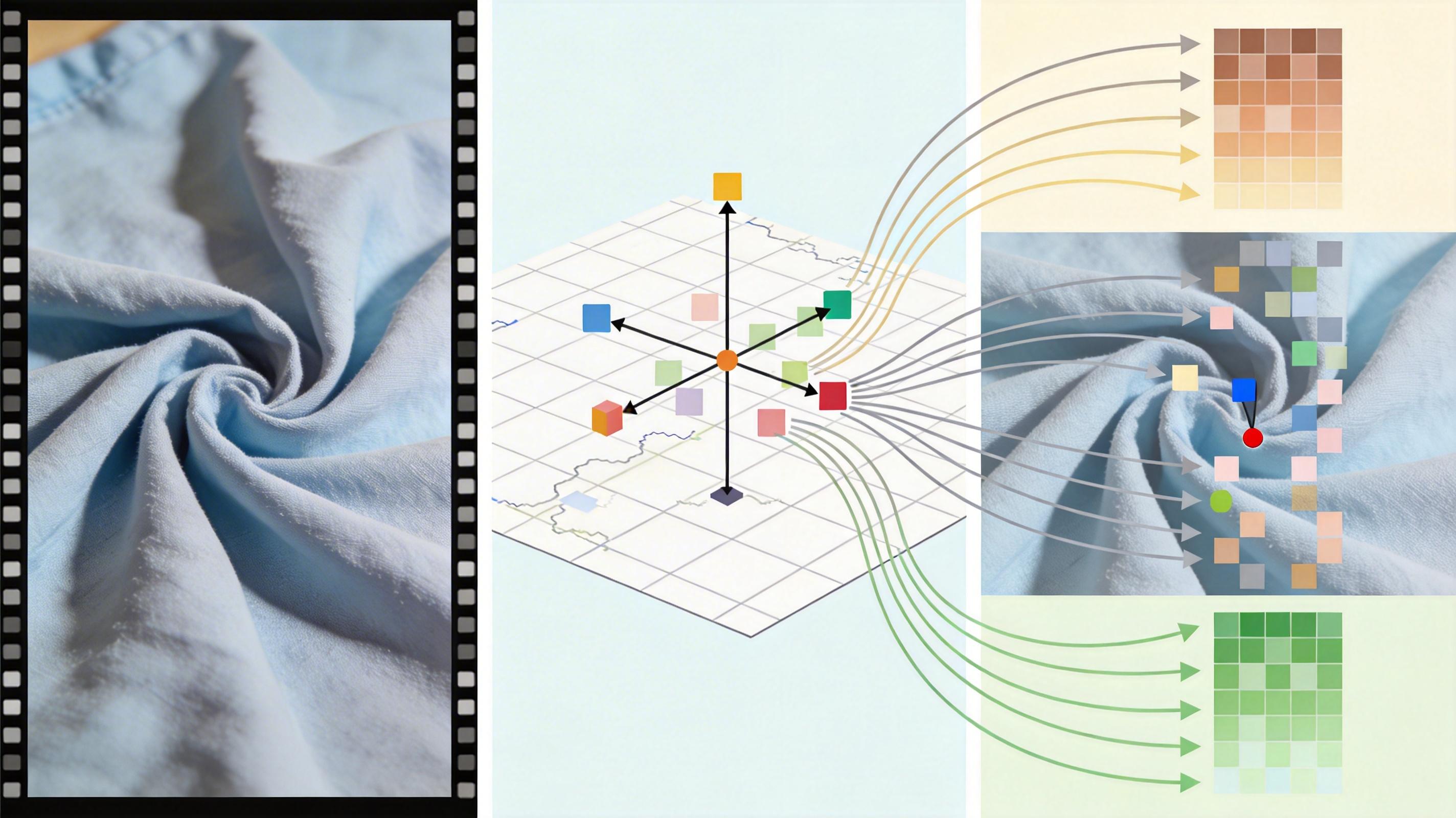

再好的算法,也架不住训练数据“有毒”。之前的动态人体数据集,标注的人体姿态要么歪歪扭扭,要么帧与帧之间抖得厉害——就像给厨师的肉全是坏的,再厉害也炒不出好菜。

DynaAvatar团队干脆自己动手,给两个主流动态数据集做了“大扫除”:用先进的2D姿态估计模型先把每帧的人体关键点标准,再用多视角信息把3D姿态调准,最后用滤波把帧间抖动抹平。前后花了几个月,重标注了1100万帧数据。

这份干净的“食材”立了大功:模型训练时不会再被错误的姿态带偏,学出来的布料动态终于和动作严丝合缝——人往前跑,外套会往后扬;人往下落,裙摆会往上飘,哪怕两个动作的最终姿态差不多,动态也完全不一样。

和物理模拟比,DynaAvatar不用精准的3D网格和姿态,单张模糊照片也能出效果;和视频扩散模型比,它生成的是真3D资产,能360度随便转视角,还能放进游戏引擎里互动。当然它也有局限:遇到透明纱裙、剧烈翻滚这类训练数据里少见的情况,布料动态还是会失真,而且核心的重标注数据没开源,其他团队复现起来难如登天。

但不可否认,它把“单图生成会动的3D人”从科幻拉到了现实。一张照片,就是一个会动的数字演员——未来游戏里的NPC、元宇宙里的虚拟分身、影视里的替身,可能真的只要一张照片就能搞定。