对抗知识焦虑,从看懂这条开始

App 下载

AI几何题总出错?原来它连图都没看懂

图像理解|清华大学|光明实验室|几何题解题|视觉语言模型|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

图像理解|清华大学|光明实验室|几何题解题|视觉语言模型|多模态视觉|人工智能

你可能见过AI解出大学微积分,生成逼真的城市夜景,甚至能写一篇逻辑通顺的科幻小说——但你绝对想不到,它会在一道初中几何题上栽跟头。不是算错了角度,也不是推错了定理,而是它根本没“看”对图:把两条相交线看成平行,漏了图里的一个关键交点,甚至凭空“脑补”出一条不存在的辅助线。

2026年3月,光明实验室与清华大学的联合研究戳破了这个假象:当前视觉语言模型在几何任务上的失败,80%以上不是因为推理能力不足,而是卡在了最基础的“看”的环节。这就像一个数学天才,拿到题却把题目里的“三角形”看成了“圆形”,再厉害的逻辑也没用。为什么AI会犯这种低级错误?我们到底该怎么让它“看懂”几何?

过去我们评测AI的几何能力,就像老师改试卷:只看最后答案对不对,对了给分,错了扣分。但没人去深究,它是“算错了”还是“看错了”——这就导致AI的感知缺陷被掩盖在“推理错误”的笼统结论里。

为了把问题拆穿,研究团队做了一件前所未有的事:他们打造了一个叫GEOPERCEIVE的评测框架,专门盯着AI“看”的能力,而不是“答”的结果。

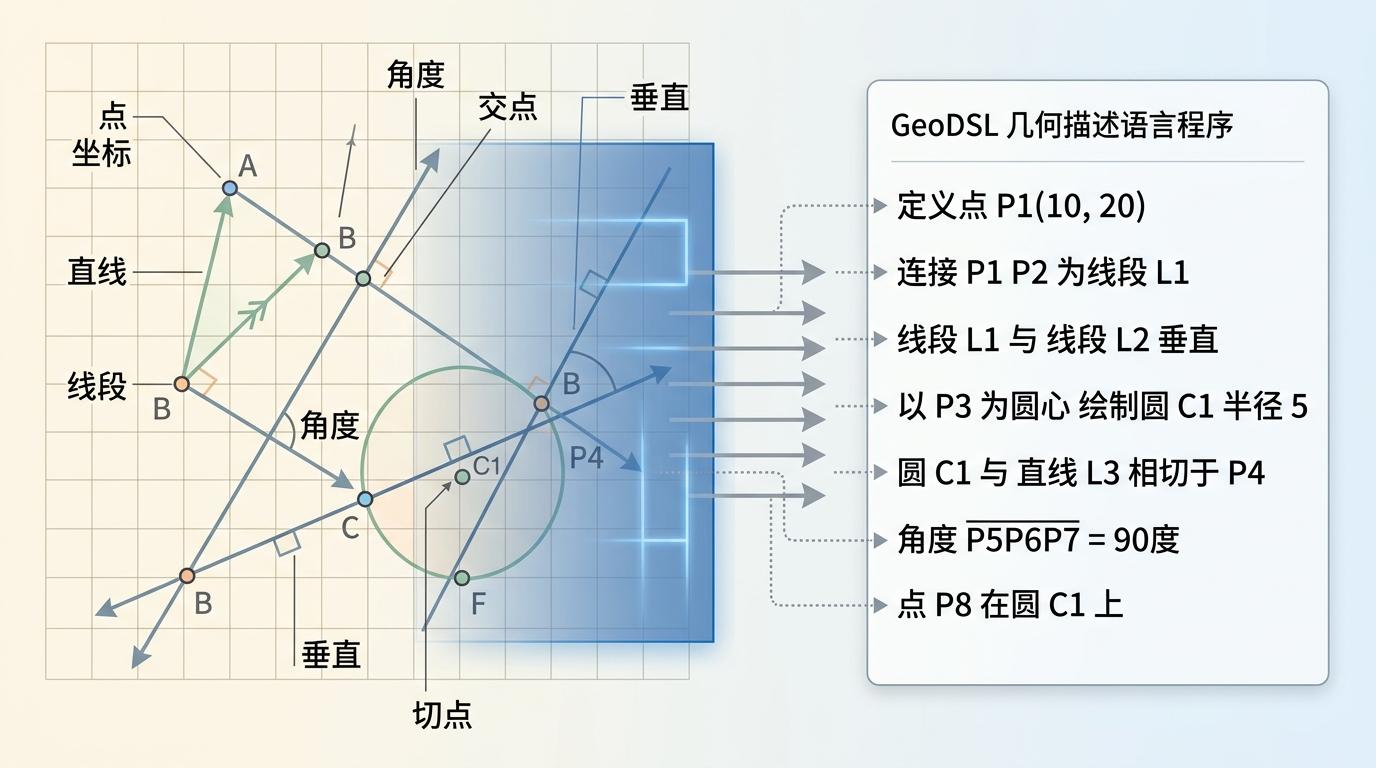

你可以把它想象成一场特殊的考试:不给AI出需要计算的几何题,只让它描述图里有什么——有几个点?哪几条线是垂直的?有没有圆和直线相切?为了让描述绝对精准,他们还设计了一套几何专用语言GeoDSL,就像用代码画图,每一个点、每一条关系都对应唯一的程序语句,没有任何歧义。

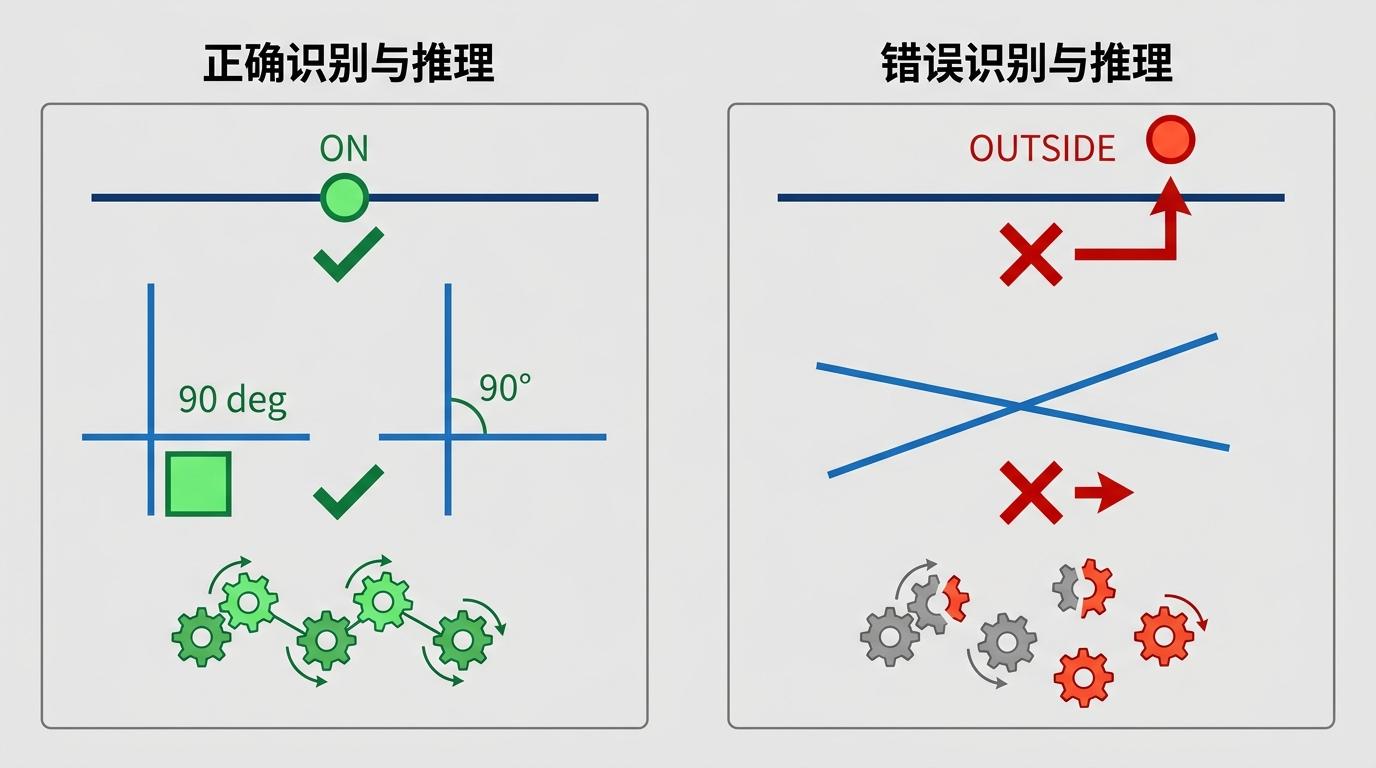

评测结果让人大吃一惊:就算是当前最顶尖的视觉语言模型,也会在30%以上的基础元素识别上出错,更别说那些需要精准判断的结构关系了。比如把“点在线上”看成“点在线外”,把“垂直”看成“相交”,这些错误全部发生在推理之前,直接把后续逻辑链连根拔起。

既然找到了病根,怎么给AI“矫正视力”?直接让AI学GeoDSL编程?不行,这样会破坏它原本的自然语言表达能力——我们需要的是能看懂图、又能用人类语言回答问题的AI,不是只会写代码的机器。

研究团队提出了一个巧妙的解决方案:GEODPO结构化强化学习。简单来说,就是让AI继续用自然语言描述图形,但在背后加一个“翻译官”和“评分员”:

这个方法的妙处在于,它完全不改变AI的输出方式,却能把模糊的“描述好坏”变成可计算的“结构精准度”。实验数据显示,用GEODPO训练后,主流视觉语言模型的几何感知能力在熟悉场景里提升了26.5%,在陌生的复杂图形上也提升了8%,就连最让人头疼的“脑补不存在的结构”问题,也减少了近40%。

更关键的是,当AI“看对”的能力提升后,它的几何推理能力直接跟着涨了39%——原来很多时候,它不是不会推理,只是推理的前提就错了。

你可能会问:不就是让AI看懂几何图吗,至于这么大张旗鼓?

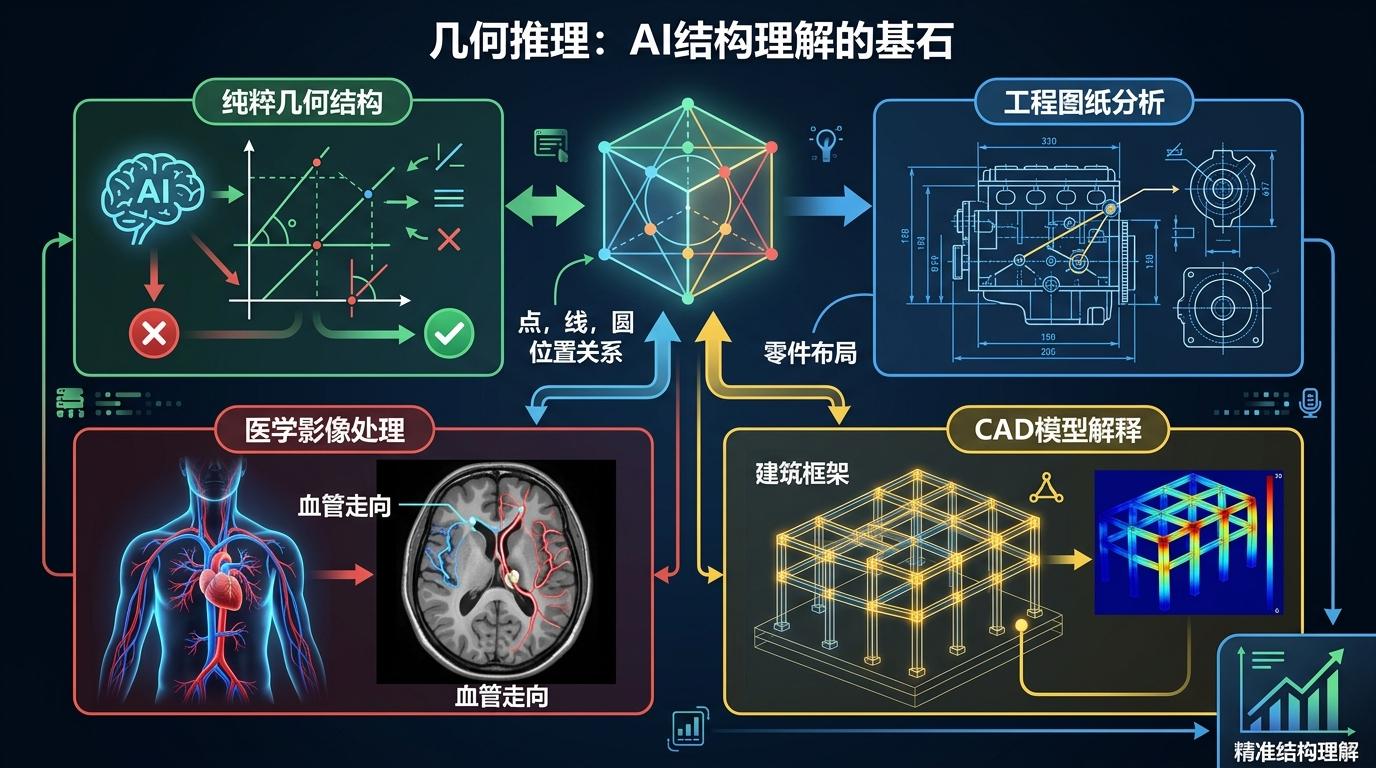

其实这背后,是AI从“匹配模式”到“理解结构”的关键一步。过去的AI更像一个超级记忆大师,靠记住海量数据里的模式来回答问题,但它从来没真正“理解”过事物的结构——就像你能认出猫,但不知道猫的眼睛、鼻子、爪子是怎么组合成一只猫的。

几何是最纯粹的结构问题,点、线、圆的位置关系,本质上就是世界上所有结构的简化版。如果AI能看懂几何图里的结构,那它就能看懂工程图纸里的零件布局,看懂医学影像里的血管走向,看懂CAD模型里的建筑框架——这些都是需要精准结构理解的专业领域,过去AI在这里一直表现拉胯。

当然,现在的GEODPO还只是个开始。它目前只能处理静态的平面几何,面对动态的三维结构、复杂的自然场景,还有很长的路要走。而且它的“翻译官”偶尔也会出错,把正确的描述翻译成错误的代码,导致评分不准。但不管怎样,这是第一次有人把AI的“感知缺陷”单独拎出来,用结构化的方法去解决——这就像给AI做了一次视力检查,终于知道它近视多少度,该配什么样的眼镜了。

当我们惊叹AI能写诗、能画画、能解复杂方程时,却忽略了它连最基础的“看”都没做好。这就像一个学富五车的学者,却连汉字的基本笔画都认不全——听起来荒谬,却是当前AI的真实写照。

GEOPERCEIVE和GEODPO的意义,不止是让AI能做对几何题,更是给我们指了一条新的路:要让AI真正理解世界,先得让它真正“看见”世界的结构。

感知准了,推理才有用。 这句话不仅适用于AI的几何题,也适用于所有人工智能的未来——毕竟,所有的智能,都始于“看见”。