对抗知识焦虑,从看懂这条开始

App 下载

AI不盯错题,开始读学生的脑内模型

知识表征|错题分析|物理受力分析|学生脑内模型|认知决策|AI产业应用|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

知识表征|错题分析|物理受力分析|学生脑内模型|认知决策|AI产业应用|心理认知|人工智能

两个学生在同一道物理受力分析题上栽了跟头。传统错题系统会给他们贴上一模一样的标签:「受力分析能力不足」。但真相是,学生甲脑子里的「力」根本不是课本上的箭头,而是「推」「拉」这种看得见的动作——所以他完全忘了画无形的重力;学生乙能画出力的箭头,却从没想过「桌子托着书本」也算一种力——在他的日常认知里,「支持」和「力」根本不沾边。同样的错题,藏着完全不同的脑内迷宫。而AI,终于能摸到迷宫的入口了。

过去的错题分析,本质上是在给教材的知识点打勾。「你不会勾股定理」「你审题错了」——这些结论指向的是课本目录和解题流程,不是坐在课桌前的那个学生。就像医生只告诉你「你发烧了」,却没说你是感冒、流感还是肺炎,听起来专业,却解决不了根本问题。

AI时代的错因分析,要找的是「首次分歧点」——学生看到题目第一眼,脑子里冒出来的第一个念头。那个念头就是脑内模型的雏形,它歪了,后面的所有步骤都会跟着歪。这不是靠拆解解题流程能做到的,得靠AI钻进学生的思维路径里,像侦探一样倒推「他是在哪一步开始想错的」。

比如Squirrel AI的系统,会盯着学生的解题草稿不放——那些涂涂改改的步骤、划掉的公式、写错又擦掉的数字,都是思维的脚印。AI能从这些脚印里定位到「第一次偏离正确路径的瞬间」,是把「支持力」当成了「帮忙」,还是把「惯性」当成了「需要持续推的动力」。

找到错因只是第一步,真正难的是怎么让学生自己修正脑内的模型。AI的做法不是直接说「你错了,应该这样」,而是制造「认知冲击」——用反例或者微调过的题目,让学生自己发现逻辑矛盾。

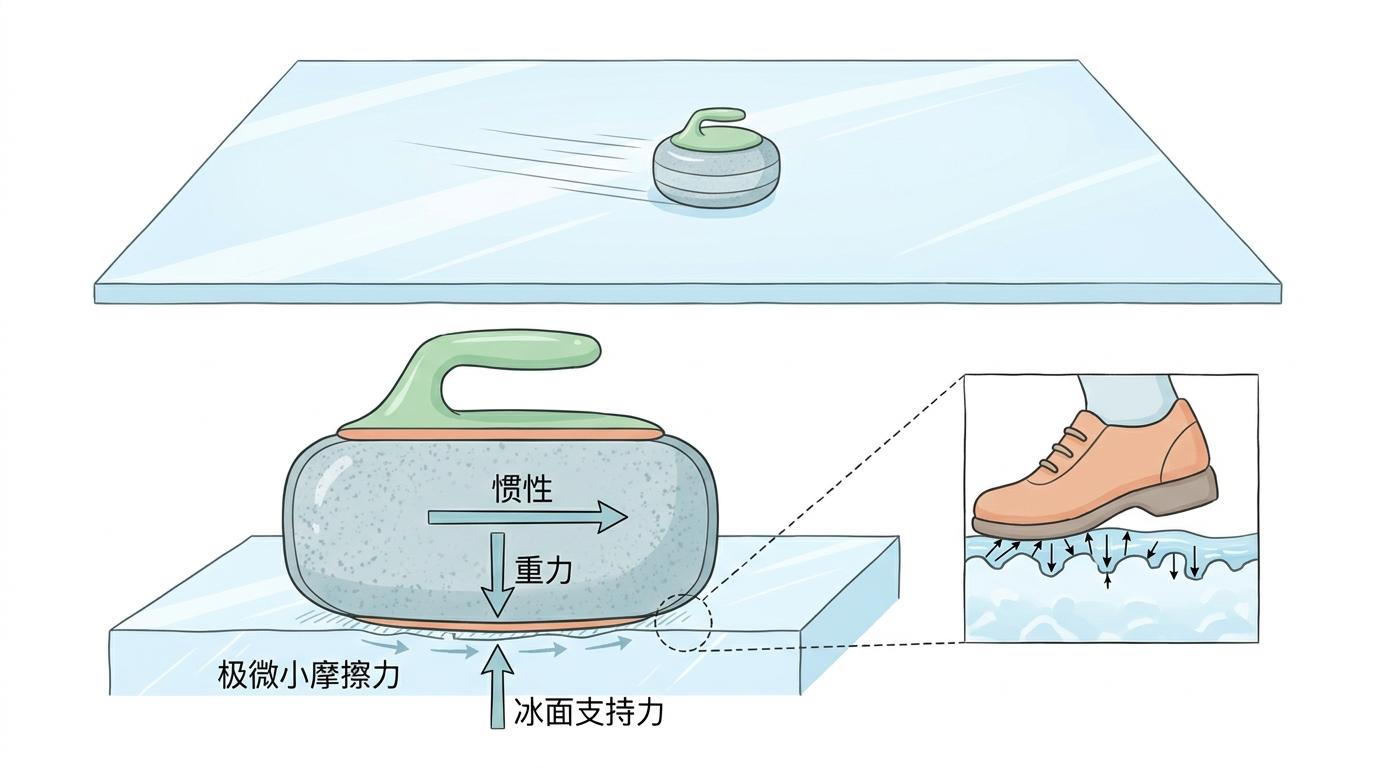

比如学生坚持「运动的物体一定受力」,AI不会直接反驳,而是给他出一道题:「在光滑冰面上滑行的冰壶,为什么能一直滑下去?」当学生按照自己的逻辑得出「冰壶一直受推力」,却发现找不到施力物体时,他的脑内模型就会开始动摇。这种自我发现的过程,比任何直接纠错都管用。

但AI的介入必须极度克制。它不会在学生第一次错题时就跳出来,而是在后台默默记录——当它发现学生在第三、第七、第十二题里,犯的都是同一个脑内模型错误时,才会出手。毕竟,学生需要自己试错的空间,过度干预只会让他们依赖AI,失去自主思考的能力。

AI错因分析的最大挑战,是怎么在刷题效率和深度诊断之间找到平衡。学生每天要做几十道题,要是每道错题都让AI追着问「你当时怎么想的」,没人能受得了。

现在的解法是「分层处理」:简单的错题,让学生自己看答案订正;AI只盯着那些「重复出现的脑内模型错误」。同时,AI会把常见的错误整理成「错误池」,遇到类似的情况直接调用现成的分析,不用每次都重新推理——这就像医生遇到常见病例,不用每次都从头诊断。

但这种平衡依然脆弱。AI能识别大部分逻辑错误,却很难捕捉那些模糊的、跨学科的认知偏差;它能分析解题步骤,却读不懂学生做题时的焦虑和犹豫。这些情绪信号,往往是脑内模型出错的前兆,而这部分,依然得靠教师的观察和判断。AI再厉害,也只是辅助工具,没法取代人和人之间的理解。

当AI开始读学生的脑内模型,教育的核心正在从「教知识」转向「教思维」。我们终于不用再把学生当成装知识的容器,而是开始关注他们怎么构建知识、怎么修正错误、怎么形成自己的思考方式。

但这也带来了新的问题:当AI能精准地找出每个学生的思维漏洞,传统的统一考试还有意义吗?当个性化的认知干预成为可能,我们的教育体系能跟上这种变化吗?

看见思维,才是教育的开始。 未来的教育,会是AI的精准诊断和教师的人文关怀交织的产物——AI帮我们找到迷宫的入口,而教师,会陪着学生一起走出去。