对抗知识焦虑,从看懂这条开始

App 下载

AI问诊六成不及格,女性健康暴露数字鸿沟?

数字鸿沟|AI健康助手|女性健康问诊|Victoria-Elisabeth Gruber|Lumos AI公司|生殖围产医学|大语言模型|医学健康|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

数字鸿沟|AI健康助手|女性健康问诊|Victoria-Elisabeth Gruber|Lumos AI公司|生殖围产医学|大语言模型|医学健康|人工智能

深夜,轻微的腹痛与头晕袭来,许多女性的第一反应不再是翻找药箱,而是拿起手机,向那个24小时在线、无所不知的AI健康助手寻求答案。这本是科技进步带来的便捷,然而,一份于2025年底发布的震撼报告,却为这个场景蒙上了一层阴影,揭示出人工智能在守护女性健康时,可能正扮演着一个专业不足且带有偏见的“数字医生”。

这场“大考”由Lumos AI公司的研究员Victoria-Elisabeth Gruber及其团队主导。他们向包括OpenAI、Google、Anthropic在内的13个主流大型语言模型提出了345个关于女性健康的专业问题,涵盖妇科、急诊、神经科等多个领域。结果令人震惊:高达60%的AI回答被17位来自欧美一线的女性健康专家、临床医生和药剂师判定为“不足以作为医疗建议”。

即便是表现最好的GPT-5,其失败率也达到了47%;而Mistral 8B的失败率更是高达73%。Gruber坦言,她和同事们注意到越来越多女性朋友依赖AI进行健康决策,这促使她们构建了首个该领域的评测基准。“我们预料到会有差距,但模型的巨大差异和普遍的失败率仍让我们感到惊讶。”她说。这项研究如同一声警钟,敲响了AI医疗在女性健康领域潜藏的系统性风险。

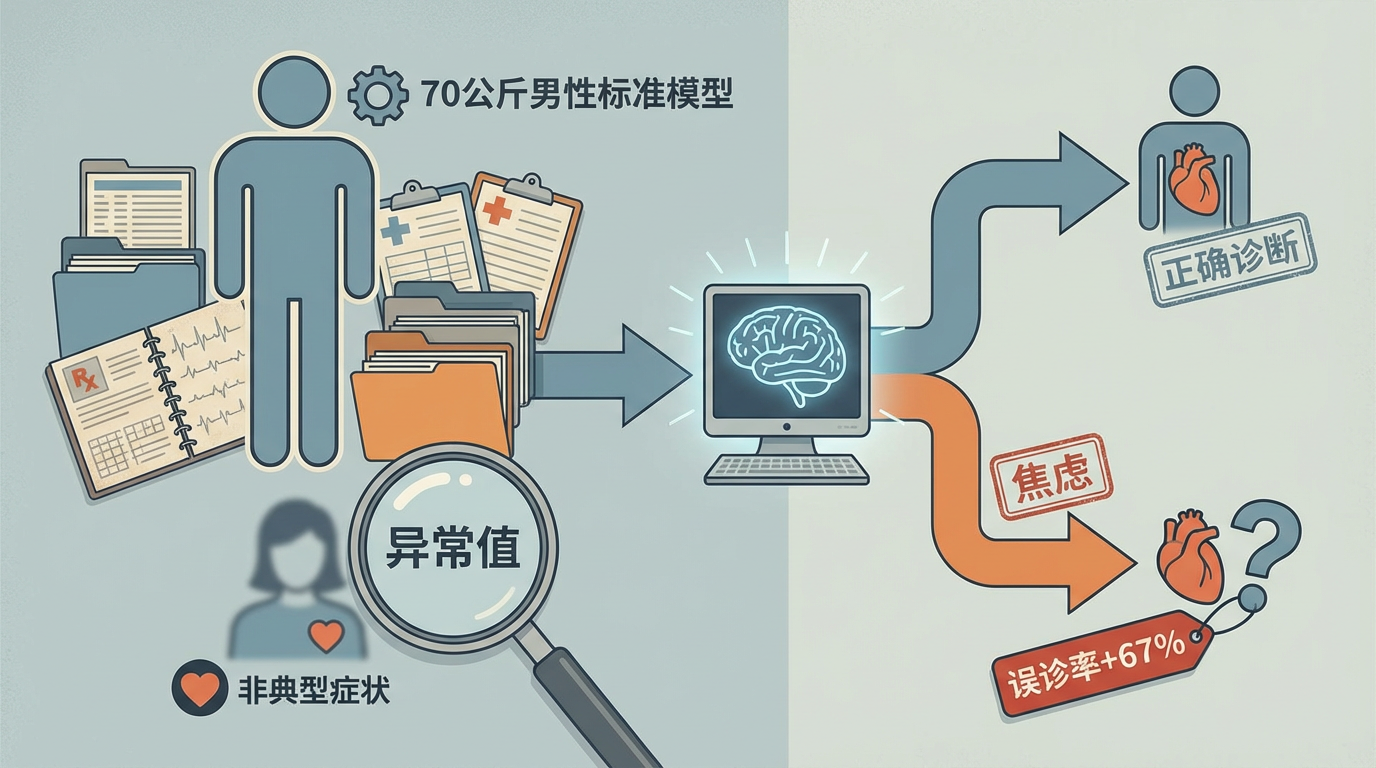

AI为何会在女性健康问题上频频“翻车”?答案深藏于代码和数据构成的“算法深渊”之中。AI的智能并非凭空产生,而是源于对海量人类历史数据的学习。然而,这些数据本身就刻印着长久以来的性别偏见。

算法设计的“无心之失”:在模型设计中,开发者可能会无意识地将月经周期等复杂变量视为“噪声”进行过滤,以追求模型的简洁高效。这种简化却可能导致对子宫内膜异位症等与周期密切相关的疾病诊断延迟。数据显示,AI对该病的诊断延迟平均长达8.4年,远超临床医生。

族裔与文化的“数据荒漠”:偏见不仅存在于性别,也体现在族裔和文化上。佛罗里达大学的研究发现,由于训练数据以白人女性为主,AI诊断细菌性阴道炎(BV)时,对不同族裔女性的准确率存在显著差异。同样,由于历史产科研究多聚焦于欧洲裔人群,AI对非洲裔孕妇子痫前期风险的误判率竟高达41%。

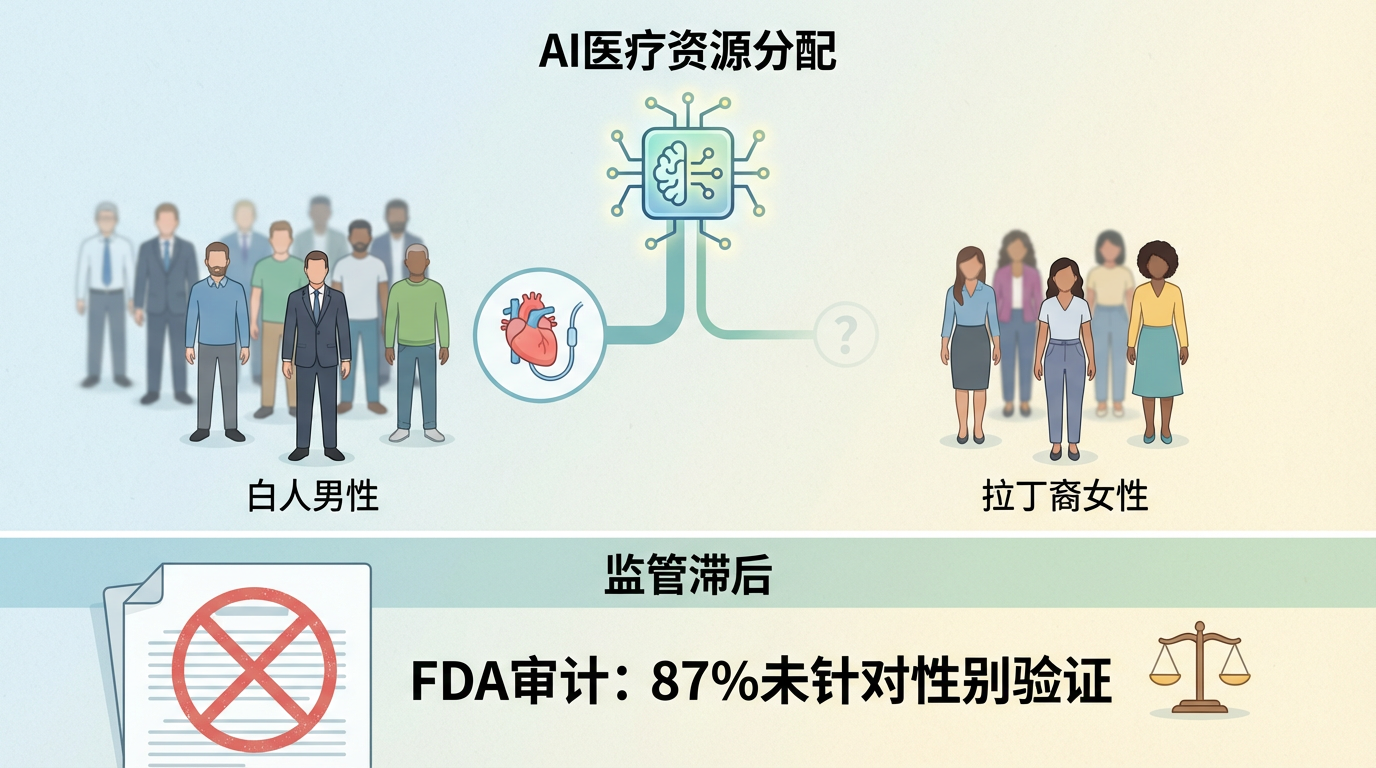

这些深植于算法的偏见,正转化为对女性健康权益的无声伤害,其影响远超一个错误的搜索结果。从诊断、治疗到资源分配,AI偏见正在加剧医疗领域的不平等。

误诊与漏诊成为常态。除了前述的心脏病和子宫内膜异位症,药物剂量的推荐系统也暴露了严重问题。基于男性标准开发的算法,使得女性患者出现药物不良反应的风险增加了34%。

健康差距被无形放大。当AI被用于医疗资源分配时,这种偏见可能导致弱势群体获得的服务质量进一步下降。哈佛医学院的实验显示,输入相同临床症状,AI推荐白人男性接受心脏导管检查的概率是拉丁裔女性的2.3倍,尽管后者实际患病风险可能更高。这一切的背后,是监管的严重滞后——美国食品药品监督管理局(FDA)的审计报告指出,高达87%的医疗AI从未针对性别差异进行过独立验证。

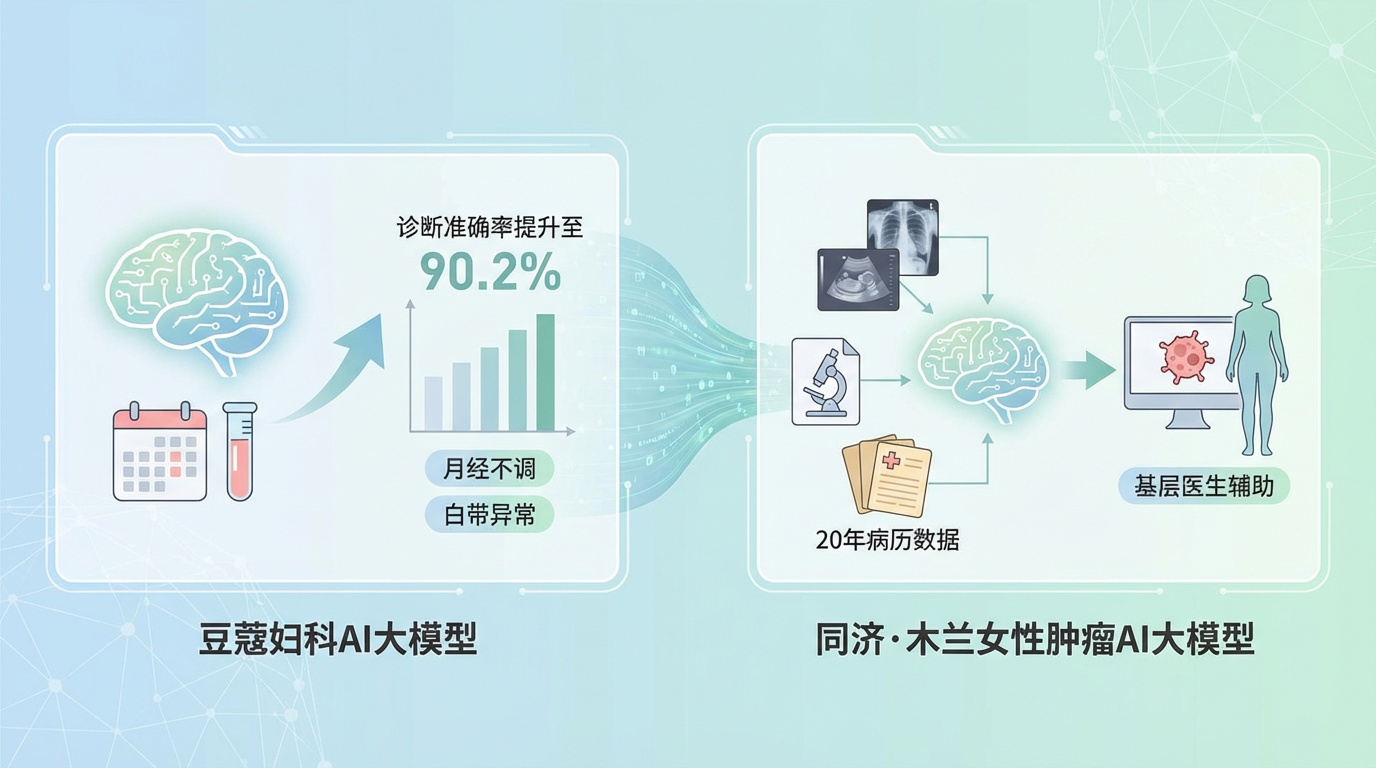

面对通用大模型的“集体失利”,行业并未坐以待毙。一条清晰的“自我救赎”之路正在浮现:从无所不包的通用模型,走向深耕垂直领域的专业模型。

在中国,这一趋势尤为明显。例如,“豆蔻妇科大模型”通过在钉钉企业专属AI平台上进行行业数据深度训练,将月经不调、白带异常等六大妇科症状的诊断准确率从77.1%一举提升至90.2%。同样,由华中科技大学同济医学院附属同济医院研发的“同济·木兰”女性肿瘤AI大模型,融合了近20年的高质量病历与多模态数据(影像、病理),成为国际上首个符合中国人群特点的女性肿瘤模型,为基层医生提供了强大的辅助。

这些专科模型的成功,证明了高质量、多样化且具有代表性的数据,结合精细化的算法调优,是弥补AI专业短板、消除偏见的关键。它们不再是“什么都懂一点”的通才,而是“精通某一领域”的专家。

技术的自我革新固然重要,但构建一个真正公平、可信的AI医疗生态,需要更多维度的协同努力。

完善的伦理与监管:全球监管机构正在觉醒。美国FDA已开始推动“算法多样性认证”,要求AI模型在不同人口统计亚组中表现均等。法律界也开始探讨如何追溯算法歧视的责任,确保技术向善的底线。

跨学科的人才培养:斯坦福大学等顶尖学府开设的“包容性AI医学”等专业,正致力于培养能同时理解代码、临床与社会伦理的复合型人才。只有让开发团队本身具备多样性,才能从源头识别并消除偏见。

患者的赋能与参与:提升公众,尤其是弱势群体的数字健康素养,让他们了解AI的局限性,并鼓励他们参与到AI工具的监督与反馈中,是确保技术不脱离现实需求的基石。

回到最初的场景,那位深夜求助AI的女性,她需要的不是一个冰冷、刻板甚至可能错误的答案,而是一个能理解她独特处境、给予专业且有温度指引的伙伴。当前AI医疗问答在女性健康领域的“不及格”报告,并非宣判了这项技术的“死刑”,而是一次至关重要的提醒。

它告诉我们,通往真正的智慧医疗,技术突破与人文关怀必须并驾齐驱。修复代码中的偏见,填补数据中的鸿沟,最终是为了让科技回归其本质——服务于每一个具体的人,无论性别、种族与背景。这条路任重道远,但唯有如此,人工智能才能真正成为守护人类健康的可靠力量,而非加剧不平等的又一推手。