对抗知识焦虑,从看懂这条开始

App 下载

99%准确率的AI,100步后只剩37%靠谱

长链路任务|API开放生态|GUI自动化|精度陷阱|企业级AI Agent|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

长链路任务|API开放生态|GUI自动化|精度陷阱|企业级AI Agent|AI智能体|人工智能

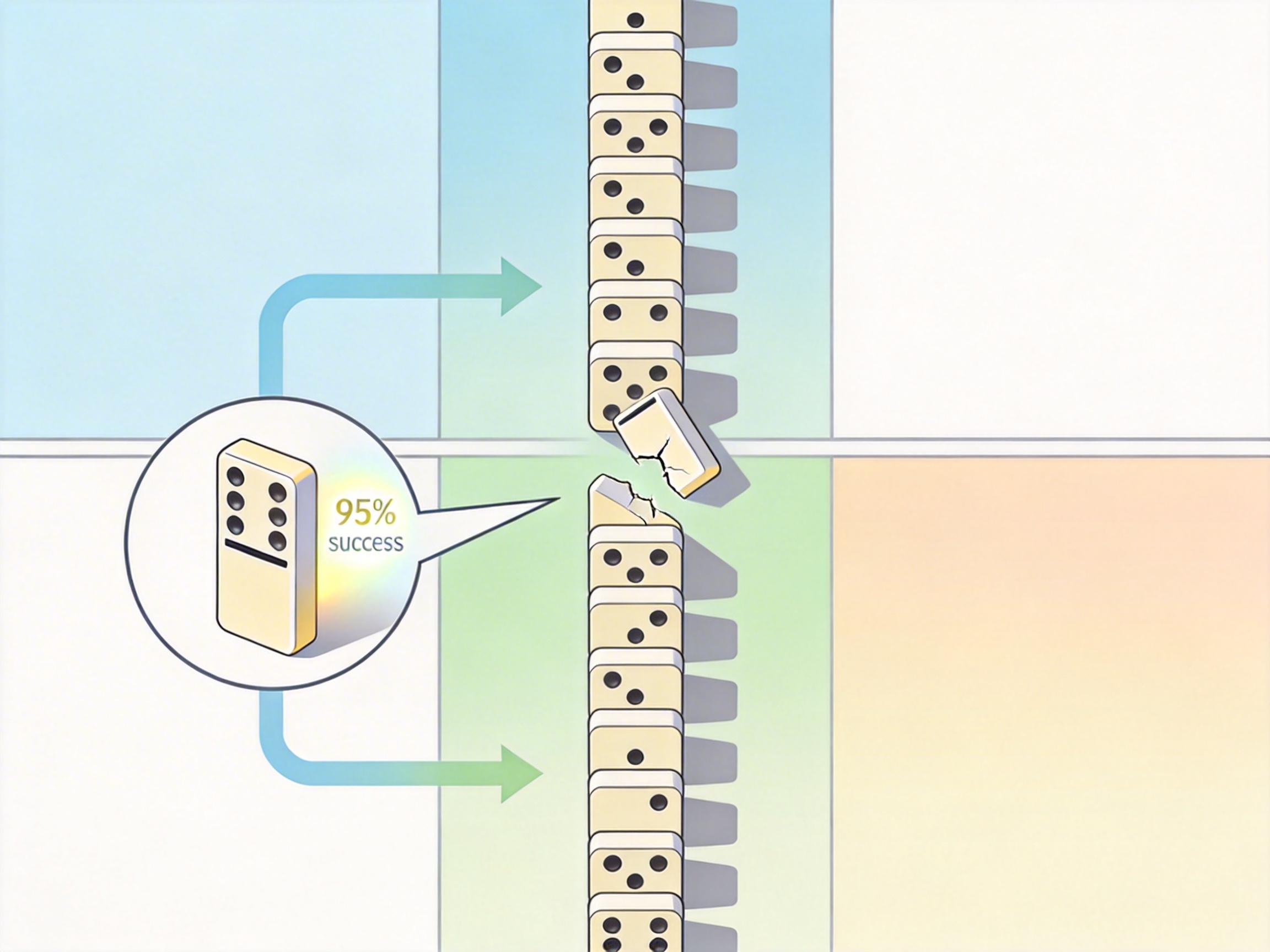

你有没有见过这种“完美陷阱”:一项任务拆成100步,每一步AI的准确率都高达99%,看起来万无一失——但走完整个流程,最终能成功的概率居然只有37%?这不是数学题,而是企业级AI Agent(能自主完成任务的智能体)正在遭遇的致命困境。

2025年底,一位深耕智能体领域五年的创业者在行业大会上戳破了这个真相:单步准确率的漂亮数字,掩盖了长链路任务中误差指数级累积的“精度陷阱”。而在中国企业普遍缺乏API开放生态的环境里,这个陷阱还被GUI(图形用户界面)自动化的技术难度进一步放大。更棘手的是,哪怕是顶尖通用模型,在开放场景下的GUI自动化准确率也只有五六十分。出路到底在哪?

你可以把AI完成长链路任务想象成串起100个多米诺骨牌:每块骨牌倒下的概率是99%,看起来几乎不会出错,但只要有一块没倒下,整个链条就会断裂。按照概率计算,100个99%相乘,最终的成功率就是(0.99)^100≈37%——这就是“精度陷阱”的数学本质。

但真实的企业场景比这更残酷。首先,企业任务往往不是独立的100步,而是环环相扣的链条:前一步的输出是后一步的输入,一旦某一步出现偏差,后续所有步骤都会基于错误的前提推进,误差会像滚雪球一样越滚越大。其次,企业环境充满了不确定性:系统界面更新、数据格式变化、权限突然调整……这些“意外”都会让AI的单步准确率从99%直接跳水,甚至连五六十分都保不住。

更麻烦的是,很多企业的核心系统没有开放API接口,AI只能像人类一样通过点击鼠标、输入文字来操作GUI。这相当于让蒙着眼睛的人去走迷宫——哪怕它记得所有路线,也可能因为一个按钮位置的变化而彻底迷路。有团队测试发现,顶尖通用模型在GUI自动化任务中的准确率普遍只有50-60分,连及格线都达不到。

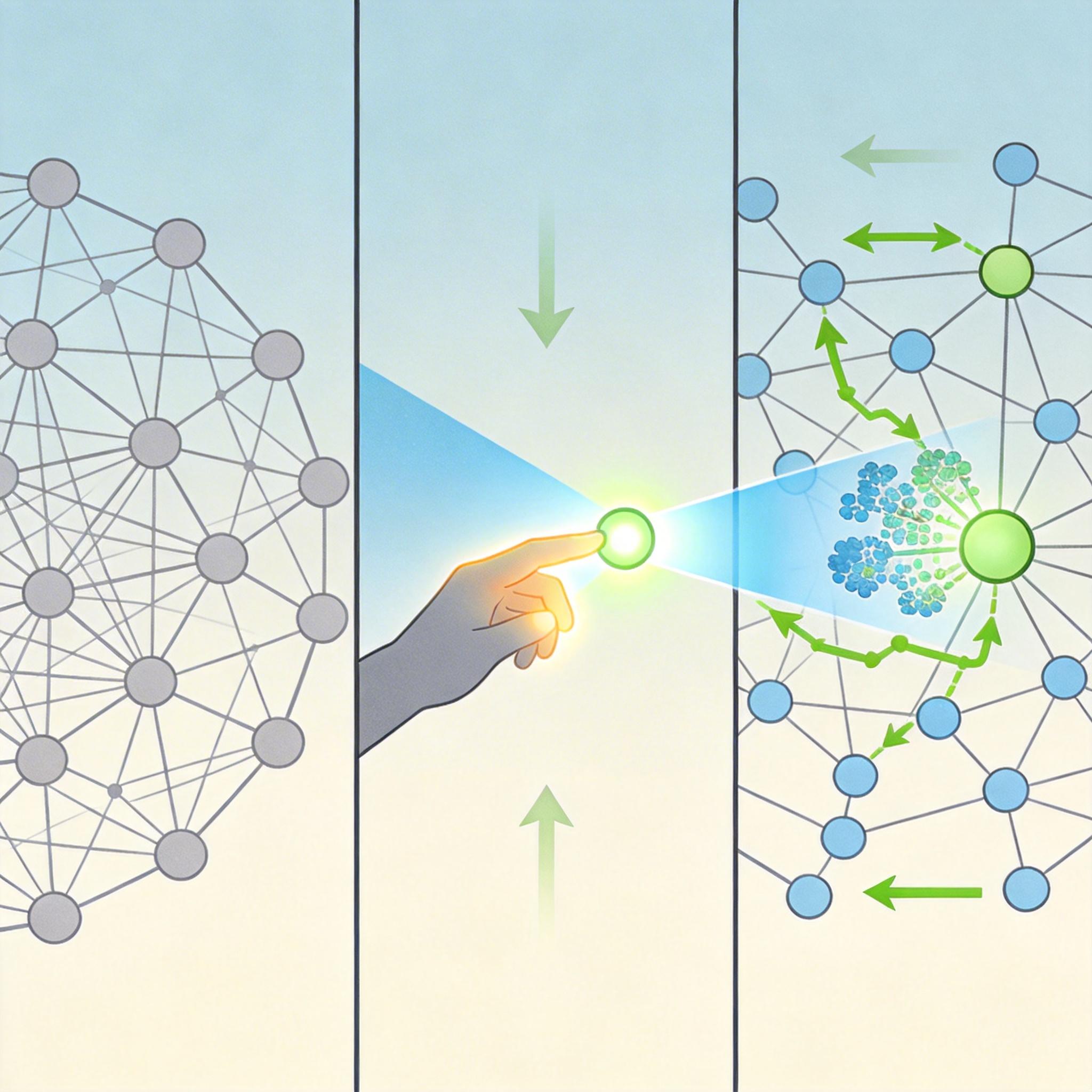

既然等模型进化解决不了问题,有人开始换个思路:不追求100%的自动化,而是把人类的判断嵌入AI的决策链条,构建“Human-in-the-Loop(人在回路)”的协同机制。

这不是简单的“AI干不了的活交给人”,而是重新设计人机分工:让AI去执行那些规则明确、重复性高的确定性任务,比如数据录入、报表生成;而人类则聚焦于目标定义、结果校验和异常处理这些需要经验判断的环节。比如在广告投放的数据分析中,AI可以自动处理上亿条数据,计算出不同投放策略的效果,但最终要不要调整预算、怎么调整,还是由人类分析师根据市场趋势和业务目标来决定。

更巧妙的是,有些团队借鉴了大模型的“注意力机制”,设计了全新的交互方式:人类可以通过“@指令”主动激活特定的AI组件,把自己的经验直接注入AI的规划路径。比如当AI在处理复杂的跨系统任务时,人类可以@负责数据校验的子智能体,让它重点检查某个关键指标,避免AI因为忽略细节而出错。

这种机制的核心是“互补”:用AI的速度和耐力解决重复劳动,用人的判断力和创造力把控方向,既避免了“精度陷阱”,又能充分发挥AI的价值。

人机协同的终极目标,不是用AI替代人类的某一项任务,而是重新定义整个岗位的价值。

过去我们总说“AI会取代人类工作”,但现实是,AI只能取代那些可以被标准化的“任务”,而人类的核心价值在于“定义目标、校验结果、审计逻辑”这些无法被标准化的“判断”。比如一个数据分析师,过去可能要花80%的时间整理数据、制作报表,现在这些工作可以交给AI,他只需要花20%的时间定义分析目标、审核AI的结果、解释数据背后的业务逻辑,就能创造出比之前更大的价值。

这本质上是一种“岗位重塑”:把原来的岗位拆成两部分,一部分是由AI负责的“数字岗位”,专注于执行确定性任务;另一部分是由人类负责的“超级岗位”,专注于决策和判断。比如在客服领域,AI可以处理90%的常规咨询,而人类客服只需要处理剩下10%的复杂问题和情绪安抚,既能提升效率,又能提高客户满意度。

当然,这种重塑也面临挑战:企业需要重新设计业务流程,员工需要提升自己的判断能力和协作能力,而不是简单地重复劳动。但从长远来看,这才是AI与人类协同的正确方向——不是谁取代谁,而是一起把事情做得更好。

当我们不再执着于“全自动”的幻想,反而能找到AI落地的现实路径。那些看起来完美的单步准确率,终究抵不过长链路任务中的误差累积;而人机协同的本质,也不是让AI变得更像人,而是让人变得更擅长做“人该做的事”。

AI补效率,人掌方向——这或许就是企业级智能体突破“精度陷阱”的终极答案。未来的职场,不再是人与AI的竞争,而是人与AI的协作:AI是人类的“手脚”,负责执行;人类是AI的“大脑”,负责决策。只有这样,我们才能真正把AI的价值转化为企业的竞争力,而不是停留在实验室的演示视频里。