对抗知识焦虑,从看懂这条开始

App 下载

1步顶100步,图像恢复终于不用二选一

U-Net|扩散模型|图像修复|IR-Flow|中科大团队|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

U-Net|扩散模型|图像修复|IR-Flow|中科大团队|多模态视觉|人工智能

你有没有过这种经历:手机拍的照片糊成一团,用AI修复要么快得像按了一键美颜——细节全磨没,要么慢得像老牛拉车——等半分钟才出一张能看的图。这不是AI偷懒,是图像恢复领域卡了几十年的死结:要速度就没细节,要细节就别想快。直到中科大的团队掏出了IR-Flow——一张256×256的模糊图,它用0.07秒就能修成高清版,比传统扩散模型快了100倍,还能把雨滴、噪点、雾气擦得干干净净,连头发丝都根根分明。这到底是怎么做到的?

过去几十年,图像恢复的江湖一直分裂成两派:一派是“闪电手”判别式模型,比如U-Net,看见坏图直接输出好图,一步到位但细节全是糊的——就像用美图秀秀磨皮磨到亲妈不认;另一派是“慢工匠”生成式模型,以扩散模型为代表,从纯噪声一步步逆向去噪,能还原出毛孔级的细节,但要跑几十上百步,一张图修完,咖啡都凉了。

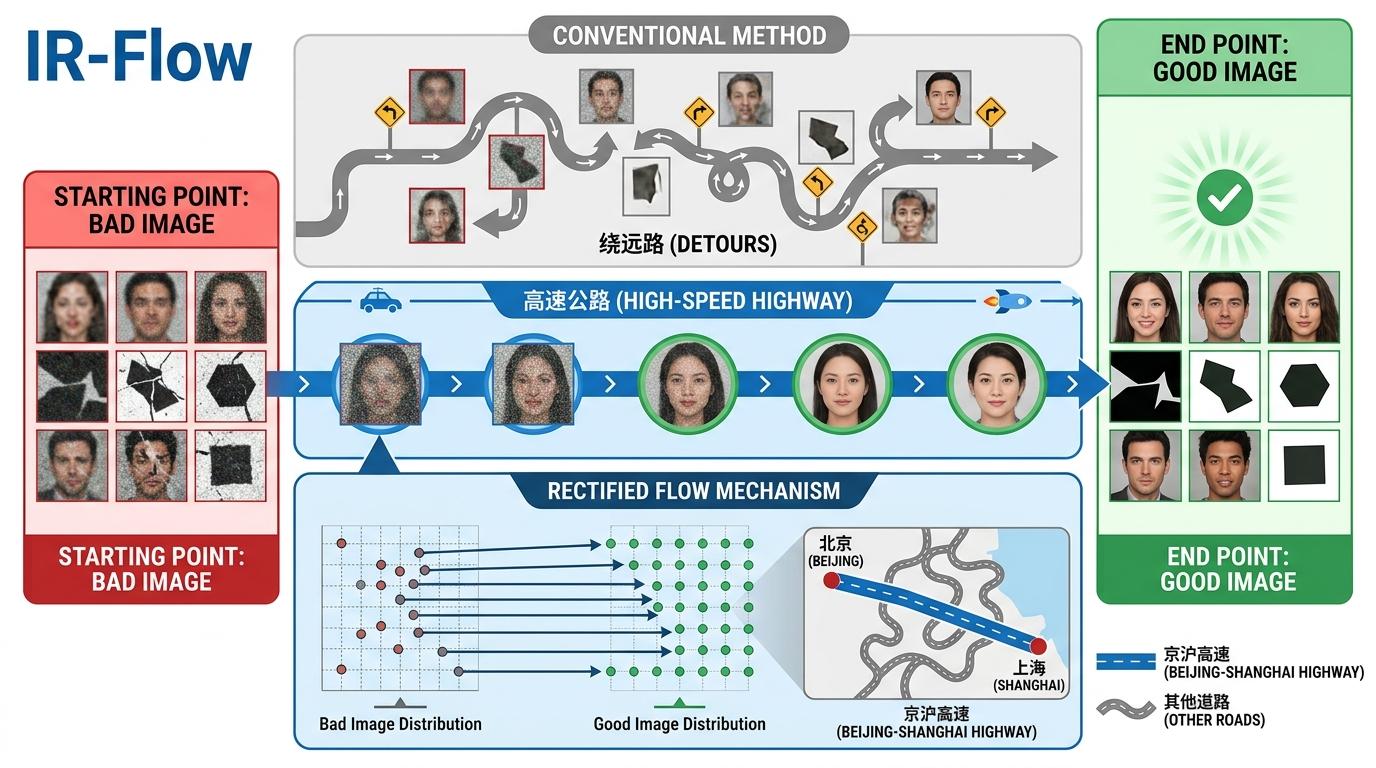

IR-Flow的思路简单到离谱:既然起点是坏图,终点是好图,为什么非要绕远路?直接在两者之间修一条“直线高速公路”不行吗?这个想法的核心是Rectified Flow(整流流)——一种能在两个数据分布间构建最短直线路径的流模型。就像你从北京到上海,不绕任何省道县道,全程走京沪高速,自然是最快的。

但光有直线还不够,得保证走直线时不跑偏。IR-Flow解决了两个关键问题:怎么让这条线足够直,怎么适应不同的“路况”——比如不同大小的雨滴、不同强度的噪声。

传统的流模型就像车载导航,每到一个路口就告诉你“下一步往哪走”,要是有一个路口指错了,最后可能开到广州去。IR-Flow换了个思路:它给模型装了个全局GPS,直接告诉模型“从你现在的位置,到终点上海的总方向是什么”——这就是累积速度场(CVF)。

你可以把它想象成:传统模型是“每100米偏东2度”,累积速度场是“上海在你东南方向1200公里”。前者的误差会一步步累积,后者只要大致朝着方向走,哪怕中间有点小偏差,也能及时调整回来。论文里用数学证明了,累积速度场的传输能量只有传统瞬时速度场的三分之一——就像同样是从北京到上海,走高速比走省道省油三分之二。

为了确保模型真的能走直线不跑偏,IR-Flow还加了个“多步一致性训练”:训练时让模型模拟走2步、4步、10步,看看最后能不能精准到终点。就像教练让运动员提前预演比赛路线,确保每一步都踩在点上。

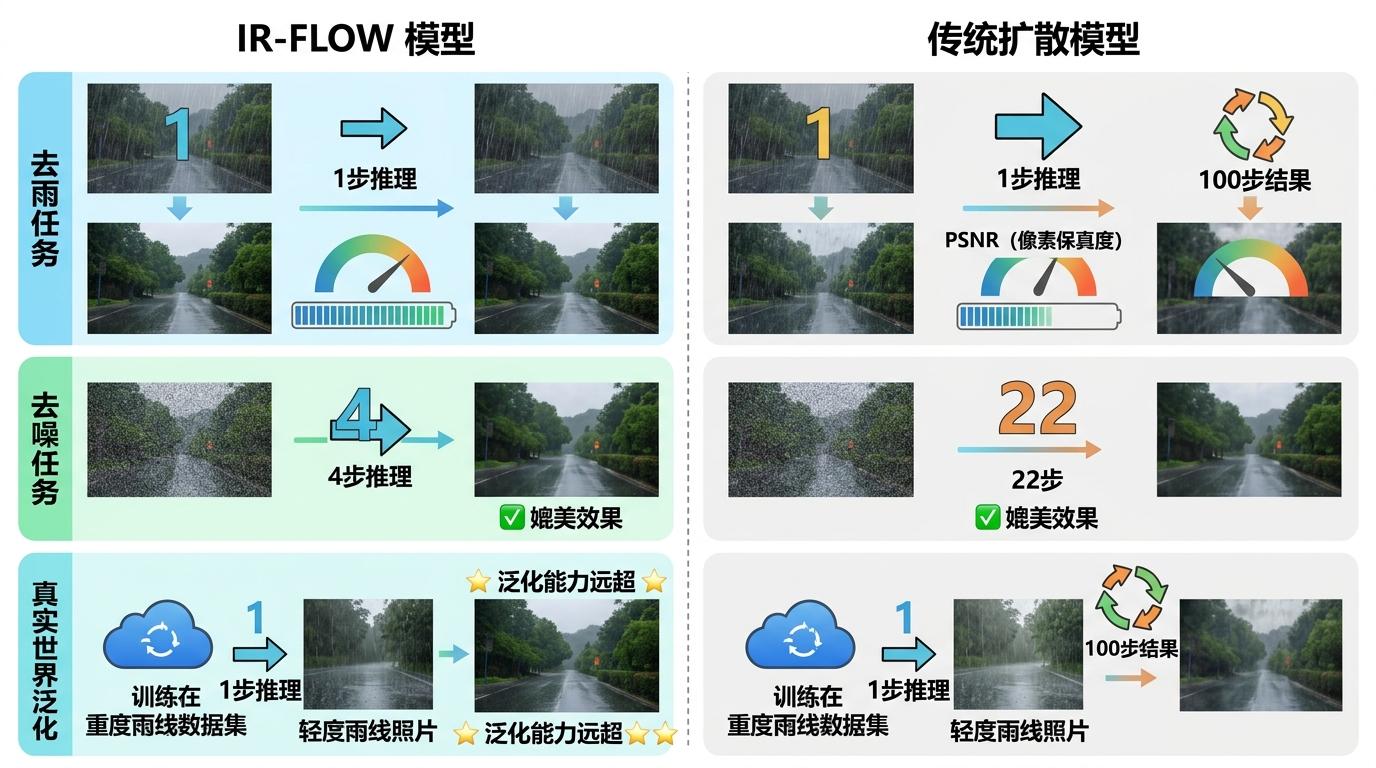

实验数据最能说明问题:在去雨任务中,IR-Flow用1步推理的PSNR(像素保真度指标)就超过了传统扩散模型100步的结果;在去噪任务中,4步推理的效果媲美22步的扩散模型;就连在真实世界的模糊照片上,它的泛化能力也远超同类模型——在重度雨线数据集上训练,直接拿轻度雨线的照片测试,1步推理的效果比100步的扩散模型还好。

更关键的是效率:同样的网络架构,IR-Flow推理一张256×256的图只要0.07秒,而传统扩散模型要7.41秒——快了100倍以上。这意味着那些以前只能在实验室里跑的高质量恢复模型,现在能在手机、监控摄像头、无人机上实时运行了。

当然,IR-Flow也不是完美的。它现在还依赖成对的干净-退化数据训练,要是能结合无监督学习,不用标注数据也能修图,应用场景会更广阔。而且面对混合退化——比如一张图同时有运动模糊、噪声和压缩伪影,这条“直线”还能不能走得通,还需要更多测试。

IR-Flow的意义,不止是让图像恢复快了100倍,更重要的是它给整个领域指了一条新的路:与其在复杂的噪声调度里“内卷”,不如回到问题的本质——图像恢复,不就是把坏图变成好图吗?用最简单的方法解决最核心的问题,往往最有效。

就像人类造汽车,不是为了让马车跑得更快,而是直接发明了轮子和发动机。IR-Flow就是这样的“轮子”——它用一条直线,打破了速度和质量的两难,让图像恢复从“二选一”变成“全都要”。未来,当你用手机拍的模糊照片秒变高清时,你可能不会想到,这背后是一群科学家用数学和代码,修了一条看不见的“直线高速公路”。

两点之间,直线最快——这是我们从小就懂的道理,直到今天,才被AI真正学会。