对抗知识焦虑,从看懂这条开始

App 下载

AI世界模型终于有了统一高考卷

统一动作词典|世界模型|清华大学团队|iWorld-Bench|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

统一动作词典|世界模型|清华大学团队|iWorld-Bench|大语言模型|人工智能

你可能刷到过各种号称“能模拟真实世界”的AI:有的能根据文字指令生成漫步街头的视频,有的能跟着键盘按键切换游戏视角,还有的能精准复刻相机的每一次转动。但这些AI到底谁真的懂“世界运行的逻辑”,谁只是在画漂亮的动画?此前没人能给出准话——就像让篮球、游泳、体操运动员同场比“运动能力”,规则都不一样,比了也是白比。直到清华大学团队拿出了iWorld-Bench,才第一次把所有AI世界模型拉到了同一个考场。

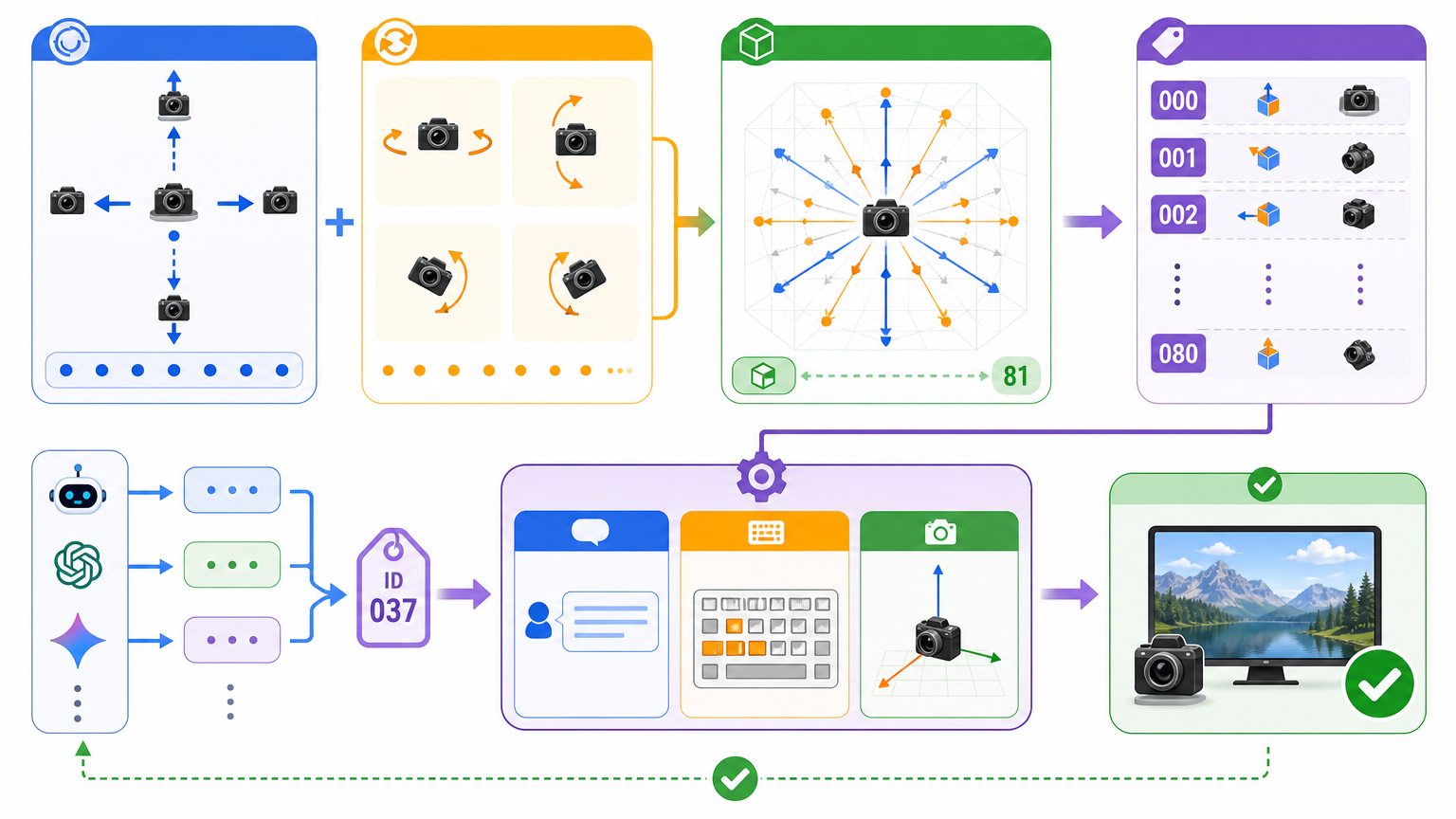

要让不同AI公平较量,首先得解决“语言不通”的问题:有的AI认文字“向前走”,有的认键盘“W”,还有的认专业的相机参数矩阵。iWorld-Bench的核心解法,是一套统一动作生成框架——相当于给所有AI编了一本通用词典。

它把所有交互动作拆解成平移和旋转两大类基础操作:平移分静止、前后左右上下7种,旋转分不同方向的偏转,两者组合出81种核心动作,每个动作对应唯一ID。然后通过一个映射字典,这个ID能同时转换成文字指令、键盘编码和相机参数——不管AI原本“说什么语言”,拿到这个ID,都能执行完全相同的动作任务。

就像把“前进”这个指令,同时翻译成中文、英文和机器代码,确保每个AI接收到的任务本质完全一致。这一下,之前各说各话的AI们,终于能在同一个规则下比高低了。

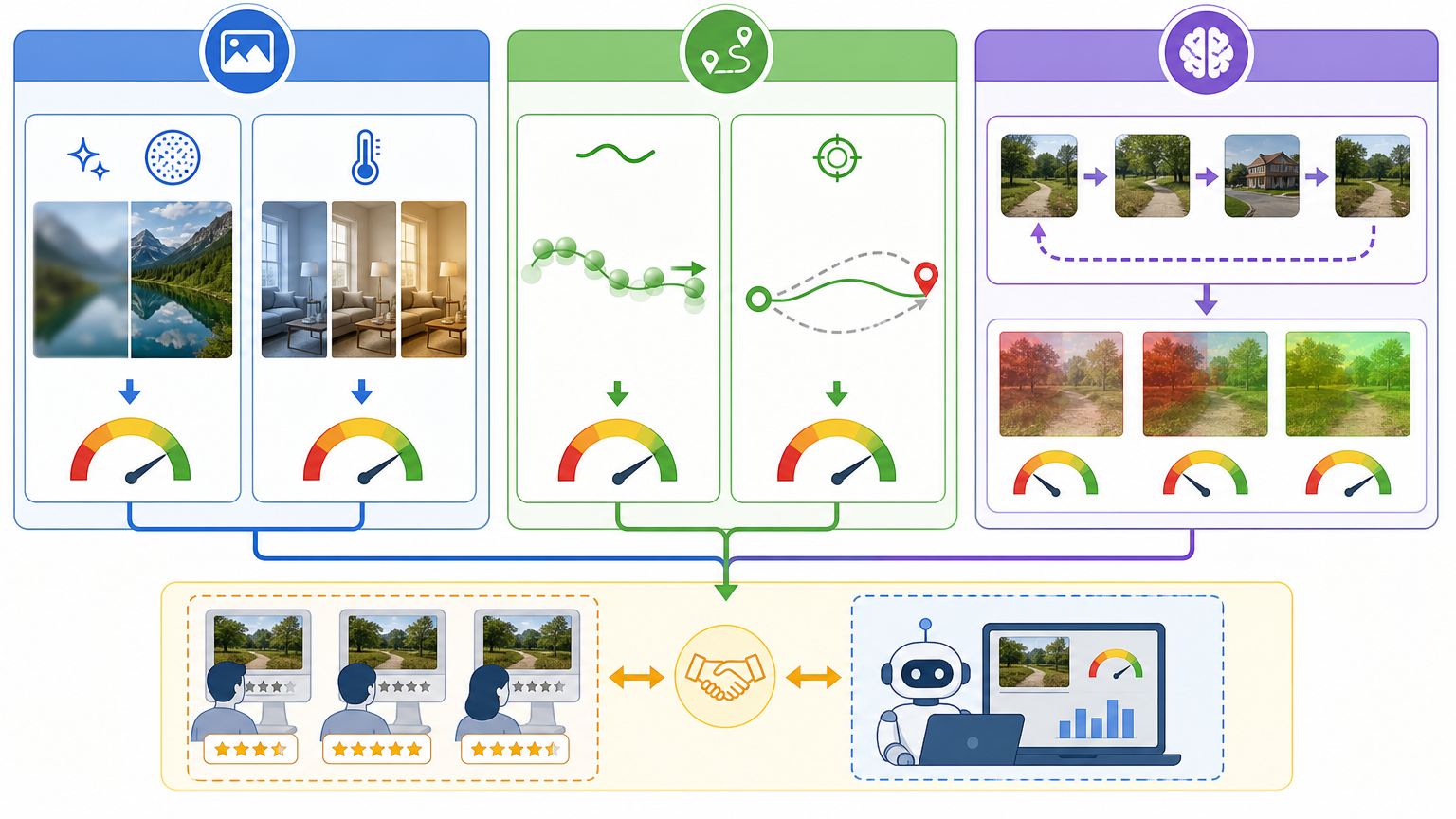

有了统一动作,还得有能测出真本事的考题。iWorld-Bench攒出了一个规模惊人的“题库”:整合12个公开数据集和4个模拟器的33万段视频,覆盖无人车、无人机、人类视角、机器人视角4种观察角度,包含晴天、雨天、雾天、雪夜等9种室外天气,以及荧光灯、暖光、昏暗环境等5种室内光照。

这些视频不是随便堆的,而是经过了严格的“出题设计”:从最简单的单步动作(比如“静止”“直线前进”),到复杂的多自由度组合(比如“向左平移同时向右旋转90度”),再到考验长期记忆的“闭环任务”——先让AI前进3米,再后退3米,看它能不能回到初始场景,生成完全一致的画面。

评测指标也跳出了“好不好看”的单一标准,分成了三大类9项:图像质量看清晰度、亮度色温一致性;轨迹跟得准不准看运动平滑度、轨迹准确度;记忆能力看回到起点时的场景重合度。每一项指标都经过人类偏好验证,确保机器打分和人的真实感受一致。

当14款主流AI世界模型被拉到这个统一考场后,结果有点出乎意料:

拿到最高分的是靠键盘编码控制的HY-World 1.5,它的动作响应精准,记忆能力出色,就像一个严格听指挥的优等生;而以画质精美著称的文本控制模型CogVideoX-I2V,虽然生成的视频细节拉满,轨迹准确度却只有0.595,相当于听懂了指令但走歪了路;相机参数控制模型则在记忆对称性上表现突出,能牢牢记住场景的空间结构,但画质细节稍逊一筹。

这场统一考试戳破了不少“纸面繁华”:很多AI能画出逼真的画面,却不懂“动作改变世界”的逻辑——让它向左转,它可能只是把画面里的物体挪了位置,而不是真的转动视角;有的AI能完成单步动作,却记不住前一秒的场景,走个闭环就彻底迷路。

iWorld-Bench的意义,绝不止是给AI排了个名次。它第一次给“能交互的世界模型”划出了清晰的能力标尺——原来AI要真正“理解世界”,光会画漂亮的画不够,得能听懂动作指令,能记住场景变化,能像人一样在世界里“行走”和“思考”。

这张统一的“高考卷”,其实是给所有AI研究者指了个方向:别再盯着“画质”卷了,先把“怎么在世界里好好行动”这件事搞明白。毕竟,能模拟真实世界的AI,最终要的不是成为画家,而是能像人一样,和这个世界真正互动。

统一标尺,才是AI向真实世界靠近的开始。