对抗知识焦虑,从看懂这条开始

App 下载

没有干净样本,AI也能给点云去噪打分了

南京理工大学|质量评估|激光雷达|UGD算法|点云去噪|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

南京理工大学|质量评估|激光雷达|UGD算法|点云去噪|多模态视觉|人工智能

想象一下:你用激光雷达扫了一个工业零件,屏幕上跳出一团带着杂点的3D点云——这是真实世界里的常态,噪声永远存在。但要判断去噪算法好不好,过去你得有一个绝对干净的「标准答案」,可现实中根本没人能掏出这么个「完美样本」。工程师们只能靠肉眼瞅,凭感觉打分,不同人判出的结果能差出一个级别。直到南京理工大学的团队拿出了UGD:它不需要任何标准答案,只看处理后的点云,就能给出精准的质量分数,甚至比依赖标准答案的传统指标更靠谱。

UGD的核心逻辑说穿了很简单——先让AI见过足够多的「好孩子」,再让它当评委。

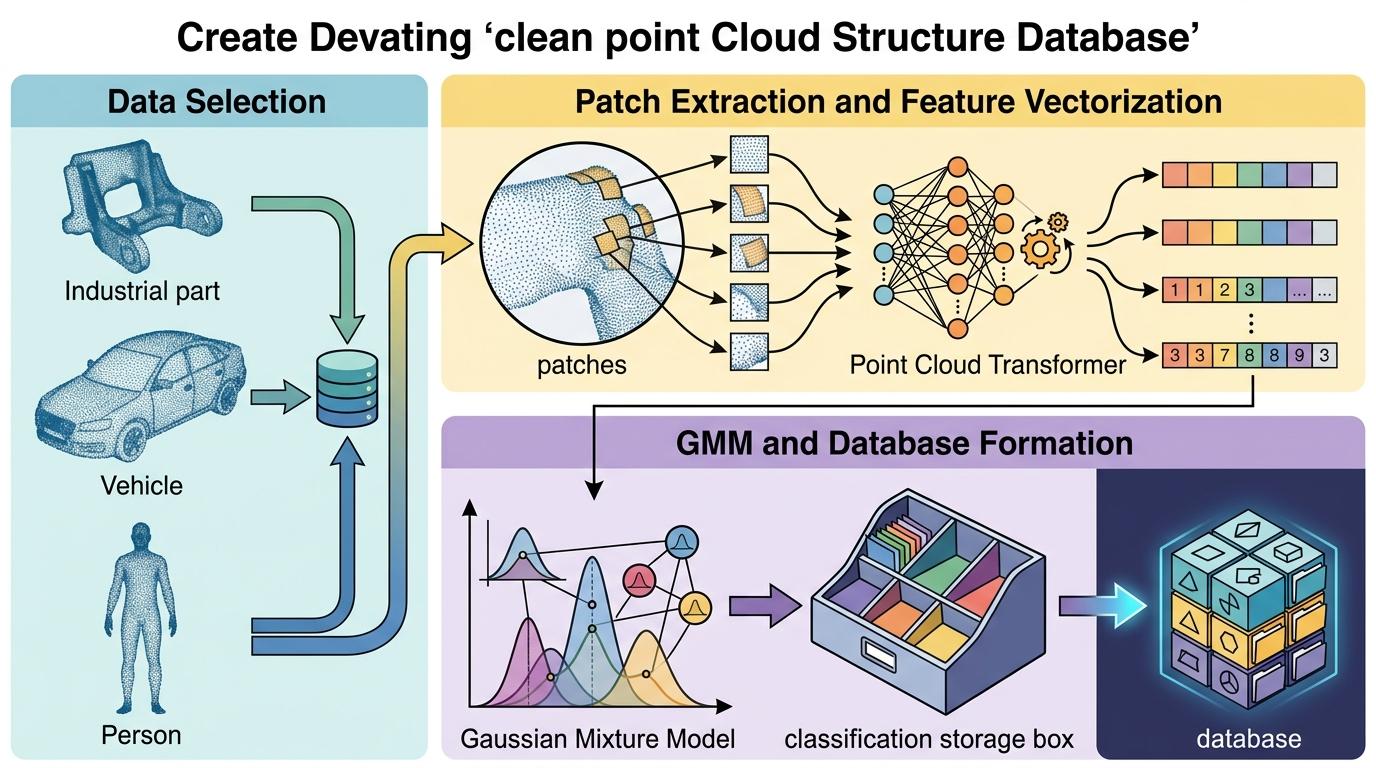

团队先从公开数据库里挑了150个高质量干净点云,涵盖工业零件、车辆、人物这些常见类别。他们把每个点云拆成无数个指甲盖大的局部「补丁」,用点云Transformer(PCT)把每个补丁转换成一组能代表几何特征的数字向量。接着,这些向量被喂给一个高斯混合模型(GMM)——你可以把它想象成一个分类收纳盒,AI会自动把相似的干净几何结构归到同一个格子里,最终形成一个「干净点云结构数据库」。

这个GMM就是UGD的「考官大脑」,它记住了所有正常、干净的点云局部该长什么样:比如平整的曲面该有怎样的点分布,尖锐的棱角该有怎样的点密度。

光有数据库还不够,得让AI能精准识别「坏孩子」——也就是被噪声破坏的点云结构。

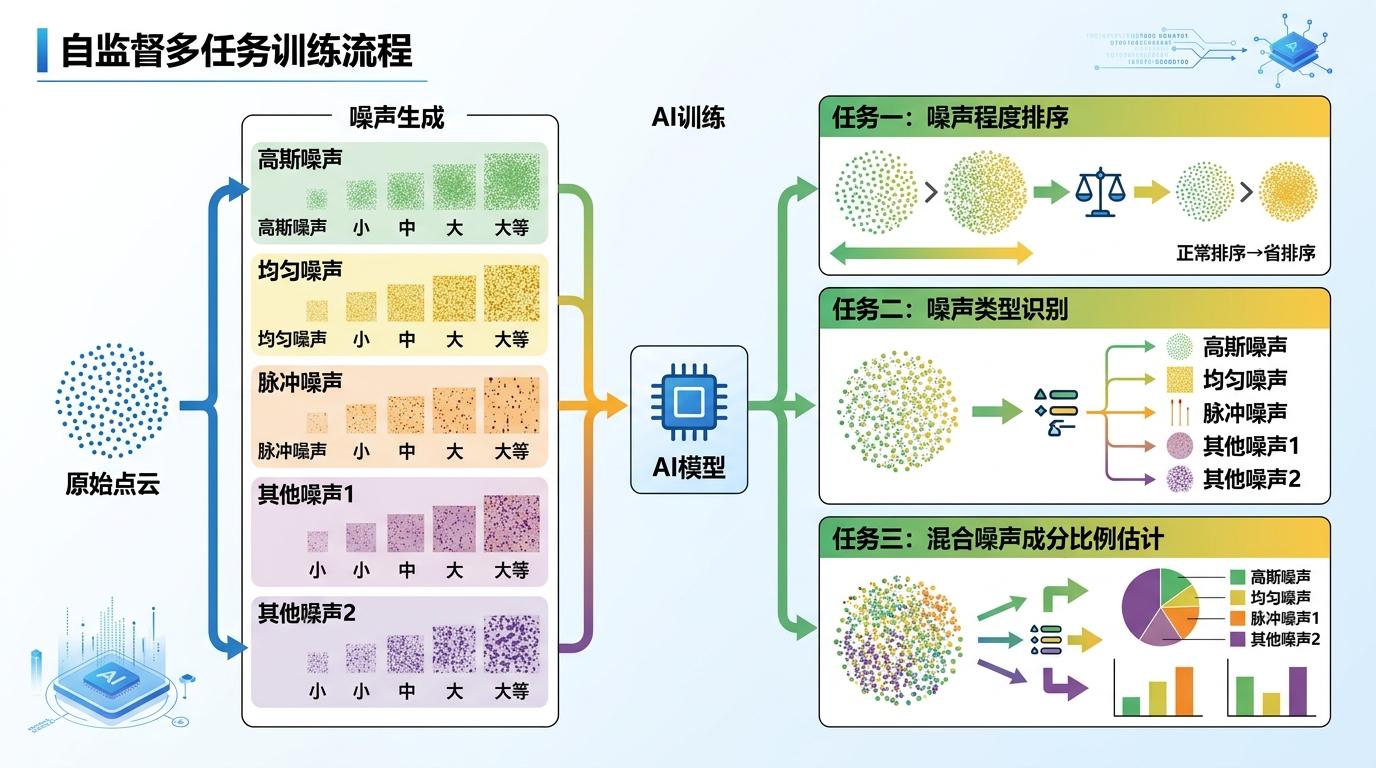

团队给AI设计了一套自监督多任务训练:他们把干净点云故意弄脏,生成高斯、均匀、脉冲等5种不同噪声,每种噪声还分5个等级。然后让AI完成三个任务:一是给两坨被不同程度弄脏的点云排序,判断谁更接近干净;二是识别这坨点云被哪种噪声弄脏了;三是猜出混合噪声里每种成分的占比。

这一套训练下来,AI的特征提取网络彻底变了:它不再只看点云的整体形状,而是对哪怕极其细微的几何畸变都极度敏感——就像老中医摸脉,指尖一搭就能察觉气血不畅。最终,当一个去噪后的点云输入进来,AI会把它拆成同样的补丁,提取特征后和GMM里的「干净模板」比对,用加权马氏距离算出每个补丁的「干净度」,最后加权平均得到整个点云的UGD分数:分数越高,越接近干净标准。

在合成噪声测试里,UGD的成对排序准确率超过90%,和依赖标准答案的传统指标表现不相上下。但在真实场景里,它的优势才真正显现:曾经有个去噪算法处理后,传统的点对点距离指标给了高分,可实际上点云里布满了偏离表面的伪影点——这是因为传统指标会被离群点干扰,而UGD只认几何结构的合理性,直接给这个算法打了低分,和人眼的判断完全一致。

当然它也有短板:因为训练用的干净点云多是平滑结构,UGD会天然偏好过度平滑的结果。如果一个去噪算法把零件的尖锐棱角磨平了,UGD可能会误判为高质量;反过来,保留了棱角但带点细微噪声的点云,得分反而会低。在实际使用时,得给它搭配局部曲率分析这类工具,才能避免被「平滑偏好」误导。

UGD的出现,本质上是把点云去噪的评估逻辑从「找标准答案」转向了「找普遍规律」。过去我们被「没有真值就无法量化」的思维困住,默认了评价必须依赖绝对标准,却忘了真实世界里的「好」,本就来自对常态的认知。

未来它或许能扩展到点云补全、上采样更多几何处理任务,但更重要的是,它给了一个启示:当现实不提供完美参考时,不妨先让AI学会理解「正常」是什么样。

没有绝对标准答案,也能做出客观判断。