对抗知识焦虑,从看懂这条开始

App 下载

Node.js AI代码争议:“DCO合规”与可审计性的两难

开源可审计性|DCO开发者证书协议|Claude Code|Matteo Collina|Node.js|软件工程|AI产业应用|前沿科技|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

开源可审计性|DCO开发者证书协议|Claude Code|Matteo Collina|Node.js|软件工程|AI产业应用|前沿科技|人工智能

2026年1月,Node.js核心维护者Matteo Collina用Claude Code在一个假期写出1.9万行代码,提交了原本需要数月全职工作的虚拟文件系统功能PR。这本该是AI提升开发效率的范例,却在两个月后引爆社区争议:资深贡献者发起请愿,要求禁止AI代码进入Node.js核心——焦点并非代码质量,而是AI生成代码是否符合“DCO开发者证书协议”,以及它对开源基础设施“可审计性”的冲击。当AI把代码产出速度提升10倍,运行在全球数百万服务器上的开源核心项目,还能守住它的信任根基吗?

作为Linux内核首创的轻量级贡献机制,DCO的核心从来不是“代码必须100%手写”——它是一条责任传递链:贡献者通过签署“Signed-off-by”声明,确认自己有权提交代码,且代码符合项目许可,愿意为其承担法律责任。这正是为什么Linux内核、Red Hat法律团队和OpenJS基金会都一致表态:AI辅助代码只要经过人类充分审核并签署DCO,就符合协议精神。

争议的真正分歧在于“充分审核”的边界。Matteo Collina强调自己主导了架构设计,逐行审查了AI生成的代码,如同“用压面机做面条,最终责任在厨师”;但反对者算了一笔账:1.9万行代码按每行审查2分钟计算,需要90个工作日——一个假期里完成这样的工作量,是否真的能做到“逐行理解”?DCO要求的“责任”,本质是贡献者对代码的完全掌控,而AI生成的大规模代码,恰恰在挑战“人类是否能真正掌控每一行”的底线。

更关键的是版权风险:尽管2024年GitHub Copilot版权案判决“AI生成代码与训练数据不构成实质性相似”不侵权,但AI训练数据中大量未经授权的开源代码仍是法律灰区。如果AI无意中复制了受GPL许可保护的代码片段,签署DCO的贡献者就必须承担侵权责任——这不是理论风险,已有研究显示45%的AI生成代码存在安全漏洞,62%含设计缺陷,其中就包括潜在的版权问题。

对于Node.js这种运行在全球数百万服务器上的核心基础设施,“可审计性”比代码效率更重要。它意味着任何一行代码都能追溯到开发者,任何一个设计决策都有上下文可查,任何一个漏洞都能快速定位根源——这是开源社区积累数十年的信任基础。

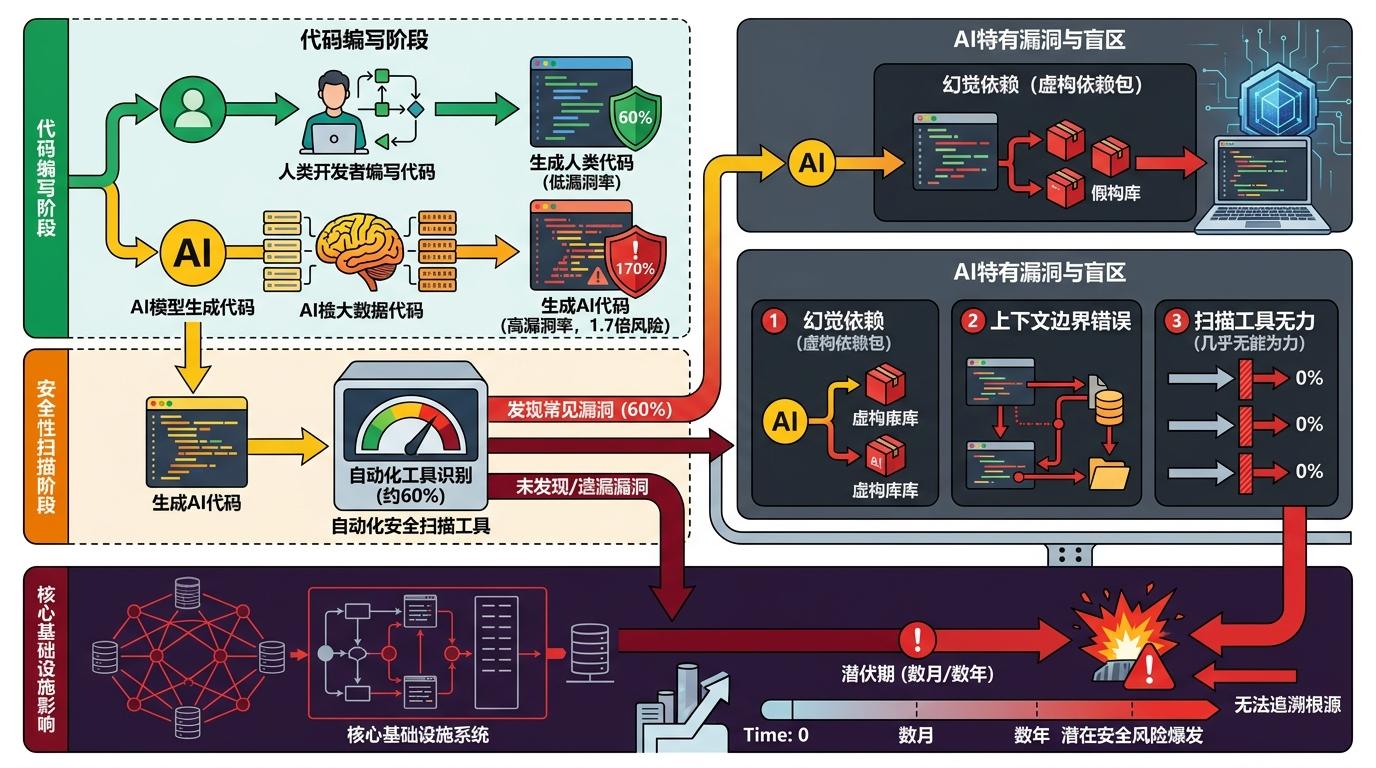

AI生成代码却正在瓦解这个基础。首先是“上下文缺失”:AI能生成符合语法的代码,却无法记录架构设计的权衡、业务规则的边界、历史兼容的妥协——这些“隐性知识”恰恰是代码可维护性的关键。当后续维护者看到一段AI生成的代码,只能知道“它做了什么”,却不知道“为什么这么做”,更无法判断它是否会引入架构漂移。

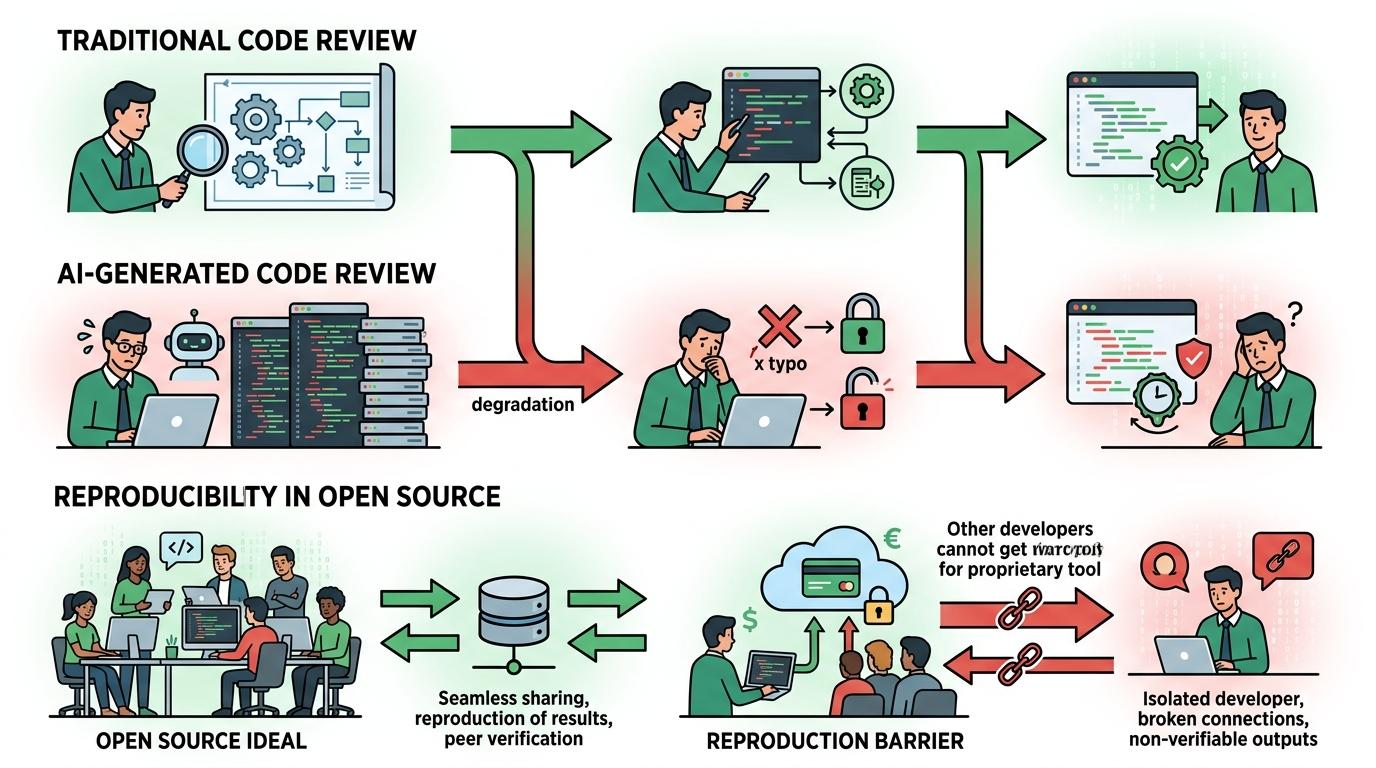

其次是“审查逻辑的退化”:传统代码审查是“理解设计→验证实现”,而面对AI生成的大规模代码,审查者只能退化为“检查语法→扫描漏洞”——从对设计合理性的判断,变成对表面错误的排查。更棘手的是复现门槛:Matteo Collina使用的Claude Code是付费工具,其他开发者无法复现他的代码生成过程,这就打破了开源社区“代码可复现、可验证”的基本原则。

研究显示,AI生成代码的漏洞率是人类代码的1.7倍,而目前的自动化扫描工具只能发现60%左右的常见漏洞,对于AI特有的“幻觉依赖”(虚构的依赖包)、上下文边界错误等问题,几乎无能为力。这意味着,当AI代码进入核心基础设施,潜在的安全风险可能在数月甚至数年后才会爆发,而那时早已无法追溯根源。

这场争议的结局,大概率不会是“全面禁止AI代码”,而是开源社区被迫建立适应AI时代的治理规则。Linux内核社区已经给出了方向:要求AI辅助代码必须通过“Assisted-by”标签透明披露,且必须经过严格的人类审查;Red Hat则提出,AI贡献的核心是“人类在环”——AI是工具,最终决策权和责任必须在人类手中。

一些开源项目已经开始尝试更具体的规范:比如限制AI在核心安全模块(认证、加密、权限控制)的使用,要求AI生成代码必须拆分为小PR提交,强制贡献者记录AI生成的提示语和审查过程。但这些规则仍停留在“补漏”阶段,面对AI代码产出的速度,开源治理的核心矛盾已经变成:如何在效率和安全之间找到平衡?

另一个不可忽视的问题是“公平性”:使用Claude Code、GitHub Copilot等付费AI工具需要成本,这意味着拥有资源的开发者能更快地提交代码,而普通贡献者可能被边缘化。这种“技术门槛”正在挑战开源社区“人人可贡献”的平等精神——当代码产出速度成为核心竞争力,开源项目是否会逐渐被少数掌握AI工具的开发者掌控?

Node.js创始人Ryan Dahl说“人类编写代码的时代已经结束”,这句话或许没错,但“人类对代码负责的时代”才刚刚开始。AI确实能把开发者从重复性劳动中解放出来,让他们专注于架构设计和创新,但对于开源基础设施而言,信任永远比效率更重要——它的每一行代码,都承载着全球数百万开发者和企业的运行安全。

这场争议的本质,是开源社区在AI时代的自我校准:它不是要拒绝AI,而是要重新定义“贡献”的标准——代码的价值从来不是“写得快”,而是“可信赖”。当AI成为开发的标配,开源治理的核心将从“代码审查”转向“责任审查”:确保每一行AI生成的代码,都有清晰的责任归属,都能被追溯、被理解、被维护。

信任比效率更重,责任比速度更急。