对抗知识焦虑,从看懂这条开始

App 下载

AI 能生成答案,但决策权还在人手里

处理流畅性效应|市场分析报告|AI助手|全球金融高管会议|认知决策|AI产业应用|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

处理流畅性效应|市场分析报告|AI助手|全球金融高管会议|认知决策|AI产业应用|心理认知|人工智能

2025年的一场全球金融高管会议上,AI助手递上了一份近乎完美的市场分析报告——数据详实、逻辑顺滑,连图表配色都精准踩中了高管们的审美。全场一片赞叹,直到一位资深分析师敲了敲桌子:“去年同类危机里的关键变量,它没提。” 满场的赞许瞬间凝固。没人质疑AI的效率,可当它用流畅到无懈可击的语言包装了一个致命遗漏时,所有人突然意识到:我们对AI的信任,已经悄悄越界了。为什么看起来越“靠谱”的AI输出,反而越危险?

这背后藏着一个被研究了几十年的心理学规律——处理流畅性效应,简单说就是:读起来越顺、看起来越规整的信息,我们越容易觉得它是对的,哪怕事实根本站不住脚。AI恰恰把这个效应用到了极致:大语言模型生成的内容语法完美、逻辑闭环,甚至会模仿人类专家的语气给出笃定结论,连标点符号都透着“专业感”。

2025年的一项研究显示,当AI以流畅的语言输出错误信息时,新手用户的验证率不足30%,而资深从业者的质疑比例也比纯人工场景低了40%。我们的大脑天生喜欢“省力”,面对一份不需要纠错、不需要补漏的“完美答案”,很容易跳过最关键的一步:判断它到底对不对。

更棘手的是,AI的错误往往不是“错别字”这种显性问题,而是像那场会议里的遗漏——它会选择性地忽略不符合逻辑链的信息,或者编造不存在的“权威来源”来支撑结论。这些错误藏在流畅的文本里,比手工撰写的错误更难被发现。

过去,衡量一个人专业能力的标准是“能给出多少正确答案”——律师要背熟法条,分析师要算出精准数据,设计师要拿出成型方案。但AI出现后,答案突然变得一文不值:你能在10秒内让AI生成3份竞品分析,5分钟写出一份项目提案,甚至1分钟算出复杂的财务模型。

真正的专业能力,正在从“生成答案”转向“评估答案”。哈佛商学院2024年对肯尼亚创业者的实验印证了这一点:同样使用GPT-4做商业助理,高绩效创业者的收入提升了15%,低绩效者反而下降了8%。差异不在于AI给的建议,而在于前者会筛选AI的方案,结合本地市场的潜规则调整策略;后者则直接把AI的“通用建议”照搬到自己的小生意里,比如照搬大城市的定价策略到人均收入不足100美元的乡村。

这就是AI时代的核心能力:带着判断用AI,而不是让AI替你判断。它要求你把AI的输出当成“素材”,而不是“结论”——你要做的是核对事实、补充背景、校准逻辑,最后把这些素材拼成真正符合场景的决策。

要做到“带着判断用AI”,核心是搞懂人机协同的边界。目前学界和业界已经形成了三条共识:

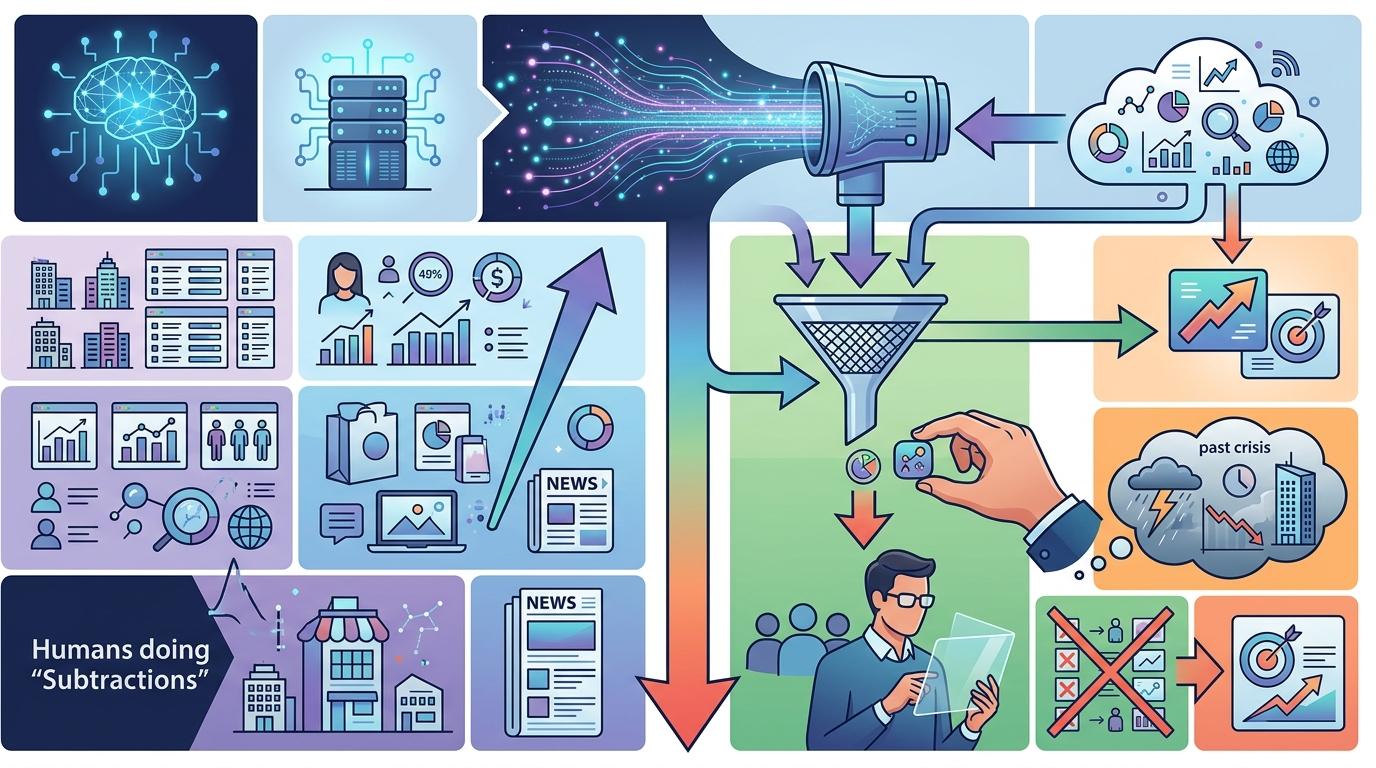

第一条,AI做“加法”,人类做“减法”。AI擅长把所有相关信息堆给你——比如一份市场分析里,它会列出10个竞争对手、8种消费趋势,但人类要做的是从中挑出和你的业务真正相关的2-3个关键变量,像那位资深分析师一样,补全AI没提到的“去年同类危机”的背景。

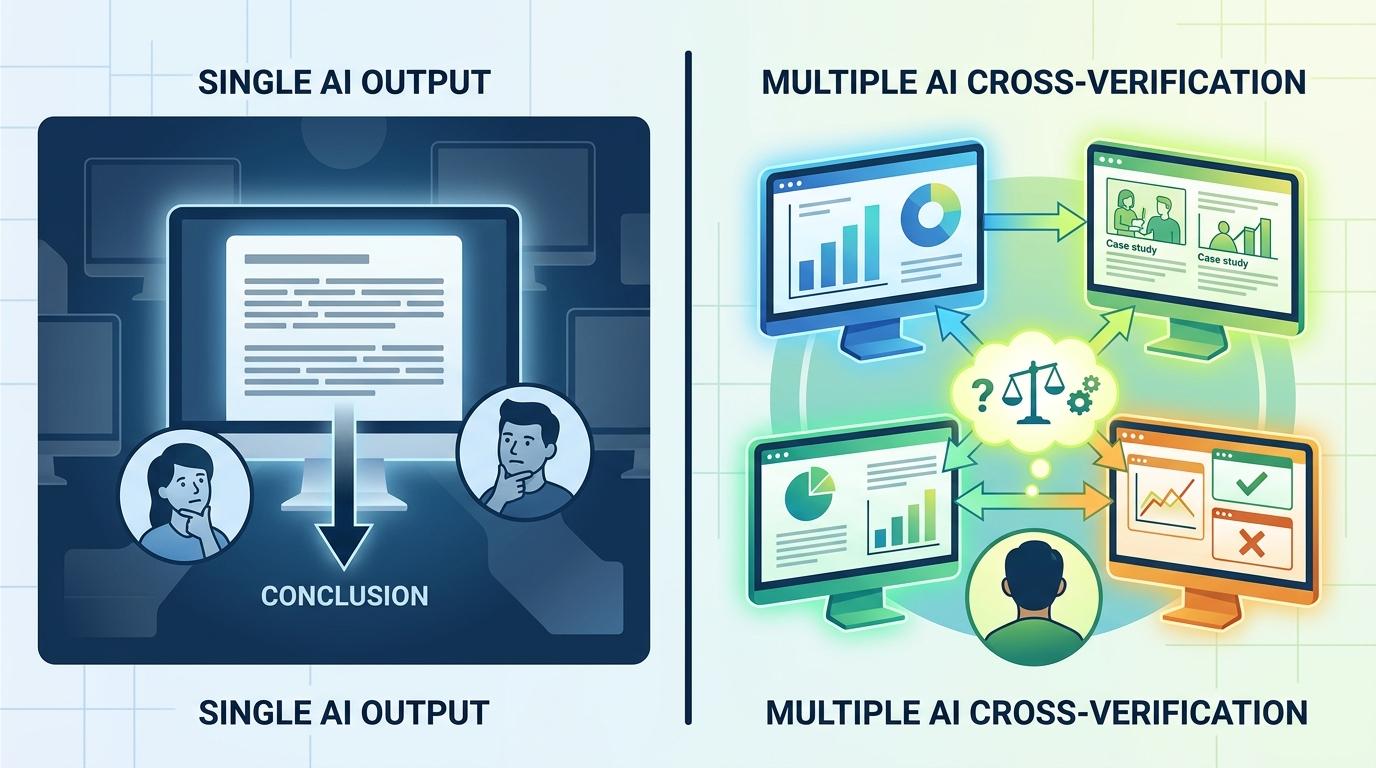

第二条,用多个AI交叉验证。同一份需求,让ChatGPT、Claude、Gemini分别输出,你会发现它们的答案可能大相径庭——有的侧重数据,有的侧重案例,有的甚至会给出完全相反的结论。这种“不一致”恰恰是价值所在,它会提醒你:这个问题没有标准答案,需要你自己权衡。

第三条,留一段“无AI思考时间”。不要刚拿到AI的输出就立刻做决策,把它放在一边,花10分钟用自己的逻辑重新梳理一遍问题。这不是浪费时间,而是在防止你的大脑被AI的逻辑“绑架”——毕竟,最终要为决策负责的是你,不是AI。

当AI能帮我们完成90%的基础工作时,剩下的10%的判断,就成了人与人之间的核心差异。有人把AI当成“甩手掌柜”,有人把AI当成“思考助理”,而这两种选择,正在拉开专业能力的鸿沟。

答案易得,判断无价。未来的职场里,不会用AI的人会被淘汰,但只会用AI的人,同样走不远。真正的专业,从来不是“知道所有答案”,而是在答案泛滥的时代,依然能找到那个最适合的选项。