对抗知识焦虑,从看懂这条开始

App 下载

AI不再死记硬背,开始学懂物理世界

AI理解能力|物理规律建模|现实模拟器|世界模型|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

AI理解能力|物理规律建模|现实模拟器|世界模型|大语言模型|人工智能

当你问ChatGPT苹果为什么落地,它能把牛顿的故事背得一字不差,但你要是把苹果换成一颗没在课本里出现过的奇怪果子,它可能就会胡编乱造——它根本没真正理解重力,只是在复述互联网上的文字。2026年春天,两场总金额超过20亿美元的融资,把一个叫“世界模型”的概念推到了聚光灯下。这是AI领域的新赛道,目标就是让机器真正“懂”这个三维的、有物理规律的真实世界。为什么大语言模型走不通?世界模型又到底要怎么建?

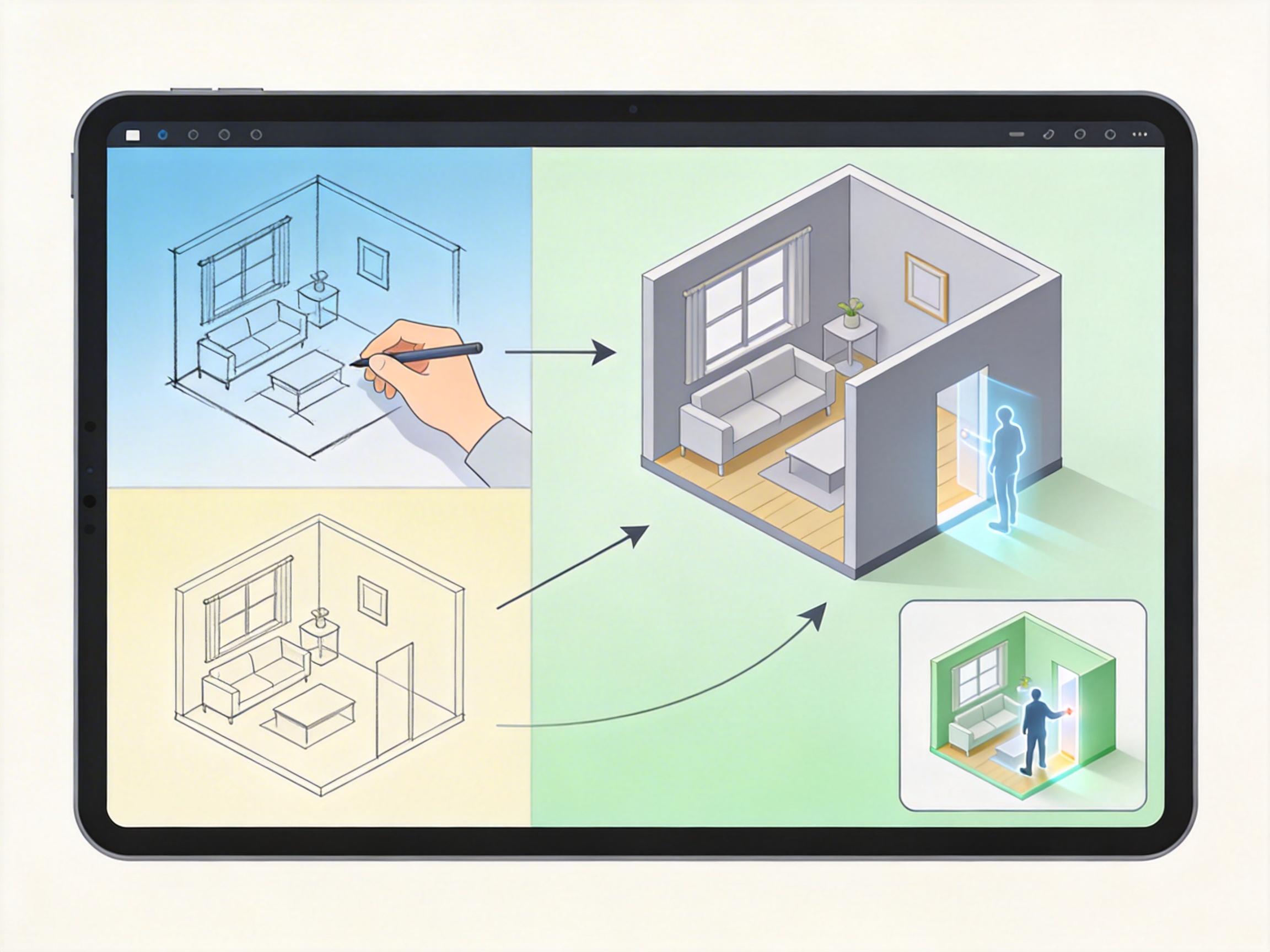

你可以把世界模型理解成AI脑子里的“现实模拟器”——它能像人一样,不用亲身经历,就能想象出“推一下杯子会倒”“球滚下桌子会落地”这些物理规律。但到底怎么建这个模拟器,全球的科学家们分成了五派,各自盯着一个核心难题死磕。 杨立昆的JEPA派,要解决的是“AI别再死记像素”的问题。他们让AI把视频转换成抽象的数学符号,不用去预测每一片叶子的飘落轨迹,只需要在这个抽象空间里判断“风会把树叶吹下来”。他们的V-JEPA 2模型,用100万小时无标签视频预训练后,只需要62小时机器人数据,就能在陌生环境里把陌生物体拿起来,成功率能到65%-80%——而传统方法要练几千小时。 李飞飞的空间智能派,盯着的是“AI看不懂三维空间”的问题。他们的Marble工具,能把一段文字、一张照片甚至随手画的草图,变成一个可以旋转、编辑的3D场景,而且从任何角度看都不会“穿模”。不过目前它还只是个“3D画家”,能画出房间的样子,却还搞不清在房间里走路会碰到什么。

还有DeepMind的“造梦师”派,干脆直接给AI造一个虚拟世界练手。他们的Genie 3能生成一个暴风雨里的威尼斯运河,你可以划船、打碎花瓶,碎片会一直留在原地。但这个“梦境”只能维持几分钟,之后就会开始变形——毕竟它没有硬编码物理规则,所有规律都是从视频里学来的。

当科学家们在实验室里各显神通时,产业界已经开始为世界模型铺路——英伟达的Cosmos平台,就是专门给造世界模型的人“卖水卖铲子”的。它能在14天内处理2000万小时视频,比传统CPU方案快60多倍,还提供了现成的预训练模型,小鹏的自动驾驶、硅谷的机器人公司都在用它练AI。 但从实验室的demo到真正能用的产品,还有三道绕不开的坎。第一道是“数据坎”:世界模型需要的不是互联网上的文字,是真实世界的视频、传感器数据、触觉反馈,这些数据不仅难收集,还涉及隐私,没法像文本那样随便爬。第二道是“算力坎”:训练一个像V-JEPA 2这样的模型,要用到上万块GPU,成本是以千万美元计的,不是谁都烧得起。 第三道也是最核心的坎,是“因果坎”。现在的AI能从视频里学到“球被推了就会滚”,但它不一定真的理解“推力是球滚动的原因”。就像一个小孩看了一万次苹果落地,也不一定懂重力——要真正理解因果,还需要AI能像人一样,在脑子里做“思想实验”:如果没有重力,苹果会怎么样?如果桌子再高一点,球会滚得更远吗? 就连最接近生物智能的主动推断派,也只是刚摸到门槛。他们的AXIOM框架,能让机器人在仓库里遇到陌生物体时,先判断“我不确定这是什么”,而不是瞎猜瞎动,但要让它像人一样灵活应对复杂环境,还早得很。

很多人把世界模型当成大语言模型的“对手”,其实更准确的说法是“搭档”。大语言模型擅长处理符号、知识和逻辑,世界模型擅长理解物理、空间和因果,两者结合,才能让AI既会写代码,又会修水管。 比如一个能帮你装修的AI,大语言模型能听懂你“想要北欧风”的需求,世界模型能在脑子里模拟“把沙发挪到窗边会不会挡光”“吊灯的高度会不会撞头”;一个工业机器人,大语言模型能看懂维修手册,世界模型能判断“拧这个螺丝用多大劲才不会断”。 当然,现在的世界模型还都有各自的缺陷:JEPA太抽象,缺具体细节;Marble能画场景,却不懂物理;Genie的梦境不够持久;主动推断派的样本效率高,但处理复杂场景还不够。未来的方向,大概率不是某一派赢到最后,而是把这些技术融合起来——就像人的大脑,既有负责抽象思考的前额叶,也有负责空间感知的顶叶。

从AlphaGo下赢李世石,到ChatGPT写代码,AI一直在挑战人类的“智力边界”,但直到世界模型出现,它才开始真正“理解”我们生活的这个世界。这不再是靠统计概率猜答案的游戏,而是让机器像人一样,通过观察、模拟、推理,一点点建立起对现实的认知。 懂物理,才是AI落地的开始。 未来的AI不会只是屏幕里的聊天框,它会是能帮你搬家具的机器人,能提前预判故障的工业设备,能在虚拟世界里帮你试装修的设计师——它会真正走进我们的物理世界,而不仅仅是存在于数字空间里。