对抗知识焦虑,从看懂这条开始

App 下载

同事被AI"蒸馏"成数字分身,"隐性知识"才是职场底气

AI复制体|员工经验|知识蒸馏|.skill|数字分身|职场生态|AIGC|社会人文|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

AI复制体|员工经验|知识蒸馏|.skill|数字分身|职场生态|AIGC|社会人文|人工智能

2026年春,一种名为“.skill”的AI玩法在互联网快速发酵:企业可以把员工的工作能力、沟通风格甚至决策习惯,“蒸馏”成一个能被随时调用的数字分身。老员工离职后,这个永不涨薪、无需社保的AI复制体可以无缝接手工作,连沟通话术都分毫不差。打工人的焦虑随之蔓延:上午提交离职申请,下午AI分身就在工作群里@前同事;被优化的员工,其数字分身还在公司007“打工”。当职场经验被代码化,我们需要搞懂:这种“蒸馏”到底能拿走什么,又拿不走什么?

很多人以为,把同事“蒸馏”成AI分身是复杂的技术工程——要跑GPU集群,要做模型微调,要把人的经验真正转化为算法。但实际拆解后会发现,目前流行的“.skill”文件,本质只是一份写得更工整的系统提示词,连最基础的检索增强生成(RAG)技术都没用到,大小不过几十KB。

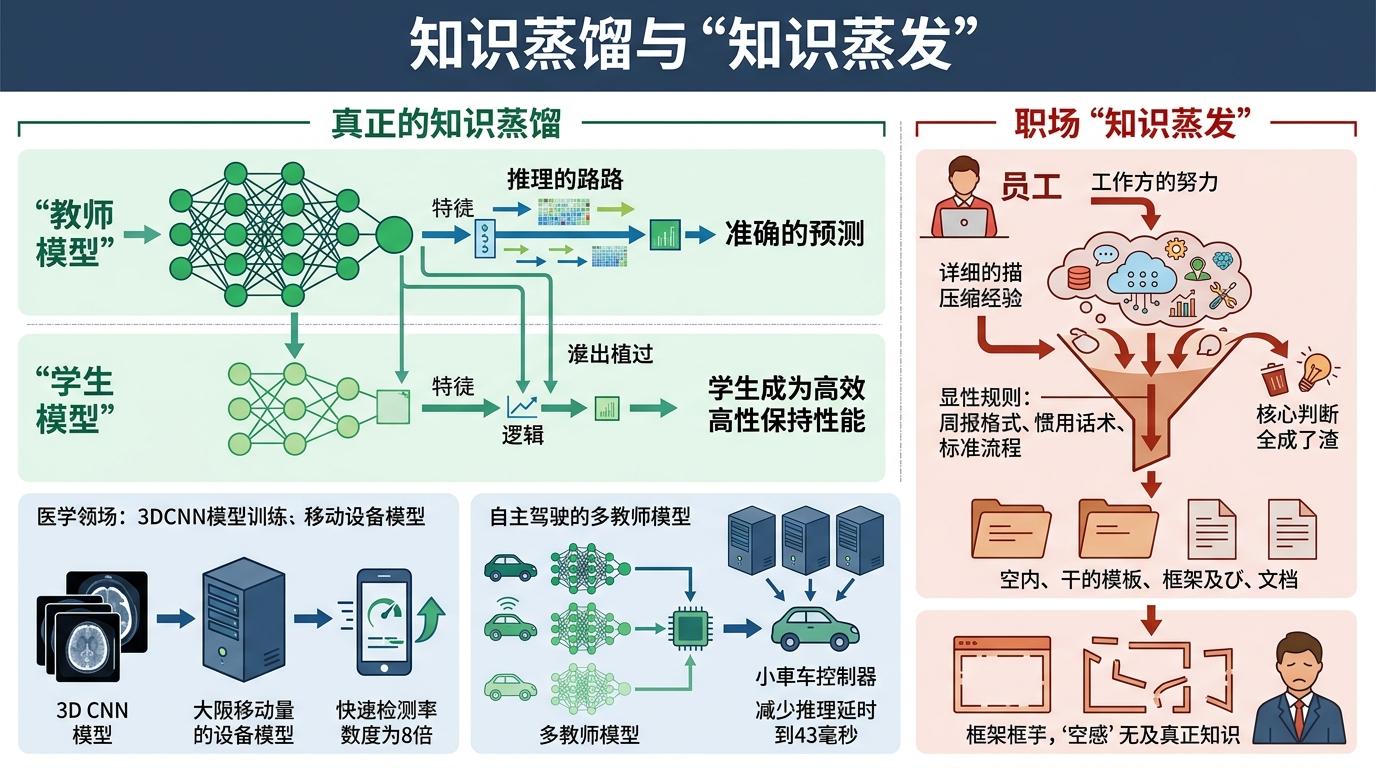

真正的“知识蒸馏”是机器学习领域的专业技术:用一个训练成熟的大“教师模型”,把学到的知识转移给轻量的“学生模型”,不仅要复制输出结果,还要模仿推理路径。比如医疗领域用3D卷积模型的知识训练轻量模型,能让移动设备的检测速度提升8倍;特斯拉用多教师模型蒸馏融合驾驶相关技能,把推理时延压缩到43毫秒。但职场里的“.skill”,只是把员工的周报格式、惯用话术、标准流程这类显性规则整理成模板,和真正的知识蒸馏相去甚远,更像“知识蒸发”——几十年的经验被浓缩成干瘪的框架,剩下的核心判断全成了渣。

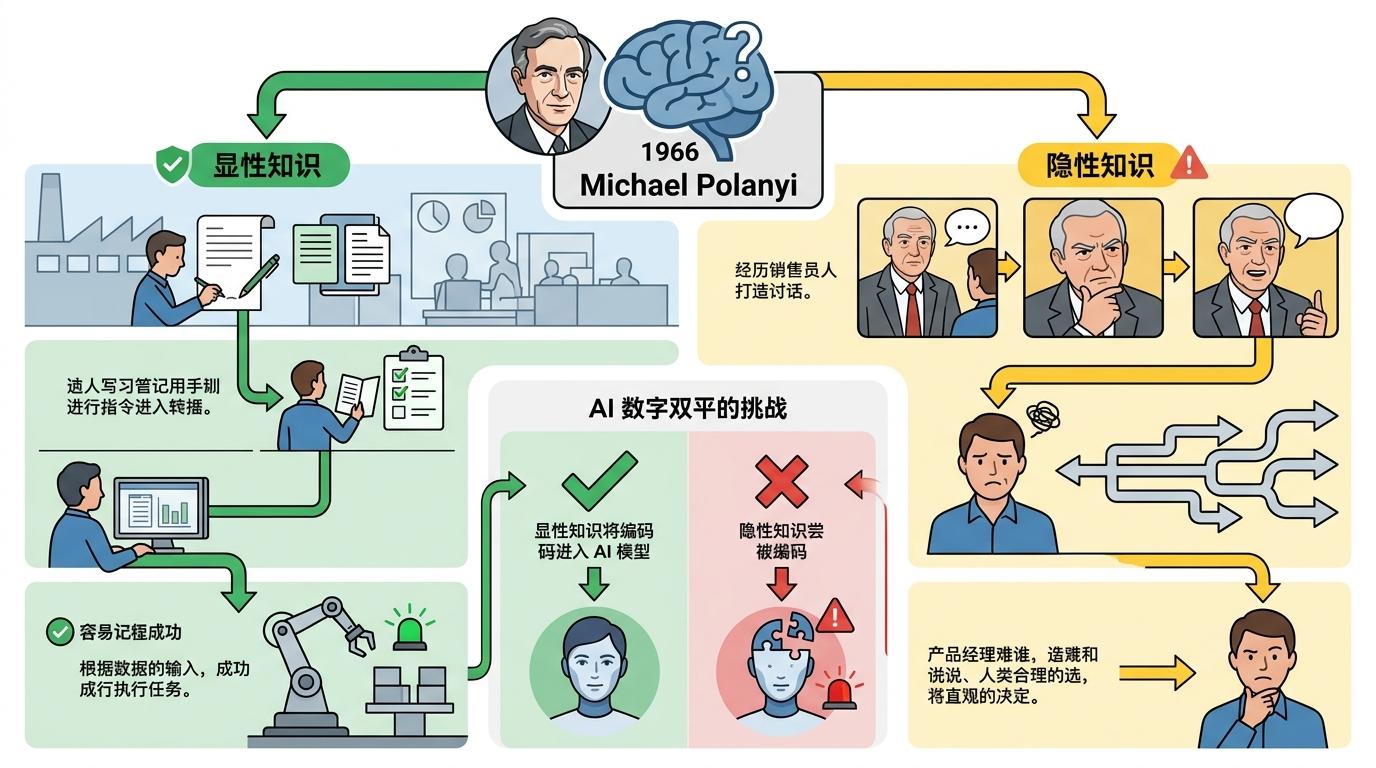

1966年哲学家波兰尼提出的理论,恰好戳中了AI数字分身的天花板:人类掌握的知识永远多于能说出口的。他把知识分成两类——写得出来、能文档化的是显性知识,比如操作手册、项目流程;说不清楚、依赖直觉的是隐性知识,比如老销售沉默5秒后开口的那句话,产品经理皱眉时做出的判断。

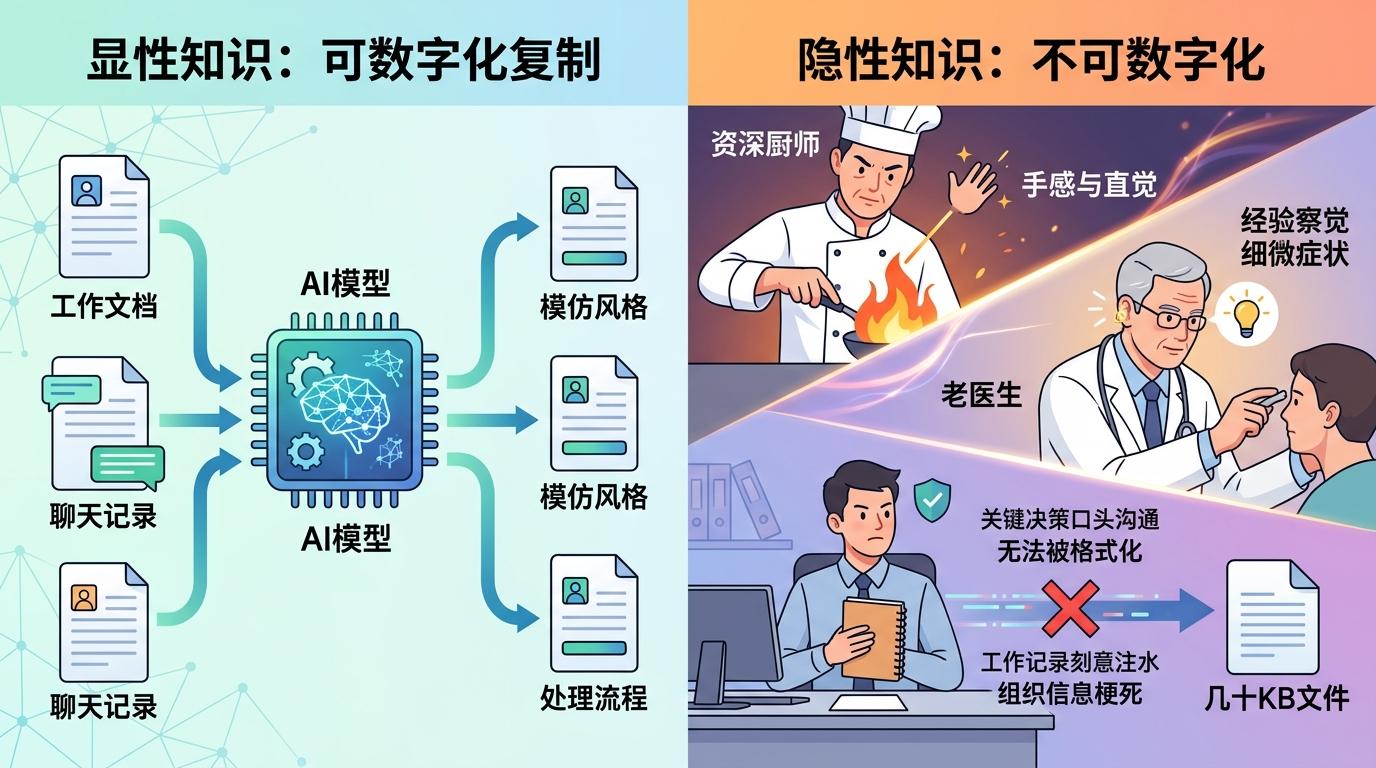

AI能轻松复制前者:只要把员工的工作文档、聊天记录喂给模型,就能模仿出八九不离十的沟通风格和处理流程。但后者藏在个体的经验、情绪甚至身体感知里,是在无数具体场景中打磨出来的直觉。就像资深厨师能凭手感判断火候,老医生能从细微症状里察觉疑难杂症,这些知识无法被格式化,更无法被几十KB的文件装下。当企业试图用AI固化员工经验,反而会触发员工的自我保护:关键决策改成口头沟通,工作记录里刻意注水,组织的信息流动就此梗死。

当同事的数字分身可以被随意调用,法律层面的模糊地带也随之浮现。如果公司未经同意悄悄“蒸馏”员工,侵犯的到底是肖像权、表达权还是数据权?目前美国部分州已出台生物特征保护法案,要求企业必须获得员工明确授权,才能使用其声音、行为模式等数据;欧盟GDPR则将生物特征数据列为“特殊敏感数据”,处理门槛极高。

更值得警惕的是职场权力关系的变化:传统PUA至少需要一个活人执行,但AI分身可以在员工离职后持续“工作”,无需沟通也无需共情。这种控制更隐蔽,也更让人细思极恐——打工人不仅要担心被优化,还要担心自己的数字分身永远被困在工作岗位上。而企业看似拿到了“永不离职的员工”,实则失去了员工主动分享知识的动力,最终受损的还是组织的创新能力。

当AI数字分身的玩梗慢慢冷却,留下的是关于职场价值的深层思考。一个大模型本质上是一个统一的大脑,即使生成千万个分身,底层参数和世界观也高度一致;但人类不同,八十亿人就有八十亿个独立的宇宙——每个人带着自己的经历、情绪和偏见解读世界,这是AI永远无法复制的多样性。

每个个体,都是不可蒸馏的独立宇宙。那些写不完的隐性知识,那些基于独特经验的判断,那些只能在具体场景中诞生的直觉,才是职场里真正的不可替代性。与其焦虑被AI“蒸馏”,不如专注打磨那些无法被代码化的能力——毕竟,能被复制的永远是流程,不能被替代的才是人本身。