对抗知识焦虑,从看懂这条开始

App 下载

AI代工程师干活,这次真不用盯着了

工程师工作流|性能对比报告|并发bug修复|自动化代码重构|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

工程师工作流|性能对比报告|并发bug修复|自动化代码重构|AI智能体|人工智能

想象一下:你把重构十万行代码的任务丢给AI,转身去开了三个小时会,回来时它不仅写完了所有逻辑,还自己跑了五轮测试、修正了三处并发bug,甚至附了一份清晰的性能对比报告。这不是科幻——就在上周,一批工程师已经用上了能做到这些的工具。此前因频繁宕机和‘降智’被用户吐槽的大模型,突然拿出了让资深开发者都惊讶的表现:它能像人类同事一样‘盯紧’长期任务,还能看懂屏幕上的每一个按钮和小字。这到底是怎么做到的?

你可以把之前的AI代码助手想象成一个刚入职的实习生:写简单代码没问题,但稍微复杂点的任务就需要你反复核对,稍微长一点的项目还会中途‘摸鱼’放弃。而这次的升级,相当于把实习生训练成了能独当一面的项目负责人。 关键的突破来自对‘长期任务稳定性’的优化。在一项叫Vending-Bench 2的测试里,模型要模拟经营一台自动售货机一整年——从选品、定价到补货、处理故障,所有决策都要自己做。前代模型最后只攒下8018美元的虚拟营收,而新模型直接做到了10937美元,差距相当于一个合格店长和金牌店长的区别。 它的秘密在于‘自我验证机制’:不再是写完代码就交差,而是会像人类工程师一样,先设计测试用例,自己运行一遍,发现问题再回头修改。在93项复杂编码任务中,它的解决率比前代提升了13%,包括4个之前完全搞不定的难题。有开发者反馈,现在可以把需要三天监督的代码重构任务,直接丢给AI去跑,自己只需要验收结果。

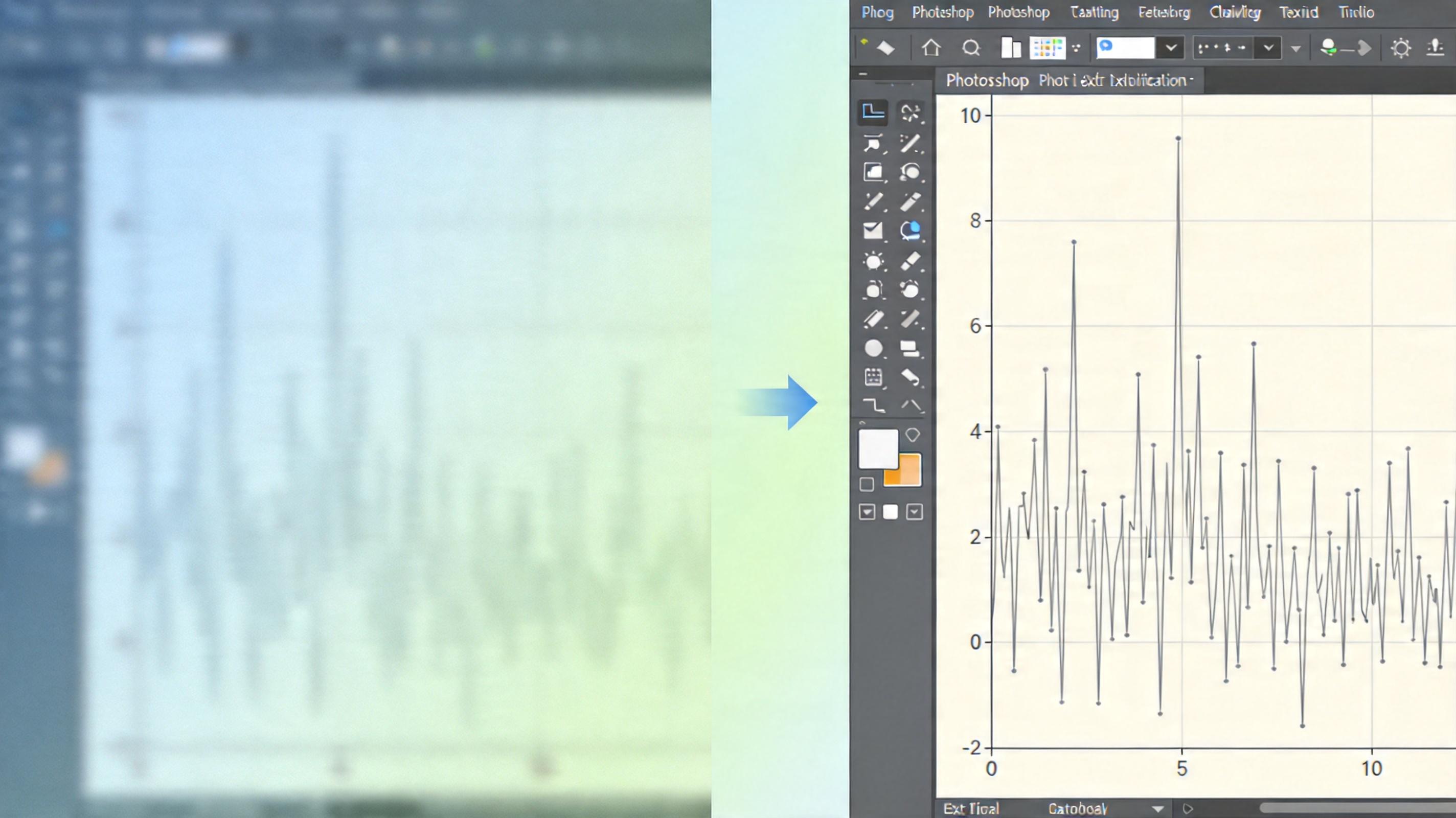

如果说代码能力是让AI能‘干活’,那视觉能力的升级就是让它能‘看懂’。之前的AI处理屏幕截图时,就像近视300度没戴眼镜:能大概看到界面布局,但按钮上的小字、图表里的精细数据经常‘看走眼’。 这次的升级把视觉分辨率提升了3倍——从之前的1.15百万像素跃升到3.75百万像素,相当于把手机摄像头从720P换成了4K。现在它能准确识别Photoshop工具栏里的每一个按钮、PDF文档里的六号小字,甚至是复杂数据仪表盘里的微小折线变化。在屏幕导航测试中,它的准确率从83.1%提升到了87.6%,看起来只是几个百分点的差距,但在实际工作中,这意味着AI终于能独立完成‘根据截图调整报表格式’‘从复杂界面里提取数据’这类之前必须人类动手的任务。

背后的技术逻辑并不复杂:更高的分辨率让模型能捕捉到更多视觉特征,再结合和语言模块的深度融合,把图像里的信息转化成能理解的文本指令。有自动化测试团队反馈,现在他们可以让AI直接处理软件界面的截图,自动生成测试用例,效率提升了至少40%。

能力升级的同时,一些细微的变化也在改变人和AI的相处方式。新模型对指令的执行变得极其‘字面’:之前你说‘帮我优化这段代码’,它会主动加上注释、调整变量名;现在它只会严格按照你说的‘优化性能’来做,多余的事情一件不碰。这让输出更可控,但也意味着之前用惯的提示词可能全部失效,得重新调整。 另一个需要注意的细节是token消耗的变化。新的分词器让同样一段文字的token数增加了0%到35%,看起来成本变高了,但因为AI干活更利索,完成同样任务的总token消耗反而更低——相当于员工虽然时薪涨了,但效率提升后,总工资反而降了。不过官方还是老实提醒:最好拿真实业务数据测一遍,心里才有底。 还有一个容易被忽略的点:为了安全,新模型主动削弱了网络安全相关的能力。在漏洞复现测试中,它的表现反而不如前代。这是个明确的信号:AI的能力越强,就越需要在‘好用’和‘安全’之间找平衡。

当AI能独立完成代码重构、能看懂屏幕上的每一个细节时,我们突然发现,人和AI的关系正在从‘工具使用者’和‘工具’,变成‘项目负责人’和‘核心员工’。之前我们担心AI会取代工程师,但现在看来,它更像是把工程师从繁琐的重复劳动里解放出来,去做更需要创造力的事情——比如设计更巧妙的架构、解决更复杂的业务问题。 人机协同的本质,是让AI做AI擅长的事,让人做人擅长的事。 未来的工程师,可能不再是写代码最多的人,而是最会给AI分配任务、最能验收AI成果的人。这场悄无声息的革命,才刚刚开始。