对抗知识焦虑,从看懂这条开始

App 下载

世界模型:AI从聊天到行动的关键一跃

AGI|空间感知|物理常识|OpenAI|世界模型|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

AGI|空间感知|物理常识|OpenAI|世界模型|大语言模型|人工智能

你有没有试过让AI帮你规划一次搬家?它能列出完美的打包清单,却永远想不到——衣柜的门打开时会撞到墙角,装满书的纸箱会压垮塑料收纳架。这不是AI的粗心,而是它的“认知盲区”:它能理解语言里的“衣柜”和“墙角”,却看不见真实世界里的空间、重量和碰撞。直到2026年,OpenAI、Google、Meta们集体押注的“世界模型”,终于开始补上这块最关键的短板。为什么这个被讨论了80年的概念,突然成了AGI的入场券?

你可以把大语言模型想象成一个背了全互联网词典的学霸——它能精准猜出下一个词,却不知道“杯子掉在地上会碎”不是语言规律,是物理规律。而世界模型,是给这个学霸装上了一双能“看见”世界的眼睛,还有一个能“推演”未来的大脑。 1943年心理学家Kenneth Craik提出,人类大脑里天生有个“小规模世界模型”:我们不用真的摔碎杯子,就能预判后果。2018年Google Brain的论文第一次把这个想法落地成AI架构——视觉模块压缩环境信息,记忆模块推演未来变化,控制模块在“模拟世界”里试错。到2026年,这条路线已经分化出三个战场:

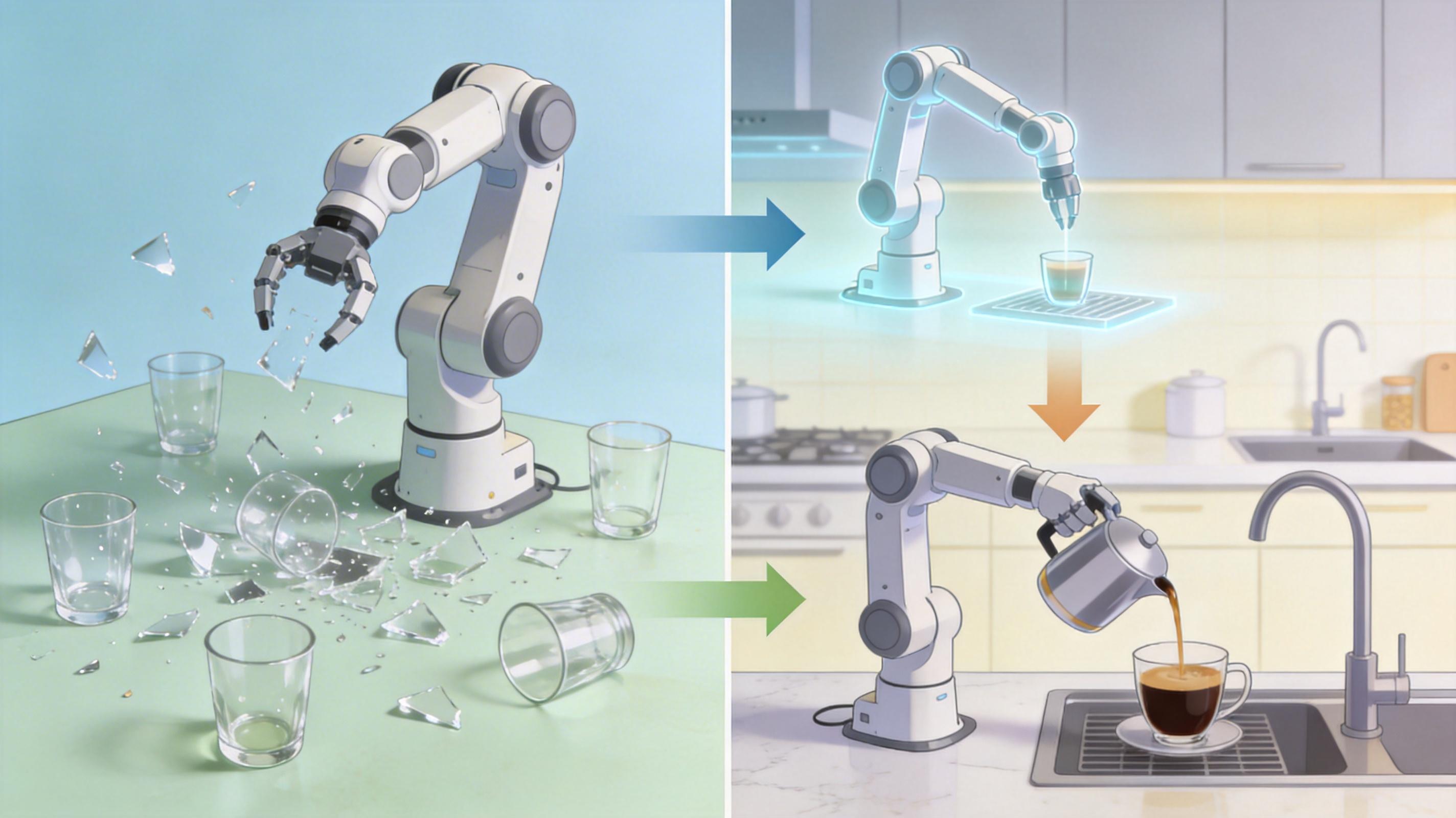

世界模型的真正威力,从来不是生成一段逼真的视频,而是让AI能在“想象”里完成任务——这直接改写了三个核心产业的逻辑。 机器人领域的改变最直观:过去训练机器人倒咖啡,要在现实里打碎几千个杯子;现在它可以在世界模型的“虚拟厨房”里练习100万次,再到现实里一次成功。2026年1X Robotics的1XWM模型,仅用900小时人类第一视角视频训练,就能完成双手协作的复杂任务,成功率比传统方法提升了70%。

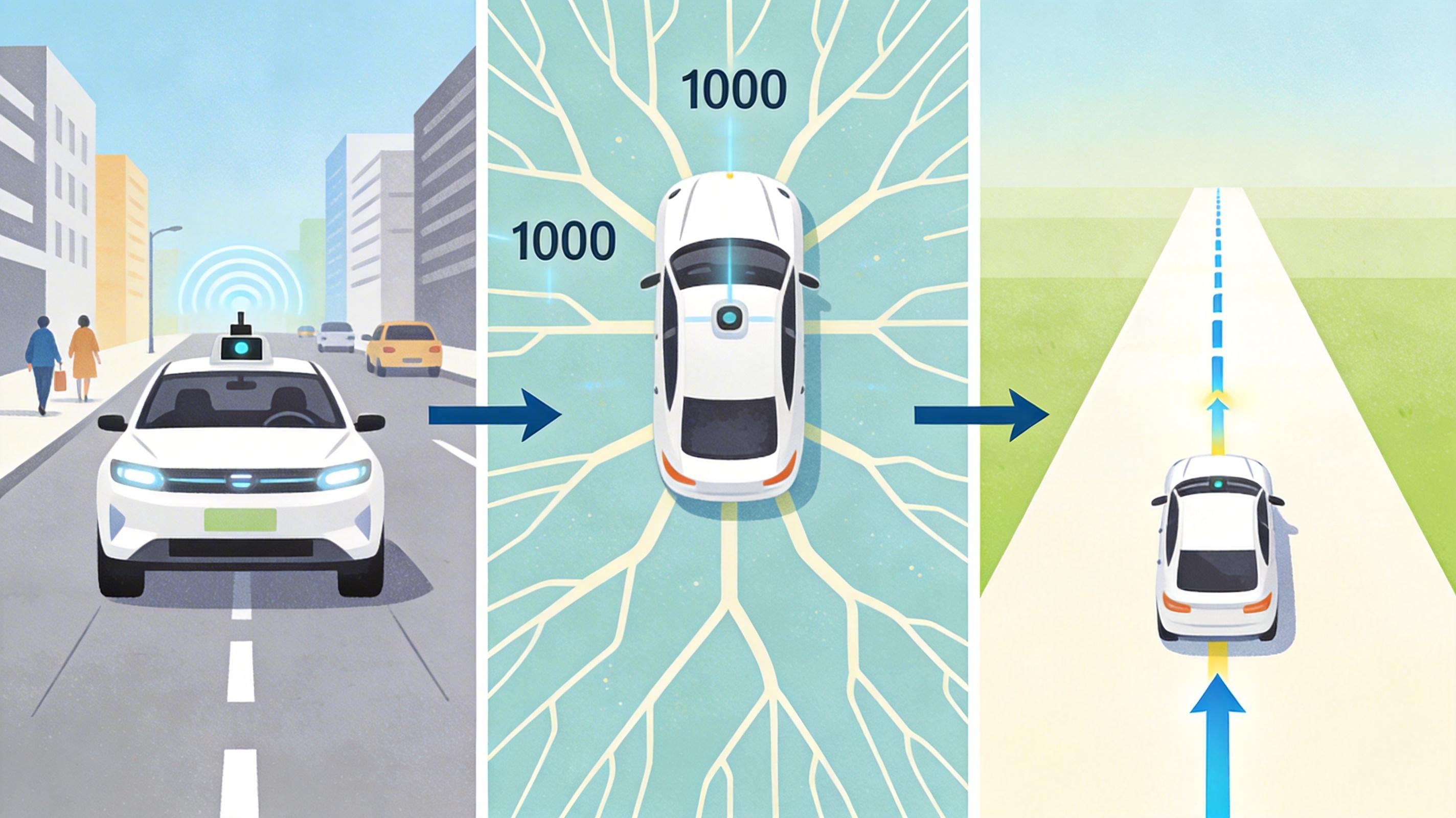

自动驾驶也终于摸到了L5的门槛:Waymo的新系统不再只是识别车和人,而是能预测“这个行人会不会突然跑过马路”“前车会不会急刹”——它在内部模拟了1000种可能的未来,再选最安全的路线。

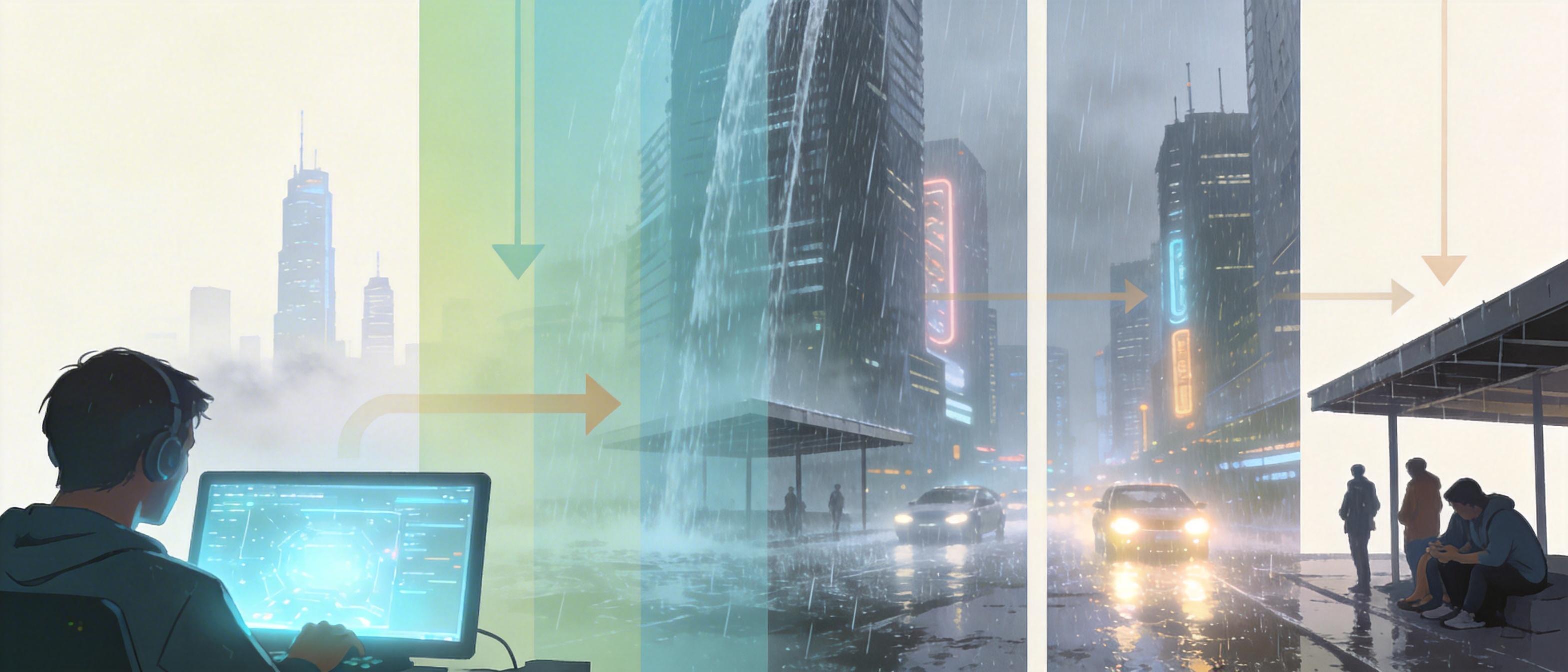

甚至连内容创作都被重构:游戏开发者不用再一砖一瓦搭建地图,只要输入“被雨水淹没的赛博城市”,世界模型就能自动生成符合物理规律的动态场景——雨水会顺着建筑流下,车灯会在水面反光,NPC会躲雨。

我认为最关键的突破是:AI第一次拥有了“常识”——不是书本里的常识,是能用来行动的常识。

但世界模型的风险,也比任何AI技术都更隐蔽。 最棘手的是“系统级幻觉”:大语言模型的幻觉是编错一个名字,而世界模型的幻觉,是构建了一套错误的物理规则——比如它认为“装满书的纸箱比塑料架轻”,机器人就会真的把纸箱压上去。这种错误藏在模型的“认知底层”,根本没法用“事实核查”发现。 权力集中的问题也被放大:未来可能只有Google、OpenAI这样的巨头,能负担起训练世界模型的算力——这意味着它们掌握了“预测世界”的能力,小到股市波动,大到社会行为,都可能被精准推演和影响。 更不用提虚拟与现实的边界模糊:当世界模型能生成和现实毫无差别的AR场景,我们可能会分不清自己是在真实世界,还是在AI构建的“平行宇宙”里。

2026年的AI圈,像极了1969年的阿波罗计划——所有人都盯着同一个目标:让AI真正“理解”世界。大语言模型是AI的“语言器官”,而世界模型,是AI的“大脑”和“眼睛”。 从1943年的心理学假设,到2026年的产业落地,世界模型走了83年。它不是AGI的终点,却是AI从“工具”变成“智能体”的关键一步——就像人类学会了“想象”,才从猿变成了人。 智能的本质,是能预测未发生的未来。 当AI终于学会这一点,我们面对的将不再是一个会聊天的程序,而是一个能和我们一起感知、思考、行动的“存在”。