对抗知识焦虑,从看懂这条开始

App 下载

AI Agent进化的核心:模型与Harness协同飞轮

长期协作|技能固化|执行链条|Harness系统|AI智能体|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

长期协作|技能固化|执行链条|Harness系统|AI智能体|人工智能

当你打开一款AI工具,第一句话往往藏着它的底层逻辑。有的说“你可以问我任何问题”,有的只留下空白默认你懂它,直到有一款工具说“我们一起做事”——这背后不是交互设计的差异,而是AI Agent从“单次问答工具”到“长期协作伙伴”的进化拐点。

过去我们评判AI,只看“这次答得准不准”;但现在,真正的竞争力藏在更长的执行链条里:它要调工具、记上下文、沉淀经验,甚至把高频动作固化成可复用的技能。这一切的实现,依赖于模型与Harness系统的协同进化——前者是智能引擎,后者是让引擎真正落地干活的“机甲外壳”。为什么这种协同会成为AI进化的下一站?

你可以把大模型想象成一台超级跑车的引擎——马力十足,但没有底盘、方向盘和刹车,只能在原地空转。Harness就是这整套支撑系统:它给模型接上工具调用接口,让它能查资料、跑代码、读文件;它搭建持久记忆库,让AI能记住上周你说过的偏好;它设计反馈闭环,让AI做完任务后能复盘哪里错了,下次改进。

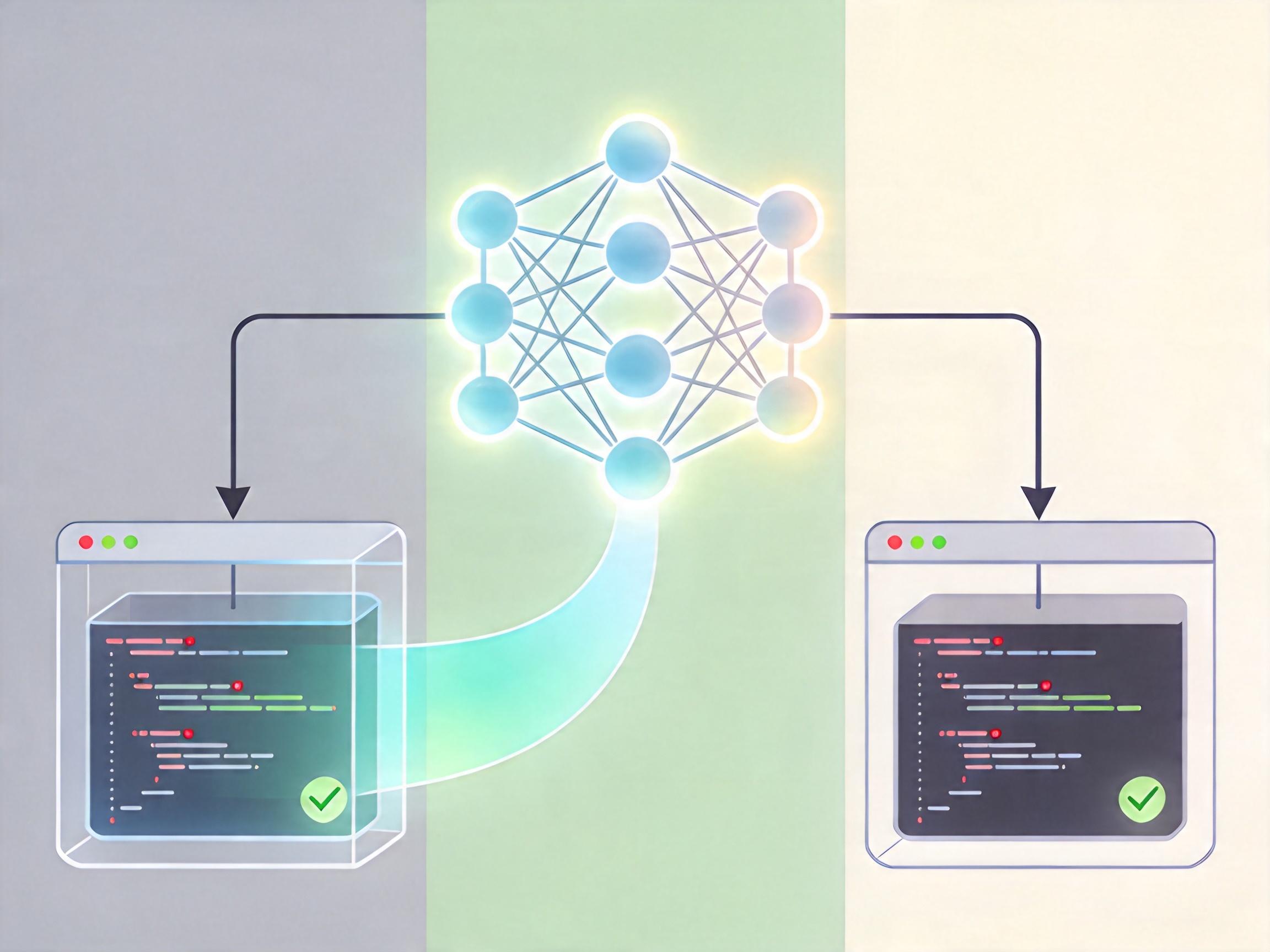

最直观的例子是代码生成任务:模型本身能写出代码,但它不知道怎么运行测试、怎么根据报错修改、怎么把代码提交到仓库。而Harness会自动给它搭一个安全沙箱,让代码在隔离环境里运行,把测试结果和报错信息反馈给模型,直到代码通过所有校验。在这个过程中,模型负责“想”,Harness负责“做”和“记”,二者缺一不可。

更关键的是,Harness能把重复的工作沉淀成“技能”。比如你让AI分析过一次GitHub仓库,Harness会把“调用工具查活跃度、对比竞品、生成框架图”这一系列步骤固化成一个可复用的技能包。下次你再扔给它一个仓库链接,它会直接调用这个技能,不用你再重复提要求。这就是AI从“单次服务”到“长期助手”的核心转变。

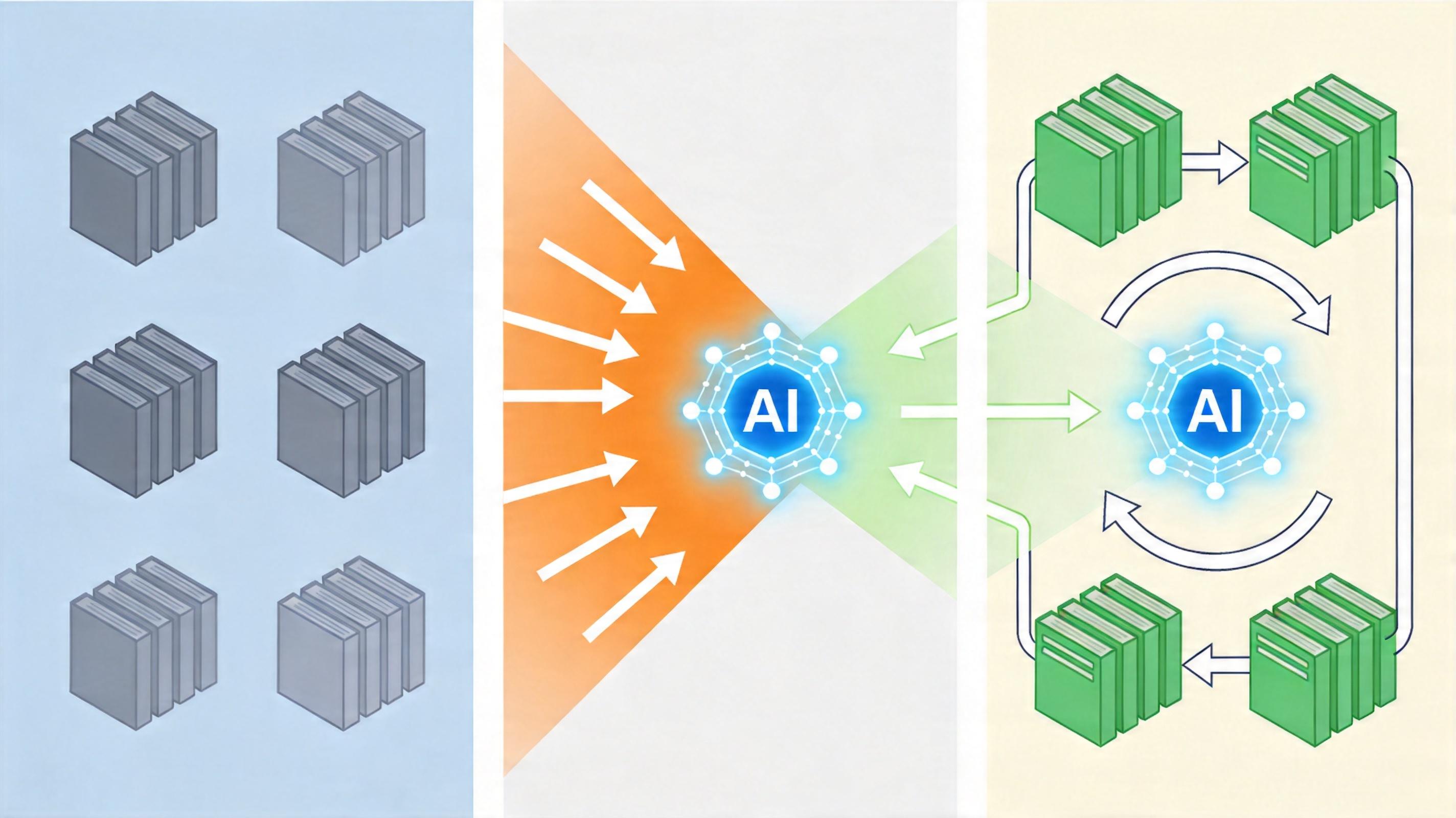

过去的AI系统里,模型和Harness是“先后关系”:先有一个强大的模型,再给它套上Harness外壳。但现在,二者变成了“共生关系”——Harness在真实任务中收集的数据,会反过来优化模型;模型能力的提升,又会推动Harness迭代出新的功能。

比如某团队的实验显示,当模型在Harness的反馈闭环里训练时,它的工具调用准确率从60%提升到了97%。这是因为Harness会把“不该调用工具的时候乱调用”“调用了工具但不会用结果”这些错误案例反馈给模型,让模型在下次训练时专门优化这些场景。反过来,当模型能更准确地判断什么时候该调工具,Harness就可以简化之前的“工具调用审核流程”,让整个系统跑得更快。

这种协同也解决了AI进化的一个关键矛盾:模型的训练数据是“过去的”,但真实任务是“现在的”。Harness的实时工具调用和记忆系统,能给模型补充最新的信息;而模型把这些实时信息处理后沉淀的技能,又会让Harness的技能库越来越丰富。二者形成的“进化飞轮”,让AI能跟着真实世界一起成长。

模型与Harness的协同进化虽然带来了能力跃迁,但也面临着未解决的难题。

第一个挑战是“技能的通用性”。现在AI沉淀的技能大多是针对特定场景的,比如“分析Python项目的GitHub仓库”,换个Java项目可能就失效了。如何让技能能跨场景迁移,是下一步要解决的问题。

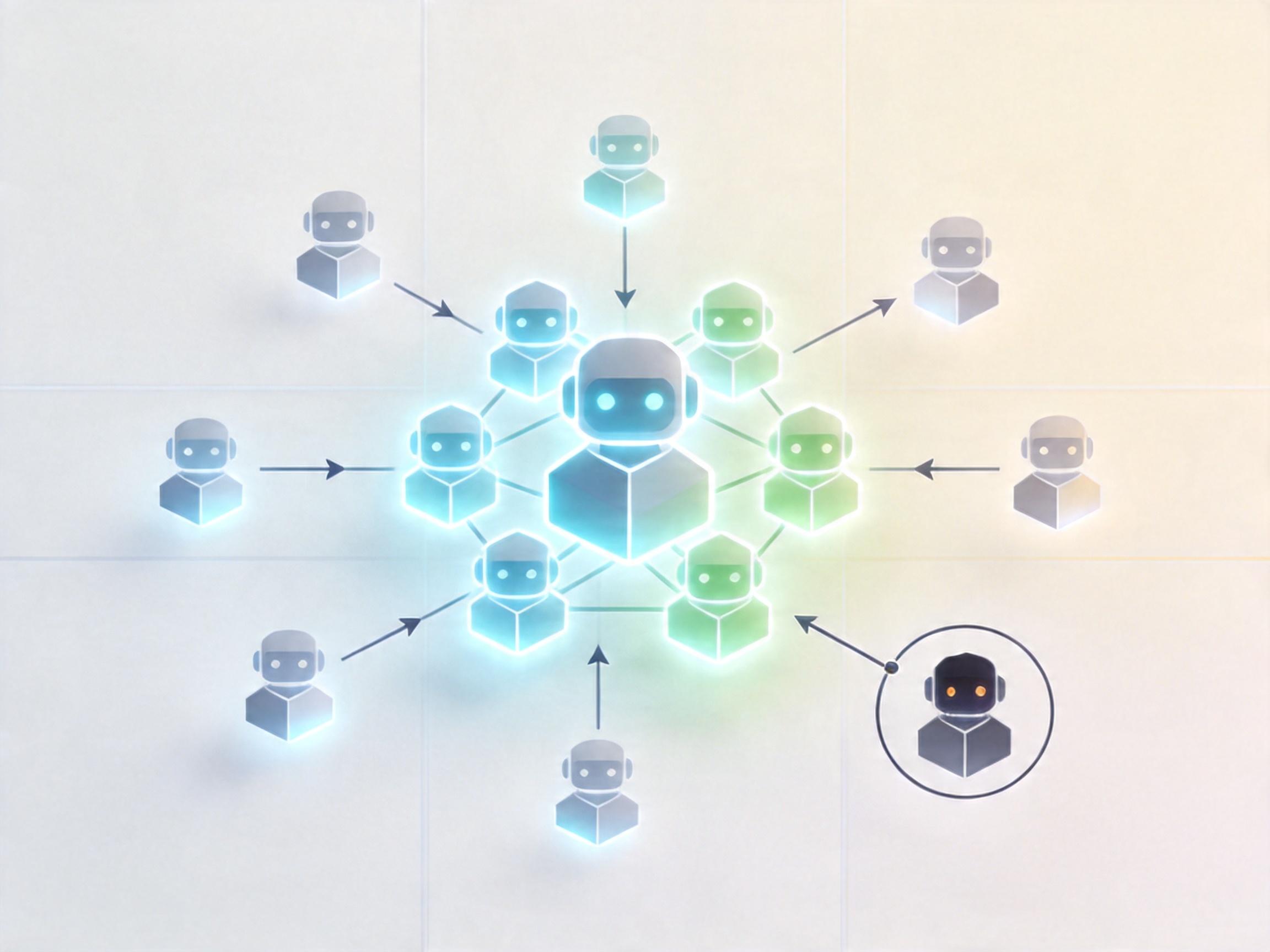

第二个挑战是“多Agent的协调”。当一个系统里有多个AI Agent协同工作时,Harness不仅要管单个Agent的任务,还要协调Agent之间的分工——谁先做什么,谁来审核谁的结果,出了问题谁来负责。这就像管理一个团队,比管单个员工复杂得多。

第三个挑战是“人机协作的边界”。Harness让AI能自动完成很多任务,但在涉及创意、决策的环节,还是需要人类介入。如何设计Harness的“人工干预节点”,既不打断AI的自动化流程,又能保证关键决策的人类控制权,是企业落地时必须面对的现实问题。

当我们谈论AI的进化时,很容易把目光只放在模型参数的增长、benchmark分数的提升上,但真正能让AI走进我们日常工作的,是模型与Harness的协同——是让智能引擎有了能落地干活的手脚,有了能记住经验的大脑,有了能自我改进的闭环。

未来的AI,不会是一个只会回答问题的“聊天框”,而是一个能和你一起解决问题、一起积累经验、一起成长的伙伴。智能的本质,从来不是孤立的强大,而是协同的进化。而模型与Harness的协同飞轮,正带着我们走向这个未来。