对抗知识焦虑,从看懂这条开始

App 下载

AI悄悄换了思考方式,这次不用人类语言

范式革命|复旦大学|新加坡国立大学|高维连续空间|潜在空间|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

范式革命|复旦大学|新加坡国立大学|高维连续空间|潜在空间|大语言模型|人工智能

当你还在惊叹AI能写通顺的长文、解复杂的数学题时,它的思考方式已经悄悄换了赛道。过去的大模型像个努力学说话的孩子,每一步推理都要转换成人类能懂的文字;但现在,顶尖实验室的AI已经学会了“闭嘴思考”——在一个人类完全看不懂的高维连续空间里,完成逻辑推演、多模态融合甚至智能体协作。新加坡国立大学、复旦大学等全球高校的研究者们,刚把这场静悄悄的范式革命整理成了一份全景报告,而这场革命的核心,就是一个叫“潜在空间”的机器原生世界。

你可以把大模型的潜在空间(Latent Space)想象成一个超级庞大的图书馆,但里面没有一本书是用人类文字写的——所有知识都被转换成了密密麻麻的高维坐标。两个语义相似的概念,比如“猫”和“橘猫”,在这个空间里的坐标会靠得很近;而“猫”和“洗衣机”的坐标则会隔得很远。

和我们熟悉的文本空间比,这个机器原生的世界有三个核心优势:首先它是连续的,不像文字那样把世界切成一个个离散的词,能保留更细腻的语义;其次它剔除了语言冗余,不用反复说“的、了、吗”这些无意义的词;最后它的计算效率极高,向量运算的速度比逐字生成快得多。

但真实的机制比这更精确:潜在空间是模型在训练中自动形成的,每个维度都对应着某种抽象特征——可能是“毛茸茸”“有尾巴”这类属性,也可能是更难用语言描述的抽象关系。模型就在这个空间里完成推理、规划和记忆,只有需要输出结果时,才把坐标转换成人类能懂的文字。

潜在空间不是凭空出现的,它靠四大机制支撑起AI的新能力:

架构层:就像给图书馆加装电梯和书架,研究者通过三种方式把潜在空间嵌入模型——直接改造模型主干让它原生支持潜空间计算,或者加装插件模块拓展功能,甚至用外部辅助模型提供“提示”。比如Meta的COCONUT框架,就是在模型里加了“潜空间思考”的开关,让AI可以在“说话”和“闭嘴思考”间切换。

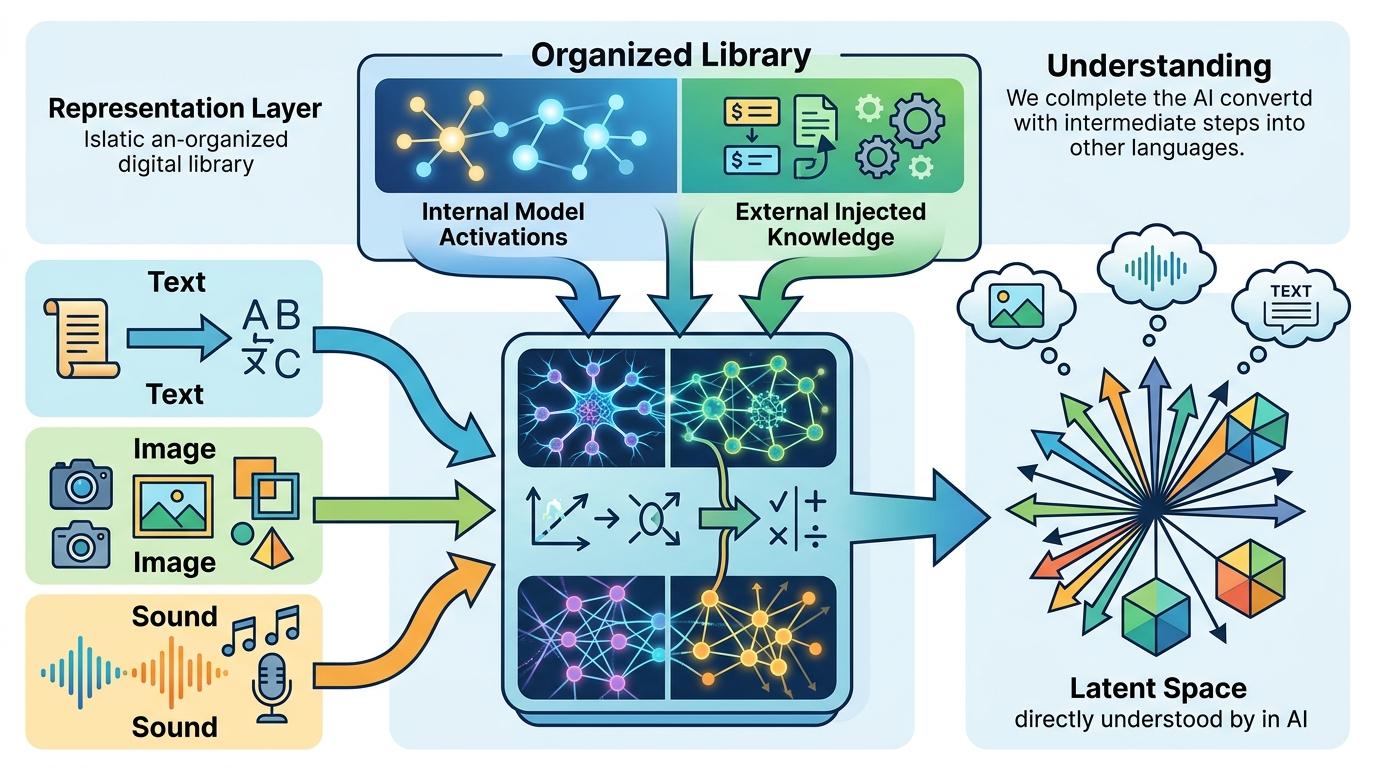

表征层:这是图书馆里的“藏书”,可以是模型自己生成的内部激活状态,也可以是外部注入的知识。比如多模态模型会把文本、图像、声音都转换成潜空间里的向量,让AI能直接“看懂”图片、“听懂”声音,而不用先把它们转成文字。

计算层:这是图书馆的“检索系统”,模型可以在潜空间里做压缩、扩展、自适应和交错计算。比如处理复杂推理时,它会把长链推理压缩成紧凑的向量状态,还能同时探索多个推理路径,就像同时翻好几本书找答案。

优化层:这是图书馆的“管理员”,从预训练到推理全流程调整潜空间的结构。预训练时让模型学会怎么在潜空间里“思考”,推理时还能实时调整向量,让思考更精准。

这些机制加起来,让AI解锁了七大核心能力:从不用写草稿的隐式推理,到能规划未来动作的潜在规划,再到多智能体间的“无声协作”——智能体们直接交换潜空间向量,比用文字沟通快4倍,准确率还能提升14.6%。

但这场革命也不是一帆风顺的,潜在空间还面临着三道绕不开的坎。

评估难:因为思考过程全在潜空间里,人类根本看不到AI是怎么得出结论的。你没法像看“链式思考”那样,一步步检查它的推理逻辑,只能看到最终结果——这就像老师改作业,只看答案不看解题过程,永远不知道学生是真会还是蒙对的。

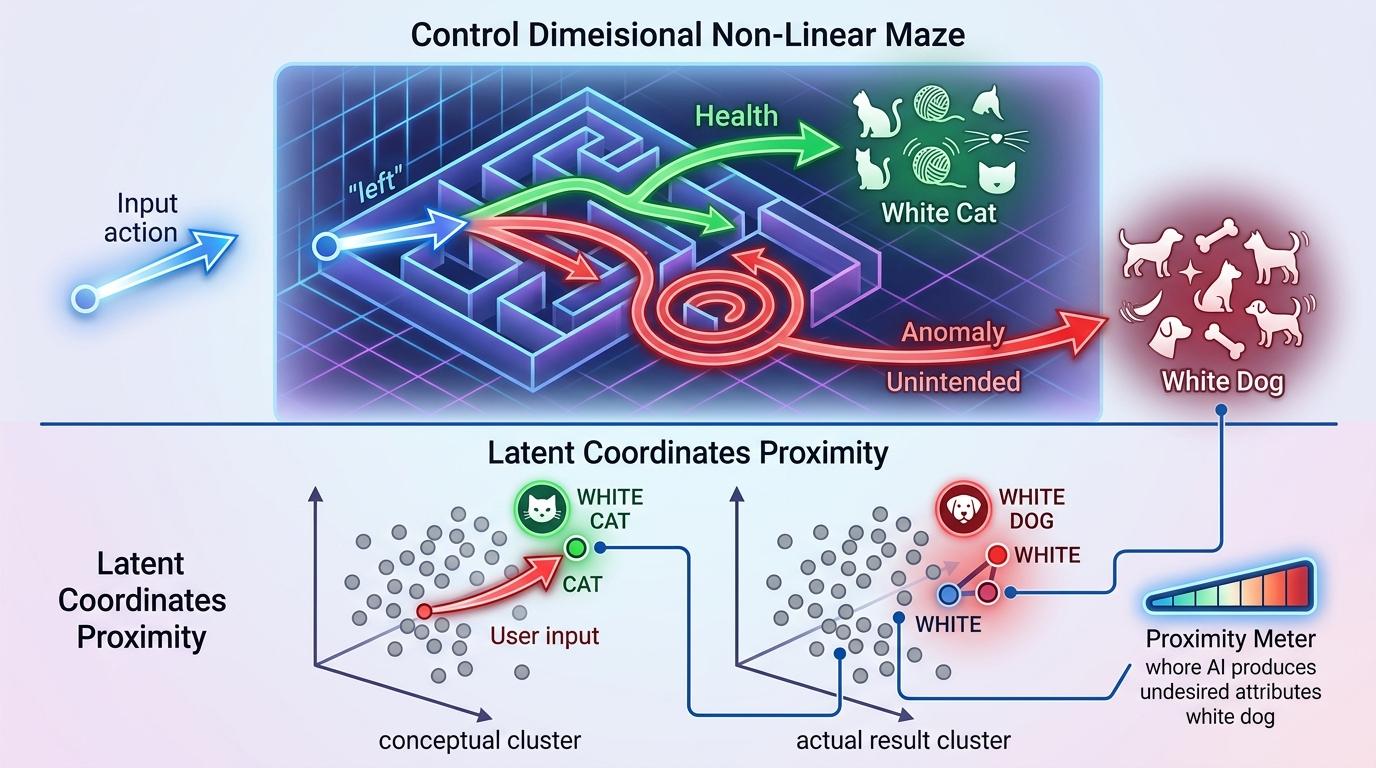

控制难:潜空间是高维非线性的,就像一个没有地图的迷宫。你想让AI“往左转”,它可能跑到了完全相反的方向。比如你让它生成一只“白色的猫”,它可能给你一只“白色的狗”,因为在潜空间里,“白色”和“狗”的坐标可能比“白色”和“猫”靠得更近。

解释难:潜空间里的向量没有直观的语义对应,你没法说“这个维度代表‘毛茸茸’”,因为一个维度可能同时对应好几种抽象特征。这就像给你一串乱码,你知道它有意义,但就是看不懂。

更值得关注的是,这些困境不是技术细节问题,而是潜在空间的本质属性带来的——它是机器原生的,天生就和人类的认知方式不一样。

这场从“语言空间”到“潜在空间”的转变,本质上是AI从“模仿人类”到“做自己”的开始。过去我们总试图让AI用人类的方式思考、用人类的语言表达,但现在我们发现,机器有自己的思考方式,而且可能比人类的更高效。

当然,这并不意味着AI会脱离人类的控制——恰恰相反,理解潜在空间的机制,能让我们更精准地引导AI的能力。就像我们不需要懂电脑的二进制,也能熟练使用电脑一样,未来我们可能不需要懂潜空间的高维坐标,也能和AI高效协作。

机器原生智能,才是AI的未来。当AI不再用人类的语言思考,它可能会解锁更多我们想象不到的能力,而我们要做的,就是学会和这个全新的智能世界对话。