对抗知识焦虑,从看懂这条开始

App 下载

只训5秒视频,AI能生成3小时不崩坏的画面

噪声注入|腾讯混元|中科大|自回归模型|长视频生成|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

噪声注入|腾讯混元|中科大|自回归模型|长视频生成|多模态视觉|人工智能

想象你让AI生成一段3小时的旅行视频:开头是清晨的西湖断桥,镜头跟着你走过苏堤,午后钻进河坊街的小吃店,傍晚爬上宝石山看日落——全程画面连贯,人物动作自然,没有中途突然变脸、场景瞬移,也不会走着走着画面变成一团糊。这在以前是天方夜谭,自回归视频生成的老毛病就是「越往后越崩」,微小误差像滚雪球一样把画面彻底砸烂。但今天,中科大、港中文、腾讯混元等团队联手把这个天方夜谭变成了现实。他们只给AI看了5秒的训练视频,就让它吐出了3小时几乎零退化的长视频。这背后的秘密,居然是给AI「留一点噪声」。

自回归视频生成的逻辑本来很简单:像写小说一样一段一段生成,先画好前10秒,再用这10秒当参考画下一个10秒,以此突破显存的物理限制。过去大家都默认,给AI的参考画面必须是「完全干净」的——前一段视频彻底去噪、变成毫无瑕疵的清晰画面,才能给下一段当模板。

但这个默认选项,恰恰是灾难的开始。

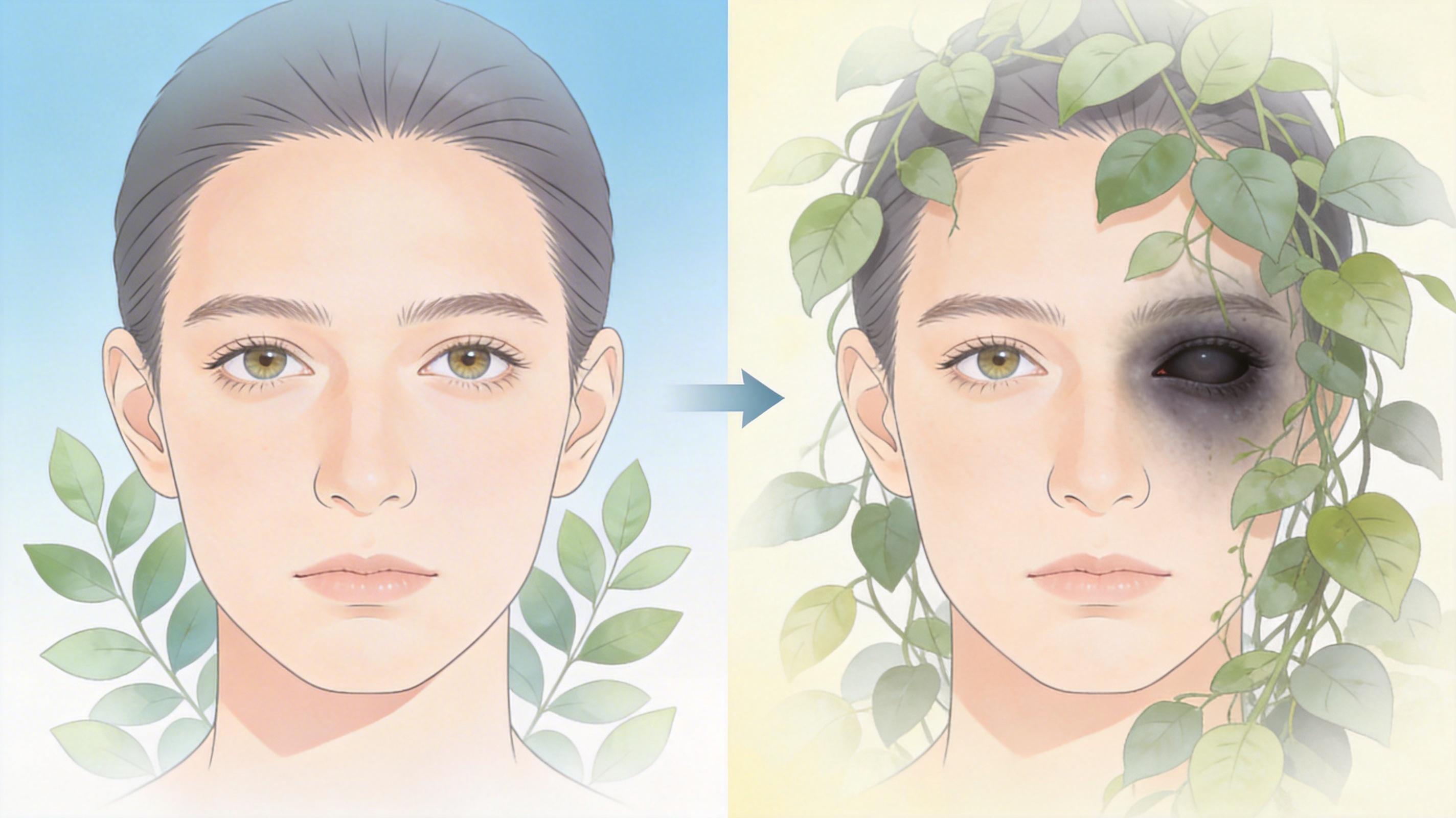

推理时的AI不可能100%精准,前一段画面必然带着微小的误差——比如人物的眼睛多了一个像素的白点,或者背景的树叶位置偏了一毫米。当AI拿到「完全干净」的参考画面时,它会把这些微小误差当成「绝对正确的真实信息」,带着100%的置信度往下画。每一段都把上一段的误差放大一点,几十段之后,人物的眼睛可能会变成黑洞,树叶会长满整个屏幕。

你可以把这个过程想象成传话游戏:第一个人说「今天吃红烧肉」,第二个人传成「今天吃红烧鱼」,第三个人变成「今天吃鲨鱼」——每一次传递都把小误差放大,最后彻底走样。而「干净上下文」就是那个逼着所有人把传话内容当成真理的规则。

团队给这套新方法起了个名字叫HiAR,核心逻辑可以用一句话概括:不让前一段视频彻底去噪,而是让所有视频块共享同一个噪声水平,同步去噪。

具体来说,传统方法是「先把第一段视频洗得干干净净,再用它洗第二段」;HiAR则是「第一段和第二段同时洗,用的是同一盆带点灰的水」。

这个思路来自双向扩散模型——那种能同时从过去和未来帧生成视频的模型,它不需要某一段画面绝对干净,只要所有画面的噪声水平一致,就能保持时序连贯。HiAR把这个逻辑搬到了自生成里:每一个去噪步骤,所有视频块都处于相同的噪声强度下,前一段不用彻底变干净就能给后一段当参考。

这样一来,AI就不会把前一段的微小误差当成真理——因为参考画面本身带着噪声,AI会默认「这中间可能有误差」,反而会更关注画面的整体逻辑,而不是抠着一个像素的白点不放。误差的雪球滚不起来了,画面自然就不会崩。

更妙的是,这种同步去噪的结构天然支持流水线并行推理——不同GPU可以同时处理不同视频块的去噪步骤,不用等前一个块彻底完成。团队测试,在4步去噪的设置下,HiAR的推理速度比传统方法快了1.8倍,吞吐量能到30fps,单块延迟只有0.3秒,已经能满足实时流式生成的需求。

解决了崩坏问题,团队又遇到了新麻烦:AI会偷懒。

自回归模型在训练时很容易走捷径——与其生成复杂的动作,不如让画面尽量不动,这样损失最低。很多长视频生成模型最后都会变成「幻灯片」,人物站在原地不动,背景也没变化。

为了逼AI动起来,团队给HiAR加了个「前向KL正则化」的约束。简单说,就是在训练时让AI同时参考过去和未来的帧(用双向注意力机制),计算它生成的动作和真实动作的差异,逼着它去学习多样的运动模式,而不是一直停留在「不动」的舒适区。

在VBench长视频基准测试里,HiAR拿到了最低的漂移分数——0.257,比所有传统方法都低。这意味着它生成的20秒视频里,几乎看不到时序漂移、人物变脸、场景瞬移这些老毛病。更夸张的是,它只在5秒的视频数据上训练,就能生成3小时的长视频,全程画面质量几乎没有退化。

当然,它也不是完美的——现在用的是1.3B的小模型,极长时序下偶尔会出现语义不连贯的问题,比如人物走着走着突然换了个场景。但团队说,这是模型容量的问题,不是HiAR范式本身的缺陷,换个大模型就能解决。

HiAR的突破,本质上是一次「回到源头的纠错」——我们以为AI需要绝对干净的输入,却忘了真实世界里从来没有绝对的完美。给噪声留一点空间,反而能让AI学会抓住更本质的逻辑。

这让我想起摄影里的「欠曝技巧」——故意让画面暗一点,反而能保留更多暗部细节,拍出更有层次的照片。AI生成也是一样,追求绝对的干净往往会带来绝对的崩坏,接受不完美,反而能走得更远。

「留一点噪声,换无限可能。」未来的长视频生成,或许会从「如何消除误差」转向「如何利用误差」——毕竟,真实的世界,本来就带着一点噪声。