对抗知识焦虑,从看懂这条开始

App 下载

自动驾驶卷错了方向?路侧传感器才是真大脑

麻省大学阿默斯特分校|交通预测|基础设施中心世界模型|路侧传感器|自动驾驶|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

麻省大学阿默斯特分校|交通预测|基础设施中心世界模型|路侧传感器|自动驾驶|人工智能

当Waymo、NVIDIA还在给单车装“大脑”,让AI盯着车头那点视野脑补未来时,麻省大学阿默斯特分校的团队悄悄换了个思路:把路口的摄像头和激光雷达,变成能俯瞰全局的“交通预言家”。

你有没有过这样的经历:开车到路口,刚变绿灯就被侧面窜出的电动车吓出冷汗?车载传感器永远有盲区,但路口那台24小时站岗的摄像头,早把这个路口三年来所有的“鬼探头”“抢红灯”记在了心里。

这就是他们提出的基础设施中心世界模型——让路侧传感器不再只是“监控器”,而是变成能理解、预测甚至调控交通的智能大脑。为什么这个思路可能比单车自动驾驶更靠谱?

你可以把车载传感器想象成一张撒开的网——它能跟着车跑遍大街小巷,见识各种路况,但在每个路口都只能停留几分钟,像蜻蜓点水;而路侧传感器是一口深扎在路口的井,它不挪窝,但能连续几年盯着同一个地方,把早高峰的右转车流规律、雨天行人闯红灯的概率、甚至三年一遇的惊险避让都记下来。

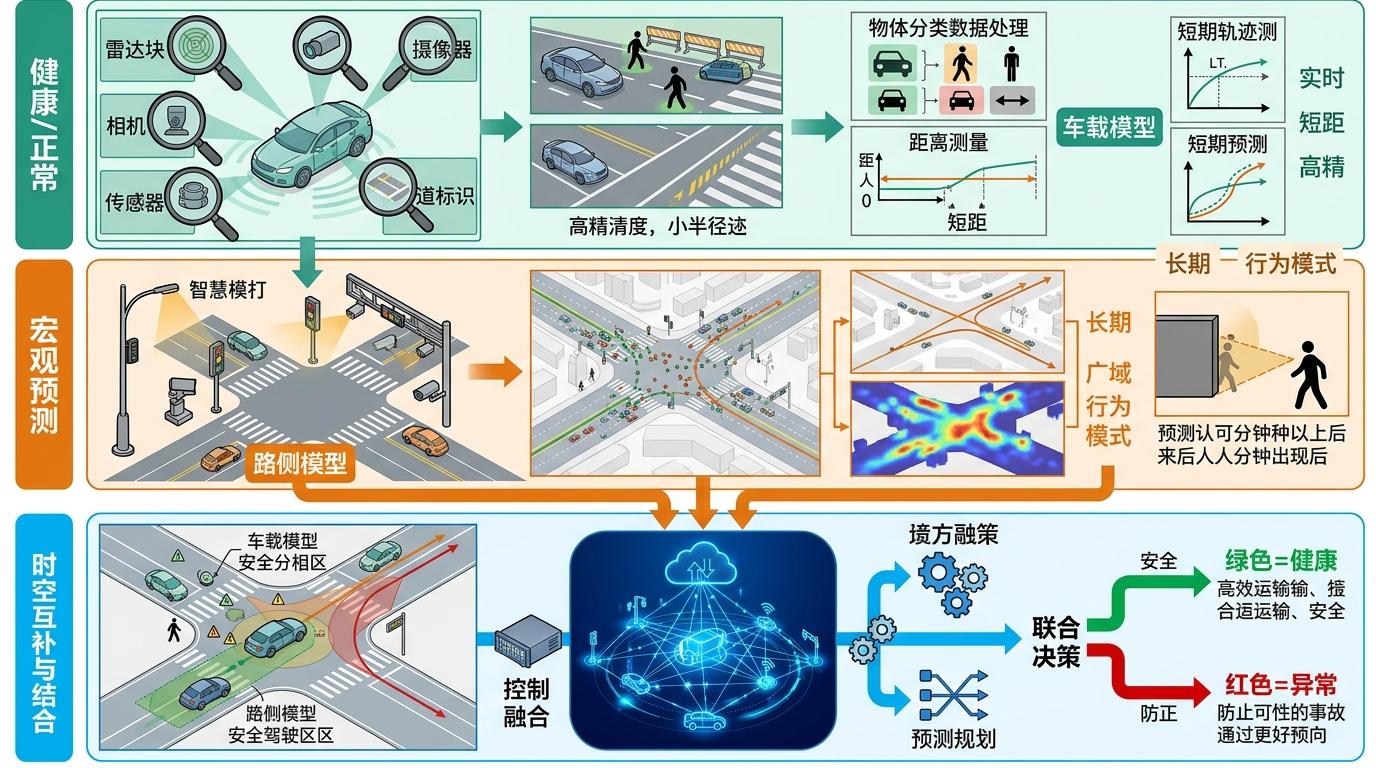

这种“时空互补性”,正是I-WM的核心逻辑:车载模型管“微观”——精准感知车身周围的细节;路侧模型管“宏观”——掌握整个路口的长期行为模式。两者结合,才能既看到眼前的车,也预见三分钟后可能窜出来的人。

更关键的是,路侧传感器能积累车载传感器一辈子都碰不到的“稀有样本”——比如一辆车在绿灯时突然急刹、行人突然从绿化带窜出。这些极端场景是自动驾驶最需要的训练数据,却恰恰是单车最难碰到的。

要让路侧传感器从“监控器”变“大脑”,不能直接把车载模型搬过来。麻省大学的团队设计了一套务实的双层架构:

第一层是“无标注感知引擎”——先解决路侧数据的痛点:没人能给每个路口的每帧数据都手工标注车辆和行人。这一层用无监督算法自动分离背景和移动物体,给每个检测到的目标打上“置信度标签”——比如远处被遮挡的车,可信度只有60%;雨天的激光雷达数据,打个80分。这些带“靠谱程度”的结构化数据,就是喂给上层的“营养餐”。

第二层是“生成式世界模型大脑”——它像一个内置的交通模拟器,用扩散模型和自回归算法,根据过去10秒的观测,预测未来15秒的路口场景:哪辆车会变道,行人会不会闯红灯,甚至能推演“如果刚才的货车没刹车会怎样”这种反事实场景。为了不让AI脑补出“汽车穿墙”的离谱画面,模型还加入了物理约束——比如车辆的加速度不能超过物理极限。

这种“脏活累活”和“高级智能”分离的设计,既满足了路侧部署快速、免标注的现实需求,又让AI能在高质量数据上高效学习。

这篇论文最难得的是不画饼,给出了一份五年三阶段的落地路线图:

第一阶段1-2年,先搞定“看懂”——用现有3D生成模型,把路侧激光雷达和摄像头的数据变成高保真的数字场景;第二阶段2-4年,学会“预测”——加入物理约束和强化学习,让AI能模拟信号灯变化对车流的影响,甚至帮交通管理部门测试不同的配时方案;第三阶段4-5年,实现“协同”——让车和路的世界模型“脑洞对齐”,车能瞬间获取路侧积累的经验,路侧也能理解单车的局部细节。

但理想和现实之间隔着不少坎:首先是成本,一个路口要装激光雷达、摄像头、4D雷达,再加上跑模型的计算单元,成本是车载传感器的好几倍;其次是隐私,路侧摄像头盯着路口,会不会泄露行人的隐私?还有跨路口的泛化——一个路口学来的规律,放到另一个完全不同的路口还能用吗?

更值得关注的是,这套系统的用户不只是自动驾驶车,更是整个交通系统:它能提前预判碰撞,联动信号灯延长红灯避免事故;能模拟路口改造方案,帮规划者选最安全的设计;甚至能给救护车开“绿波带”,让急救时间缩短几分钟。

当我们还在争论单车自动驾驶什么时候能完全替代人类司机时,I-WM的思路像一扇新打开的窗:自动驾驶的终极目标,从来都不是让每辆车都变成“老司机”,而是让整个交通系统变得更聪明、更安全。

未来的路口可能不再是冰冷的信号灯和摄像头,而是能主动思考的“智能节点”——它记得这个路口所有的故事,能预见可能的危险,还能和路过的车、等待的人“对话”。

从单车智能到路网智能,才是自动驾驶的终极答案。