对抗知识焦虑,从看懂这条开始

App 下载

AI长出“眼”和“手”:CVPR新突破揭示机器感知革命?

机器感知|自动驾驶汽车|无人机协同|ASC实验室|CVPR 2026|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

机器感知|自动驾驶汽车|无人机协同|ASC实验室|CVPR 2026|多模态视觉|人工智能

一个场景正在清晰:当城市被晨雾笼罩,一辆自动驾驶汽车行驶在复杂的十字路口,它的视线被前方的大型卡车遮挡。但在它“看不见”的角落,一架无人机正从空中俯瞰全局,将行人即将闯入车道的预警实时传递给它。这并非科幻电影的片段,而是正在发生的现实。人工智能(AI)正以前所未有的速度进化,从一个被动的、存在于云端的“大脑”,演变为一个拥有实体、能够感知并行动的“具身智能体”。

这场革命的最新注脚,出现在计算机视觉领域的顶级国际会议CVPR 2026上。ASC实验室以7篇主会论文的瞩目成绩,系统性地揭示了AI感知智能的前沿图景。这些研究不再是单一算法的优化,而是对机器如何看、如何听、如何协同、乃至如何“像人一样”行动的根本性探索。

这份成绩单的核心,直指三大突破方向:

这些看似深奥的学术名词,正共同描绘一个未来:一个机器能深度融入物理世界,与人类高效、安全共存的时代。

人类感知世界的奇妙之处,在于我们能无缝融合视觉、听觉、触觉等多种信息。当听到玻璃破碎声,我们会立刻联想到一个具体的画面。长期以来,AI的感知是割裂的,摄像头是摄像头,雷达是雷达。多模态融合的目标,正是要打破这堵墙。

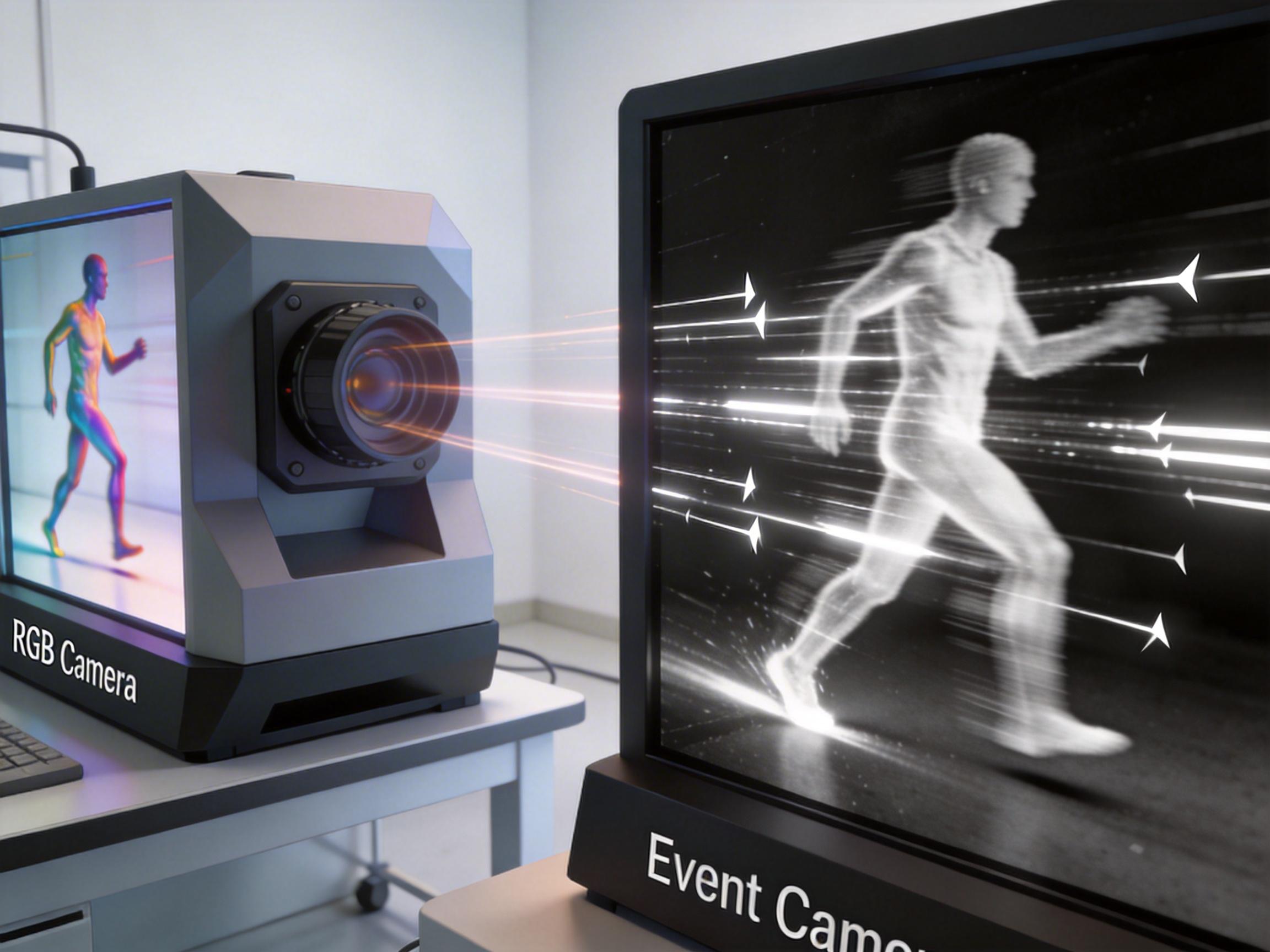

ASC实验室的FlashCap系统给出了一个极佳的范例。传统的动作捕捉依赖昂贵的高速相机,难以普及。FlashCap创新地结合了普通RGB相机与能捕捉光线微秒级变化的事件相机。通过融合两种视觉数据流,它能以毫秒级的精度捕捉人体最快、最细微的动作。这不仅为体育竞技分析开辟了新路径,更意味着AI拥有了超越人眼的“超动态视觉”,能够感知到过去被忽略的物理世界细节。

另一项研究TCFDNet则更为精妙。为了让机器通过步态识别人,它创新地使用文本作为“翻译官”,引导机器理解并对齐来自激光雷达(一堆3D点云)和RGB相机(彩色图像)这两种截然不同模态的数据。大语言模型生成的语义描述,如同一个经验丰富的向导,帮助AI在混乱的异构数据中找到了识别身份的关键共享特征。这标志着AI的感知不再是冷冰冰的数据匹配,而是开始借助人类的语言知识进行更高维度的理解与推理。

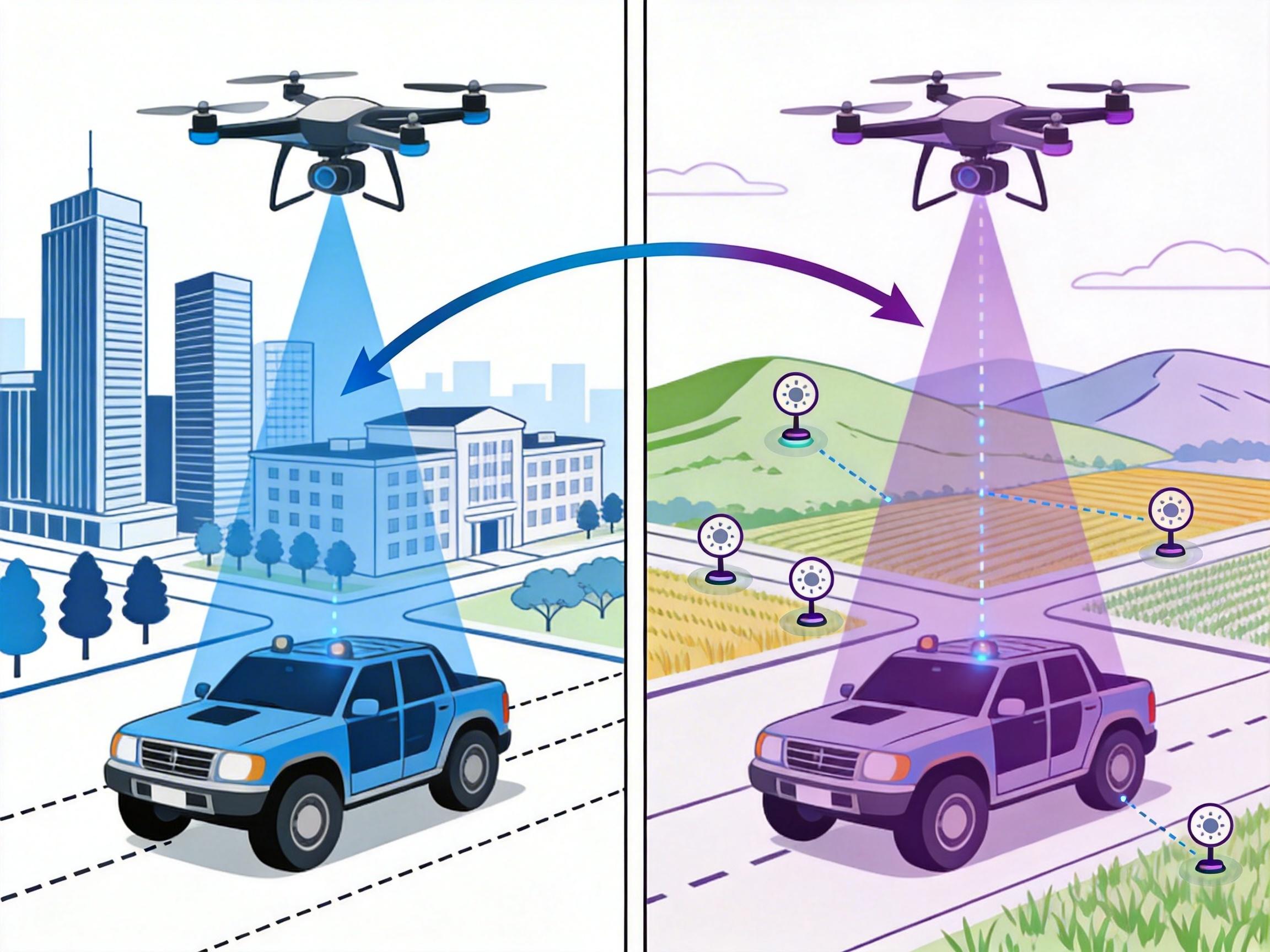

如果说多模态融合是让单个智能体变得更“聪明”,那么协同感知就是让一群智能体组成一个“超级大脑”。自动驾驶面临的最大挑战之一便是“视线遮挡”。一个再智能的单车,也无法看到被建筑物挡住的行人。

ASC实验室为此推出了全球首个大规模真实场景下的车与无人机协同感知数据集V2U4Real。研究团队在城市、校园、乡村等多种复杂环境中,让地面车辆与无人机协同工作。无人机从空中提供的广阔视野,完美补充了车辆因遮挡、盲区和距离受限的地面视角。实验证明,这种“天地协作”的模式,能显著提升车辆在复杂路况下的感知鲁棒性和远距离探测能力。这不仅是技术的突破,更是一种全新范式的确立:未来的智能交通系统,将是一个由无数个移动“神经元”(汽车、无人机、路边传感器)组成的分布式感知网络,彻底消除信息孤岛。

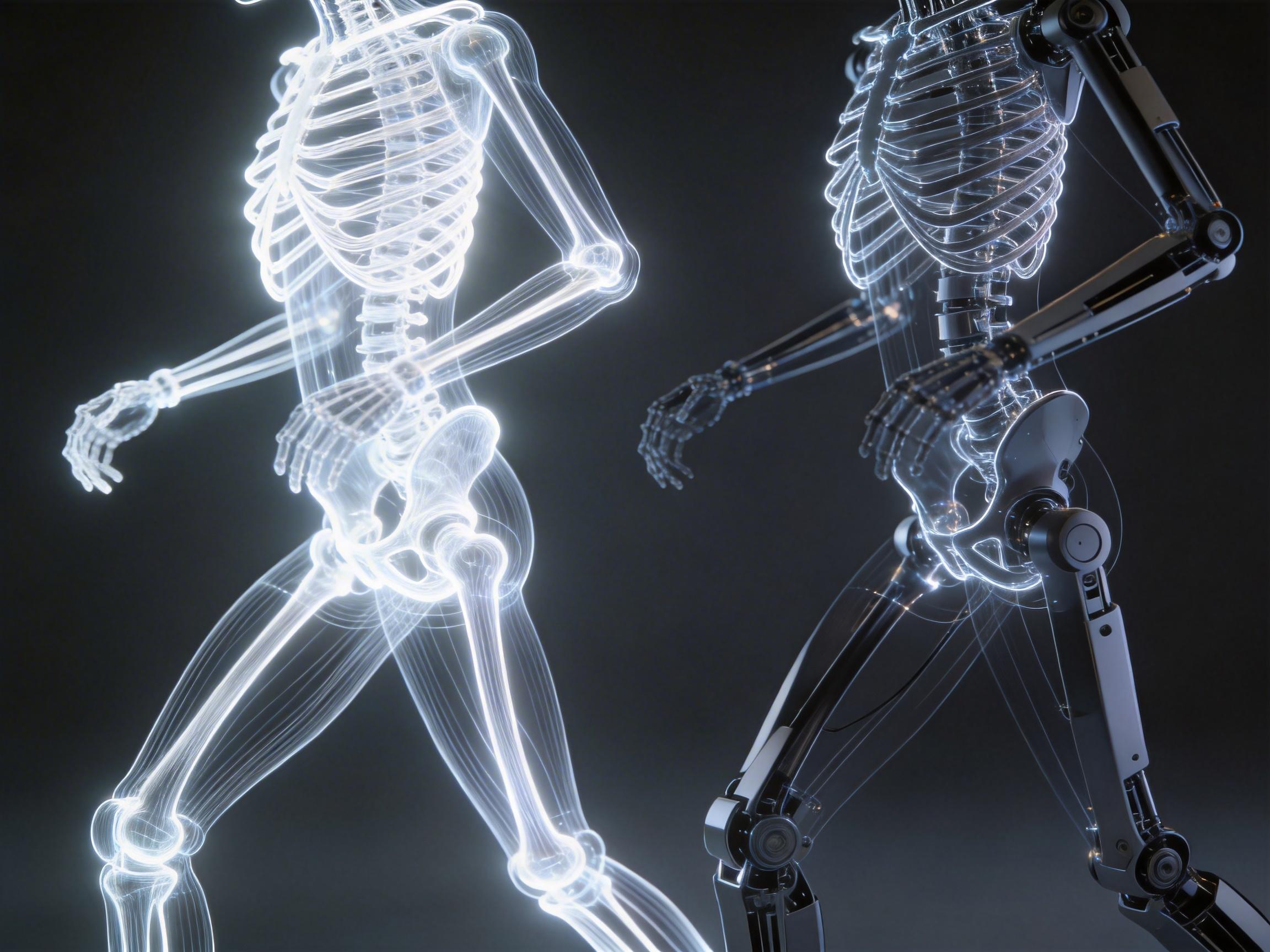

随着机器人动作越来越流畅自然,一个终极问题浮出水面:它到底有多“像人”?传统的图灵测试通过对话来判断机器是否智能,但这已无法衡量能在物理世界行动的具身智能体。

为此,ASC实验室受图灵测试启发,开创性地提出了**“机器人行为图灵测试”(Robot Motion Turing Test)**。这项测试极具巧思:它将人类与机器人的动作数据都剥离掉外观、材质等一切视觉信息,只保留纯粹的运动学骨架,然后让人类观察者来判断,哪个动作来自人类,哪个来自机器人。

研究结果发人深省:即便在“盲测”条件下,当前最先进的人形机器人,其动作在人类观察者眼中依然与真人存在明显差距,尤其在跳跃、拳击等高动态、需要爆发力的场景中,“机器感”尤为突出。这项工作首次为评估机器人运动的“类人程度”提供了一个客观、量化的新范式。它迫使我们思考,具身智能的终点,究竟是完美复刻人类的每一个动作细节,还是在遵循物理规律的基础上,发展出最高效、最适应任务的独特运动模式?这个问题的答案,将深刻影响未来人机协作的形态。

这些前沿研究并非空中楼阁。它们是即将引爆一个万亿级市场的技术引擎。据国务院发展研究中心预测,中国具身智能市场规模有望在2035年突破万亿元。IDC的数据则更为具体,预计到2026年,中国人形机器人的应用场景将增长三倍以上,市场规模翻倍增长。

从ASC实验室的论文中,我们清晰地看到了技术如何转化为生产力:

一个“以模型为中心、软件定义体系、硬件随之重构”的全栈式变革正在发生。基础研究的每一次突破,都在为这个庞大产业的基座添砖加瓦。

当AI拥有了身体,获得了前所未有的感知与行动能力时,新的社会命题也随之而来。一个由无数传感器构成的协同感知网络,如何保障公民隐私?当一个由多个AI智能体共同决策的系统出错并造成损失时,责任该如何界定?

这些问题没有简单的答案,但探索已经开始。从欧盟的《人工智能法案》到中国的《生成式人工智能服务管理暂行办法》,全球都在积极构建与技术发展相适应的治理框架。其核心原则逐渐清晰:人类必须始终拥有最终决定权,AI的行为必须可解释、可追溯、可问责。 我们需要的不是一个“放手让AI跑”的未来,而是一个“人定底线、AI助跑、人控回溯”的稳健体系。

ASC实验室在CVPR 2026上的成果,如同一扇窗,让我们窥见了人工智能的下一个形态。它不再仅仅是语言上的巨人,更将成为行动上的伙伴。通过多模态融合,它获得了理解世界的深度;通过协同感知,它拓展了感知的边界;通过对“类人”行为的不断探索,它正在学习如何与我们更和谐地共存。

这场深刻的变革,最终指向的可能不是机器取代人,而是一种全新的人机共生关系。在这个关系中,人类的角色或许将从任务的执行者,转变为智能机器的“牧羊人”——我们负责设定目标、规划方向、守护伦理边界,而AI则作为我们延伸到物理世界的手、眼和腿,去探索和建设一个更广阔的未来。