对抗知识焦虑,从看懂这条开始

App 下载

给原子拍动态照:AI把雪花屏修成高清图

北京理工大学|AI去噪|原子成核过程|高分辨率透射电镜|多模态视觉|先进材料|前沿科技|人工智能

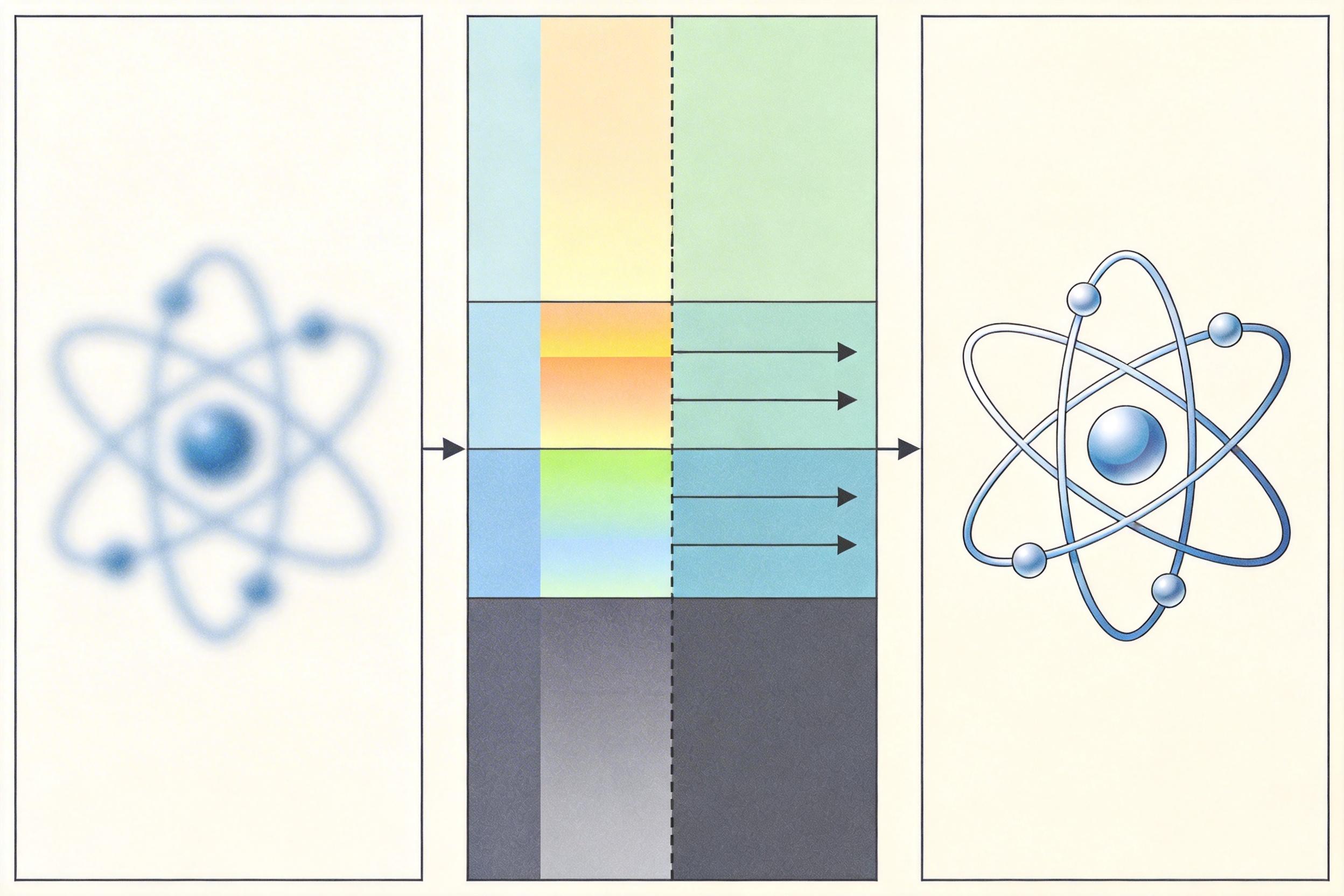

想象你举着高速相机蹲守冰晶凝结,快门按到最快,拍出来的画面却满是雪花——材料科学家用高分辨率透射电镜(HRTEM,能看清原子的“超级相机”)观察原子抱团成晶体的“成核”过程时,就卡在了这一步:要抓毫秒级的原子动态,曝光必须极短,结果原子图像直接被噪声淹没,连专家都分不清哪块是原子哪块是雪花。北京理工大学的团队最近解决了这个难题:他们给AI装了“统计导航仪”,从两个维度联手清噪,还专门造了一套让AI“懂”原子的训练数据。现在,那些被雪花盖了几十年的原子动态,终于能看清了。

不是盲扫雪花,是带着地图清噪

你可以把传统AI去噪想象成拿拖把瞎擦脏玻璃——不管玻璃上是泥点还是花纹,全用一样的力度擦,要么擦不掉泥点,要么蹭花了花纹。HRTEM的原子图像偏偏是最棘手的那种脏玻璃:原子信号弱得像暗处的萤火虫,噪声却亮得像舞台射灯,而且原子还不是整整齐齐排着队,是乱哄哄挤在一起的。

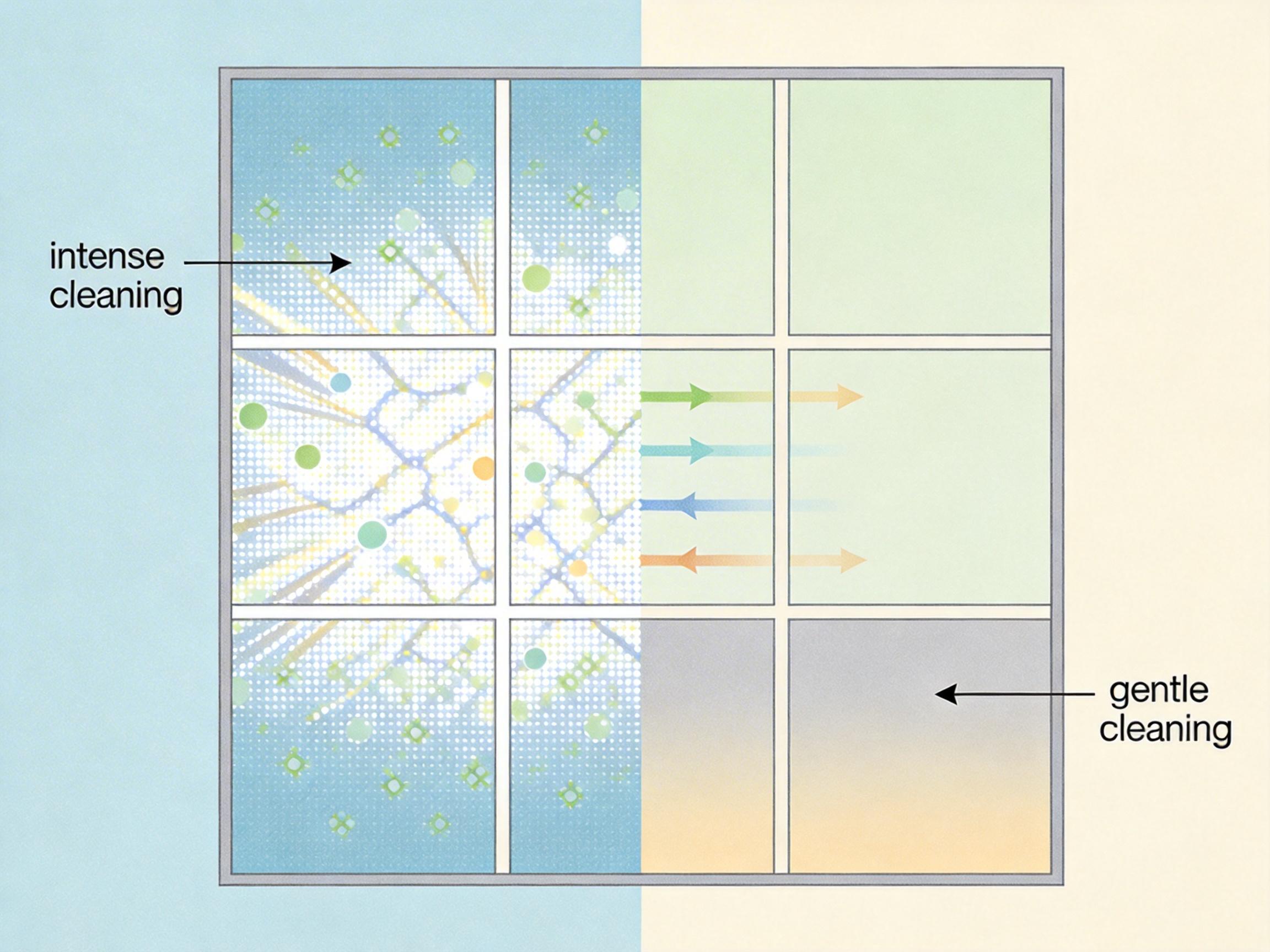

北理工的团队换了个思路:给AI先画张“噪声地图”。他们从两个维度提取图像的统计特征,相当于给AI装了两个导航仪:

一个是**空间偏差导航**——计算每个3×3像素小区域的像素值波动(标准差)。原子中心的像素波动和空白背景的波动完全不同,AI就靠这个判断:这里该用力清噪,那里该小心保留细节。具体来说,AI会先算出一堆不同的“擦玻璃姿势”(卷积结果),再根据每个区域的波动程度选最合适的姿势,就像在油污重的地方用钢丝球,在有花纹的地方用软抹布。

另一个是频段导航——把图像转到频域看。就像听音乐时能分清鼓点(低频)和小提琴(高频),原子的信号和噪声也住在不同的“频率小区”里。AI用通道注意力机制给每个频率小区打分,该增强的加权重,该抑制的减权重,最后再转回到空间域。这相当于先把音乐里的杂音频段消掉,再还原成完整的曲子,比直接在空间域抠杂音精准得多。

这两个导航仪拧成的SCGN网络,就像个有经验的修图师:先看照片哪里脏,再选最合适的工具,而不是拿个滤镜瞎套。

给AI造本“原子写真集”练手

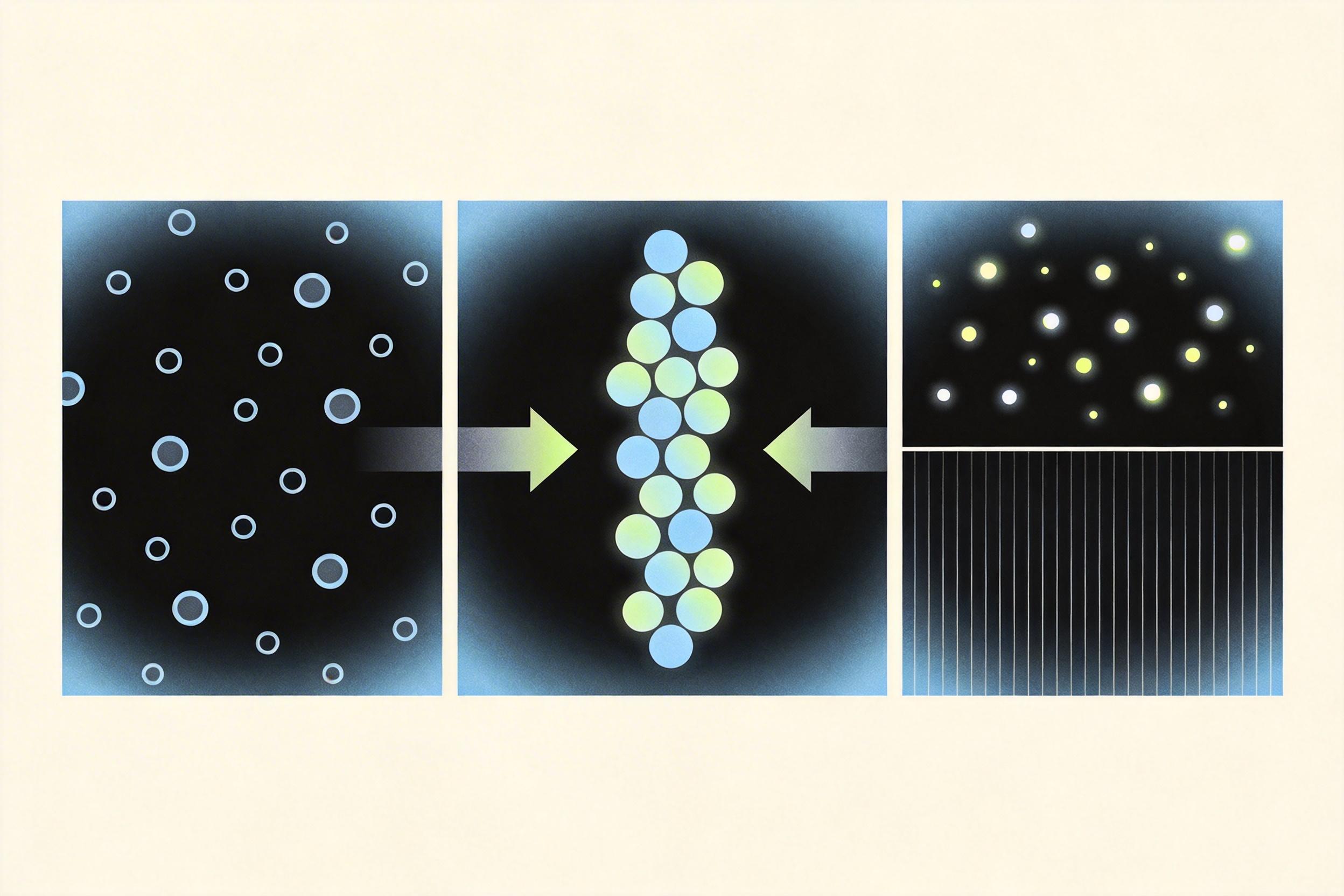

光有好工具还不够,AI得见过真的原子长什么样才行。之前的训练数据集要么是整整齐齐的完美晶体,要么是随便加的模拟噪声,跟真实成核时的乱哄哄原子差太远——就像让学画的人只画过石膏像,突然让他画街头路人,肯定画不像。

北理工的团队干脆造了一本专门的“原子写真集”——NUC数据集:

首先用泊松盘采样生成原子位置,保证原子之间不会挤得重叠,就像在操场上随机站人,还得保持安全距离,模拟成核时原子从无序到有序的真实状态;然后用柏林噪声做背景,模拟电镜里的真空杂纹;最关键的是,他们真的用电镜拍了一堆只有噪声的真空图像,校准出两种真实噪声:一种是每个像素独立的“点噪声”,强度和信号成正比;另一种是同一列像素共享的“列噪声”,强度几乎恒定。

用这个数据集训练出来的AI,就像专门练过画街头路人的画家,再看真实成核的原子图像,一眼就能认出哪个是原子,哪个是噪声。实验数据最能说明问题:在NUC数据集上,SCGN的峰值信噪比(PSNR)比上一代最好的方法高出0.85dB——别小看这0.85dB,在极低信噪比的原子图像里,这就是从“全是雪花”到“看清原子”的差距。

不是修图,是打开原子动态的门

去噪不是最终目的,是为了让科学家能真正研究原子的动态。之前因为看不清,成核过程的很多细节只能靠猜:原子是怎么从无序抱团的?第一个晶核是怎么形成的?现在用SCGN处理后的图像,科学家能清晰看到毫秒级的原子运动,连原子之间的距离和排列变化都能精准测量。

更重要的是,这套思路给其他极端低信噪比的科学图像开了个头。不管是天文观测里被宇宙射线干扰的星系照片,还是生物医学里弱信号的细胞图像,都能用“统计特征导航+双域协同+专用数据集”的模式解决。当然它也有局限:现在只用了标准差和频段两种统计特征,面对更稀疏的原子状态(比如单原子缺陷),还得再升级;而且这套系统是专门针对HRTEM造的,要用到其他领域,还得重新校准数据。

我们总说“看清微观世界”,但微观世界的真相,往往藏在那些被噪声淹没的细节里。过去几十年,材料科学家拿着最精密的电镜,却像戴着雾蒙蒙的眼镜看原子——不是眼镜不够好,是没人帮他们擦干净镜片。

北理工的这套方法,本质上是给AI装了“懂科学的眼睛”:它不是在修图,是在还原被噪声掩盖的原子真相。让AI懂数据的规律,比让AI学更多技巧更重要。未来,当我们能看清更多原子的动态,那些关于材料性能、催化剂效率的秘密,或许就能在这些清晰的动态画面里,找到答案。