对抗知识焦虑,从看懂这条开始

App 下载

给低光图像打一场“攻防战”,噪点终于能治了

噪点抑制模型|IEEE论文|图像增强|图像噪点|低光图像|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

噪点抑制模型|IEEE论文|图像增强|图像噪点|低光图像|多模态视觉|人工智能

你肯定有过这种经历:深夜掏出手机拍路边的小店,预览图黑得像块砖,点开“增强”按钮——画面亮了,可墙上的斑驳、布帘的褶皱全被密密麻麻的噪点糊成了马赛克。明明是想看清细节,结果反而更糟。

2026年3月,IEEE发表的一篇论文,把这个“越亮越糊”的老大难问题,变成了一场针对噪点的“攻防对抗赛”:先在图像的“原生领地”制造出最真实的噪点“攻击”模型,再让模型学会根据噪点类型“见招拆招”。最终的结果是,同样是提亮低光照片,噪点能被精准压制,连衣服的针脚都能看清。这背后到底藏着什么门道?

你手机里的照片,从传感器捕捉光线到变成你看到的JPG,中间要经过ISP(图像信号处理器)的一整套“美颜”:白平衡、色彩校正、伽马压缩……就像把刚从菜园摘的菜,洗切炒成了一盘菜——你能尝到味道,却再也看不到菜刚摘下来的样子。

传统的低光增强方法,全是在这盘“做好的菜”上折腾:要么调调亮度对比度,要么随便撒点“模拟噪点”让模型练手。可真实的噪点,是在“菜园摘菜”的阶段就产生的——传感器捕捉光子时的随机波动(泊松噪声)、电路读取信号时的干扰(高斯噪声),这些噪点和光线强度绑定在一起:越暗的地方,噪点占比越大。

等经过ISP的非线性处理,这些噪点就像混进了一堆调料里,变得面目全非。模型在“做好的菜”上学到的去噪方法,面对真实场景里“从菜园带出来”的噪点,自然就抓瞎了——这就是为什么一增强就满屏噪点:模型根本没见过真正的敌人。

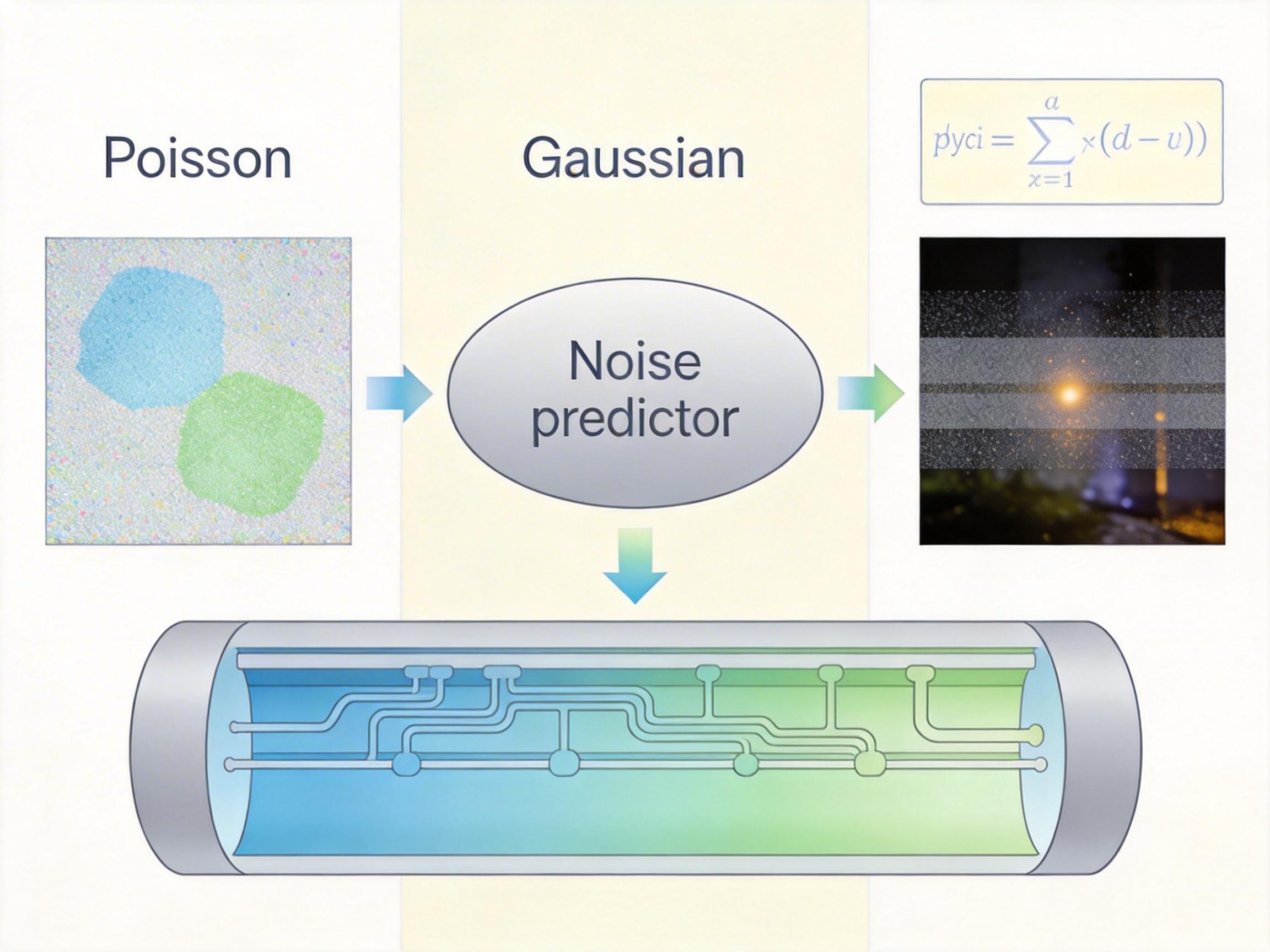

论文的核心思路,是把低光增强变成一场“攻防对抗”:先在图像的“原生领地”(RAW域,也就是传感器刚捕捉到的原始数据)制造出最真实的噪点“攻击”,再让模型学会“防御”。

研究团队设计了一套“物理基础的退化合成”(PDS)模块,它的工作流程像一场精准的模拟战:

用这样的“攻击样本”训练模型,就像让士兵在和真实敌人的模拟对战中练手,而不是对着稻草人挥拳。

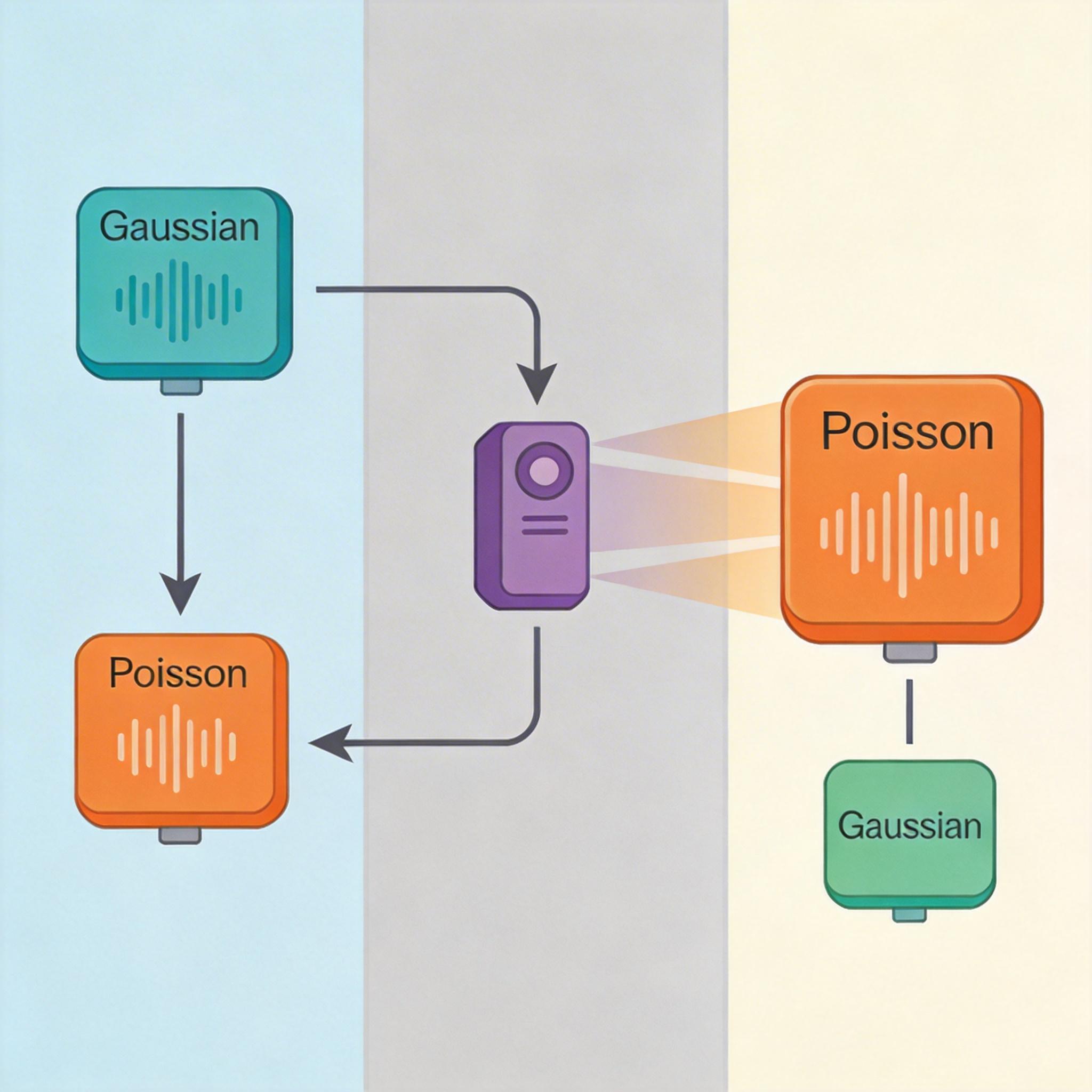

面对“攻击”,模型的防御系统分两层:

更妙的是,这个防御模块是“即插即用”的,可以直接嵌入到现有的低光增强模型里。实验显示,把它加到FourLLIE模型上,PSNR(衡量图像保真度的指标)从22.03提升到22.87,LPIPS(衡量感知质量的指标)从0.285降到0.220——相当于从满屏噪点变成了清晰锐利的画面,而额外增加的推理时间只有3毫秒,几乎可以忽略不计。

不过,这套“攻防战”思路也不是万能的。它的核心依赖于对ISP流程的逆向还原——也就是说,必须知道相机的具体参数,才能精准复刻噪点。如果遇到一些小众相机,或者ISP算法不公开的设备,生成的“攻击样本”就会失真,模型的防御效果也会打折扣。

而且,目前的“攻击”只模拟了噪点,真实低光环境里的退化还有很多:比如手抖导致的模糊、镜头的像差、色彩失真……这些还没被纳入到“攻击库”里。未来如果能把这些退化也用物理模型模拟出来,模型的“防御能力”会更强。

更值得关注的是,这套“物理攻击-自适应防御”的范式,不止能用于低光增强。只要能给某种图像退化(比如雨天的水渍、雾天的模糊)建立物理模型,就能用同样的思路训练出更鲁棒的复原模型——这可能是比低光增强本身更有价值的突破。

从在“做好的菜”上折腾,到回到“菜园”里解决问题,这篇论文其实给整个图像复原领域提了个醒:与其让模型死记硬背“菜谱”,不如让它理解“菜是怎么长出来的”。

当我们开始从物理本质出发,而不是只靠数据堆出来模型,那些困扰了我们很久的“老大难”问题,反而会找到更简单的解法。毕竟,所有的图像问题,本质上都是光的问题——而光的规律,从来都写在物理课本里。

物理先验为骨,数据驱动为翼,才是视觉技术的未来。