对抗知识焦虑,从看懂这条开始

App 下载

靠算法降硬件门槛,这家公司重构物理世界数据采集

天使投资人|机器人学习|算法驱动硬件|物理世界数据采集|Ropedia|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

天使投资人|机器人学习|算法驱动硬件|物理世界数据采集|Ropedia|AI产业应用|人工智能

当你戴着普通头戴设备在厨房做饭——伸手拿锅、拧开燃气、翻炒食材,这套动作在别人眼里是日常,在Ropedia的系统里,却是能让机器人学会做饭的核心数据。2026年3月,这家成立仅半年的新加坡公司拿到了千万美金级种子轮融资,背后站着谷歌、英伟达的天使投资人。他们没做更精密的传感器,也没搞更复杂的硬件,反而要靠算法把物理世界数据采集的门槛拉到最低。为什么一群Meta出身的博士,会把宝押在「用算法反向定义硬件」这件事上?

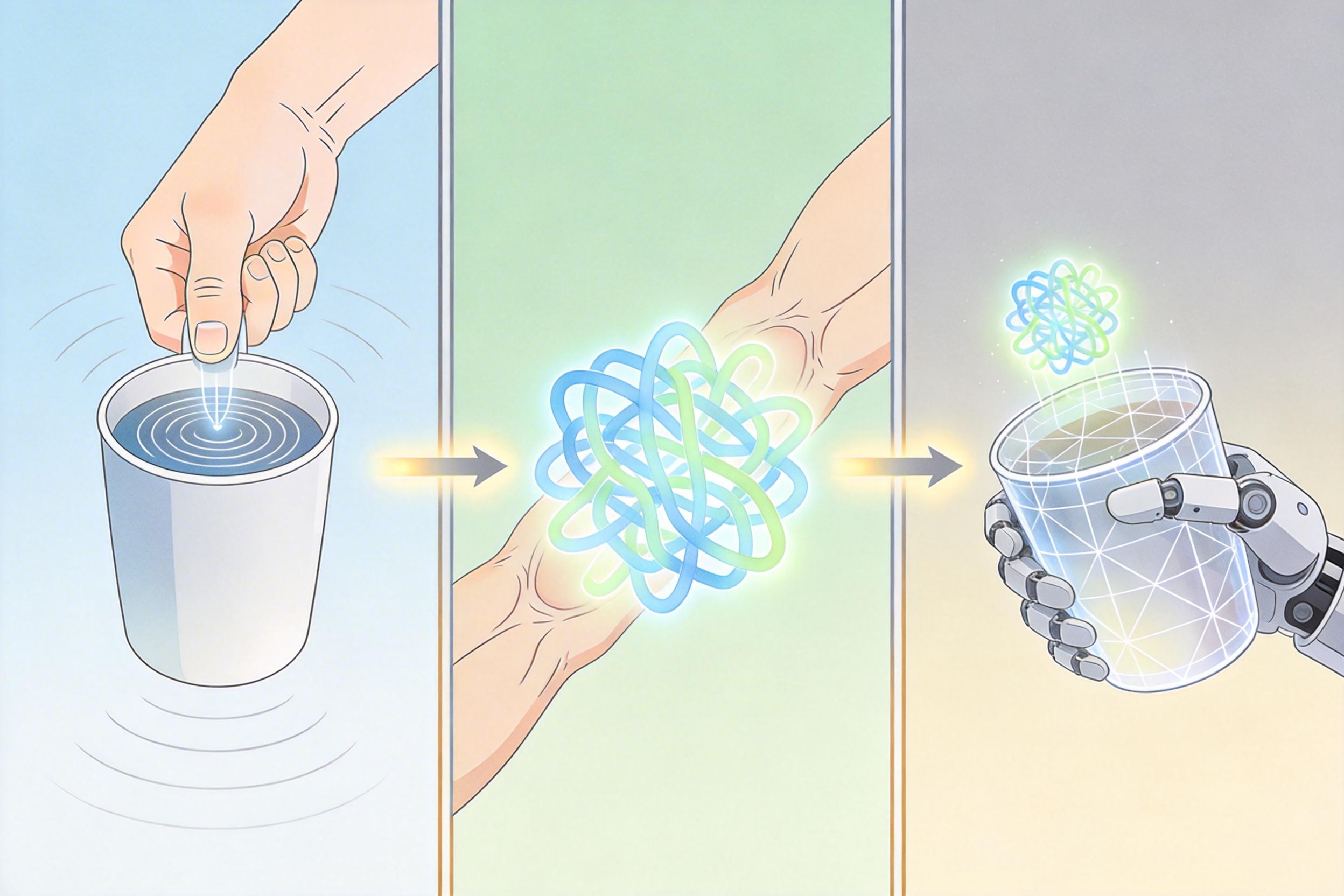

你可以把传统数据采集模式理解成「先买顶配相机,再考虑拍什么」——用最精密的LiDAR、动捕棚,花几十万成本采回一堆原始数据,再花几倍精力去清洗、标注,最后能用来训练机器人的可能不到10%。Ropedia的思路完全反过来:先搞懂机器人「需要学什么」,再用算法定义「该采什么数据」,最后只给硬件配刚好够用的传感器。

这就是他们说的「用算法能力反向定义采集能力」——比如机器人要学「开门」,不需要整个房间的高清3D模型,只需要门把手的位置、手的施力角度、门的转动轨迹这些关键信息。自研的4D重建与对齐算法,能像智能裁剪工具一样,从头戴设备采到的普通视频、动作信号里,自动提取出这些结构化数据,还能还原真实物理尺度——就像把模糊的手绘稿,自动转成带精确尺寸的工程图。

他们的头戴式设备HOMIE,重量和普通耳机差不多,不需要提前在房间里装任何基站,就能在厨房、工厂、医院这些真实场景里采集数据。相比传统动捕设备动辄几十万的成本,这套系统的门槛直接降到了「拿起来就能用」的级别。

过去训练AI,靠的是互联网上的图片、视频——就像让机器人看一万条别人开门的视频,但它永远学不会「握住门把手需要用多大劲」。Ropedia的核心逻辑是:物理世界的智能,必须从「体验」里学,而不是从「观察」里学。

他们提出的「Xperience」数据,就是以第一视角采集的完整体验:你伸手拿杯子时的肌肉运动、手指碰到杯壁的触觉反馈、杯子被拿起时的重量变化,甚至你拿起杯子的意图——这些多模态数据捏合在一起,才是机器人能用来学习的「真实经验」。而自研的空间基础模型,能自动把这些原始体验数据翻译成机器人能懂的语言:比如把「手指施力10牛」转换成代码里的力控制参数,把「杯子倾斜30度水不会洒」转换成物理规则模型。

我认为,这才是真正的突破——不是硬件更先进,而是数据的定义被重新改写了。以前我们把物理世界的数据当成「三维图像」,现在终于开始把它当成「可交互的体验」。这就像给机器人从「看教学视频」改成「亲自上手实操」,学习效率提升的不是几倍,而是一个维度。

2024年全球空间计算机器人市场规模是85亿美元,预计到2034年会涨到804亿美元——这个赛道的玩家已经从硬件厂商、算法公司,变成了抢「数据基础设施」的选手。微软、Meta在搞自己的空间模型,英伟达在推仿真工具,而Ropedia的机会,就在于他们是第一个把「算法-硬件-数据管线」打包成基础设施的公司。

现在他们的客户已经覆盖了北美十多家头部机器人公司,这些公司以前要花几个月时间采数据、做标注,现在用Ropedia的系统,一周就能拿到可用的训练数据。更关键的是,采的数据越多,他们的空间基础模型就越准——就像用得越多越聪明的导航软件,数据和模型形成了正向循环。

当然,这条路也有坎:比如怎么保证不同场景下数据的一致性,怎么解决隐私问题——毕竟要在家庭、医院这些场景采数据,用户的隐私是绕不开的坎。但至少他们已经找对了方向:物理智能的未来,从来不是比谁的硬件更贵,而是比谁能更高效地把真实世界,翻译成机器能学的语言。

当AI终于要从手机屏幕里走出来,走进厨房、工厂、医院这些真实的物理世界,我们才发现,原来最缺的不是更聪明的算法,而是能把「人类的日常」变成「机器的教材」的工具。

Ropedia做的事,本质上是在给物理智能修一条「数据高速公路」——以前要靠人力把真实世界的体验一点点翻译成代码,现在有了这条高速路,机器能直接「上车」学习。算法定义数据,数据定义智能,这不仅是一家公司的技术路线,更是物理智能时代的底层逻辑。

也许再过十年,当机器人能熟练地帮你泡一杯咖啡,你不会想起它背后的GPU算法,只会记得,曾经有人把「戴个耳机做饭」这件小事,变成了改变世界的起点。