对抗知识焦虑,从看懂这条开始

App 下载

开车不用盯屏幕,3D导航直接铺在路面上

驾驶辅助|光学立体视觉|3D导航|抬头显示系统|裸眼3D-HUD|消费电子|前沿科技

对抗知识焦虑,从看懂这条开始

App 下载

驾驶辅助|光学立体视觉|3D导航|抬头显示系统|裸眼3D-HUD|消费电子|前沿科技

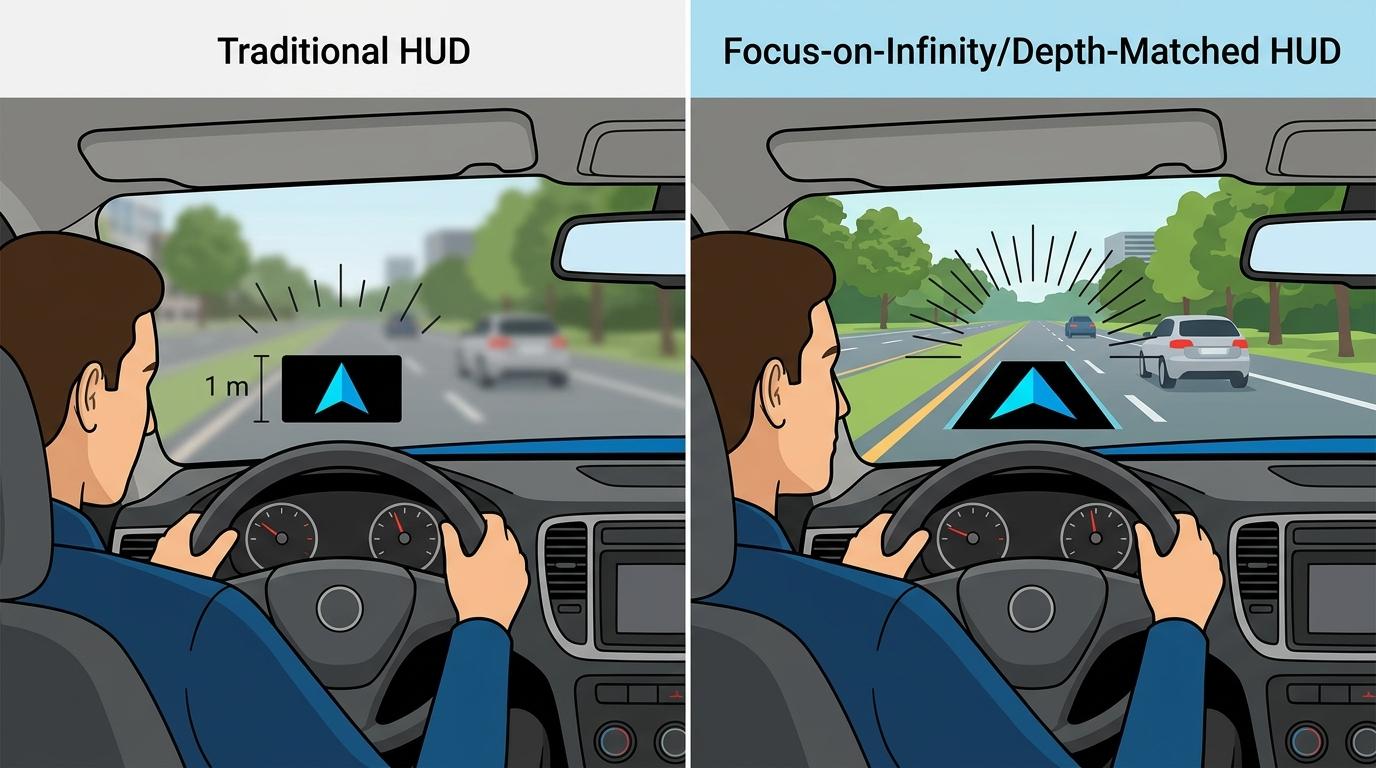

想象你开在高架岔路口,不用低头瞟中控屏,不用眯眼瞅手机支架——前方挡风玻璃上,一个悬浮的3D箭头正“钉”在真实的车道上,车往前开,箭头会跟着缩放远近,和你看真实路面的焦距完全同步。这不是科幻电影的特效,而是已经量产的裸眼3D-HUD(抬头显示系统)。它解决了传统HUD的核心痛点:当你在看远方路况和近处屏幕信息时,眼睛频繁对焦产生的疲劳,甚至可能引发的驾驶风险。而实现这一切的核心,是一套让左右眼“看”到不同画面的光学魔法。

你可以把人眼的立体视觉想象成两台错位的相机——左右眼看到的画面有细微偏差,大脑把这两幅画面一融合,就能判断物体的远近。传统HUD不管是2D还是普通AR款,都只投射一幅画面,虚像固定在7.5米或10米的某个焦面上,你的眼睛要么盯着这个固定焦面,要么看真实路况,来回切换自然累。

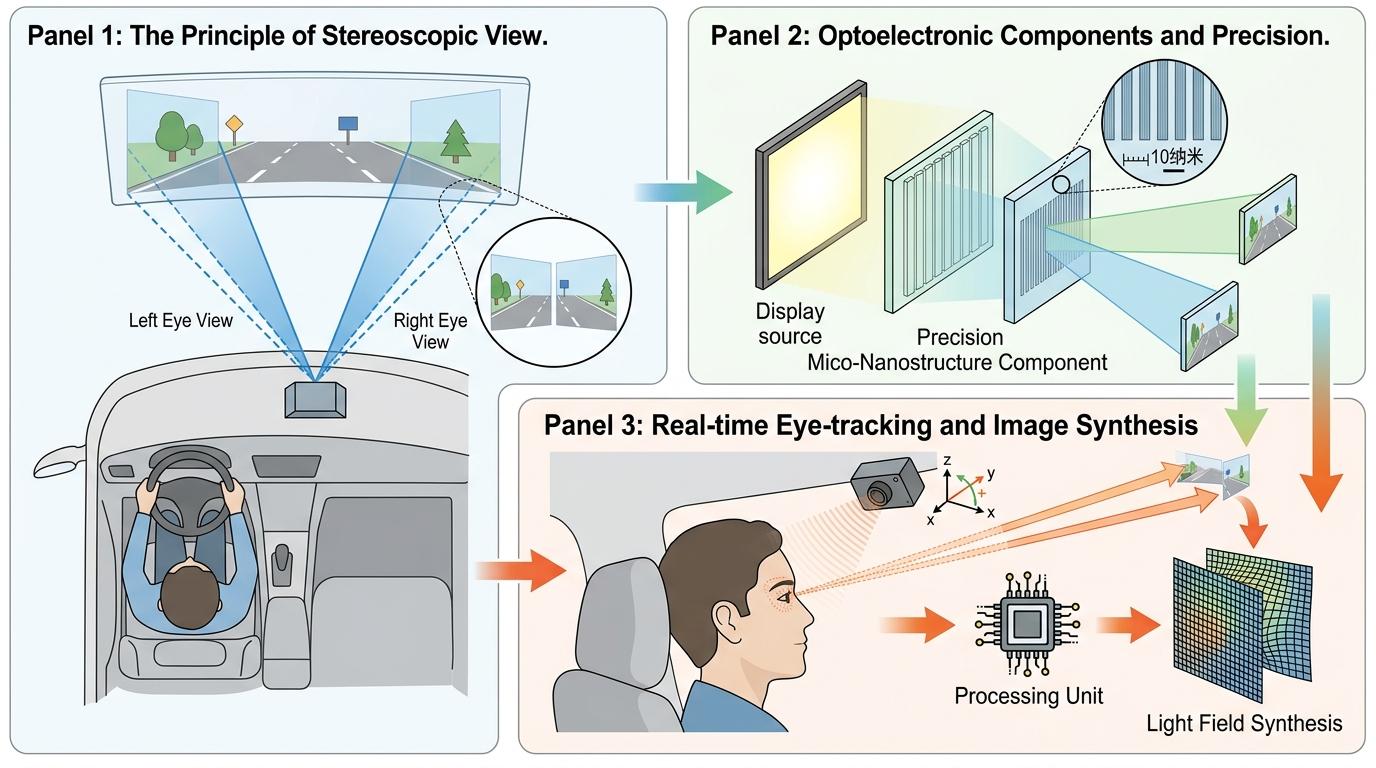

裸眼3D-HUD的核心逻辑,就是给左右眼分别投射带视差的画面。这需要一套精准的光学系统:首先用微纳光学元件——比如精度达10纳米的微棱镜阵列——把光线拆分成两路,分别对应左右眼的视角;再配合眼球追踪技术,实时捕捉你头部和眼睛的位置,动态调整两幅画面的偏差量;最后靠光场成像算法,把这些画面“拼”成连续景深的立体图像。

简单说,它让HUD的虚像不再是固定的一个点,而是能从1米延伸到“无限远”,和真实世界的景深完全匹配。你看导航箭头的感觉,就像看路上的路牌一样自然,眼睛不用再反复对焦。

听起来原理不复杂,但把这套系统塞进汽车仪表盘那点有限空间里,难度堪比在行李箱里装下一套家庭影院。

第一个难题是光学系统的体积。传统HUD用的是几何光学,靠大镜子折叠光路,体积动辄十几升;而裸眼3D-HUD要用到微纳光学元件,得把复杂的光路压缩在几厘米的空间里,还得保证左右眼的画面不串扰,光的利用率够高——毕竟阳光直射下,HUD画面也得清晰可见。

第二个坎是成本和量产。微纳光学元件需要电子束光刻、纳米压印这些高精度制造工艺,初期良率低,成本居高不下;而且汽车工业对可靠性要求极高,这套系统得扛住零下40度到零上80度的温度变化,还要经得起车辆颠簸的长期考验。

还有一个容易被忽略的问题:视觉舒适性。如果左右眼的视差没调好,或者画面延迟超过人眼能感知的阈值,就会导致眩晕,反而影响驾驶安全。这需要算法和硬件的精准配合,把延迟控制在毫秒级。

其实HUD技术最早是为战斗机设计的——让飞行员不用低头看仪表,盯着前方就能获取飞行数据。上世纪80年代,这项技术开始向汽车领域迁移,但早期的车载HUD只能显示车速、转向灯这些简单的2D信息。

直到2010年后,AR-HUD的概念出现,导航箭头能“贴”在路面上,但还是没解决对焦疲劳的问题。直到有人在靶场瞄准的瞬间得到灵感:既然单眼瞄准和双眼看东西的体验差这么多,那能不能用双目视差来解决HUD的疲劳问题?

这个灵感花了十年才落地。期间工程师们解决了微纳光学元件的量产难题,优化了眼球追踪的精度,还把光场算法的算力需求降到了车载芯片能承受的范围。如今,这项技术终于从实验室走到了量产车,让普通驾驶者也能用上曾经只有战斗机飞行员才有的体验。

当3D导航箭头和真实路面融为一体时,我们看到的不只是一项光学技术的突破,更是人车交互方式的改变——从“人适应机器”,到“机器适应人”。未来的智能座舱里,HUD可能不只是显示导航和车速,还能把前方的障碍物、行人甚至交通信号灯的信息,都以3D的方式呈现在你眼前。

技术的终极目标,从来不是炫技,而是让人忘记技术的存在。当你开车时,不用再分心去看任何屏幕,信息自然“长”在你看到的世界里,这才是真正的智能驾驶。

好的科技,是让你感觉不到它的存在。