对抗知识焦虑,从看懂这条开始

App 下载

AI鉴伪不再背答案,学会像法医一样找证据

ACL会议|西安交大团队|图文伪造检测|证据链推理|AI鉴伪模型|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

ACL会议|西安交大团队|图文伪造检测|证据链推理|AI鉴伪模型|多模态视觉|人工智能

当你刷到一条“某地出现野生大熊猫”的新闻——配着清晰的熊猫啃竹子照片,文案细节满满——你怎么判断真假?现在的AI鉴伪模型可能会立刻给你一个“真/假”标签,但换个场景,比如把熊猫换成南极企鹅站在沙漠里,它可能就彻底懵了。这不是模型笨,是它一直在“背答案”:只记住了训练过的伪造特征,没学会找证据链的逻辑。2026年5月,西安交大、合工大与澳门大学的跨校团队,在ACL会议上拿出了一套能让AI当“法医”的新框架——它不只会给结论,还能像刑侦人员一样,一步步拆解图文里的破绽。

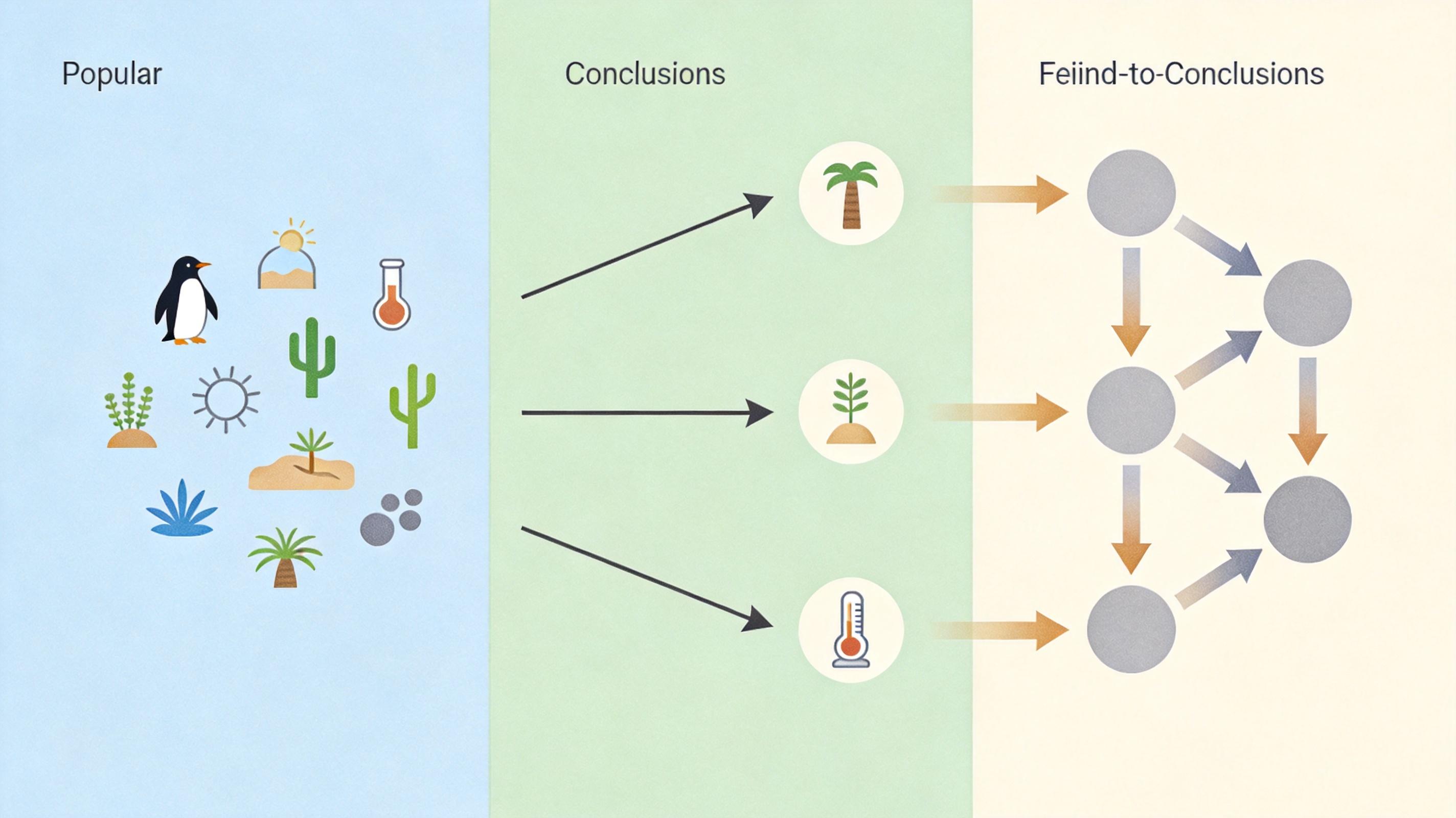

你可以把传统鉴伪模型想象成只会背题的考生:做过的题能拿满分,换个题型就抓瞎。它的训练逻辑是“直接把图文映射到真假标签”——相当于只看答案不看解题过程,时间长了就只会拟合训练数据里的表面特征,比如“熊猫照片里的竹子纹理”“新闻文案里的特定用词”,根本没摸到伪造的本质。

当伪造手法从“换脸”变成“换整个场景”,当新闻领域从“自然科普”跳到“社会新闻”,这些靠“背答案”的模型就会瞬间失灵。论文里的一组数据更直白:面对未见过的场景级伪造,传统模型的准确率直接从80%跌到40%以下——不是识别难,是它根本没学会“为什么假”的逻辑。

真正的问题在于,我们需要的不是只会判案的法官,是能找出证据链的法医。

这套叫REFORM的框架,核心就是让AI先当侦探,再当法官。

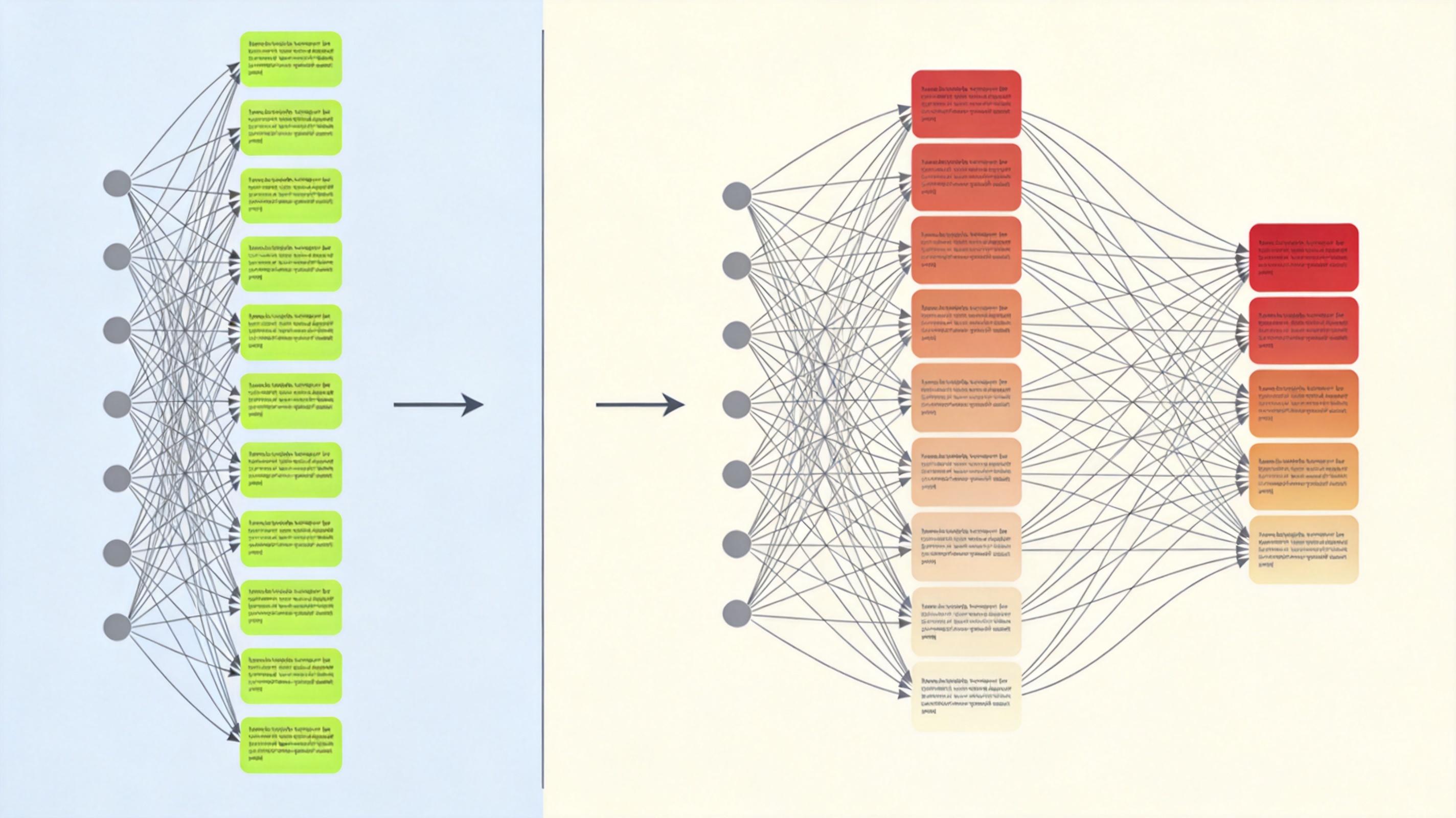

它的训练分三步走:第一步是“认知热身”——先让AI把图文里的可疑线索全部拎出来,比如“企鹅照片里的沙漠植被”“文案里提到的南极温度和沙漠环境矛盾”;第二步是“推理-答案对齐”,确保每一个结论都对应着实打实的证据,不能出现“凭感觉判断假,但说不出哪里假”的情况;第三步是用强化学习优化推理逻辑,让它像法医写报告一样,把“哪里假、为什么假”的链条理得清清楚楚。

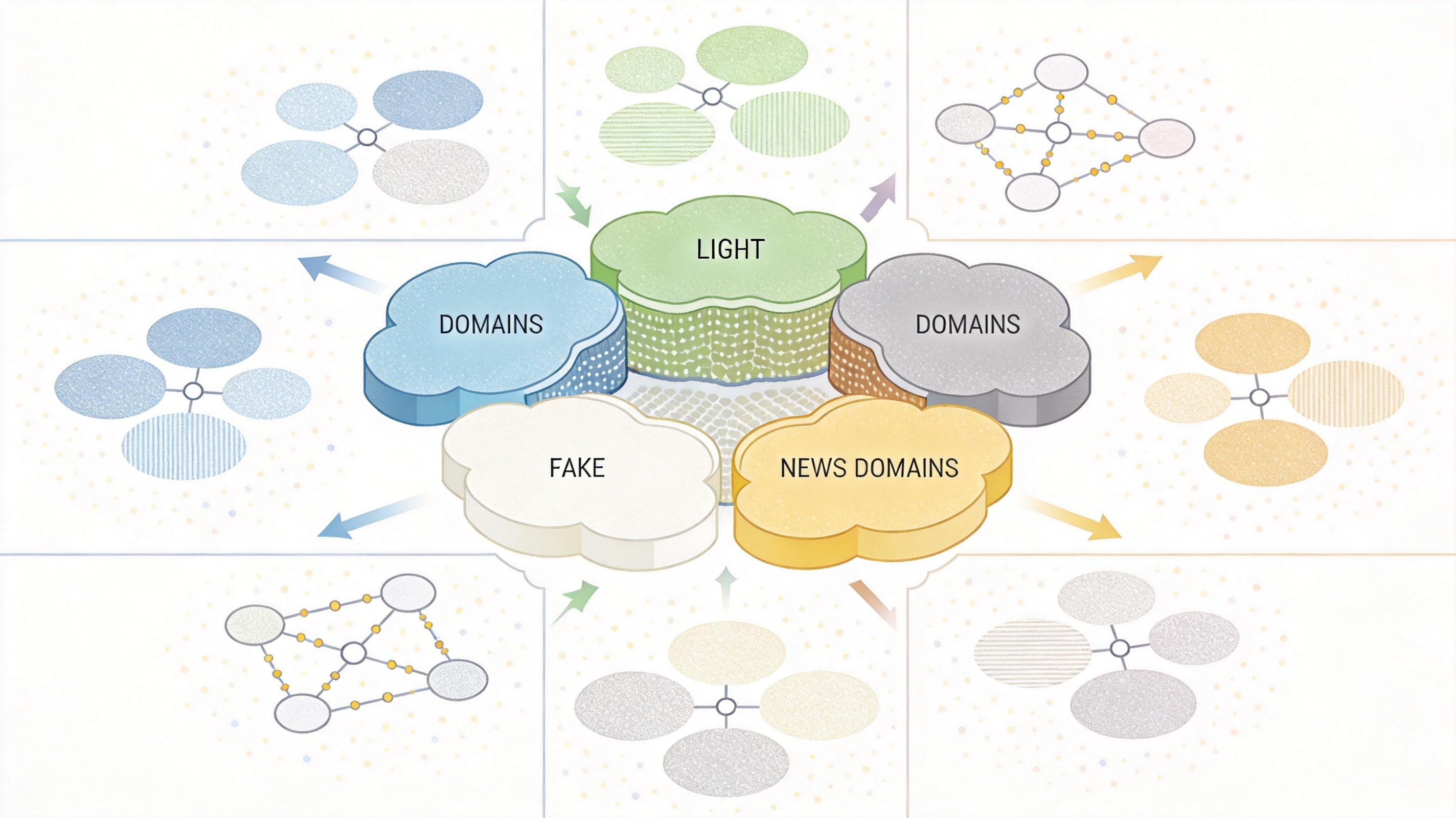

为了让AI练出真本事,团队还专门做了一个叫ROM的数据集——70万条图文样本,覆盖5个新闻域、9种伪造类型,每条样本都标注了完整的推理证据链。这相当于给AI准备了70万份刑侦案卷,让它在训练时不是背“真假标签”,而是学“找证据的思路”。

直给说就是:以前AI是“看图文→输出真假”,现在是“看图文→找破绽→理逻辑→给结论”。

在ROM数据集的跨域测试里,REFORM的准确率能稳定在81%以上——换了新闻领域、换了伪造手法,性能几乎没掉。更关键的是零样本测试:面对完全没训练过的场景级伪造,它的F1值达到74.9,比传统大参数量模型高出15%以上。

当然它也不是完美的。比如面对极其细微的局部伪造,比如只篡改了照片里的一个小文字,它的推理链偶尔会遗漏细节;而且目前的训练还依赖高质量的标注数据,要是遇到标注模糊的样本,推理逻辑也会打折扣。但这些问题都是技术迭代里的细节,核心的突破已经明确:当AI学会了找证据链,就不用再怕“没见过的伪造”。

说句实在的,这才是AI鉴伪该有的样子——不是跟在伪造技术后面“见招拆招”,而是掌握一套能迁移的逻辑,以不变应万变。

当生成式AI把伪造门槛拉到最低,我们需要的早已不是“能识别已知伪造”的工具,而是“能应对未知伪造”的逻辑。REFORM的意义,从来不是刷新了几个准确率数字,而是给AI鉴伪换了一套底层思路:从“背答案”到“找证据”,从“看结果”到“理逻辑”。

比识别伪造更重要的,是学会推理伪造。 未来的内容安全战场里,能站稳脚跟的,永远是那些能像法医一样,一步步拆解真相的AI。毕竟,伪造手法会变,但“假的永远有破绽”这个道理,不会变。