对抗知识焦虑,从看懂这条开始

App 下载

Mac Mini断货背后,本地AI硬件正在改写AI规则

开源AI智能体|Token账单|本地AI超算硬件|OpenClaw|Mac Mini|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

开源AI智能体|Token账单|本地AI超算硬件|OpenClaw|Mac Mini|AI产业应用|人工智能

2026年春天的苹果官网,Mac Mini高配版的交货周期被拉长到4到5个月,二手市场的同款机型也被炒到溢价。没人是为了买台普通电脑——这款原本定位入门级的主机,成了养“龙虾”的专属窝。这里的“龙虾”是爆火的开源AI智能体框架OpenClaw,它能像员工一样帮人写方案、管数据、跑流程,但20分钟消耗3000万Token的账单,让月薪两万的用户都直呼养不起。正是这份“养虾焦虑”,点燃了一个全新的赛道:本地AI超算硬件,它要解决的核心问题,就是让AI在本地“替人干活”,不用再给云端交天价“Token税”。

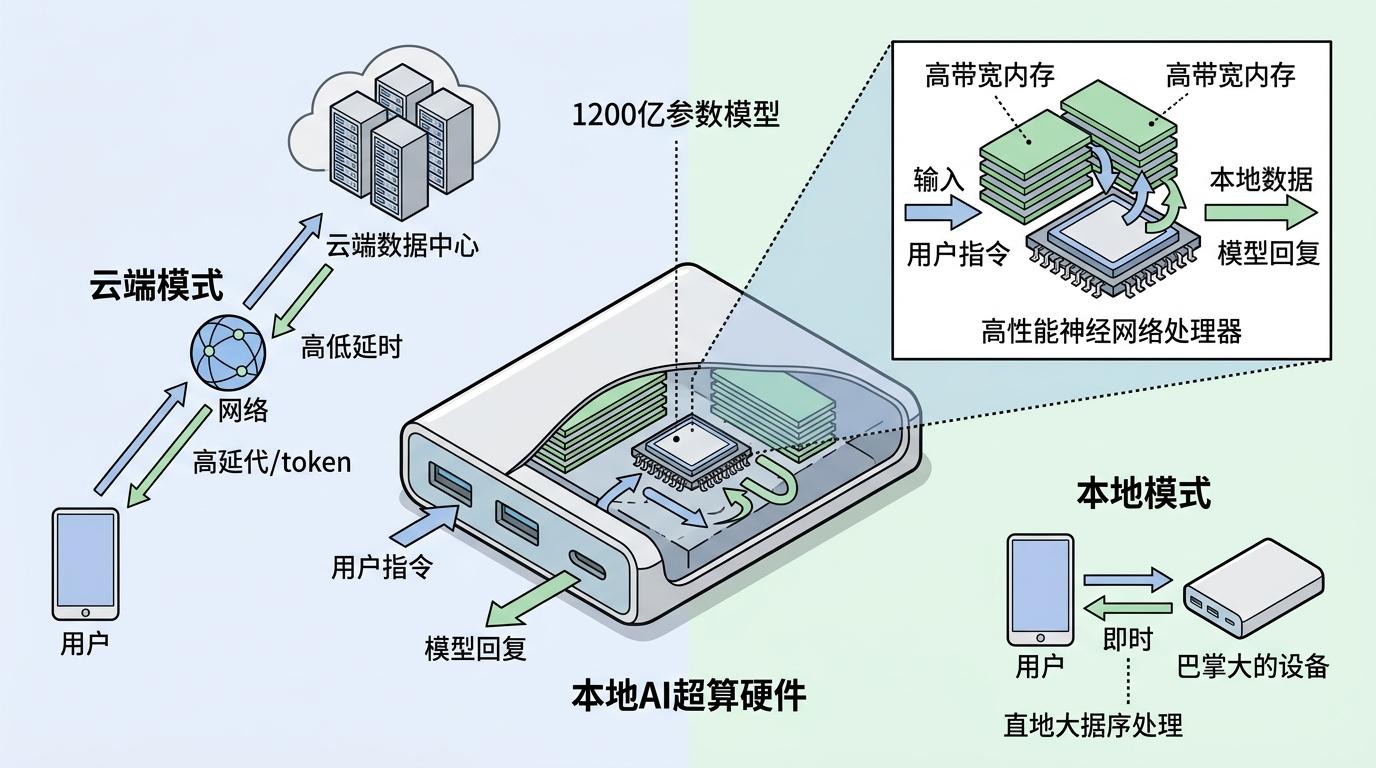

你可以把云端AI理解成共享办公室:空间大、设备全,但每用一次会议室、每打印一页纸都要花钱,还得担心自己的文件会不会被邻座看到。而本地AI超算,就是你给自己的AI租了一间独立工作室——一次性付完房租,所有设备随便用,文件锁在自己抽屉里,不用再看服务商的脸色。

这个“工作室”的核心,是能在本地运行大模型的硬件。过去,千亿参数的大模型只能躺在云端的数据中心里,用户每发一条指令,都要把数据传上去计算,再把结果传回来,不仅延迟高,Token消耗更是像流水一样。现在,本地AI超算硬件能把百亿级的大模型“装”进一台巴掌大的设备里,比如一款叫Tiiny AI的产品,只有充电宝大小,却能跑1200亿参数的模型,完全不用连云端。

最直观的变化是成本。有用户算了一笔账:用云端AI运行OpenClaw,两个月能烧掉好几万;换成本地硬件,一次性投入一两万,之后几乎零成本。对律师、医生这种需要处理敏感数据的职业来说,本地运行的吸引力更大——所有数据都在自己的设备里,不用再担心病历、客户隐私泄露的风险。

当Mac Mini意外成为“AI网红”,科技巨头和创业公司都盯上了本地AI超算这块蛋糕,但玩法截然不同。

苹果、华为这些大厂,手里握着成熟的硬件供应链和用户生态,它们的优势是把AI能力塞进现有的设备里——比如Mac Mini用统一内存架构,能高效运行70亿参数的模型;华为的AI芯片,已经在国内AI服务器市场拿下了41%的份额。但大厂的问题也很明显:它们的产品是通用型的,没法针对AI智能体的需求做深度优化。比如Mac Mini虽然能跑OpenClaw,但它的系统不是为7×24小时运行AI设计的,长时间高负载下稳定性会打折扣。

创业公司则走了另一条路:聚焦垂直场景,把“小而专”做到极致。有的公司专门做面向极客的命令行交互设备,放弃了花哨的界面,把所有资源都留给AI计算;有的公司主打视觉识别,能让AI看懂电脑屏幕,直接帮用户操作软件;还有的公司在数据绑定上做文章——用户用得越久,AI就越懂用户的习惯,比如记住你喜欢的文档格式、常用的工作流程,形成别人抢不走的用户粘性。

投资人更看好后者。有数据显示,2025年全球AI加速芯片市场规模超过1200亿美元,其中推理芯片的增速最快,而创业公司在模型压缩、量化这些推理优化技术上,走得比大厂更远。

本地AI超算的核心矛盾,始终是“有限的硬件”和“无限的AI需求”之间的拉扯。

最大的瓶颈是内存。大模型的参数、运行时的缓存,都要占内存,尤其是长对话场景,缓存会像滚雪球一样越变越大。比如运行一个70亿参数的模型,至少需要40GB的显存,要是想同时跑两个模型,或者处理更长的上下文,内存需求还会翻倍。这也是为什么Mac Mini的64GB版本会卖断货——它刚好能满足“养龙虾”的基本需求。

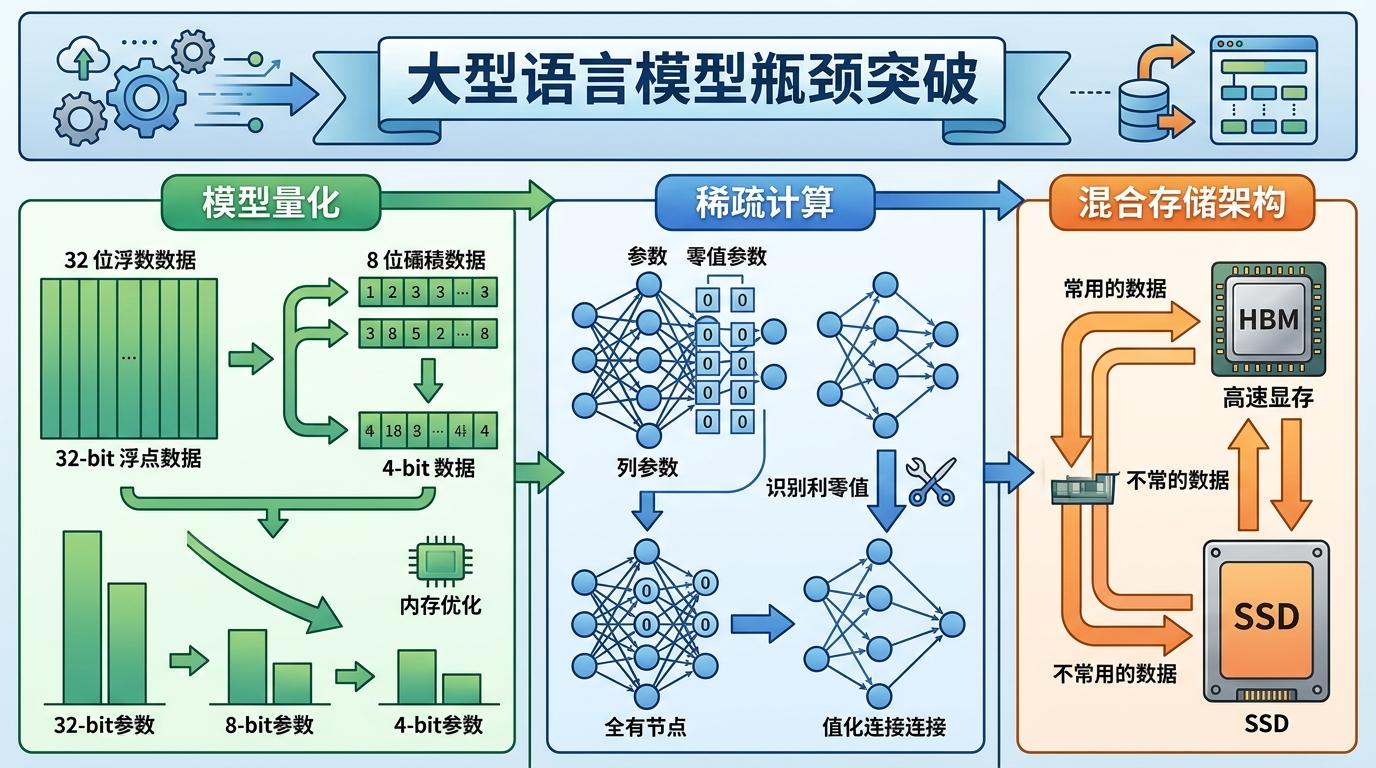

为了突破这个瓶颈,工程师们想出了各种办法:模型量化,把32位的参数压缩成8位甚至4位,内存占用直接减少75%;稀疏计算,跳过模型里那些没用的“零值”参数,少做无用功;还有混合存储架构,把常用的数据放在高速显存里,不常用的放在SSD里,像电脑的内存和硬盘一样配合。

但这些办法都有代价:量化会损失一点精度,稀疏计算需要专门的硬件支持,混合存储会增加延迟。怎么在“省钱”“好用”“安全”这三个需求里找到平衡点,是所有玩家都要解决的问题。比如一款叫玲珑星核的产品,把内存加到了128GB,能跑80亿参数的模型,虽然价格从13000涨到了21000,却依然卖断货——这说明,只要能解决真实需求,用户愿意为性能买单。

OpenClaw的热度可能会像之前的AI风口一样慢慢降温,但它点燃的需求不会消失——人们想要的从来不是一个能聊天的机器人,而是一个能帮自己解决问题的“数字员工”。

本地AI超算的兴起,本质上是一场用户对AI“主权”的争夺:从“用别人的AI”到“养自己的AI”,从“看云端的脸色”到“自己掌握数据”。未来的AI,可能不会是一个躲在手机里的聊天框,而是一个放在你桌上、揣在你兜里的“数字助手”,它懂你的习惯,守着你的隐私,24小时待命,却不用你付一分钱的“加班费”。

AI的未来,终将是本地的。