对抗知识焦虑,从看懂这条开始

App 下载

三星市值破万亿,拆解AI算力的「HBM内存战争」

芯片股|台积电|HBM芯片|高带宽内存|三星电子|AI算力|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

芯片股|台积电|HBM芯片|高带宽内存|三星电子|AI算力|人工智能

2026年5月6日的亚洲股市像被按下了加速键:韩国综合股价指数首次冲破7000点,三星电子股价飙涨15%,市值跃过1万亿美元大关——这是台积电之后,亚洲第二家跻身万亿俱乐部的科技公司。同一天,A股科创板50指数涨超9%,澜起科技、兆易创新等芯片股集体涨停。

所有人都在说这是AI的功劳,但很少有人说清:为什么是内存芯片先吃到红利?这场涨势背后,藏着一场决定AI算力上限的技术战争,而核心武器是一个普通人从未听过的词——高带宽内存(HBM)。

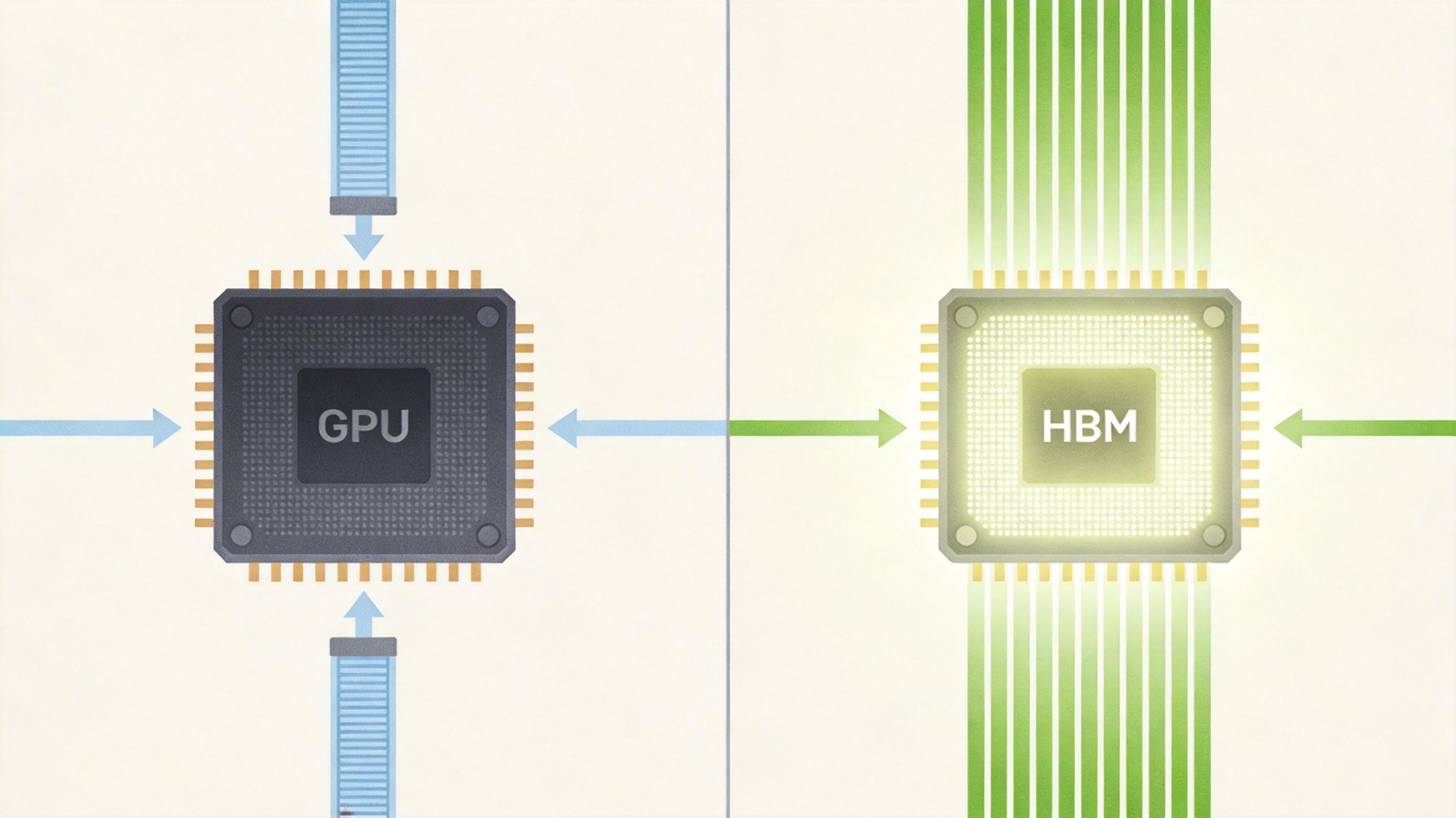

你可以把AI大模型想象成一个同时读1000本书的学霸:传统DDR内存是单车道公路,数据只能排队通过,学霸刚读完第一页,后面的书还在堵车;而HBM是1024车道的超级高速,所有数据能同时涌进大脑。

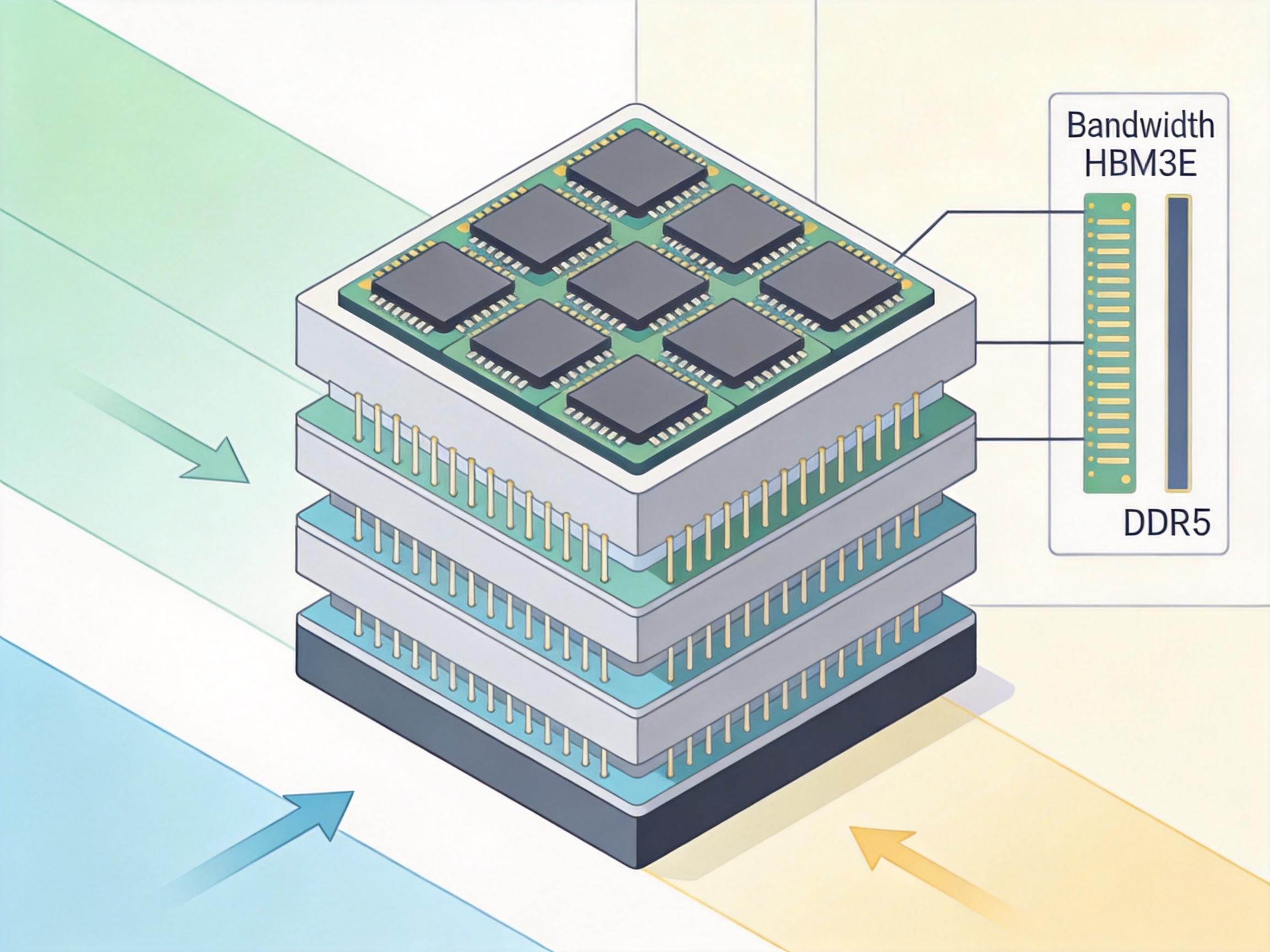

但真实的机制比这更精确:HBM采用3D堆叠技术,把8到16层DRAM芯片像叠煎饼一样堆起来,通过头发丝万分之一粗细的硅通孔(TSV)垂直连接,总线宽度直接拉到1024位以上。最新的HBM3E单堆栈带宽能达到1.2TB/s,是DDR5的6倍,功耗却低30%。

AI训练时,万亿参数模型需要每秒调用几十TB的数据,DDR内存的带宽瓶颈会让GPU算力直接浪费70%——就像给F1赛车配了一条乡村土路。而HBM的存在,就是把这条土路换成了机场跑道,让GPU的算力真正跑起来。

现在你就能理解为什么三星的财报会爆炸:它的HBM产能跟上了AI巨头的订单,第一季度营业利润同比暴涨48倍,其中仅内存业务的利润就占了90%以上。

美国财经评论员克莱默用黄仁勋的「五层蛋糕」模型解释了这场涨势:最底层是电力,往上是半导体芯片,再是数据中心基础设施,然后是云平台,最顶层是AI应用。AI的需求像雨水一样从顶层浇下来,最先灌满的就是底层的芯片和基础设施。

谷歌、亚马逊、微软、Meta四大巨头2026年的AI资本开支将达到7250亿美元,比2025年暴涨77%,其中近一半的钱要花在HBM和GPU上。这直接导致HBM芯片供不应求:2026年HBM3E的良率只有50%到60%,而传统DRAM良率能超过90%,高层堆叠的HBM甚至需要3个月才能生产出来,交货期比去年翻了一番。

但狂欢背后藏着暗礁。巴菲特的伯克希尔哈撒韦公司就明确拒绝了通用大模型的风口,转而押注垂直场景的「慢AI」——他们看到了泡沫的风险:OpenAI未能完成内部目标,部分AI公司的现金流已经亮起红灯;HBM的制造良率瓶颈短期无法突破,一旦AI资本开支增速放缓,整个半导体产业链可能面临回调。

更关键的是,这场战争的话语权并不完全握在芯片厂商手里:ASML的EUV光刻机、Lam Research的蚀刻设备,这些上游设备厂商的产能,才是决定HBM能否扩产的真正命门。

AI内存战争还在重构全球半导体供应链的格局。美国通过《芯片与科学法案》砸下数百亿美元,要求获得补贴的企业10年内不能在中国扩建先进制程产能;欧洲的《欧洲芯片法案》则计划到2030年把本土芯片产能占全球的比例从10%提升到20%。

中国也在加速追赶:长鑫存储、武汉新芯等企业已经推出了HBM2样品,但距离量产HBM3还有至少2年的差距——最大的障碍不是设计,而是制造设备:生产HBM需要的高精度TSV蚀刻设备、热压键合设备,目前几乎被美日荷企业垄断。

这场供应链的「新冷战」,本质上是对AI算力话语权的争夺。谁掌握了HBM的产能,谁就能卡住AI大模型的脖子;谁能实现HBM的自主可控,谁就能在未来的AI竞赛中站稳脚跟。

当三星的市值冲破万亿美元时,很少有人注意到:这家公司的员工正在威胁罢工,要求分一杯AI红利的羹;也很少有人提到,HBM的热管理难题还没真正解决——当16层芯片堆叠在一起,核心温度会超过100℃,必须用液冷技术才能降温,而这又会增加数倍的成本。

技术的迭代永远比资本的狂欢慢半拍。AI的算力革命,本质是内存的战争。当我们为万亿市值欢呼时,更应该记住:每一个流畅的AI对话背后,都有上百层DRAM芯片在高温下高速运转,也有无数工程师在攻克那些看不见的技术瓶颈。这场战争没有终点,只有一个又一个需要跨越的门槛。