对抗知识焦虑,从看懂这条开始

App 下载

AI时代的新货币:Token如何重构资源规则

资源分配规则|AI对话成本|词元|Token计费|大语言模型|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

资源分配规则|AI对话成本|词元|Token计费|大语言模型|人工智能

你有没有过这样的经历:和AI聊到兴头上,对话框突然弹出「Token额度不足」;或是为了写一份报告,反复调整提问方式,就怕多耗了几个Token。2026年3月,「Token」有了官方中文译名「词元」,这个藏在AI背后的小单位,突然从技术圈走进了我们的日常账单。它像隐形的秤砣,称量着每一次AI对话的成本;又像无形的指挥棒,悄悄改变着我们工作和思考的方式。为什么一个看不见的符号,能成为AI时代的「通用货币」?它又在怎样悄悄重构我们的生活规则?

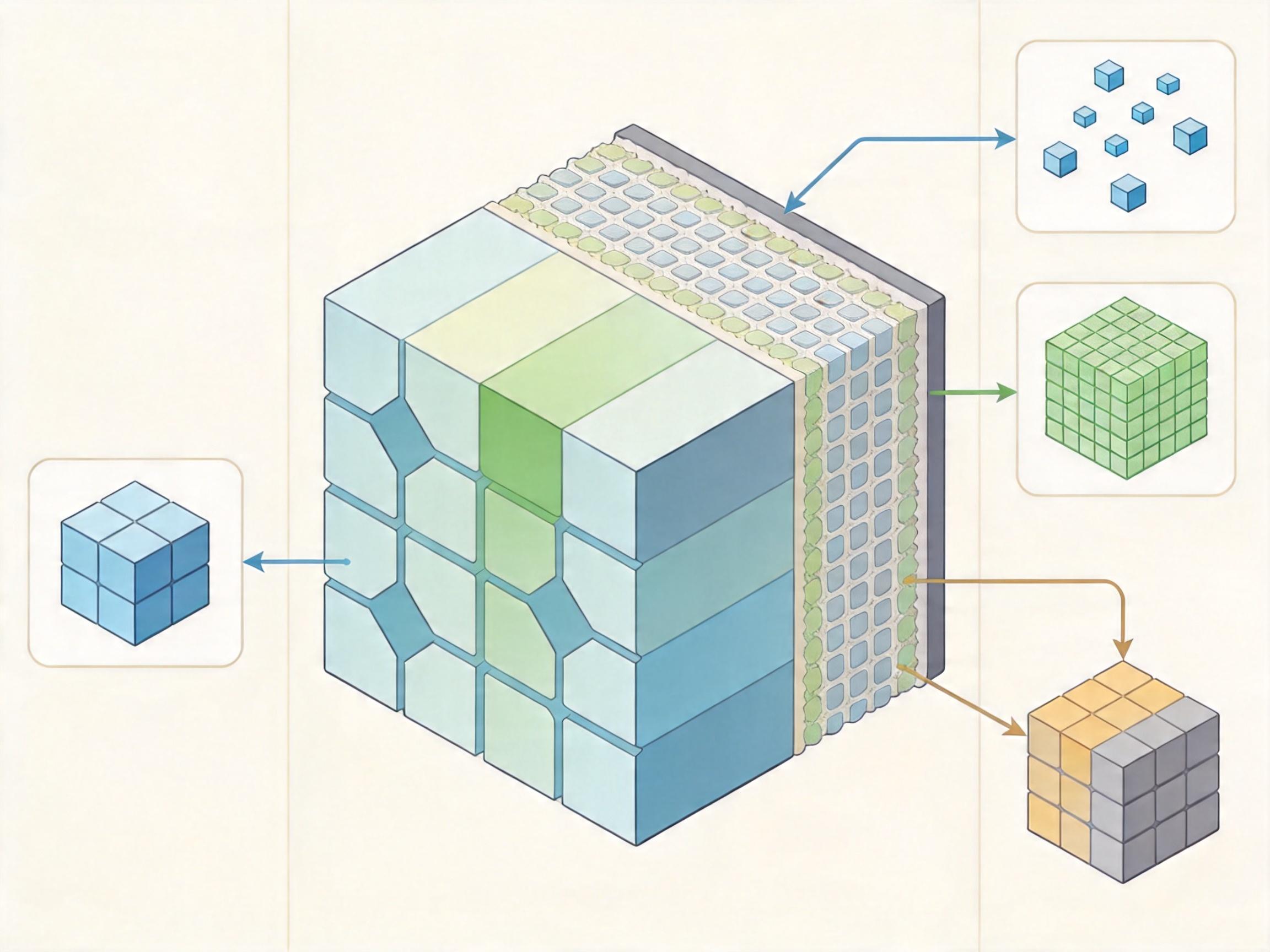

你可以把Token理解为AI世界的「最小乐高块」——不管是输入的文字、上传的图片,还是AI生成的回答,都会被拆成一个个标准化的小单元。比如英文里「unhappiness」会被拆成「un-」「happiness」两个Token,中文里「人工智能」可能直接是一个Token,而一张高清图会被切分成上千个视觉Token。

但真实的机制比乐高积木更精确:AI模型的核心是Transformer架构,它只能处理这种标准化的Token序列。每输入一个Token,模型就会计算它和前后所有Token的关联,最终生成下一个最合理的Token。这个过程的计算量、耗电量,甚至你的付费账单,都直接和Token数量挂钩。

2022年到2025年,全球Token处理量增长了10倍,2025年底中国日均调用量突破100万亿。这意味着,越来越多的智能活动——从写文案、做数据分析到设计海报——都在被折算成Token的消耗。就像工业时代一切生产都要耗电,AI时代的智能劳动,本质上是在「烧Token」。

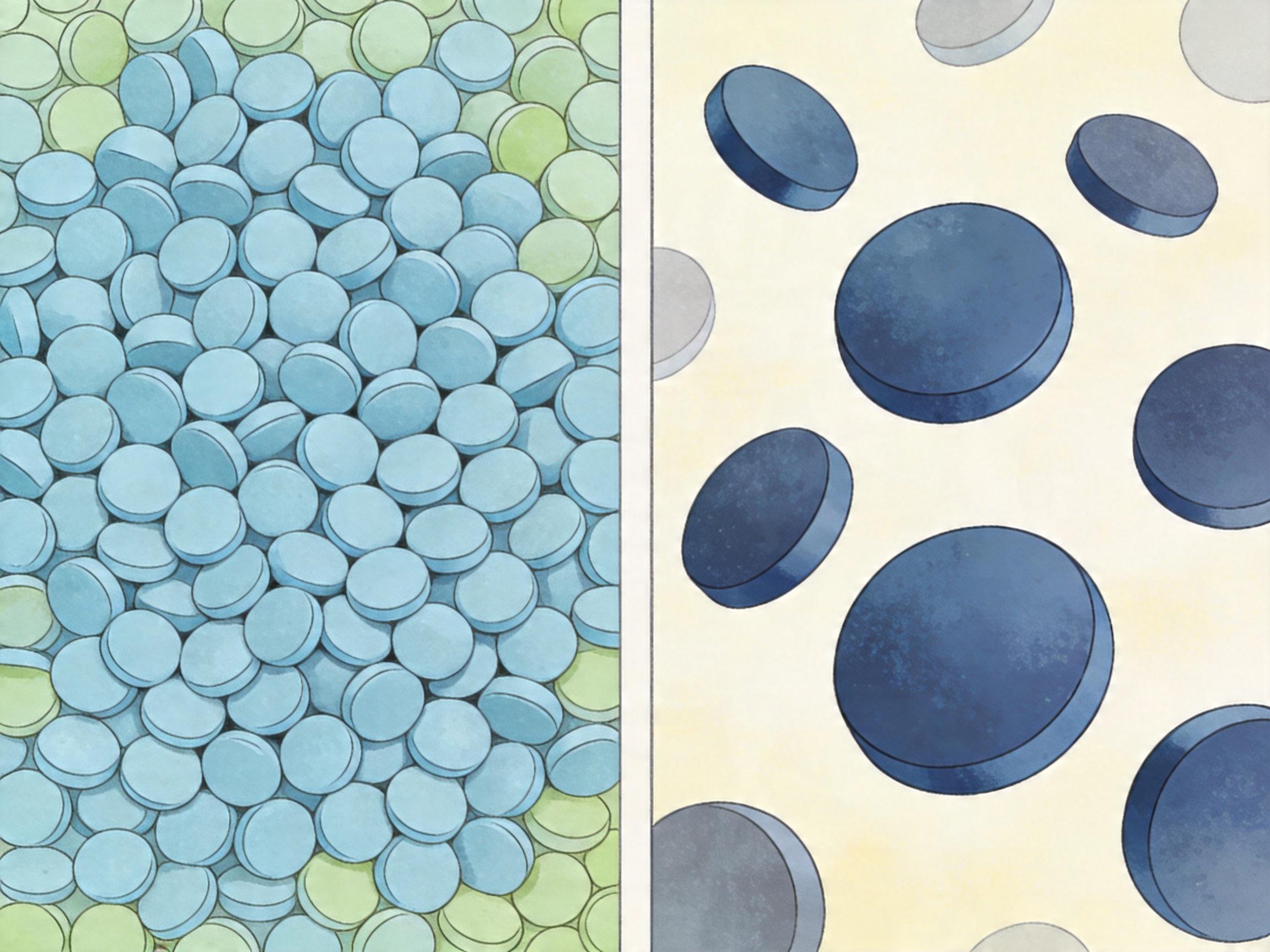

你可能没注意到,同样一句话,用不同语言说,消耗的Token成本天差地别。由于主流AI模型的Token拆分规则是基于英语训练的,非拉丁语系语言常常要付出更高的「Token溢价」:泰卢固语用户表达同样信息,成本是英语用户的5倍;阿拉伯语、泰米尔语的Token消耗也比英语多2到3倍。

这不是简单的技术问题,而是一场隐形的数字鸿沟。非英语用户不仅要付更高的钱,同样的Token上下文窗口,能容纳的信息量也只有英语的一半;更糟的是,Token碎片化还会降低AI的理解准确率——非英语任务的准确率普遍比英语低20到30个百分点。这种「语言税」正在把低资源语言用户挡在AI普惠的门外。

对企业来说,Token的成本陷阱同样棘手。一个年薪10万美元的知识工作者,年均Token消耗成本约1000美元,但AI代理的全成本(包括基础设施、风险管理)却高达8.2万美元。更讽刺的是,有些企业为了考核AI使用率,搞起「Token竞赛」,员工为了刷量无意义调用AI,导致Token消耗虚增,实际产出却没提升——这正是绩效指标失效的典型。

面对Token的成本和公平难题,行业已经在探索解法。比如企业开始用「分层模型架构」:简单的客服问答用廉价轻量模型,复杂的法律文档分析才用高端模型,能节省60%到87%的成本。还有团队开发「语义缓存」技术,把相似的AI查询结果存起来,下次再调用时直接读取,部分场景成本降低达73%。

在个人层面,「Prompt工程」不再是技术宅的专属技能——学会用最精简的语言提问,比如把「请你帮我写一份关于AI的报告,最好能有数据支撑」改成「写AI产业报告,含2025年中国Token调用数据」,就能减少30%到70%的Token消耗。甚至有人发现,删掉提问里的「请」「谢谢」这类礼貌用语,也能在不影响结果的前提下省Token。

但更关键的改变在底层:学界正在研发「多语言公平Tokenizer」,让不同语言的Token拆分更合理;有些企业开始把Token使用和实际产出绑定,而不是单纯看消耗数量。毕竟,Token的本质是衡量智能劳动的工具,而不是被追逐的目标。

当我们开始用Token计量思考,其实是把人类最无形的认知劳动,第一次变成了可以被精确计算的「商品」。这既是效率的革命,也是对我们的提醒:每一次提问、每一个想法,都有其成本和价值。

Token不是冰冷的数字,它背后是全球数据中心每年消耗的415太瓦时电力,是不同语言用户之间的数字鸿沟,是企业和个人对智能时代的适应与博弈。我们需要更高效地使用Token,但更需要警惕被Token绑架——毕竟,真正有价值的不是消耗了多少Token,而是用它创造了什么。

Token计量智能,却无法衡量思想的重量。