对抗知识焦虑,从看懂这条开始

App 下载

AI争议重演历史:显微镜之争揭示技术判断真相

行业领袖|数据科学家|幻觉问题|罗夏墨迹测试|伦理准则|社会心理学|AI安全治理|心理认知|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

行业领袖|数据科学家|幻觉问题|罗夏墨迹测试|伦理准则|社会心理学|AI安全治理|心理认知|人工智能

想象一个场景:一间汇集了数据科学家、教育家、公共政策专家和行业领袖的研讨室里,讨论的焦点是为人工智能(AI)研究制定伦理准则。尽管所有参与者都对AI技术了如指掌,但现场的气氛却出人意料地分裂。一些构建AI模型的人,激情澎湃地宣称AI正在彻底改变科学和商业;而另一些同样资深的专家则深表悲观,他们反复强调AI的“幻觉”问题根深蒂固,这项技术被严重夸大,实用价值终将有限。

这场专家间的巨大分歧,并非源于信息差或技术理解的偏差。一位计算机科学家朋友将这种现象精准地比喻为**“罗夏墨迹测试”**。就像心理学家赫尔曼·罗夏的著名墨迹图一样,我们在AI中看到的,更多地揭示了我们自身的心理状态、情感和期待,而非AI本身客观、冰冷的事实。这场现代科技的巅峰对话,与其说是事实的碰撞,不如说是一场情感的博弈。

要理解这场现代争论,我们需要将时钟拨回到三百多年前的17世纪。

1665年,英国科学家罗伯特·胡克(Robert Hooke)出版了他的划时代著作《显微图谱》(Micrographia)。书中精美绝伦的插图,首次向世界展示了跳蚤、软木塞在显微镜下的微观结构。胡克满怀希望与惊奇,他相信这件新发明将“辨识出自然界所有秘密的运作方式”,为人类揭开一个前所未见的宇宙。对他而言,显微镜是通往真理的窗户,充满了无限潜力。

然而,与他同时代的哲学家玛格丽特·卡文迪什(Margaret Cavendish)却对此不屑一顾。她也有自己的显微镜,但她看到的尽是缺陷。她尖锐地指出:

胡克和卡文迪什都是显微镜的直接使用者,知识层面并无鸿沟,为何结论却南辕北辙?答案不在于他们的知识,而在于他们的情感。胡克带着希望与好奇,看到了潜力压倒了缺陷;而卡文迪什则怀着谨慎与怀疑,看到了缺陷掩盖了潜力。有趣的是,我们今天认为卡文迪什错了,是因为显微镜在19世纪经过了重大改良。但在当时,她指出的所有问题都真实存在。若没有后续的技术突破,胡克的远见或许真的只会沦为一场新奇的幻梦。

三百多年后,胡克与卡文迪什的辩论,正在AI领域以惊人的相似度重演。我们对AI的判断,同样被希望与怀疑这两种强大的情感所撕扯。

一方面,AI正以前所未有的速度融入我们的生活。腾讯研究院2025年的一项调研显示,高达96.2%的中国成年人使用过生成式AI,其中近七成(67.7%)每天都在使用。它主要被用作强大的效率工具,处理文字(72%)、检索资料(70.9%),并深度融入学习(75.7%)和工作(70.6%)之中。

然而,这种广泛应用并未带来普遍的安心。数据显示,公众的情绪极为复杂:

人们的核心担忧与卡文迪什的怀疑如出一辙,充满了对现实问题的关切:虚假信息泛滥(60.4%)、就业岗位被替代(59.7%)和个人隐私泄露(46.7%)。尤其在年轻群体中,职业焦虑感更为显著,高达77%的人担心自己的专业技能因AI而贬值。使用AI越频繁,这种焦虑感反而越明显。

AI之所以能成为情感投射的完美画布,源于其内在的复杂性和不可预测性。与结构简单、功能明确的锤子或汽车不同,大型AI模型是一个由数千亿参数构成的“黑箱”。

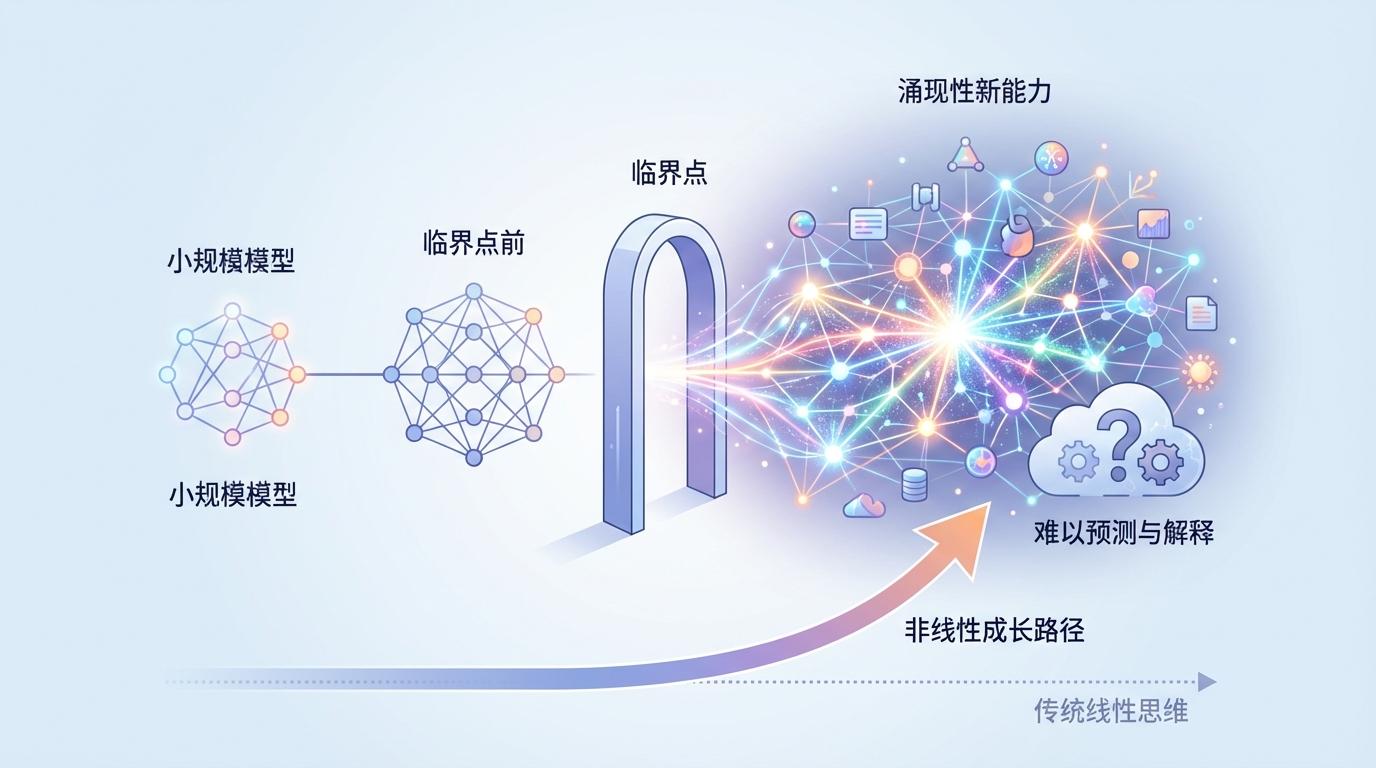

它的能力表现出**“涌现性”**——当模型规模跨越某个临界点,会突然获得之前没有的新能力,这种非线性的成长路径超出了传统的线性思维范畴。我们很难精确预测它的下一步进化,也无法完全解释其决策的内在逻辑。

更重要的是,AI存在着被称为**“幻觉”(Hallucination)**的固有缺陷,即会生成看似合理但完全错误或凭空捏造的信息。这个问题,正如17世纪显微镜的镜片瑕疵,成为了怀疑论者最有力的论据。当一个工具会“说谎”时,我们该如何信任它?这种不确定性,为我们的希望和恐惧留下了巨大的解读空间。

我们与AI的关系,正在深刻地重塑我们的认知习惯。过度依赖AI提供的“认知捷径”,可能导致一种被称为**“AI脑雾”**的现象,即批判性思维和独立解决问题能力的弱化。

研究表明,长期使用大语言模型的人,其大脑中与认知处理相关的神经连接活动会减少。当我们习惯于让AI完成“烧脑”的部分,自己只负责执行时,思考的深度和广度便会萎缩。这引出了一个核心问题:我们是想成为驾驭AI的“驾驶员”,还是仅仅满足于做一个被动接受指令的“乘客”?

专家建议建立一种**“思维的AI缓冲带”**——在面对问题时,先独立思考,形成自己的判断,再利用AI进行深化和拓展。这不仅是为了保持我们的认知自主权,更是为了确保我们不会在技术的洪流中迷失作为思考主体的身份。

从显微镜到人工智能,技术发展的历史反复证明,任何一项颠覆性技术都不仅仅是工具,更是一面映照出人类集体情感、价值观和恐惧的镜子。

这两种力量的博弈,共同塑造了技术的演进轨迹。AI的未来,同样不会由代码本身单向决定,而是取决于我们——它的创造者和使用者——如何在这两种情感之间取得平衡。

最终,围绕AI的讨论,核心议题或许并非“AI能做什么”,而是“我们希望AI成为什么”。要回答这个问题,我们首先需要诚实地审视自己的内心。因为我们对AI的每一种判断,每一次争论,都像是在解读一幅罗夏墨迹图,最终揭示的,是我们自己对未来世界的希望与恐惧。