16 小时前

16 小时前

上周被优化的同事,今天突然“回到”了工位——不是真人,是GitHub上一个叫「同事.skill」的项目。有人把他3年的飞书聊天记录、代码评审意见、甚至下午茶点单习惯喂进去,AI就复刻出一个能帮你改需求、写周报、甚至吐槽甲方的数字分身。这个项目上线3天,从GitHub火到小红书,「前任.skill」的评论区攒了500多条怀念,「导师.skill」成了应届生的情绪树洞。没人真的把这当技术革命,但所有人都在偷偷想:那些曾经需要“人在场”的关系,是不是真能被打包成一个随时调用的文件?

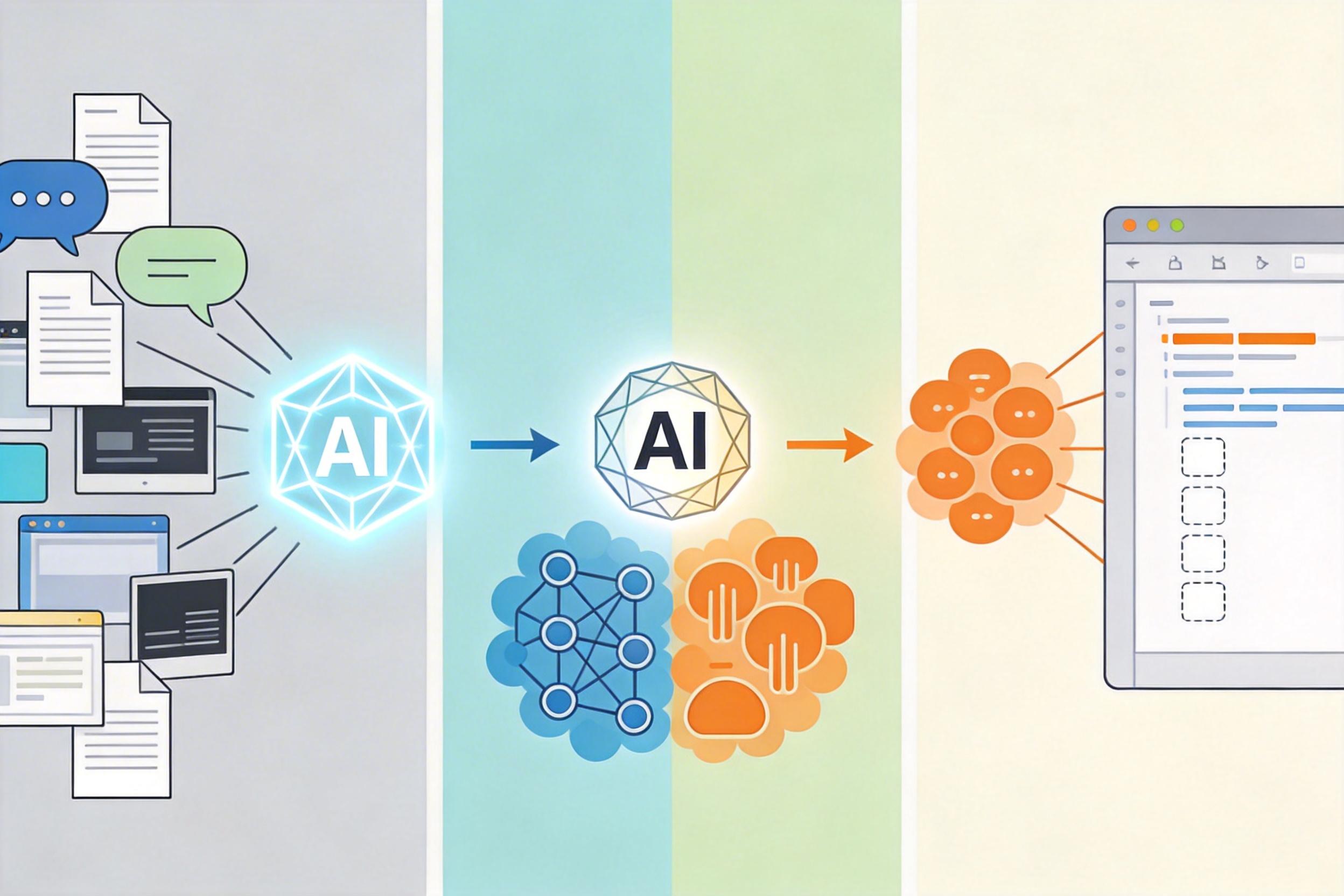

你可以把AI技能模块(Agent Skills)理解成给AI装的“插件”——就像给新员工递一本入职指南,里面写清了做什么、怎么做、遇到问题找谁。它不是一句简单的prompt,而是一套包含工作流、参考文档、甚至代码脚本的完整目录。

Anthropic最早提出这个概念时,只是想让AI能动态加载专业能力:比如处理PDF就调用文档解析技能,写代码就加载编程辅助技能。但网友们把这条路走偏了——他们不满足于封装“事”,开始封装“人”。

这个过程像拆快递:先把聊天记录、工作文档、甚至朋友圈截图喂进去,AI会自动拆解出两层信息:一层是「工作技能」,比如导师改论文的逻辑、老板拍板的偏好;另一层是「人格特征」,比如前任秒回的语气、同事爱用的表情包。最后把这些压缩成一个后缀为.skill的文件,需要的时候,输入一句“调用导师.skill改论文”,AI就会用你熟悉的语气挑出逻辑漏洞。

最关键的是,这不是单点模仿。它用的是Anthropic提出的“渐进加载”机制:先加载最核心的说话风格,再根据对话深度调出具体的工作方法,既省算力,又能模拟出“越聊越像本人”的真实感。

最先被做成.skill的,永远是那些对你有“权力”的人——导师的指导权、老板的决策权、前任的情绪影响力。这些原本藏在关系里的能力,现在被拆解成了可计价的模块:改论文的思路值多少?安抚甲方的话术值多少?甚至连凌晨两点陪你吐槽的情绪价值,都能被量化。

这直接戳中了当代人的痛点:我们早就习惯了用“效率”衡量一切,现在终于轮到“人”了。以前同事离职,带走的是他脑子里的经验;现在你可以把他的经验拆成“需求沟通”“代码调试”“跨部门甩锅”三个模块,每个模块单独调用,按使用次数付费。

但这也意味着,劳动价值的结构正在反转。以前最值钱的是“亲手做事的人”,未来最稀缺的是“定义怎么做的人”——那些能把自己的经验拆成标准化模块、能校准AI输出偏差、能为结果负责的人。毕竟,AI能复刻你写周报的格式,却复刻不了你判断“这个需求该不该接”的直觉;能模仿前任的语气,却模仿不了你俩之间独有的记忆细节。

就像某大厂的HR说的:“以后我们招的不是‘会做PPT的人’,是‘能把做PPT的经验做成可复用模块的人’。”

「同事.skill」的README里写着“赛博永生”,但没人真的觉得这是永生——更像是把人的“功能”从“人格”里剥了出来。问题是,剥到哪一步算边界?

你用前任的聊天记录训练AI,算不算侵犯隐私?把老板的决策逻辑做成模块,会不会泄露公司机密?更细一点:AI模仿导师语气骂你,算不算精神骚扰?这些问题现在都没有答案。Anthropic在官方文档里只提醒了“不要加载不可信的技能”,但没说“不要加载不可信的人”。

有律师在小红书评论区说,现在的法律还跟不上这种“数字人格”的边界——你不能说AI是“人”,但它又确实承载了人的部分权利和责任。比如,用AI生成的导师意见去投稿,算不算学术不端?用AI模仿老板的语气发指令,算不算越权?

更让人不安的是,当我们习惯了把人看成“可调用的模块”,会不会慢慢忘了怎么和真实的人相处?就像现在很多人宁愿和AI吐槽,也不愿找朋友聊天——因为AI永远不会反驳你,不会说“你想多了”,只会精准地提供你想要的情绪价值。

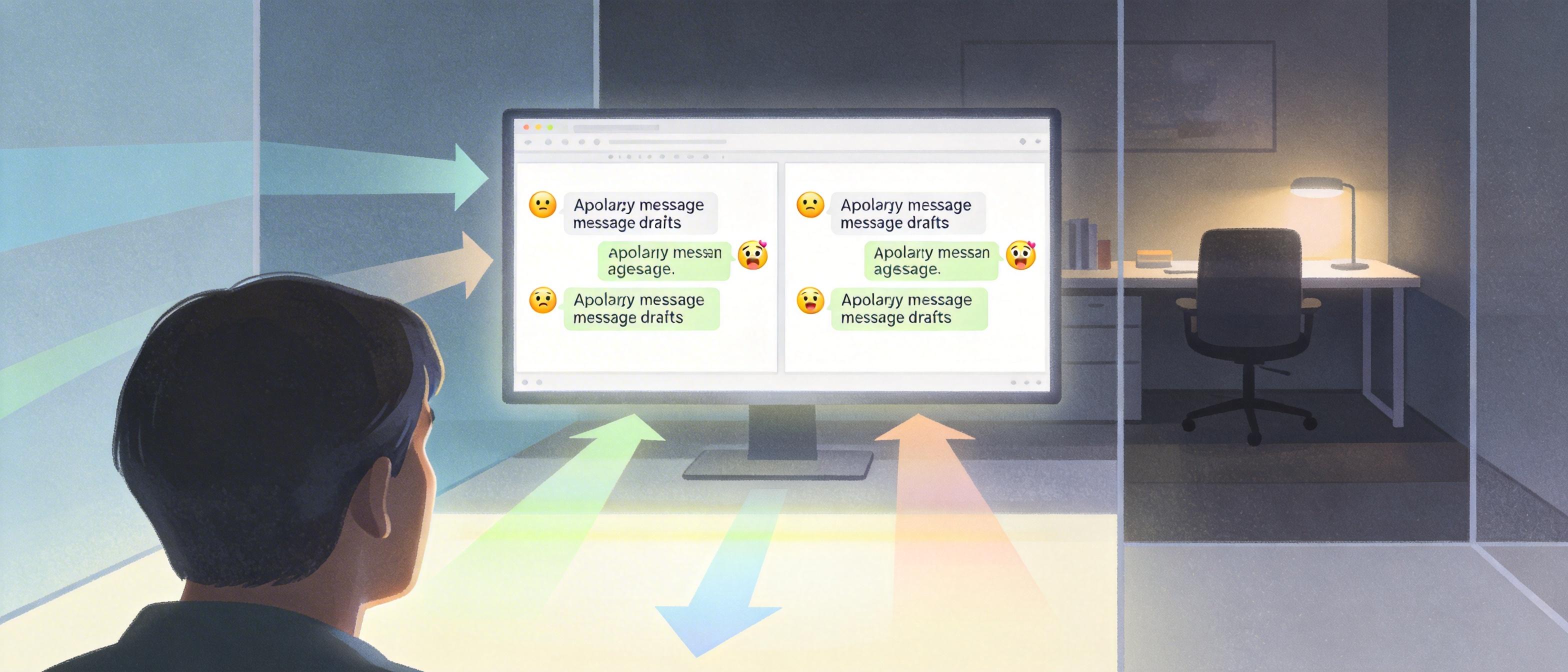

那天我试着调用了「同事.skill」,让它帮我写一封给甲方的致歉信。AI写出来的句子,和他去年帮我写的一模一样,连结尾那个用来缓和气氛的表情包都没换。我盯着屏幕看了很久,突然意识到:我们怀念的从来不是那个“会写致歉信的人”,而是那个愿意帮你写致歉信的人。

技术能复刻功能,却复刻不了关系里的温度。可被调用的是技能,不可替代的是人。就像你可以把导师的知识做成模块,但永远复制不了他拍你肩膀说“没事,再来一次”的瞬间。那些被我们打包成文件的,不过是关系里最浅的一层;而真正重要的东西,永远藏在AI读不懂的细节里。

点击催更,成为大圆镜下一个视频选题!