对抗知识焦虑,从看懂这条开始

App 下载

遥感AI学会了:给未来地球拍精准快照

城市场景预测|斯坦福大学|武汉大学|遥感图像生成|ChangeBridge模型|多模态视觉|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

城市场景预测|斯坦福大学|武汉大学|遥感图像生成|ChangeBridge模型|多模态视觉|人工智能

当卫星拍下今天的城市,我们能不能提前“看见”三年后这里的样子——新写字楼拔地而起,老公园的树木更茂密,就连季节更替的光影变化都分毫不差?过去这只存在于科幻里:要么只能凭空生成模糊场景,要么只能生硬叠加新建筑,完全顾不上背景的自然演变。但在2026年CVPR会议上,武汉大学、斯坦福大学等团队联合发布的ChangeBridge模型,第一次让AI能同时精准模拟“突发的新建筑”和“缓慢的季节变化”,给未来遥感图像生成打开了全新的可能。

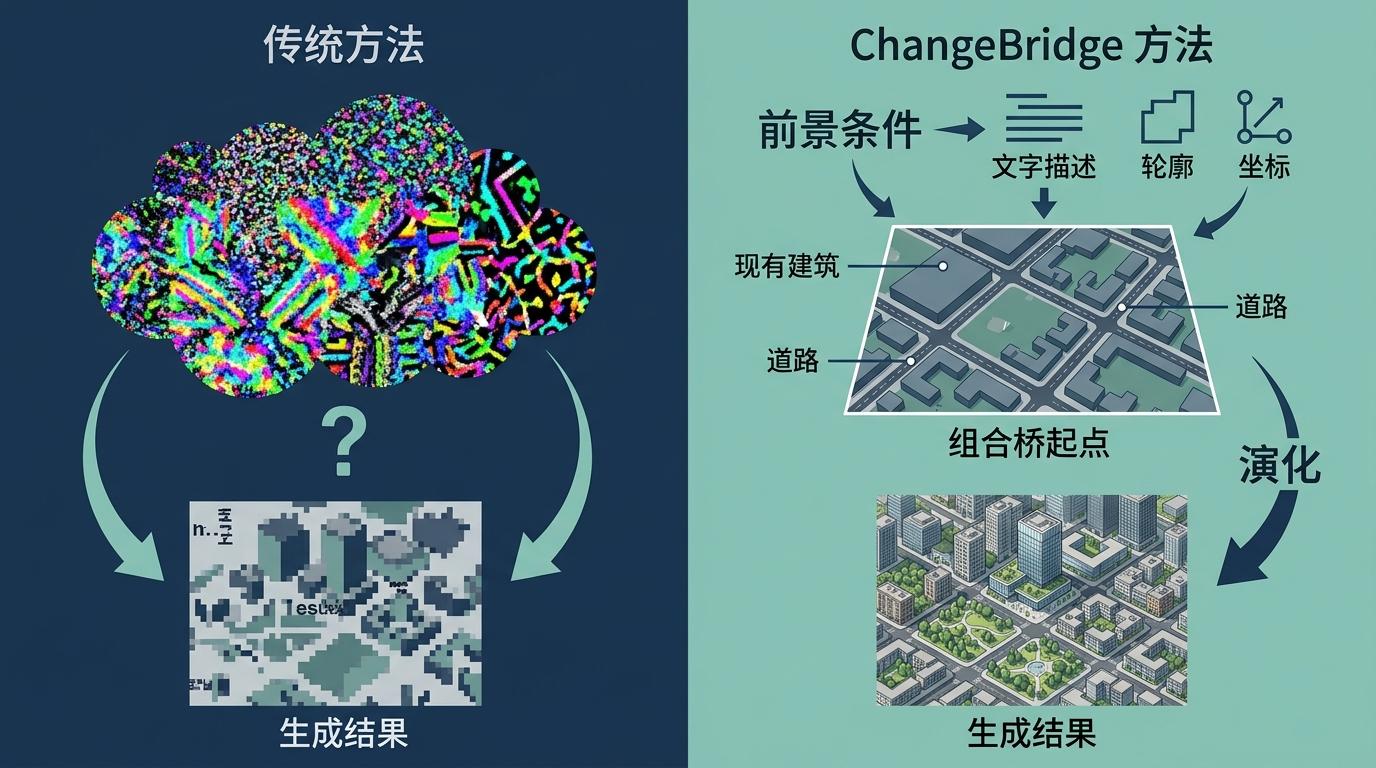

过去的遥感生成AI,要么是从纯噪声开始“瞎画”,很难和真实场景对应上;要么只能处理单一的变化——比如只给城市加新建筑,却完全忽略背景里的树木会变绿、池塘水位会下降。这就像给旧照片P新衣服,却忘了人会变老,结果怎么看都违和。

ChangeBridge的第一个创新,就是把“纯噪声起点”换成了“组合桥起点”——你可以理解成先拿一张现在的卫星图当底,再把需要添加的新建筑、道路等“前景条件”(不管是文字描述、轮廓还是坐标)精准贴上去,形成一张半完成的图,再让AI从这张图开始演化,而不是从一片空白开始瞎猜。这就像写作文先搭好框架,而不是对着白纸硬凑,生成的场景自然和真实世界的空间结构严丝合缝。

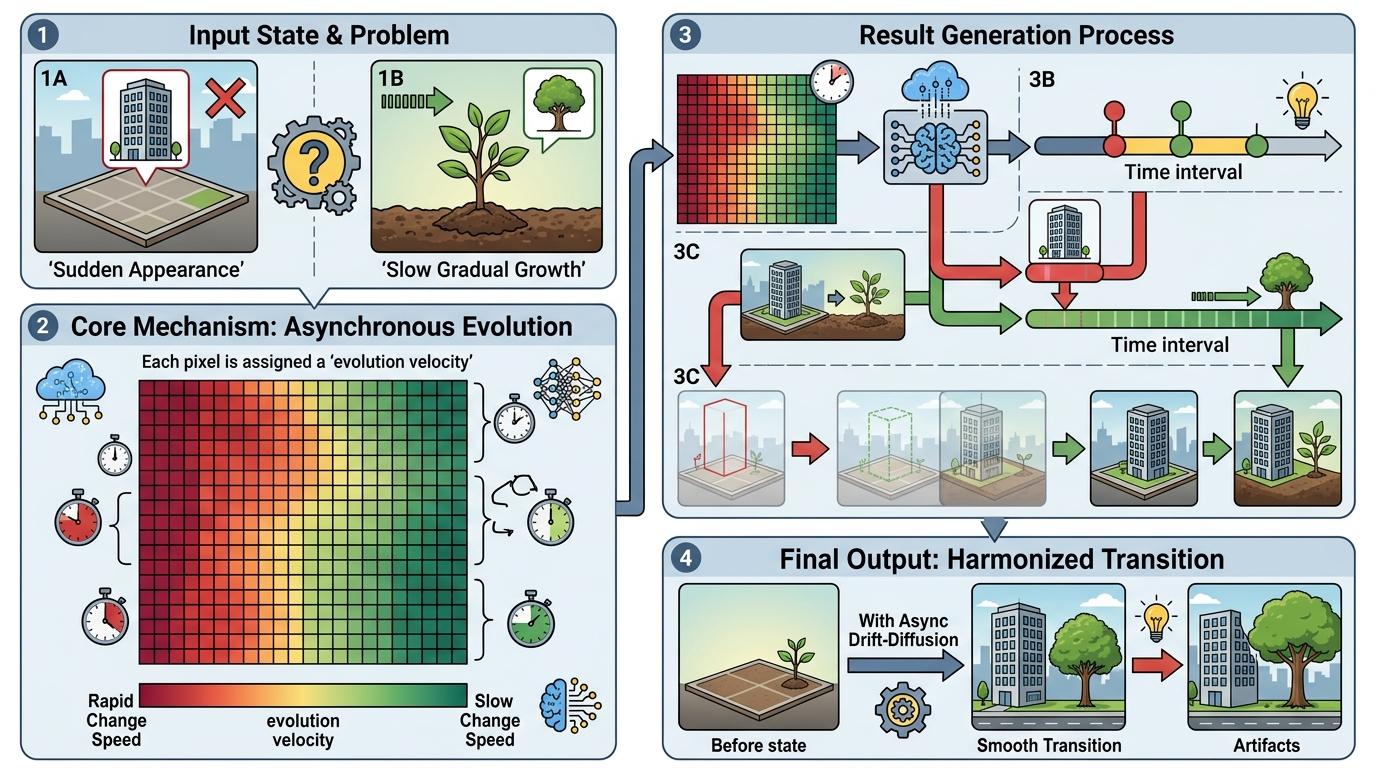

光有框架还不够,关键是怎么让AI同时处理两种完全不同的变化:比如新建筑是“突然出现”的,而树木生长是“缓慢渐变”的。ChangeBridge的核心杀招,就是这套“异步漂移扩散机制”——简单说,就是给每个像素分配不同的“演化速度”。

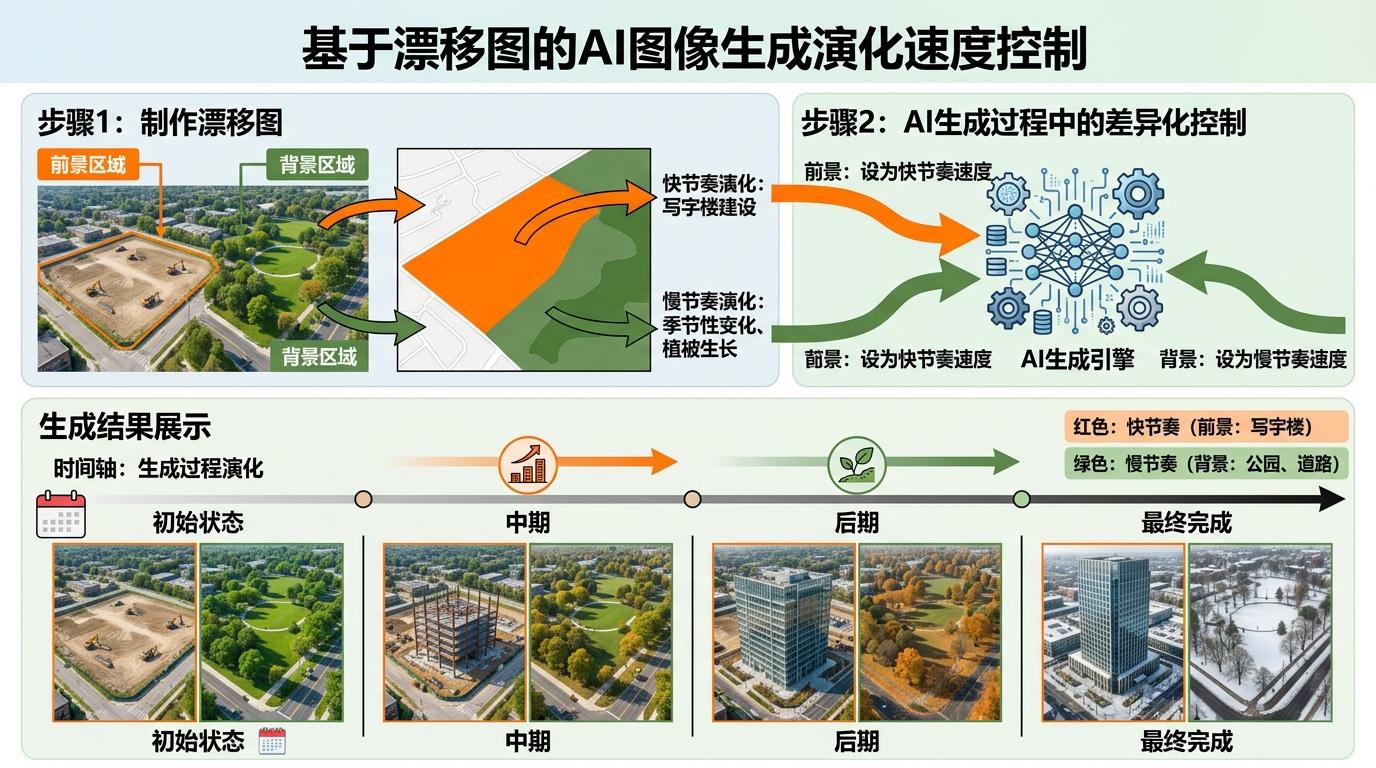

团队会先做一张“漂移图”:把需要突然变化的前景区域(比如要建写字楼的空地)标出来,给它们设一个快节奏的演化速度;而背景区域(比如已经存在的公园、道路)则设一个慢节奏的速度。在AI生成图像的过程中,前景区域会快速完成从空地到写字楼的转变,背景区域则慢慢模拟季节更替、植被生长的细微变化。

为了让AI精准识别这些速度差异,他们还设计了“漂移感知去噪模块”——就像给AI装了个“速度导航仪”,让它在每一步去噪时都能记住:哪些地方要快变,哪些地方要慢变,最终生成的图像里,新建筑和周围环境的光影、植被状态完全匹配,看不出任何拼接痕迹。

实验数据最能说明问题:在LEVIR-CC数据集的坐标文本条件测试中,ChangeBridge的FID指标(衡量生成图像和真实图像相似度的核心指标)从传统方法的95.64降到了31.45,几乎是现有最优水平的三分之一;在WHU-CD的实例布局测试中,代表语义一致性的IoU指标达到了78.13%,比ControlNet等主流方法提升了近5个百分点。

当然,ChangeBridge也不是完美的。目前它还只能处理256×256分辨率的图像,离实际遥感应用需要的高分辨率还有差距;而且训练一次需要12到25小时,推理也需要200步,计算成本依然很高——就像现在的高端相机,拍出来的照片好,但价格贵、操作复杂,普通人用不起。

另外,它现在只能处理光学遥感数据,还没法融合SAR雷达、热红外等多模态数据;一旦遇到不同传感器的数据冲突,比如光学图像里的阴影和SAR图像里的真实地形不符,AI还没法自动协调这些矛盾。不过团队已经在计划引入流匹配技术来加速推理,未来还会尝试融合更多传感器数据,让生成的场景更接近真实世界。

更重要的是,它已经展现出了作为“数据引擎”的潜力:用它生成的模拟数据来训练变化检测模型,能让WHU-CD数据集的IoU指标提升2.26%,这对于遥感变化检测这种极度依赖标注数据的任务来说,不啻于找到了一个无限量的“数据加油站”。

当我们能提前“看见”地球的未来,很多事情都会变得不一样:城市规划师可以提前模拟新商圈对交通的影响,生态学家能预测冰川融化的精确范围,救灾团队可以提前演练洪水到来后的场景。

ChangeBridge的意义,不止是生成了更逼真的遥感图像,更在于它第一次让AI真正理解了地球表面的“异步变化”——有些变化是突发的,有些是缓慢的,而真实的世界,本来就是这两种变化交织的结果。

精准模拟地球,才能更好地守护地球。