对抗知识焦虑,从看懂这条开始

App 下载

靠算法省成本的AI公司,跑去草原建机房了

潜在注意力机制|稀疏专家混合模型|电力调度|服务器散热|数据中心运维|AI产业应用|人工智能

对抗知识焦虑,从看懂这条开始

App 下载

潜在注意力机制|稀疏专家混合模型|电力调度|服务器散热|数据中心运维|AI产业应用|人工智能

月薪3万,去草原给AI公司运维机房——这不是段子,是2026年春AI圈最耐人寻味的招聘启事。那家靠“小力出奇迹”闻名的公司,过去总说要靠算法优化绕开硬件限制,如今却要亲自下场,从机房立项、建设到运营一把抓。他们要把写训练代码的效率哲学,硬生生延伸到草原上的服务器散热、电力调度里。为什么一家以轻资产算法为傲的公司,突然要啃起数据中心运营这最“重”的骨头?这背后藏着AI大模型时代最核心的生存逻辑。

过去他们的效率革命,只发生在代码里:用稀疏专家混合模型让大模型“按需激活”参数,把每token的内存消耗压到行业的七分之一;靠多头潜在注意力压缩缓存,让长上下文处理速度翻番。创始人梁文锋那句“反对大力出奇迹”,曾是算法圈对抗硬件焦虑的口号——不用堆最贵的GPU,靠架构优化就能跑出顶尖性能。

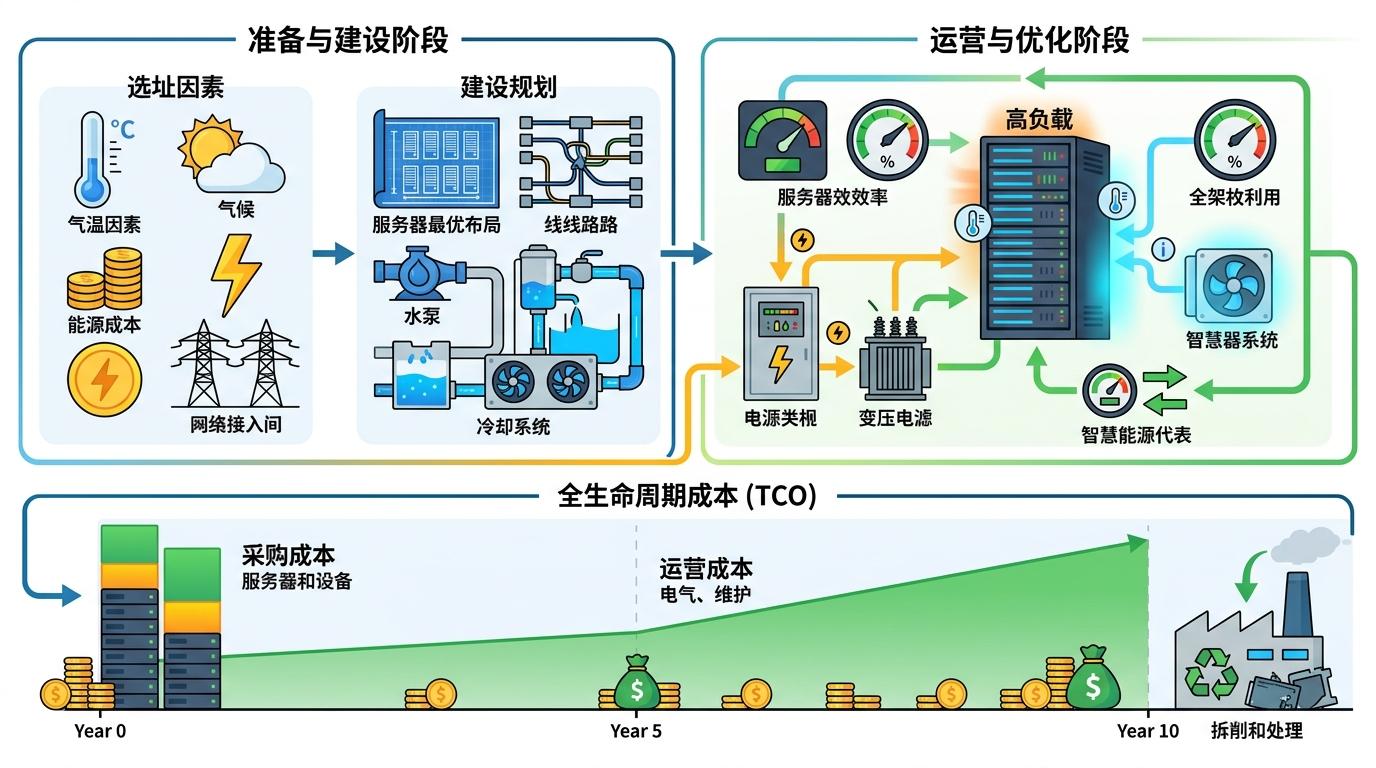

但这一次,他们要把这套逻辑从比特世界推进到原子世界。自建数据中心,意味着要把“效率最优”从模型训练,贯穿到机房的每一个细节:从选址时的气温、电价,到建设时的机柜布局、冷却系统,再到运营时的电力调度、服务器利用率。他们要算的不再只是每一轮训练的算力成本,而是数据中心全生命周期的总体拥有成本(TCO)——从服务器采购到十年后报废的每一分钱都要抠到极致。

这是一场从“优化代码”到“优化物理世界”的延伸。就像一位厨师,过去只钻研怎么把有限的食材做出珍馐,现在要亲自去种粮、磨面,从源头控制每一份成本。

他们最终把机房落在了乌兰察布——这片年均气温只有7℃的草原,是国家“东数西算”的核心枢纽之一。这里的优势,每一项都精准命中“TCO最优”的目标:

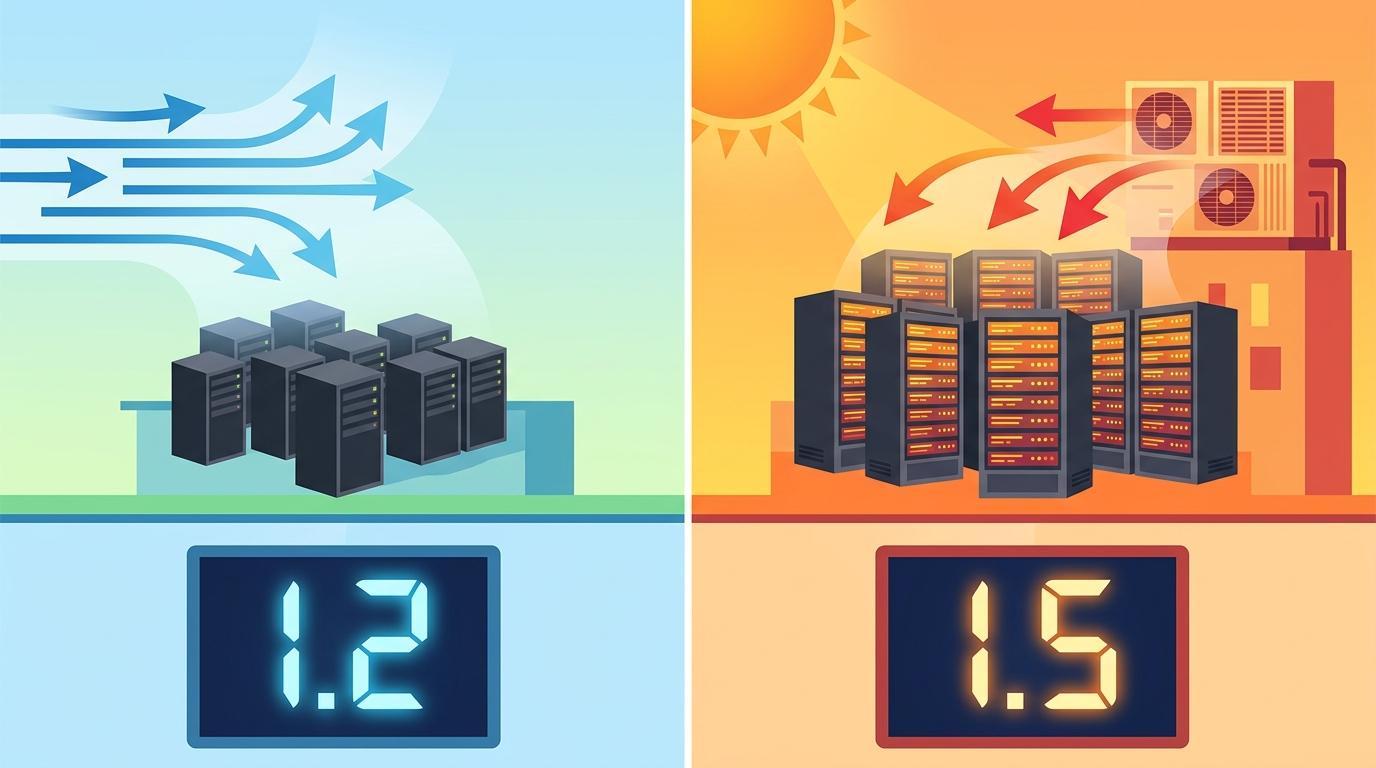

首先是免费的天然空调。数据中心的能耗里,冷却占了近三分之一,而乌兰察布的低温天气,能让数据中心全年大部分时间用自然风冷替代空调。这里新建数据中心的PUE(电源使用效率,越接近1越节能)能严控在1.2以下——而东部城市的数据中心,PUE通常要到1.5甚至更高。别小看这0.3的差距,一个10兆瓦的大型数据中心,一年就能省下近千万度电。

其次是白菜价的绿电。乌兰察布的风电、太阳能装机占比超过65%,电价低至0.32元/千瓦时,是北京的三分之一。对于24小时不间断运行的AI数据中心来说,电费占了运营成本的一半以上——每度电省一毛钱,一个超大规模机房一年就能省下上亿元。

更重要的是,这里已经是成熟的算力集群:华为、阿里的超大型数据中心早已落地,配套的电网、通信、运维产业链一应俱全。这相当于在一个成熟的工业园区里建工厂,不用从零修马路、铺管线,把自建机房的风险和门槛降到了最低。

这家公司的转型,本质上是踩中了AI行业的一个关键拐点:当算法创新的边际效益开始递减,算力就成了新的护城河。

过去十年,AI的进步靠的是算法突破:从CNN到Transformer,每一次架构革新都能让模型性能跳级。但到了万亿参数时代,算法能挖的潜力越来越有限——再精巧的架构优化,也很难弥补“没有足够算力训练模型”的差距。传闻中他们即将发布的V4模型,参数规模直奔万亿,上下文窗口突破百万token,这样的模型,没有足够的算力支撑,再厉害的算法也无从施展。

更现实的是,大模型的竞争早已从“训练出好模型”转向“低成本运行好模型”。推理阶段的算力消耗,是训练阶段的数十倍——用户每问一个问题,背后都要消耗算力。如果能把机房的运营成本降20%,就能在保持相同服务质量的前提下,把价格降15%,这在To C市场里是致命的竞争力。

当然,这条路也不是没有风险:自建数据中心是重资产投入,动辄数亿甚至数十亿,一旦行业风向变化,很容易变成沉重的包袱;而且数据中心运营是完全陌生的领域,从算法工程师到机房运维,隔的不是一个部门,而是一整个行业的经验壁垒。

当草原上的服务器开始轰鸣,AI行业的竞争逻辑正在悄悄改变。过去我们以为,AI的未来属于最会写算法的人;现在才发现,真正的玩家要能同时管好代码里的比特和机房里的原子。

这就像一场马拉松,前半程比的是爆发力(算法创新),后半程拼的是耐力(算力效率)。那些能把每一分算力都用到极致的公司,才能在这场长跑里笑到最后。

算力不是目的,而是让算法持续创新的底气。 当草原上的风带着服务器的轰鸣吹过,我们看到的不只是一个AI公司的转型,更是整个AI行业从“狂飙突进”到“精耕细作”的开始。